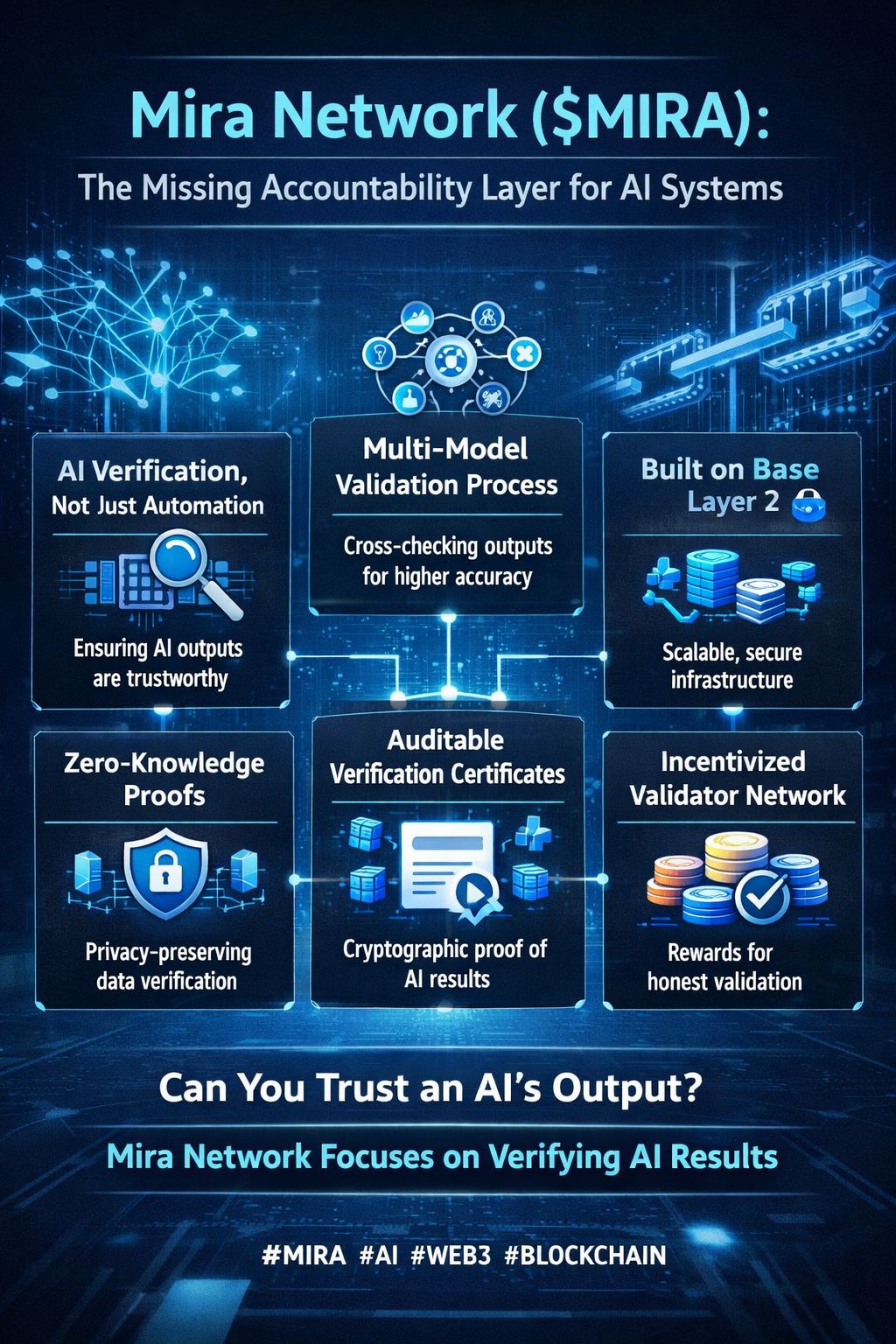

$MIRA Rete ($MIRA): Il Livello di Responsabilità Mancante per i Sistemi di IA

Negli ultimi anni, la maggior parte delle conversazioni sull'intelligenza artificiale si è concentrata su un tema centrale: rendere i modelli di IA più potenti. Modelli più grandi, risposte più rapide e livelli di automazione più elevati dominano la discussione. Tuttavia, mentre esploravo i diversi progetti di IA che emergono nell'ecosistema Web3, una particolare domanda mi ha colpito: Come possiamo veramente fidarci delle uscite dell'IA quando le decisioni del mondo reale dipendono da esse?

Questa domanda mi ha portato a dare uno sguardo più approfondito a Mira Network ($MIRA ). Invece di competere nella corsa per costruire il modello di IA più intelligente, Mira sta cercando di risolvere un problema diverso: verificare se le uscite generate dall'IA sono affidabili.

Perché la verifica dell'IA potrebbe contare di più rispetto alla costruzione di modelli più intelligenti

I moderni sistemi di IA sono incredibilmente capaci. Riassumono informazioni complesse, analizzano grandi set di dati e assistono nel processo decisionale in molti settori. Ma mentre l'accuratezza è importante, non risolve completamente il problema che le organizzazioni affrontano negli ambienti reali.

Per le istituzioni che operano in settori regolamentati come la finanza, la sanità e la ricerca, ogni decisione importante deve essere difendibile e auditabile. Se un sistema di IA produce una raccomandazione, le aziende potrebbero eventualmente dover spiegare come quel risultato è stato verificato prima di essere utilizzato.

Semplicemente dire "il modello ha generato questa risposta" è raramente sufficiente.

Questo divario tra l'accuratezza dell'IA e la reale responsabilità è dove si posiziona la rete Mira.

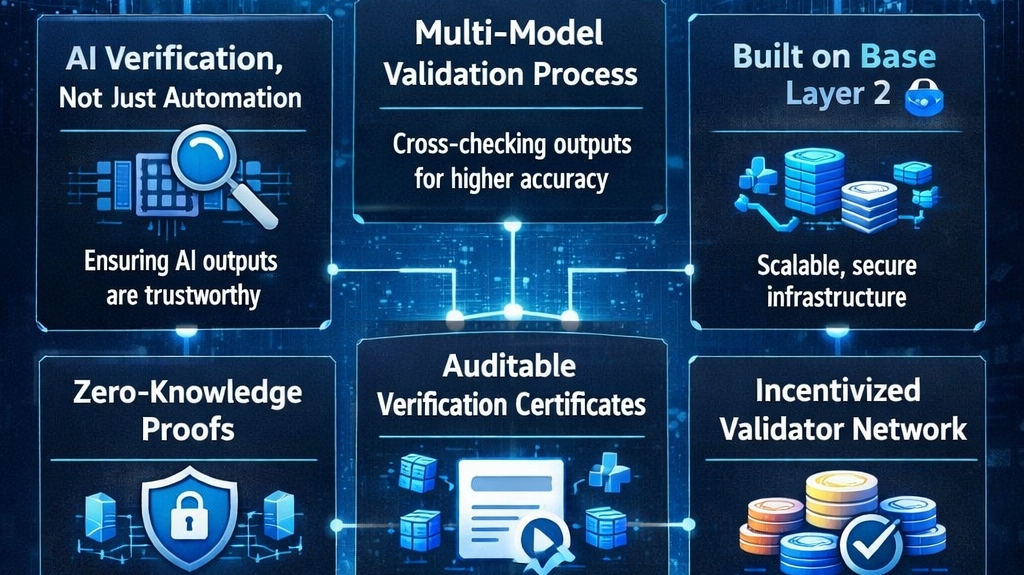

L'idea principale di Mira: verificare l'IA invece di fidarsi di un singolo modello

La maggior parte dei sistemi di IA si basa su un modello per produrre una risposta. Se quel modello allucina, contiene bias o interpreta male il contesto, l'uscita può essere difettosa.

Mira affronta questo in modo diverso.

Invece di fare affidamento su un singolo modello di IA, la rete instrada le richieste generate dall'IA attraverso più validatori distribuiti e diversi sistemi di IA. Ogni partecipante valuta indipendentemente la richiesta prima che una decisione finale venga accettata.

Questo approccio di verifica multi-modello offre diversi vantaggi:

Riduce le allucinazioni

Minimizza il bias nascosto

Controlla le uscite attraverso diverse architetture e set di dati

Aumenta l'affidabilità complessiva

Secondo il design del sistema, questo processo di verifica può raggiungere livelli di accuratezza vicini al 96% in molti scenari.

È importante notare che Mira non sta cercando di creare un "modello di IA perfetto."

Sta costruendo un livello di verifica che controlla se le uscite dell'IA possono essere fidate.

Costruito su Base: infrastruttura progettata per la scala

Da una prospettiva infrastrutturale, la rete Mira è costruita su ****, la rete Ethereum Layer-2 sviluppata da ****.

Questa scelta è significativa perché i sistemi di verifica richiedono:

Alto throughput

Costi di transazione bassi

Forti garanzie di sicurezza

Base consente a Mira di elaborare grandi volumi di richieste di verifica in modo efficiente, beneficiando comunque della sicurezza e decentralizzazione sottostante di Ethereum.

L'architettura di verifica a tre livelli di Mira

L'architettura di Mira è strutturata in tre livelli chiave, ciascuno progettato per garantire una verifica affidabile dell'IA.

1. Livello di standardizzazione degli input

Questo livello prepara e normalizza i prompt prima che inizi la verifica.

Aiuta a prevenire la deriva contestuale, una situazione in cui piccole variazioni nei prompt producono risultati significativamente diversi.

Standardizzando gli input, Mira garantisce che i validatori stiano analizzando informazioni coerenti.

2. Livello di distribuzione

Una volta che l'input è standardizzato, i compiti di verifica sono distribuiti tra i validatori utilizzando il random sharding.

Questo approccio:

Distribuisce il carico computazionale

Protegge dati sensibili

Previene il controllo centralizzato sui risultati di verifica

Più partecipanti analizzano indipendentemente la richiesta.

3. Livello di aggregazione

La fase finale raccoglie le risposte dai validatori e forma consenso attraverso un meccanismo di super maggioranza.

Quando abbastanza validatori concordano, il sistema genera un certificato di verifica crittografico collegato a quell'uscita dell'IA.

Questo certificato registra:

Quali validatori hanno partecipato

Quando è avvenuta la verifica

L'hash crittografico dell'uscita

Il risultato del consenso

Trasformare le uscite dell'IA in registri auditabili

Un modo utile per comprendere l'approccio di Mira è attraverso un'analogia di produzione.

In molte industrie, i prodotti passano attraverso più checkpoint di ispezione prima di raggiungere il mercato. Ogni checkpoint produce documentazione che conferma che gli standard di qualità sono stati rispettati.

Mira applica un concetto simile all'IA.

Invece di trattare le risposte dell'IA come uscite temporanee, il sistema le converte in registri verificabili supportati da prove crittografiche.

Questo potrebbe rendere le decisioni dell'IA auditabili, il che è critico per le imprese e le industrie regolamentate.

Privacy attraverso il coprocessore SQL a conoscenza zero

Un'altra caratteristica interessante dell'ecosistema è la capacità di coprocessore SQL a conoscenza zero di Mira.

Questo consente alle organizzazioni di dimostrare che il risultato di una query del database è corretto senza rivelare la query effettiva o il set di dati sottostante.

Per le industrie in cui le normative sulla privacy sono rigorose, questo può essere estremamente prezioso.

Esempi includono:

Istituzioni finanziarie

Organizzazioni sanitarie

Ambienti di ricerca scientifica

Queste entità possono verificare i risultati mantenendo i dati sensibili privati.

Incentivi che incoraggiano una verifica onesta

Come molti sistemi decentralizzati, anche Mira include un modello di incentivo economico.

I validatori devono impegnare capitali per partecipare al processo di verifica.

In cambio:

I validatori onesti guadagnano ricompense

I validatori disonesti o negligenti affrontano sanzioni

Questo meccanismo incoraggia i partecipanti a mantenere elevati standard di verifica in tutta la rete.

Compatibilità cross-chain

Un altro aspetto pratico del design di Mira è la sua compatibilità cross-chain.

Invece di costringere gli sviluppatori a migrare l'intera applicazione a un ecosistema, il livello di verifica di Mira può integrarsi con progetti in più reti blockchain.

Questa flessibilità potrebbe facilitare agli sviluppatori l'adozione dell'infrastruttura di verifica senza dover ricostruire i sistemi esistenti.

I compromessi della verifica

I sistemi di verifica comportano anche compromessi.

Poiché sono coinvolti più validatori, la verifica distribuita richiede più tempo rispetto a fare affidamento su un singolo modello di IA. Ciò introduce un certo ritardo in alcuni casi d'uso.

Ci sono anche domande più ampie sulla responsabilità e responsabilità se un'uscita dell'IA verificata si rivela problematica.

Queste sfide non sono uniche per Mira: fanno parte della discussione più ampia sulla governance e responsabilità dell'IA.

Perché la verifica potrebbe essere la prossima fase dell'infrastruttura dell'IA

Durante la ricerca sulla rete Mira, un'osservazione è emersa.

Le discussioni sul progetto tendono a concentrarsi di più sull'architettura, l'infrastruttura e i meccanismi di verifica piuttosto che sulla speculazione a breve termine sul prezzo del token. Questo suggerisce spesso una comunità che è più interessata alla tecnologia sottostante.

Man mano che l'IA diventa sempre più integrata nei sistemi finanziari, nelle istituzioni di ricerca e negli ambienti normativi, le organizzazioni avranno probabilmente bisogno di modi affidabili per dimostrare che le uscite generate dall'IA sono state verificate prima di essere utilizzate.

L'infrastruttura progettata per fornire questo tipo di responsabilità potrebbe diventare uno strato critico nell'economia dell'IA futura.

Considerazioni finali

Lo sviluppo dell'IA si è principalmente concentrato sul rendere i modelli più intelligenti. Ma l'adozione a lungo termine dipenderà da qualcosa di altrettanto importante: fiducia.

Se le uscite dell'IA non possono essere verificate, auditabili o spiegate, le organizzazioni esiteranno a fare affidamento su di esse per decisioni importanti.

Progetti come $MIRA Network ($MIRA) stanno esplorando un percorso diverso: costruire l'infrastruttura che garantisce che i sistemi di IA possano essere fidati.

Se il futuro dell'IA dipende non solo dall'intelligenza ma anche dalla responsabilità, i livelli di verifica come Mira potrebbero svolgere un ruolo chiave nel plasmare come l'IA si integra nel mondo reale.

Tag:

#AI #Web3 #Blockchain #Mira Network #AIInfrastructure #DecentralizedAI #Network #AIInfrastructure #DecentralizedAI #

#Mira #

#AltcoinSeasonTalkTwoYearLow #

#NewGlobalUS15%TariffComingThisWeek