C'è qualcosa di eccitante e inquietante nell'era dell'intelligenza artificiale in cui viviamo. Ogni giorno assistiamo a macchine che scrivono storie, risolvono problemi complessi, rispondono a domande difficili e persino aiutano gli scienziati a sbloccare nuove scoperte. A volte sembra di assistere alla nascita di un nuovo tipo di intelligenza, una che può elaborare informazioni più velocemente di qualsiasi mente umana. Eppure, sotto questa meraviglia, si nasconde un quieto sentimento di esitazione che molte persone faticano a esprimere. Ammiriamo ciò che l'IA può fare, ma nel profondo ci poniamo ancora una semplice domanda: possiamo davvero fidarci di essa?

Chiunque abbia trascorso del tempo interagendo con sistemi di IA ha probabilmente vissuto quel momento strano in cui una macchina risponde con completa sicurezza, anche quando le informazioni non sono del tutto corrette. Le parole suonano convincenti, la spiegazione sembra logica e la risposta appare rifinita, eppure da qualche parte si nasconde un errore. Nel mondo dell'IA, questi errori sono spesso chiamati allucinazioni. Per il sistema è solo un'altra previsione basata su schemi nei dati, ma per la persona che legge la risposta può sembrare di essere fuorviata da qualcosa che sembrava certo. Nelle conversazioni informali, questi errori possono essere innocui, ma quando la stessa tecnologia inizia a influenzare decisioni sanitarie, sistemi finanziari, analisi di ricerca o politiche pubbliche, le conseguenze diventano molto più serie.

Questa è la crisi silenziosa che circonda l'intelligenza artificiale oggi. L'umanità ha costruito macchine capaci di intelligenza straordinaria, ma l'intelligenza da sola non è sufficiente. La conoscenza senza affidabilità può creare confusione invece di chiarezza. Una macchina che genera informazioni rapidamente è impressionante, ma una macchina che genera verità è qualcosa di completamente diverso. Fino a quando questa lacuna non sarà risolta, il mondo continuerà a muoversi con cautela, senza mai permettere completamente all'IA di assumere le responsabilità che il suo potere sembra promettere.

Da questa sfida nasce un'idea che si sente sia tecnica che profondamente umana allo stesso tempo. Invece di cercare di costruire un unico sistema di IA perfetto, cosa succederebbe se l'intelligenza stessa potesse essere controllata, verificata e confermata prima di raggiungere le persone? Cosa succederebbe se le risposte generate dalle macchine non fossero semplici previsioni, ma conclusioni che sono state esaminate e validate attraverso un processo trasparente? Questa è la visione che Mira Network porta nella conversazione sul futuro dell'intelligenza artificiale.

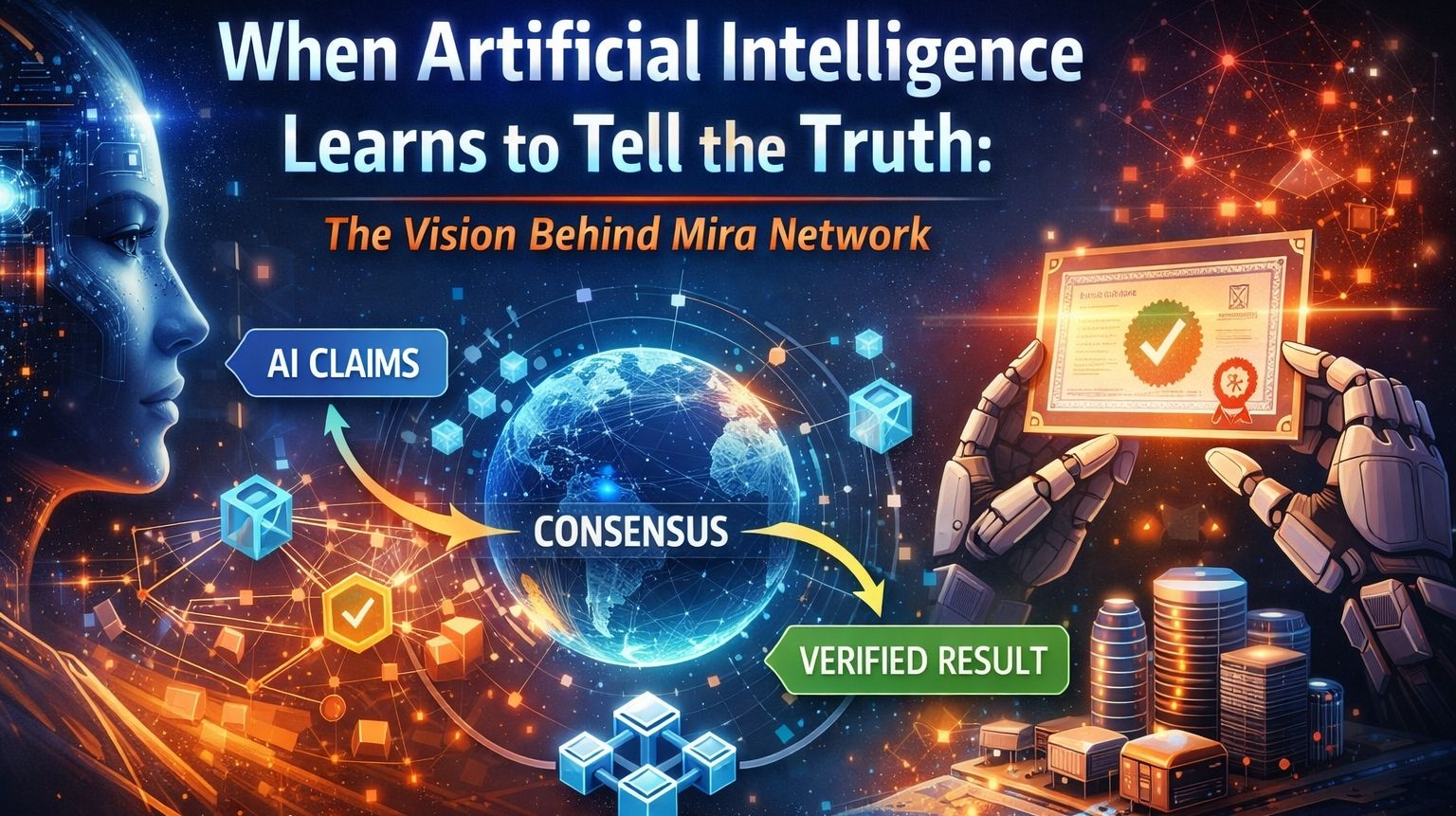

Mira Network introduce un nuovo modo di pensare alla affidabilità dell'IA. Invece di chiedere agli utenti di fidarsi ciecamente dell'output di un singolo modello, il sistema tratta ogni risposta come qualcosa che merita verifica. Quando un'IA produce informazioni, Mira non le accetta immediatamente come verità. Invece, la risposta viene accuratamente scomposta in pezzi più piccoli—singole affermazioni che possono essere esaminate indipendentemente. Ciascuna di queste affermazioni viene quindi inviata attraverso una rete decentralizzata dove più modelli di IA la analizzano da diverse prospettive.

Questo processo crea qualcosa di notevole: una sorta di conversazione digitale tra sistemi intelligenti. Invece di una macchina che parla da sola, molti modelli indipendenti valutano le stesse informazioni, mettendo in discussione se siano corrette, incomplete o fuorvianti. Attraverso questo esame collettivo, la rete forma gradualmente un consenso su ciò che dovrebbe essere considerato affidabile e ciò che dovrebbe essere riesaminato. Il risultato finale non è semplicemente una risposta generata da una macchina, ma una risposta rafforzata da un accordo attraverso un'intera rete di verificatori.

C'è qualcosa di profondamente rassicurante in questo approccio perché rispecchia come la conoscenza umana sia sempre evoluta. Quando gli scienziati scoprono qualcosa di nuovo, non si aspettano che il mondo lo accetti istantaneamente. Il loro lavoro viene esaminato, testato, sfidato e ripetuto da altri ricercatori. La verità diventa più forte attraverso il controllo. Mira Network applica questa stessa filosofia all'intelligenza artificiale, trasformando la verifica in una parte essenziale di come viene prodotta la conoscenza dell'IA.

Un altro strato di fiducia deriva dall'uso della tecnologia blockchain, che registra il processo di verifica in modo trasparente e resistente alle manomissioni. Una volta che le informazioni passano attraverso il processo di consenso della rete, possono essere accompagnate da una prova crittografica che mostra che sono state validate. Per sviluppatori, aziende e utenti, questo significa che il sistema non afferma semplicemente l'accuratezza—fornisce prove che le informazioni sono state esaminate e confermate. In un mondo digitale sempre più pieno di dati, disinformazione e sistemi automatizzati, tale prova potrebbe diventare incredibilmente preziosa.

Dietro le quinte, la rete è alimentata da una comunità di partecipanti che contribuiscono con potenza di calcolo e capacità di verifica. Questi partecipanti operano nodi che analizzano le affermazioni e aiutano a determinare se le informazioni debbano essere accettate o rifiutate. Il loro lavoro è supportato da incentivi economici, il che significa che la verifica onesta diventa gratificante, mentre il comportamento disonesto comporta un rischio finanziario. Questo crea un ambiente in cui l'accuratezza non è solo incoraggiata ma anche protetta economicamente.

L'importanza emotiva di questa idea diventa più chiara quando immaginiamo quanto profondamente l'IA può plasmare il futuro. L'intelligenza artificiale sta già aiutando i medici ad analizzare i dati medici, assistendo i ricercatori a comprendere i modelli climatici, guidando le aziende attraverso decisioni complesse e aiutando gli studenti ad apprendere in modi nuovi. Man mano che questi sistemi diventano più capaci, inevitabilmente diventeranno più coinvolti nelle scelte che influenzano vite reali. In un futuro del genere, l'affidabilità conterà di più della velocità, e la fiducia conterà di più dell'intelligenza grezza.

Mira Network rappresenta un passo verso la costruzione di quella fiducia. Trasformando le uscite dell'IA in informazioni che possono essere verificate attraverso un consenso decentralizzato, il sistema cerca di risolvere una delle preoccupazioni più umane riguardo alla tecnologia: la paura di credere a qualcosa che si rivela errato. Riconosce che l'intelligenza è potente, ma la responsabilità è essenziale.

Forse l'aspetto più ispiratore di questa visione è che riflette la ricerca della verità da parte dell'umanità. Nel corso della storia abbiamo costruito istituzioni progettate per proteggere la conoscenza dall'errore—revisione paritaria scientifica, giornalismo investigativo, tribunali e dibattiti accademici. Questi sistemi esistono perché la verità diventa più forte quando viene testata da molte menti invece di essere dichiarata da una sola voce. Mira Network porta quel stesso principio nel mondo dell'intelligenza artificiale, creando un ambiente in cui le macchine partecipano a un processo condiviso di verifica.

La storia dell'IA è ancora in fase di scrittura e nessuno sa esattamente fino a dove arriverà la sua influenza. Ma una cosa è certa: il futuro non dipenderà solo da quanto intelligenti diventeranno le nostre macchine. Dipenderà da quanto possiamo fidarci delle informazioni che producono. L'intelligenza può aprire la porta alle possibilità, ma la fiducia è ciò che ci consente di attraversarla con sicurezza.

Se quella fiducia può essere costruita—se le macchine possono generare conoscenza che non è solo veloce ma anche verificata—allora l'intelligenza artificiale potrebbe finalmente andare oltre l'essere uno strumento impressionante e diventare un partner affidabile nella risoluzione delle sfide del nostro mondo. E in quel momento, l'umanità si renderà conto che la vera svolta non è mai stata solo creare macchine intelligenti. La vera svolta è stata imparare a rendere la loro intelligenza degna della nostra fiducia.