Sto aspettando, sto osservando, sto guardando come l'intelligenza artificiale continua a trovare il suo posto nella vita quotidiana, e ho notato un cambiamento silenzioso nel modo in cui le persone trattano le risposte che questi sistemi forniscono. Mi concentro sui piccoli momenti in cui qualcuno fa una domanda, riceve una risposta sicura da una macchina e semplicemente la accetta come verità. Più a lungo lo osservo, più sento una strana tensione crescere sotto la superficie. L'IA sta diventando potente molto rapidamente, ma la fiducia sta ancora cercando di recuperare.

All'inizio, l'entusiasmo attorno all'intelligenza artificiale sembrava comprensibile. Questi sistemi potevano scrivere, spiegare, riassumere e generare idee in pochi secondi. Per molte persone sembrava come aprire una porta su qualcosa di completamente nuovo. Ma quando trascorri abbastanza tempo a utilizzare questi strumenti, un certo schema inizia a rivelarsi lentamente.

Le risposte sembrano spesso perfette.

Le frasi sono fluide. Le spiegazioni sembrano logiche. La fiducia nel tono rende tutto apparentemente affidabile. Ma ogni tanto qualcosa rompe quell'illusione. Un dettaglio non controlla. Un riferimento non porta da nessuna parte. Una statistica appare che nessuno può risalire a una fonte reale.

È una sensazione strana quando la noti per la prima volta. La macchina suona certa, eppure la certezza è vuota.

Le persone lo chiamano allucinazione, ma quella parola non cattura completamente ciò che sta accadendo. Il sistema non sta cercando di ingannare nessuno. Sta semplicemente facendo ciò per cui è stato progettato. Prevede come dovrebbe apparire il prossimo pezzo di testo in base ai modelli che ha appreso.

Verità e previsione non sono la stessa cosa.

Quella differenza diventa molto reale quando questi sistemi iniziano a entrare in ambienti dove l'accuratezza conta realmente. Immagina di fare affidamento sull'IA per aiutare a rivedere contratti, analizzare dati finanziari, assistere nella ricerca medica o supportare decisioni tecniche complesse. In quei momenti, un errore sicuro non è solo scomodo. Può diventare pericoloso.

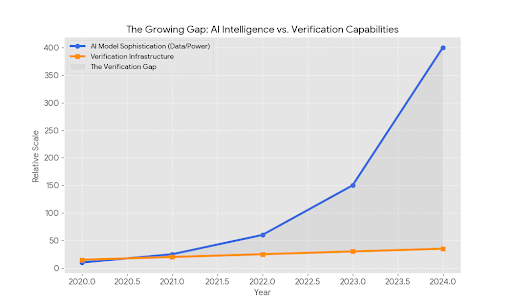

E questa è la parte della conversazione che spesso sembra mancare nel mondo dell'IA. La maggior parte dei progetti continua a correre in avanti cercando di costruire modelli più grandi e più impressionanti. Più dati. Maggiore potenza di calcolo. Maggiore intelligenza.

Ma l'intelligenza da sola non risolve il problema più profondo.

Anche il sistema più intelligente può ancora produrre qualcosa che sembra corretto ma è silenziosamente sbagliato. Il problema non riguarda solo la generazione di informazioni. Riguarda sapere se quelle informazioni meritano di essere fidate.

Questo è il punto in cui qualcosa come Mira Network inizia a sentirsi diverso.

L'idea dietro di essa non insegue la stessa attenzione che la maggior parte dei progetti di intelligenza artificiale sta inseguendo. Inizia da un'osservazione più silenziosa. E se la vera sfida non fosse costruire macchine più intelligenti, ma creare un modo per controllare le macchine che abbiamo già?

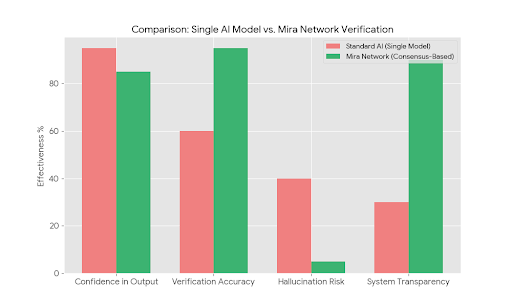

Invece di assumere che un singolo modello di intelligenza artificiale possa essere fidato da solo, Mira affronta il problema con una mentalità diversa. Tratta ogni output dell'IA come qualcosa che deve essere messo in discussione.

Quando un'IA produce una risposta all'interno del sistema Mira, quella risposta non viene semplicemente accettata. Le informazioni al suo interno vengono suddivise in affermazioni più piccole. Ognuna di quelle affermazioni diventa qualcosa che può essere effettivamente esaminato.

Poi succede qualcosa di interessante.

Quelle affermazioni sono distribuite attraverso una rete di modelli di IA indipendenti. Ogni modello guarda le informazioni e cerca di verificare se reggono. Invece di una macchina che parla da sola, più sistemi valutano silenziosamente la stessa idea da angolazioni diverse.

Il processo sembra quasi umano.

Somiglia al modo in cui le persone controllano naturalmente le informazioni nella vita reale. Quando viene detto qualcosa di importante, di solito non ci fidiamo della prima voce che sentiamo. Cerchiamo conferma. Chiediamo agli altri. Confrontiamo prospettive.

Mira trasforma quell'istinto in infrastruttura.

Ciò che rende il sistema ancora più interessante è il ruolo degli incentivi nel processo. I partecipanti alla rete sono incoraggiati a verificare le informazioni onestamente. L'accuratezza diventa qualcosa di prezioso piuttosto che opzionale.

Col tempo, questo crea una pressione sottile all'interno della rete. Il sistema ricompensa coloro che identificano correttamente la verità e sfidano gli errori. Invece di incoraggiare congetture sicure, incoraggia una verifica attenta.

Il layer blockchain sottostante aiuta a rendere questo possibile. I meccanismi di consenso consentono a molti partecipanti di concordare sull'affidabilità di un'affermazione senza fare affidamento su un'autorità centrale. Il risultato non è solo una risposta, ma una risposta che è passata attraverso un processo di validazione indipendente.

Quando ti fermi a pensarci, l'idea sembra stranamente ovvia.

Ogni sistema importante che gestisce informazioni preziose ha bisogno di verifica. Le reti finanziarie verificano le transazioni. Le comunità scientifiche verificano la ricerca. Anche il giornalismo si basa su più fonti prima di pubblicare qualcosa di importante.

L'intelligenza artificiale è cresciuta incredibilmente veloce, ma la verifica non è cresciuta di pari passo.

Quell'impatto sta diventando sempre più difficile da ignorare.

L'IA sta per generare un volume inimmaginabile di informazioni. Rapporti, riassunti di ricerca, codice, bozze legali, analisi di mercato, materiale educativo. Il flusso aumenterà solo man mano che la tecnologia diventa più integrata negli strumenti quotidiani.

Se anche solo una piccola parte di quelle informazioni è inaffidabile, gli effetti a catena potrebbero diffondersi rapidamente. Un singolo errore ripetuto attraverso sistemi automatizzati può moltiplicarsi silenziosamente.

Ecco perché l'idea dietro Mira continua a richiamare la mia attenzione.

Non sta cercando di impressionare le persone con dimostrazioni appariscenti o promesse audaci. Sta cercando di risolvere qualcosa di più silenzioso ma profondamente importante. Sta ponendo una semplice domanda che molti progetti sembrano trascurare.

Come sappiamo quando l'IA sta effettivamente dicendo la verità?

La risposta potrebbe non provenire dal rendere le macchine infinitamente più intelligenti. Potrebbe derivare dalla costruzione di sistemi che permettano alle macchine di mettere in discussione l'una l'altra.

Osservare questo spazio evolversi lentamente crea una sensazione insolita. L'entusiasmo attorno all'IA è ancora molto reale, ma sotto quell'entusiasmo c'è una crescente consapevolezza che l'intelligenza senza verifica è fragile.

E più osservo, più inizio a credere che il futuro dell'intelligenza artificiale possa dipendere meno da quanto velocemente le macchine possono produrre risposte e più dal fatto che finalmente costruiamo sistemi in grado di dimostrare quali risposte meritano di essere credute.