La conversazione attorno all'intelligenza artificiale si sta espandendo rapidamente nel mondo della tecnologia. Ogni settimana vediamo nuovi modelli, nuove capacità e nuove applicazioni emergere. Ma insieme a questo rapido progresso, un'altra domanda continua a crescere: come verifichiamo i risultati prodotti dai sistemi di IA?

L'intelligenza artificiale può analizzare enormi set di dati, generare approfondimenti e automatizzare processi più velocemente che mai. Tuttavia, la velocità da sola non garantisce l'affidabilità. Man mano che l'IA viene integrata in sistemi critici, assicurarsi che i risultati siano affidabili diventa sempre più importante.

Questa sfida diventa ancora più complessa negli ecosistemi decentralizzati. Nelle piattaforme centralizzate tradizionali, gli utenti spesso si affidano alla credibilità delle aziende che gestiscono il sistema. Ma negli ambienti Web3, la fiducia deve derivare da meccanismi trasparenti piuttosto che da autorità centralizzate.

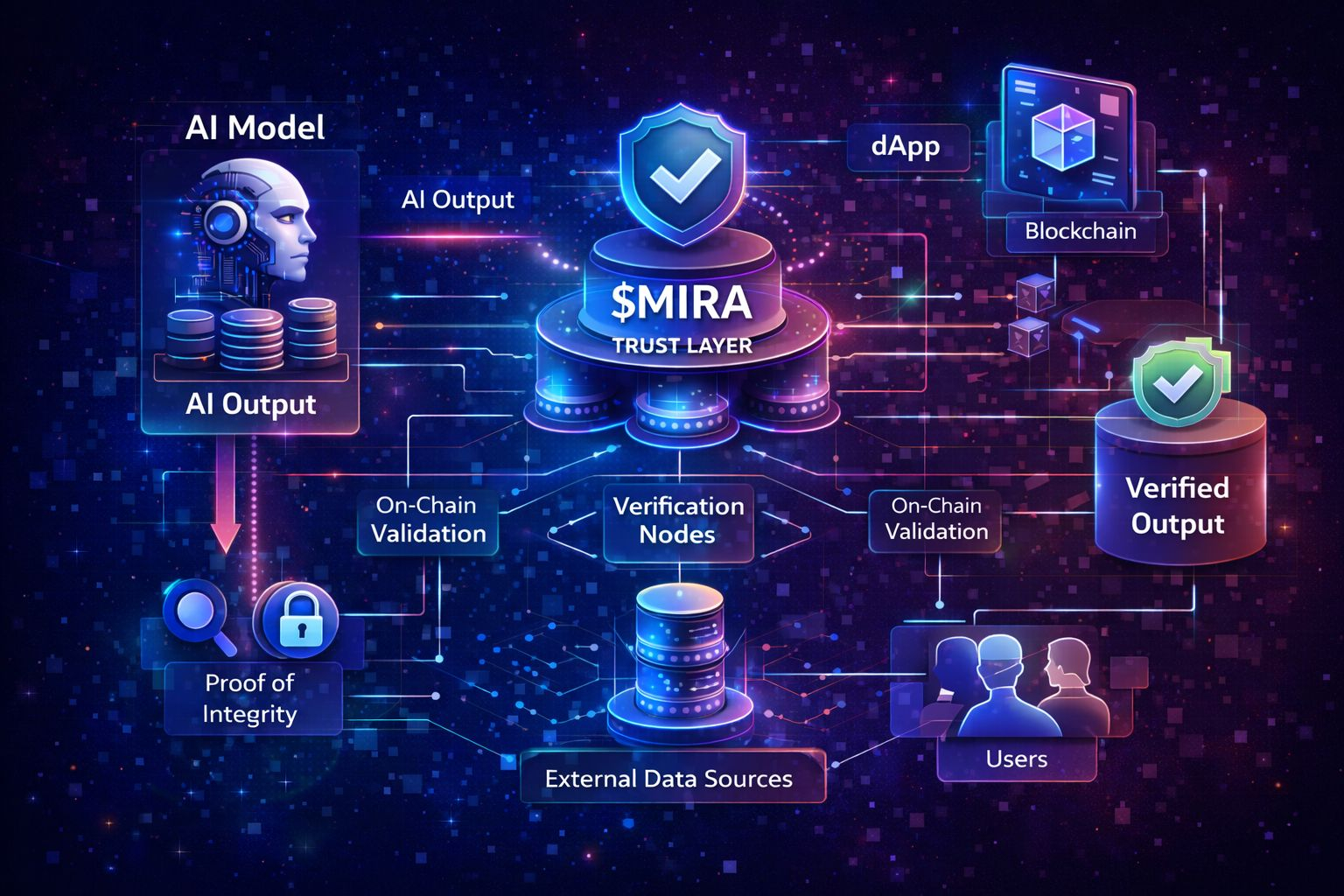

Questo è un motivo per cui i progetti che esplorano l'infrastruttura di verifica stanno guadagnando attenzione. Mentre ricercavo diversi approcci, ho iniziato a guardare più in profondità l'idea dietro @mira_network e come $MIRA mira a esplorare il concetto di un livello di fiducia per l'AI.

L'idea è interessante perché i risultati dell'AI sono spesso difficili da verificare rapidamente. Un modello di AI può produrre una risposta in pochi secondi, ma verificare quella risposta può richiedere tempo, competenza e accesso a fonti di dati affidabili. Questo squilibrio tra generazione e verifica crea potenziali sfide man mano che l'adozione dell'AI aumenta.

Se le applicazioni decentralizzate iniziano a fare affidamento su intuizioni guidate dall'AI, devono esistere sistemi per confermare che quelle intuizioni soddisfino gli standard di affidabilità. I livelli di verifica potrebbero aiutare a fornire trasparenza e fiducia quando i sistemi AI interagiscono con applicazioni basate su blockchain.

Un'altra ragione per cui questo argomento è importante è l'overlap crescente tra AI e Web3. Le reti blockchain sono già utilizzate per sistemi finanziari, proprietà digitale, meccanismi di governance e infrastrutture distribuite. Man mano che gli strumenti AI si integrano con questi ambienti, garantire risultati affidabili diventa un fattore critico.

Progetti come @mira_network stanno esplorando come l'infrastruttura decentralizzata potrebbe supportare i processi di verifica dell'AI. Il concetto dietro $MIRA si concentra sulla costruzione di framework che consentano ai risultati dell'AI di essere convalidati piuttosto che accettati ciecamente.

Questo approccio potrebbe potenzialmente aiutare a rafforzare l'affidabilità delle applicazioni basate su AI negli ecosistemi Web3. Che si tratti di analisi dei dati, governance decentralizzata o processi automatizzati, i meccanismi di verifica potrebbero fornire ulteriore fiducia per gli utenti che interagiscono con i sistemi AI.

Durante la campagna #Mira, osservare come la comunità reagisce a queste idee è stato piuttosto interessante. I periodi di campagna portano spesso nuovi partecipanti che iniziano a esplorare la visione del progetto e discutere le implicazioni più ampie della verifica dell'AI.

In molti modi, la prossima fase dello sviluppo dell'AI potrebbe non concentrarsi solo sull'intelligenza, ma anche sulla credibilità. I sistemi capaci di generare intuizioni potenti devono anche fornire modi per convalidare quelle intuizioni.

Questo è il motivo per cui le conversazioni attorno ai livelli di fiducia, ai framework di verifica e all'infrastruttura AI decentralizzata stanno diventando sempre più importanti.

Osservare come queste idee si sviluppano attorno a @mira_network e $MIRA fornisce uno sguardo interessante su come la comunità Web3 sta pensando al futuro rapporto tra AI e fiducia.