Come qualcuno che trascorre molto tempo a guardare strumenti e infrastrutture per l'IA, un problema continua a emergere: i modelli di IA sono potenti, ma non sono sempre affidabili. Chiunque abbia costruito con modelli di linguaggio di grandi dimensioni sa che le allucinazioni e le uscite errate possono ancora verificarsi.

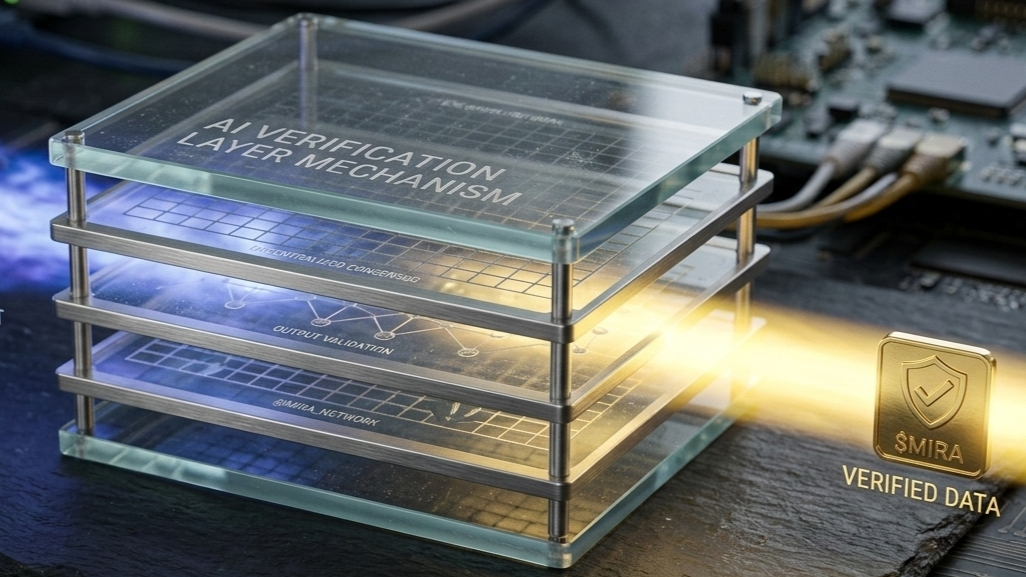

Ecco perché l'approccio adottato da @Mira - Trust Layer of AI ha catturato la mia attenzione. Invece di concentrarsi semplicemente su modelli più veloci o dataset più grandi, il progetto sta lavorando a uno strato di verifica per le uscite dell'IA. L'idea è piuttosto semplice: piuttosto che fidarsi ciecamente di ciò che produce un modello di IA, la rete può convalidare le risposte utilizzando meccanismi di verifica decentralizzati.

Dal punto di vista di uno sviluppatore, questo potrebbe essere estremamente utile. Man mano che più applicazioni iniziano a utilizzare agenti IA, sistemi di automazione e servizi on-chain, avere un modo per verificare crittograficamente i risultati potrebbe ridurre i rischi e migliorare la fiducia nei processi automatizzati.

Apre anche la porta a sistemi IA che interagiscono direttamente con ambienti blockchain. Se i risultati possono essere verificati da una rete, gli sviluppatori possono creare applicazioni affidabili basate su IA senza dipendere da un singolo fornitore fidato.

Ecco perché sto tenendo d'occhio $MIRA. Se l'ecosistema attorno a @Mira - Trust Layer of AI continua a svilupparsi, il progetto potrebbe diventare un pezzo importante dell'emergente stack infrastrutturale IA+crypto.

Curioso di vedere come i costruttori iniziano a sperimentare con esso nei prossimi mesi.