Quando sento per la prima volta la frase “intelligenza artificiale verificata” la mia reazione non è l'eccitazione immediata che circonda di solito i nuovi annunci di infrastrutture AI, ma un senso più tranquillo di riconoscimento perché riconosce qualcosa che le persone che lavorano a stretto contatto con i sistemi di apprendimento automatico sanno da molto tempo, cioè che la vera barriera per un'AI affidabile non è mai stata la generazione di output, ma la capacità di dimostrare che quegli output sono stati prodotti in modo affidabile, tracciabile e verificabile piuttosto che emergere da una scatola nera che nessuno può auditare o riprodurre con fiducia.

Per anni la conversazione sull'intelligenza artificiale si è concentrata su capacità, scala e velocità, il che ha portato al rapido dispiegamento di modelli sempre più potenti che possono generare testi, codici, immagini e decisioni con straordinaria fluidità; tuttavia, questo progresso ha anche esposto una debolezza fondamentale che diventa impossibile da ignorare mentre questi sistemi iniziano a influenzare decisioni finanziarie, conclusioni di ricerca e infrastrutture digitali, poiché agli utenti viene spesso chiesto di fidarsi di output che non possono verificare in modo indipendente e gli sviluppatori sono tenuti a difendere modelli i cui processi di ragionamento rimangono per lo più opachi.

Il modello tradizionale di distribuzione dell'IA pone il peso della fiducia sull'utente, il che significa che individui, organizzazioni e piattaforme devono decidere se credere all'output di un sistema senza avere un modo chiaro per verificare l'integrità del calcolo che lo ha prodotto, e mentre questo accordo può funzionare per compiti a basso rischio come generare testi pubblicitari o riassumere documenti, diventa rapidamente fragile quando l'IA inizia a partecipare a sistemi in cui l'accuratezza, la responsabilità e la trasparenza non sono caratteristiche opzionali, ma requisiti fondamentali.

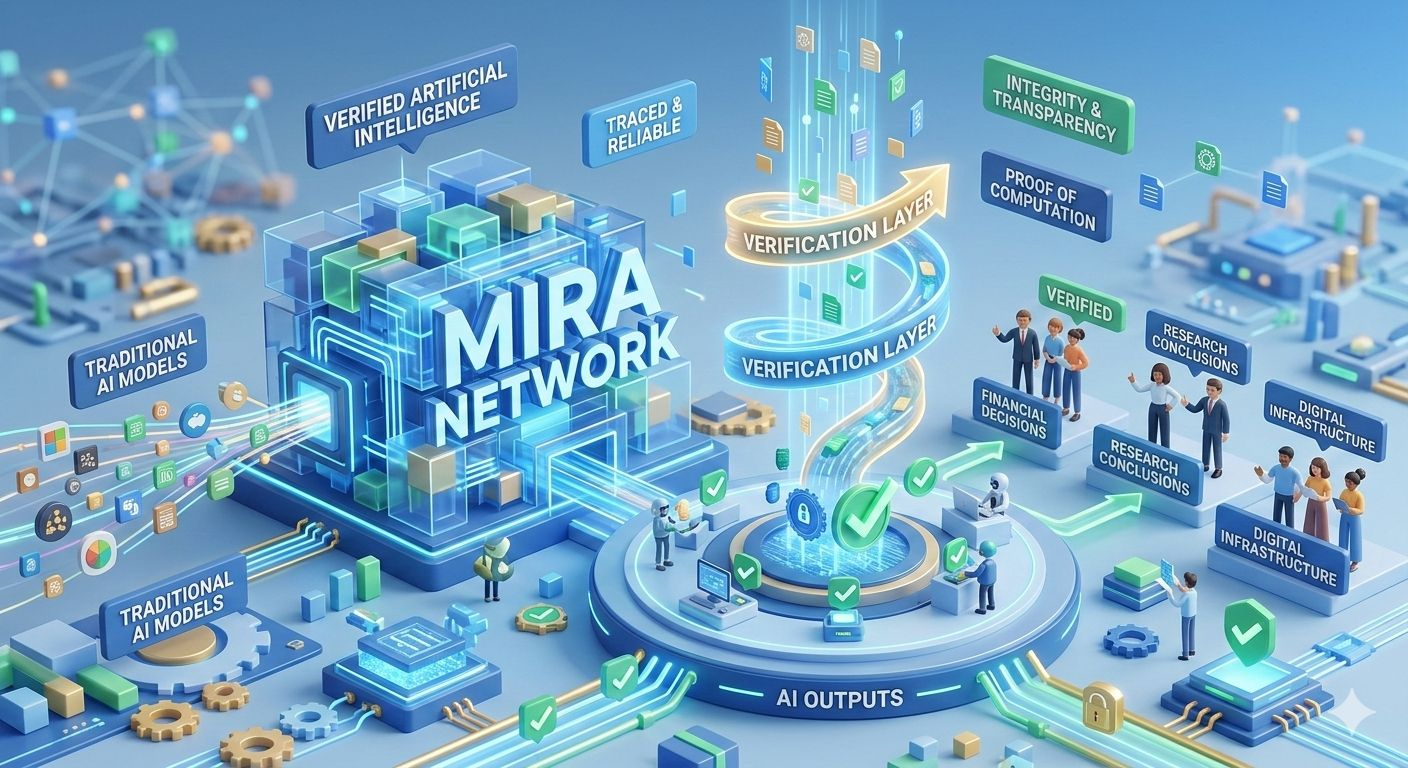

Questo è il contesto in cui la rete Mira inizia a essere rilevante, poiché il concetto alla base non è semplicemente creare un'altra piattaforma di intelligenza artificiale o competere nella corsa per modelli più grandi, ma piuttosto introdurre uno strato di verifica che consenta agli output dell'IA di essere accompagnati da prove crittografiche o computazionali che il processo sottostante è avvenuto esattamente come dichiarato, trasformando efficacemente l'IA da un sistema che produce semplicemente risposte a un sistema che può dimostrare l'integrità di come quelle risposte sono state prodotte.

Una volta che la conversazione si sposta dalla generazione alla verifica, appare immediatamente un nuovo insieme di domande infrastrutturali, poiché produrre risultati di IA verificabili richiede più che far girare un modello su un server e restituire un output, poiché implica il tracciamento dei passi computazionali, l'ancoraggio delle strutture di prova, il coordinamento dei processi di verifica tra partecipanti distribuiti e l'assicurarsi che il costo e la latenza della verifica rimangano pratici abbastanza da supportare applicazioni reali piuttosto che diventare una garanzia teorica che pochi sistemi possono permettersi di utilizzare.

Ciò che emerge da questa architettura non è solo un miglioramento tecnico, ma un cambiamento strutturale nel modo in cui i sistemi di intelligenza artificiale sono integrati negli ecosistemi digitali, poiché la verifica introduce un intero nuovo strato operativo che si colloca tra il calcolo grezzo dell'IA e il consumo dell'utente, e quel livello inizia a somigliare all'infrastruttura nello stesso modo in cui i processori di pagamento, i fornitori di cloud e i validatori blockchain formano componenti invisibili ma essenziali dei servizi digitali moderni.

Le implicazioni di questo cambiamento diventano più chiare quando si considera come funziona attualmente la fiducia nell'industria dell'IA, dove la credibilità è spesso concentrata in un numero ristretto di grandi organizzazioni i cui modelli sono accettati in gran parte a causa della reputazione del marchio, del prestigio della ricerca o del dominio della piattaforma, il che significa che gli utenti alla fine si fidano delle istituzioni piuttosto che dell'integrità verificabile del calcolo stesso, creando una struttura di dipendenza che funziona solo finché quelle istituzioni rimangono sia competenti che benevole.

Una rete di verifica cambia quella dinamica distribuendo la responsabilità della validazione attraverso un sistema più ampio di partecipanti che possono confermare in modo indipendente che una particolare esecuzione del modello ha seguito un insieme specifico di regole o calcoli, il che trasforma gradualmente la fiducia da una promessa istituzionale in una proprietà tecnica che può essere controllata, riprodotta e convalidata indipendentemente da quale entità ha originariamente generato il risultato.

Tuttavia, l'introduzione della verifica crea anche un nuovo insieme di considerazioni operative che molti osservatori sottovalutano, poiché verificare le uscite dell'IA richiede la gestione di prove computazionali, il coordinamento dei validatori, il mantenimento delle strutture di incentivo e l'assicurarsi che i livelli di verifica rimangano resilienti durante i periodi di alta domanda o attività avversarie, il che significa che l'affidabilità della rete di verifica stessa diventa un fattore critico nel determinare se l'intero sistema può funzionare su larga scala.

In questo senso, la rete Mira non introduce semplicemente una funzione che rende più facili da fidare gli output dell'IA, ma stabilisce invece le basi per una nuova classe di operatori di infrastruttura il cui ruolo somiglia a quello delle camere di compensazione finanziarie o dei validatori blockchain, poiché partecipano al processo di conferma dell'integrità computazionale e mantenendo l'affidabilità di un mercato di verifica che si colloca tra i produttori di IA e i consumatori di IA.

Questo sviluppo porta importanti implicazioni di mercato, poiché una volta che la verifica diventa un'aspettativa standard per gli output dell'IA, il panorama competitivo inizia a spostarsi dalla pura capacità del modello verso la qualità della pipeline di verifica che circonda quei modelli, inclusi fattori come la rapidità con cui i risultati possono essere verificati, quanto è trasparente il processo di verifica, quanto robusta rimane la rete durante i periodi di intenso utilizzo e quanto il sistema è resistente alla manipolazione o alla frode.

Il risultato è che le applicazioni di intelligenza artificiale possono competere sempre più non solo su quanto intelligenti sembrano essere i loro modelli, ma anche su quanto affidabilmente possono dimostrare che l'intelligenza è stata eseguita correttamente, il che alza in modo sottile ma significativo lo standard per ciò che gli utenti si aspettano quando interagiscono con sistemi guidati dall'IA che influenzano decisioni del mondo reale o attività finanziarie.

C'è anche una dimensione strategica più profonda in questa evoluzione, poiché l'IA verificata introduce un modello di responsabilità che le piattaforme tradizionali di machine learning hanno faticato a fornire, poiché sviluppatori e organizzazioni non possono più fare affidamento solo sull'autorità della loro infrastruttura, ma devono invece garantire che i loro sistemi operino all'interno di framework che possono resistere a verifiche e scrutinio indipendenti.

Se questo modello ha successo, il significato a lungo termine di reti come Mira non sarà misurato semplicemente dal numero di compiti di IA elaborati attraverso la loro infrastruttura, ma da quanto efficacemente trasformano la fiducia nell'intelligenza artificiale da un accordo sociale in uno standard tecnico verificabile che opera in modo affidabile anche quando i sistemi sottostanti diventano più complessi, più autonomi e più profondamente radicati nel tessuto economico e informativo di Internet.

Ciò porta, in ultima analisi, alla domanda che conta di più quando si valuta l'ascesa dell'intelligenza artificiale verificata, poiché la vera prova di questa architettura non si verificherà quando i sistemi operano in condizioni ideali, ma quando la domanda aumenta, gli attori avversari tentano di manipolare gli output e gli incentivi economici dei partecipanti alla verifica sono messi sotto stress, poiché la credibilità a lungo termine dell'IA verificata dipenderà dal fatto che reti come Mira possano mantenere integrità, trasparenza e affidabilità proprio quando quelle qualità diventano più difficili da garantire.

@Mira - Trust Layer of AI #Mira $MIRA