L'intelligenza artificiale sta diventando sempre più potente ogni anno. Dalla scrittura di contenuti all'analisi dei dati e all'assistenza nella ricerca, gli strumenti di IA sono ora utilizzati in molte aree della vita quotidiana. Tuttavia, esiste ancora un grande problema: la fiducia. I sistemi di IA possono talvolta produrre informazioni che sembrano convincenti ma sono in realtà errate. Questi errori, spesso chiamati allucinazioni, rendono difficile fare affidamento sull'IA in situazioni in cui l'accuratezza è davvero importante.

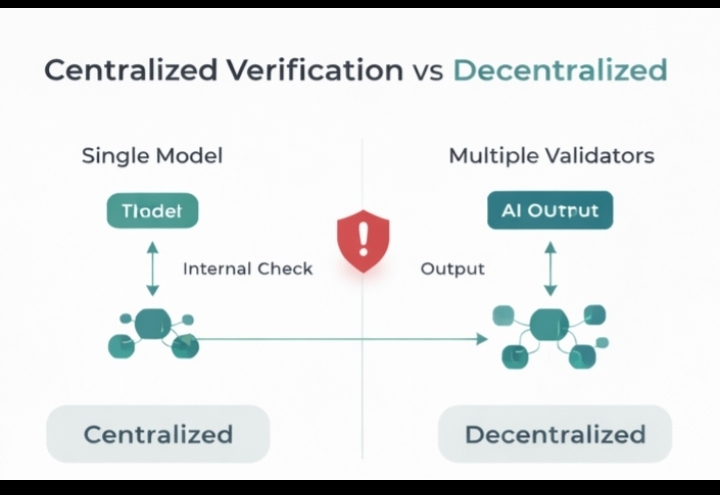

Mira Network sta cercando di risolvere questo problema introducendo un sistema decentralizzato che verifica le informazioni generate dall'IA. Invece di dipendere da un unico modello di IA per produrre e convalidare le risposte, la rete utilizza più modelli indipendenti per controllare le stesse informazioni. Questo approccio riduce il rischio di errori perché diversi sistemi valutano le affermazioni prima che un risultato finale venga accettato.

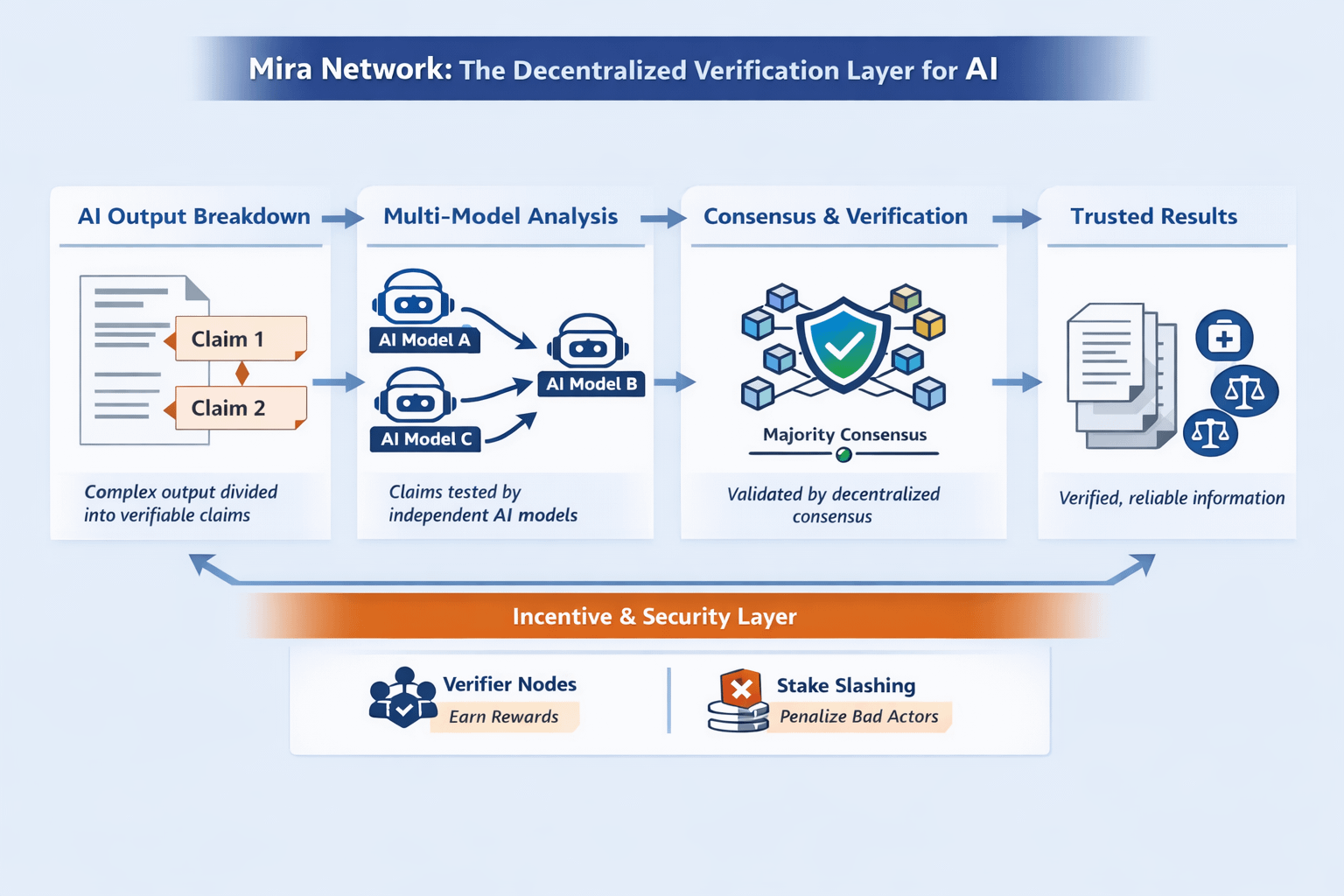

Il processo funziona suddividendo le uscite complesse dell'IA in affermazioni più piccole e chiare che possono essere controllate singolarmente. Ogni affermazione viene quindi esaminata da diversi modelli di IA all'interno della rete. Quando diversi modelli raggiungono la stessa conclusione, il risultato è considerato verificato. Questa verifica è supportata dalla tecnologia blockchain, che registra il risultato in modo trasparente e resistente alle manomissioni.

Un'altra parte importante di Mira Network è il suo sistema di incentivi. I partecipanti che aiutano a verificare le informazioni contribuiscono con potenza di calcolo e ricevono ricompense per il loro lavoro. Questo crea un sistema in cui i partecipanti sono incoraggiati ad agire onestamente e con attenzione. Se qualcuno tenta di manipolare il processo di verifica, il sistema può rilevarlo e applicare sanzioni, contribuendo a mantenere l'affidabilità della rete.

L'idea alla base di Mira Network diventa particolarmente importante quando pensiamo al futuro dei sistemi di intelligenza artificiale autonomi. Man mano che l'IA inizia a svolgere più compiti in modo indipendente, la necessità di informazioni affidabili diventa ancora più critica. Settori come la finanza, la sanità e i servizi legali richiedono dati accurati, e gli errori in queste aree possono avere conseguenze gravi. Uno strato di verifica come Mira potrebbe aiutare a rendere l'IA più sicura e più affidabile in questi ambienti.

Mentre il concetto è ancora in fase di sviluppo, l'approccio evidenzia un cambiamento importante nel modo in cui le persone pensano all'intelligenza artificiale. Invece di limitarsi a rendere i modelli di IA più intelligenti, progetti come Mira si concentrano sul rendere le uscite dell'IA più affidabili. Combinando la verifica decentralizzata con la tecnologia moderna dell'IA, Mira Network mira a costruire un sistema in cui le informazioni generate dalle macchine possano essere controllate, convalidate e considerate affidabili.

Con l'evoluzione continua dell'intelligenza artificiale, soluzioni che migliorano la trasparenza e l'affidabilità giocheranno probabilmente un ruolo importante. Mira Network rappresenta un tentativo di affrontare queste sfide e creare un quadro in cui i sistemi di IA possano operare con maggiore fiducia e responsabilità.#mira $MIRA @Mira - Trust Layer of AI #Mira