La conversazione che ha fatto scattare Mira per me

All'inizio di questa settimana stavo scorrendo i post delle campagne di CreatorPad su Binance Square mentre chattavo con un altro trader nei commenti. Stavamo confrontando diversi progetti di AI nella crittografia, principalmente scherzando su come ogni secondo protocollo affermi di essere “infrastruttura AI.”

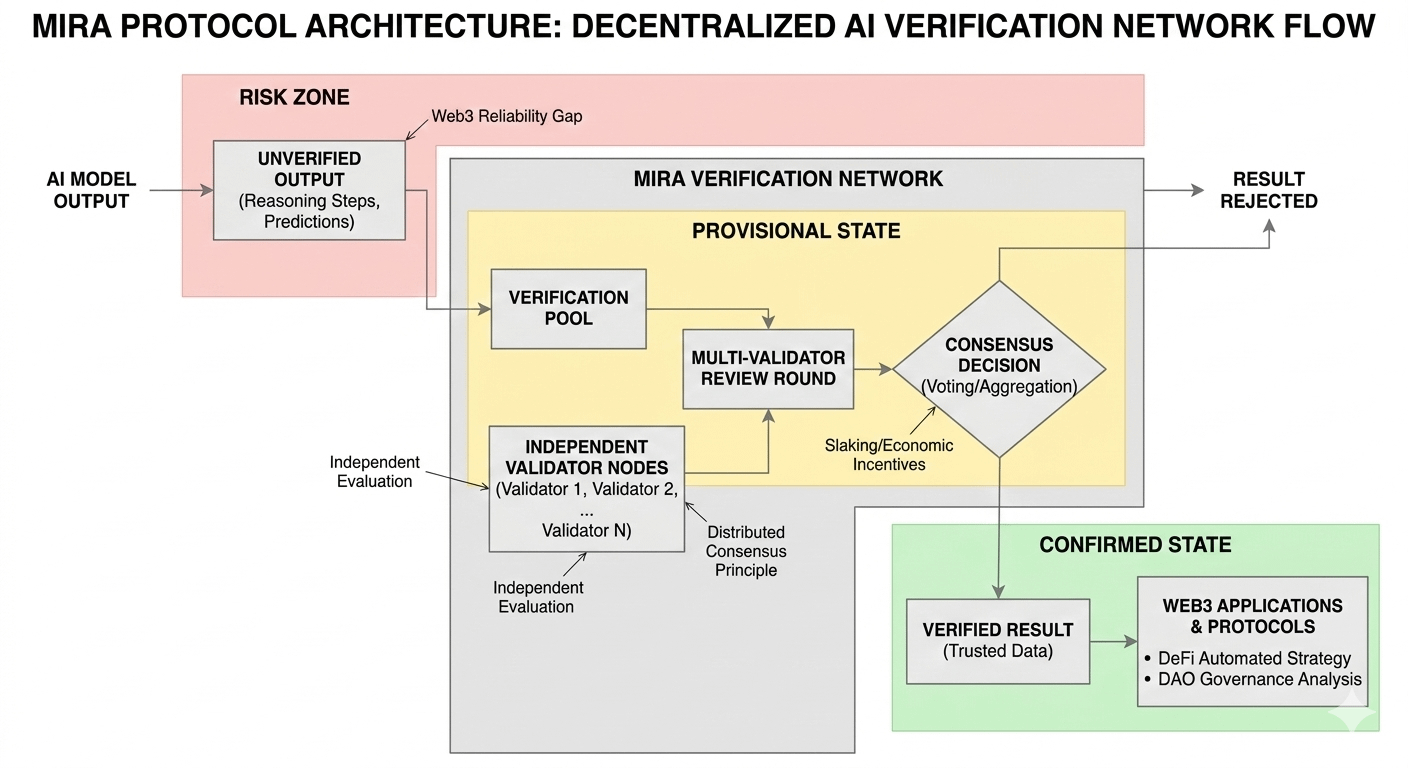

A un certo punto qualcuno ha lasciato cadere un diagramma che spiega la rete di verifica di Mira.

A prima vista sembrava semplice. Ma dopo averlo fissato per qualche minuto mi sono reso conto di qualcosa di interessante: Mira non sta realmente cercando di costruire un modello di AI più intelligente. Sta cercando di costruire una rete che verifica i risultati dell'AI.

Quella distinzione è sottile, ma cambia completamente il modo in cui il progetto si inserisce nell'ecosistema Web3.

Il problema che appare quando l'IA incontra il Web3

Chiunque abbia utilizzato strumenti IA regolarmente conosce la strana esperienza di ricevere una risposta che sembra estremamente sicura... ma non è del tutto corretta.

Nelle piattaforme centralizzate, le aziende gestiscono questo internamente. Monitorano gli output e migliorano i modelli dietro le quinte.

I sistemi decentralizzati non possono fare affidamento su un'unica autorità per farlo.

Se gli agenti IA iniziano a interagire con i protocolli Web3 — analizzando mercati, riassumendo proposte di governance o eseguendo strategie automatizzate — output errati potrebbero influenzare decisioni finanziarie o di governance reali.

Quindi la domanda diventa ovvia:

Quindi la domanda diventa ovvia:

Chi verifica le informazioni generate dalla macchina prima che la rete si fidi di esse?

Questo è il divario infrastrutturale che Mira sembra affrontare.

Trasformare la verifica in una rete

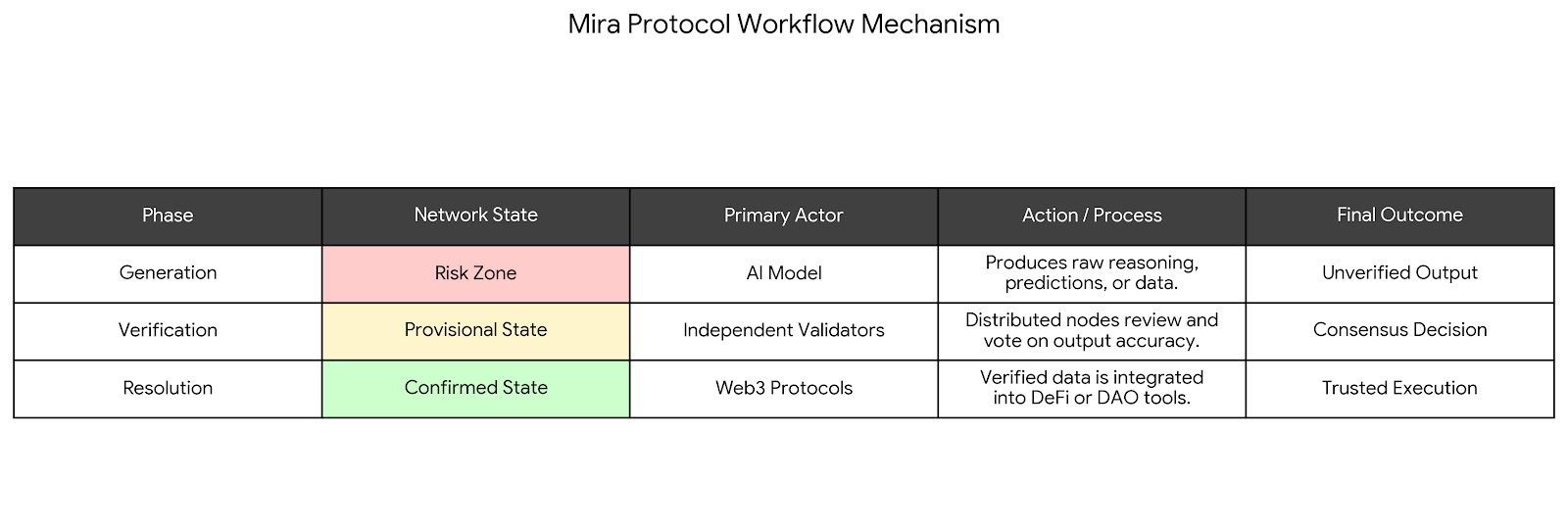

Dalla lettura di frammenti di documentazione e discussioni su CreatorPad, l'architettura di Mira ruota attorno alla suddivisione del flusso di lavoro IA in due ruoli separati.

Il primo ruolo è la generazione. I modelli IA producono output come passi di ragionamento, previsioni o risposte strutturate.

Il secondo ruolo è la verifica. Partecipanti indipendenti valutano quegli output prima che siano accettati come risultati validi.

Invece di fidarsi direttamente del modello, il sistema indirizza gli output attraverso un processo di verifica distribuita.

Mentre cercavo di visualizzare il design, ho disegnato un flusso di processo approssimativo nelle mie note:

Output IA → Pool di verifica → Revisione multi-validator → Decisione di consenso → Risultato verificato

La struttura assomiglia effettivamente alla validazione delle transazioni blockchain, tranne per il fatto che la rete sta convalidando informazioni piuttosto che trasferimenti finanziari.

Questa scelta di design fa sentire Mira meno come un'applicazione IA e più come uno strato di infrastruttura di affidabilità.

Perché decentralizzare la verifica è importante

Un dettaglio che mi ha colpito mentre leggevo i thread della comunità è l'enfasi su più validatori indipendenti.

Se un singolo partecipante verifica un output dell'IA, quella valutazione potrebbe essere soggettiva o errata. Ma quando diversi partecipanti esaminano lo stesso output, la probabilità di accettazione errata diminuisce.

Questo è essenzialmente applicare lo stesso principio che protegge le blockchain: consenso distribuito.

La differenza è che invece di verificare i blocchi di transazione, la rete verifica il ragionamento prodotto dalle macchine.

Se l'output del modello supera i turni di verifica, diventa dati fidati su cui le applicazioni possono fare affidamento.

Se fallisce, l'output viene rifiutato.

Un esempio pratico: agenti IA in DeFi

Mentre leggevo i post di CreatorPad su Mira, continuavo a pensare agli agenti di trading automatizzati.

Immagina un modello IA che analizza pool di liquidità e suggerisce aggiustamenti di portafoglio. Senza verifica, quell'output potrebbe attivare operazioni direttamente.

Se il ragionamento è errato, la strategia potrebbe portare a decisioni sbagliate.

Con la struttura di Mira, l'output IA potrebbe prima entrare in un turno di verifica dove partecipanti indipendenti esaminano il ragionamento prima che influisca sull'applicazione.

È un piccolo passo in più, ma introduce responsabilità nei sistemi decisionali automatizzati.

E man mano che più strumenti DeFi sperimentano con agenti IA, quello strato di affidabilità potrebbe diventare sempre più importante.

L'economia dietro la rete

Un altro aspetto interessante del design di Mira è il modello di incentivo.

I verificatori non stanno semplicemente esaminando gli output per curiosità. Sono economicamente incentivati a valutare i risultati con precisione.

Questo trasforma la verifica in un'attività produttiva all'interno dell'ecosistema.

Gli sviluppatori di IA generano output.

I verificatori convalidano quegli output.

Le applicazioni consumano i risultati verificati.

Questa relazione triangolare crea quella che alcuni partecipanti di CreatorPad hanno iniziato a chiamare un'economia di verifica, dove la fiducia stessa diventa un servizio decentralizzato.

Le sfide che il sistema deve ancora affrontare

Le sfide che il sistema deve ancora affrontare

Anche se il concetto è accattivante, ci sono diverse domande che la rete dovrà risolvere.

Il primo è la complessità della valutazione. Alcuni output IA sono facili da verificare, specialmente le affermazioni fattuali. Altri coinvolgono ragionamento o interpretazione, il che rende la convalida più difficile.

Il secondo è la velocità. I turni di verifica introducono latenza, mentre molte applicazioni IA si aspettano risposte rapide.

Il terzo è il coordinamento. Il sistema deve garantire che i verificatori effettuino valutazioni indipendenti invece di copiare semplicemente i segnali di consenso.

Queste sfide non minano il concetto, ma evidenziano la difficoltà di costruire strati di fiducia decentralizzati per l'IA.

Perché l'idea continua a riemergere nelle discussioni di CreatorPad

Dopo aver passato del tempo a leggere le discussioni delle campagne di CreatorPad, ho notato che le discussioni su Mira tendono a concentrarsi meno sulla speculazione sui token e più sull'architettura.

Di solito è un segnale che un progetto sta affrontando un problema infrastrutturale più profondo.

Le blockchain hanno creato un consenso decentralizzato per le transazioni finanziarie. Ma i sistemi di intelligenza artificiale producono qualcosa di diverso: informazioni e ragionamenti.

Se le applicazioni decentralizzate iniziano a fare affidamento su analisi generate da macchine, le reti avranno bisogno di meccanismi per confermare che quegli output siano affidabili.

L'esperimento di Mira riguarda essenzialmente se la verifica dell'IA stessa possa diventare una rete decentralizzata.

È ancora presto, e molte sfide di design rimangono. Ma la domanda che il protocollo sta esplorando sembra sorprendentemente fondamentale per il futuro incrocio tra IA e Web3.

Se le macchine stanno generando le risposte, qualcuno — o piuttosto, qualche rete — dovrà verificarle.

$HANA $DEGO #Mira

@Mira - Trust Layer of AI $MIRA