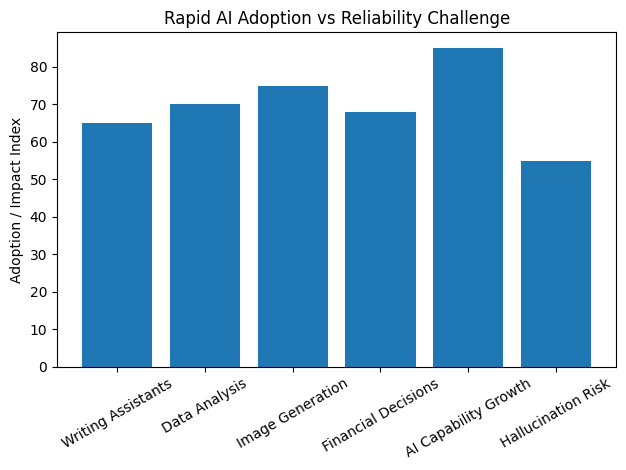

Spesso mi ritrovo a pensare a quanto velocemente la tecnologia stia cambiando il mondo intorno a noi. L'intelligenza artificiale, che una volta sembrava qualcosa di lontano e sperimentale, è rapidamente diventata parte delle nostre routine quotidiane. La vediamo negli assistenti alla scrittura, negli strumenti di analisi dei dati, nelle piattaforme di generazione di immagini e persino nei sistemi di decisione finanziaria. Ciò che una volta richiedeva team di esperti può ora essere fatto da un modello di IA in pochi secondi.

Questo rapido progresso è entusiasmante, ma solleva anche una domanda importante. Man mano che ci affidiamo di più all'IA, come possiamo sapere se le informazioni che fornisce sono realmente corrette?

Molti sistemi di IA oggi operano analizzando grandi dataset e prevedendo la risposta più probabile a una domanda. Questi sistemi sono incredibilmente potenti, ma non sono perfetti. A volte generano risposte che suonano sicure e logiche ma contengono errori o informazioni completamente fabbricate. Questo problema, spesso definito come allucinazione dell'IA, evidenzia una delle maggiori debolezze dell'intelligenza artificiale moderna.

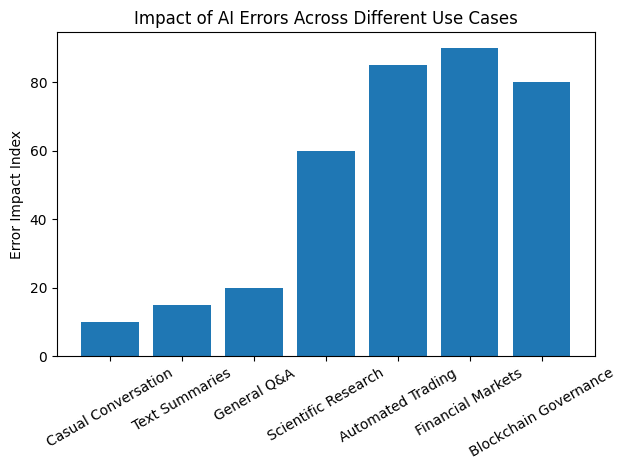

Per compiti semplici o conversazioni informali, questi errori potrebbero non causare grandi problemi. Se un'IA commette un piccolo errore mentre riassume un testo o risponde a una domanda generale, le conseguenze sono solitamente minime. Tuttavia, la situazione diventa molto più seria quando l'IA inizia a influenzare decisioni importanti.

Immagina l'IA utilizzata nei mercati finanziari per analizzare le tendenze e guidare gli investimenti. Considera i sistemi di trading automatizzati che si basano sulle previsioni dell'IA per eseguire le transazioni. Pensa alla ricerca scientifica in cui i modelli di IA aiutano a interpretare i dati, o ai sistemi di governance blockchain in cui agenti automatizzati aiutano a gestire le economie digitali. In queste situazioni, anche un piccolo errore può avere conseguenze importanti.

Un'assunzione errata in un algoritmo di trading potrebbe provocare grandi perdite finanziarie. Una cattiva interpretazione nei dati di ricerca potrebbe rallentare il progresso scientifico. Nei network decentralizzati, informazioni inaffidabili potrebbero danneggiare la fiducia e interrompere interi ecosistemi. Man mano che l'intelligenza artificiale si sposta in questi ambienti ad alto impatto, l'affidabilità diventa più importante che mai.

È qui che Mira Network introduce un'idea convincente.

Invece di concentrarsi solo sulla costruzione di modelli di IA più grandi e potenti, Mira Network si concentra sull'assicurarsi che le uscite dell'IA possano essere verificate. Il progetto affronta l'intelligenza artificiale da una prospettiva diversa. Invece di chiedersi quanto velocemente o complessa possa diventare l'IA, Mira chiede quanto possa essere affidabile la sua informazione.

Il concetto alla base di Mira Network è incentrato sulla verifica. Quando un sistema di IA genera informazioni, Mira non accetta semplicemente l'output come un singolo pezzo di verità. Invece, il sistema suddivide quelle informazioni in affermazioni più piccole. Ogni affermazione può quindi essere controllata e validata indipendentemente.

Queste affermazioni sono distribuite attraverso una rete di validatori indipendenti. Ogni partecipante esamina le informazioni e valuta la loro accuratezza. Poiché più validatori partecipano al processo, il risultato finale è determinato attraverso un consenso decentralizzato piuttosto che fare affidamento su una singola autorità.

Questo approccio riduce il rischio di pregiudizi o errori provenienti da un modello o un'organizzazione. Crea anche un sistema in cui le informazioni vengono continuamente esaminate e verificate dalla rete stessa.

La tecnologia blockchain gioca un ruolo importante nel supportare questo processo. I risultati di verifica possono essere registrati in log trasparenti e auditabili, consentendo a sviluppatori e utenti di tracciare come le informazioni sono state validate. Questa trasparenza aiuta a costruire fiducia in sistemi che dipendono da dati affidabili.

Un altro elemento chiave è il meccanismo di incentivazione. I partecipanti che contribuiscono a una verifica accurata vengono premiati, mentre azioni disoneste o negligenti possono portare a sanzioni. Questo sistema incoraggia la partecipazione onesta e rafforza l'integrità della rete.

Man mano che l'intelligenza artificiale continua a espandersi in finanza, ricerca e tecnologia decentralizzata, l'importanza di informazioni affidabili aumenterà solo. I sistemi che si basano sull'IA avranno bisogno di meccanismi che confermino se i dati che utilizzano sono accurati e fidati.

Mira Network rappresenta un passo verso quel futuro. Concentrandosi sulla verifica e sulla validazione decentralizzata, il progetto mira a creare un ambiente in cui le informazioni generate dall'IA non siano solo potenti, ma anche affidabili.

A lungo termine, il successo dell'intelligenza artificiale non dipenderà solo da quanto intelligenti diventano questi sistemi. Dipenderà da quanto possiamo fidarci di loro. L'intelligenza verificata potrebbe diventare la base che consente all'IA di alimentare in sicurezza la prossima generazione di sistemi digitali.