Quando le persone sentono la frase “AI verificabile”, l'assunzione iniziale è solitamente che si tratti di un altro aggiornamento tecnico progettato principalmente per ingegneri e team infrastrutturali, ma la mia reazione iniziale è diversa perché il vero significato della verifica non vive all'interno dell'architettura del modello, ma all'interno degli ambienti in cui le decisioni dell'IA comportano effettivamente conseguenze, in particolare in settori come la finanza e la sanità, dove un singolo output errato può tradursi in perdite finanziarie, violazioni normative o rischi medici, motivo per cui il lavoro svolto da Mira Network sembra meno un miglioramento delle funzionalità e più un tentativo di correggere una debolezza strutturale in come l'intelligenza artificiale interagisce attualmente con sistemi critici del mondo reale.

La scomoda realtà che molte istituzioni riconoscono silenziosamente è che i moderni modelli AI sono generatori di risposte estremamente persuasivi, ma non fonti di verità intrinsecamente affidabili, perché producono risposte sicure anche quando il ragionamento sottostante è difettoso o quando i dati di addestramento non supportano l'affermazione generata, il che significa che le industrie costruite attorno alla conformità, alla revisione e alla sicurezza dei pazienti non possono trattare le uscite dei modelli come decisioni finali senza costruire ulteriori strati di verifica attorno ad esse, e l'assenza di quegli strati è precisamente ciò che tiene molte istituzioni finanziarie e fornitori di assistenza sanitaria cauti riguardo al dispiegamento di sistemi AI autonomi al di là di ruoli sperimentali ristretti.

Tradizionalmente, il peso della gestione di questa incertezza ricade sulla supervisione umana, dove gli analisti ricontrollano le uscite AI, i revisori esaminano i report automatizzati e i clinici verificano le intuizioni generate dalla macchina prima che influenzino le decisioni di trattamento, ma quel modello si espande male perché più potente diventa l'AI, più dati produce, e più dati produce, più difficile diventa per gli esseri umani convalidare manualmente ogni pezzo di informazione, il che significa che la promessa dell'automazione inizia a scontrarsi con la realtà operativa che la fiducia non può essere automatizzata a meno che la verifica stessa non diventi programmabile.

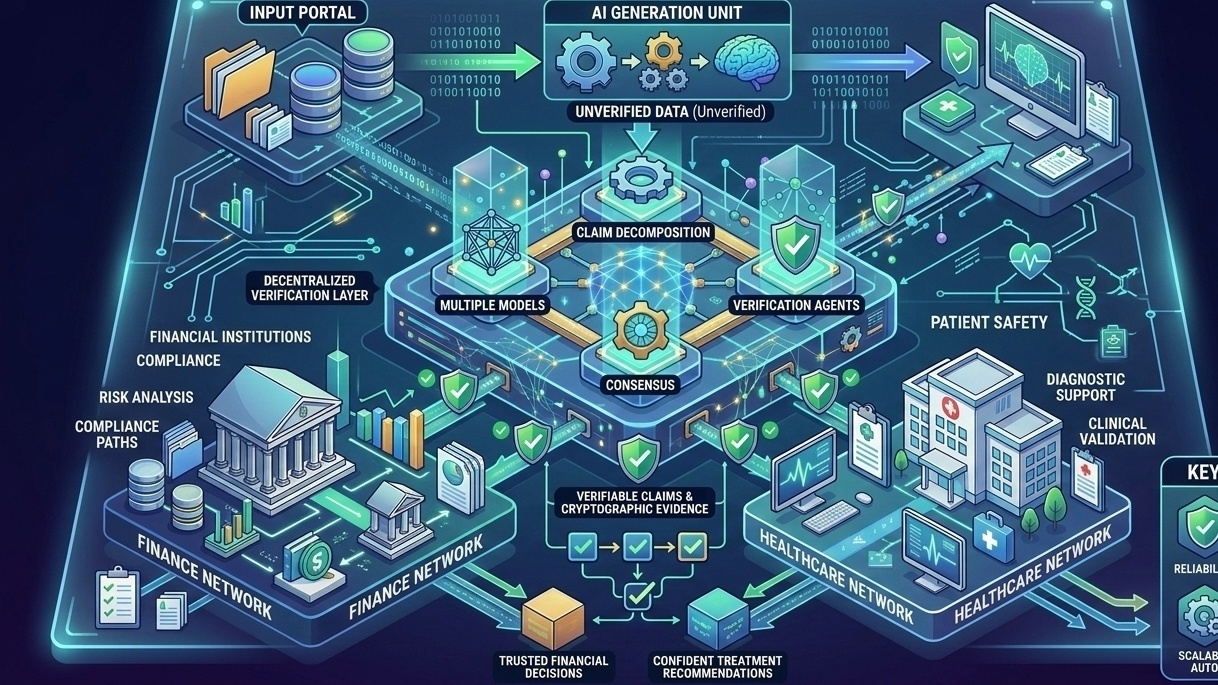

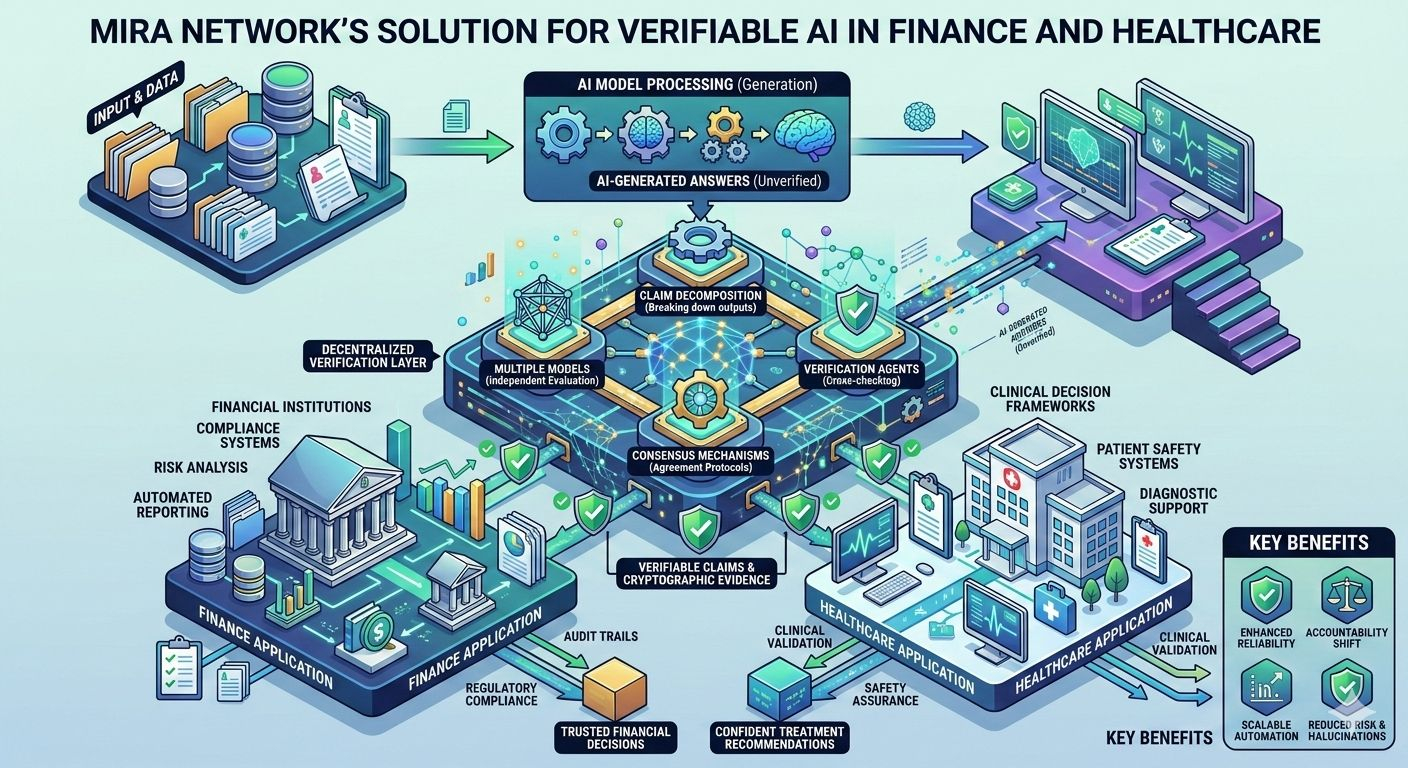

Questo è il contesto in cui l'architettura dietro Mira diventa interessante, perché invece di chiedere alle organizzazioni di fidarsi semplicemente dell'uscita di un singolo modello, la rete riformula le risposte AI come una raccolta di affermazioni verificabili che possono essere valutate indipendentemente da più modelli operanti attraverso uno strato di verifica decentralizzato, il che trasforma efficacemente i risultati dell'AI da risposte opache in dichiarazioni strutturate che possono essere controllate, contestate e validate attraverso meccanismi di consenso che somigliano alle garanzie di affidabilità comunemente associate ai sistemi di registri distribuiti.

Una volta che quel cambiamento avviene, la conversazione smette di riguardare se un modello individuale ha allucinato e inizia a diventare una questione di quanto fortemente una rete di agenti di verifica concordi sull'accuratezza di ciascuna affermazione incorporata in una risposta generata da AI, il che introduce una struttura di fiducia probabilistica con cui le istituzioni possono effettivamente lavorare perché i sistemi di conformità finanziaria e i framework decisionali sanitari si basano già su modelli di validazione stratificati in cui più fonti devono concordare prima che vengano intraprese azioni critiche.

In finanza, questo approccio affronta direttamente una serie di problemi che le istituzioni incontrano quando dispiegano l'AI per compiti come la rilevazione di frodi, la reportistica automatizzata, l'analisi del rischio o il monitoraggio della conformità regolamentare, perché mentre i sistemi AI possono elaborare enormi dataset più velocemente degli analisti umani, introducono anche la possibilità che ipotesi errate o correlazioni fabricate possano infiltrarsi nelle decisioni automatizzate, e uno strato di verifica decentralizzato fornisce un meccanismo per il controllo incrociato di quelle uscite in un modo che somiglia a come le revisioni finanziarie convalidano i registri attraverso una revisione indipendente piuttosto che fare affidamento su un'unica autorità.

Gli ambienti sanitari rivelano una versione ancora più sensibile della stessa sfida, perché gli strumenti di supporto diagnostico, i sistemi di documentazione clinica e gli assistenti alla ricerca medica si affidano sempre più all'AI per riassumere le storie dei pazienti, interpretare la letteratura medica e proporre intuizioni terapeutiche, eppure le conseguenze di un'allucinazione non verificata sono molto più serie quando una raccomandazione influisce sul giudizio clinico, il che significa che i fornitori di assistenza sanitaria hanno bisogno di sistemi che possano trasformare i suggerimenti dell'AI in dichiarazioni verificabili la cui accuratezza può essere confermata prima che vengano integrate nei flussi di lavoro dell'assistenza ai pazienti.

Ciò che l'architettura di Mira introduce silenziosamente in questa equazione è l'idea che l'affidabilità possa diventare una proprietà emergente di una rete di verifica piuttosto che una promessa allegata a un singolo modello, perché decomponendo output complessi in affermazioni fattuali più piccole e distribuendo quelle affermazioni tra più valutatori, il sistema sostituisce la fiducia cieca con un accordo misurabile, e quell'accordo diventa una forma di prova crittografica che le organizzazioni possono allegare alle uscite dell'AI quando vengono utilizzate all'interno di ambienti operativi sensibili.

Tuttavia, l'implicazione più profonda di questo design non è semplicemente un'accuratezza migliorata, ma una ridefinizione di come funziona la responsabilità quando l'AI partecipa a decisioni ad alto rischio, perché quando le uscite vengono validate attraverso una verifica decentralizzata, la responsabilità per la correttezza non ricade più interamente sullo sviluppatore del modello o sull'istituzione che dispiega il modello, ma diventa invece legata all'integrità e alle prestazioni della rete di verifica che valuta le affermazioni prodotte.

Questo cambiamento inizia a somigliare all'evoluzione che i sistemi finanziari stessi hanno vissuto quando la registrazione centralizzata ha gradualmente ceduto il passo a framework di verifica distribuiti, perché la questione critica smette di essere se un sistema può generare risposte rapidamente e inizia a diventare se l'infrastruttura circostante può garantire che quelle risposte soddisfino le soglie di affidabilità richieste da regolatori, revisori, clinici e gestori del rischio finanziario.

Da una prospettiva sistemica, la conseguenza più importante è che la verifica diventa uno strato infrastrutturale piuttosto che un processo manuale, il che significa che le organizzazioni che integrano l'AI nei flussi di lavoro finanziari o sanitari non sono più costrette a scegliere tra automazione e affidabilità perché la rete stessa può far rispettare gli standard di validazione che altrimenti richiederebbero una supervisione umana costante.

Detto ciò, la vera prova di un tale sistema non apparirà durante le operazioni normali, dove le uscite del modello sono per lo più accurate e la verifica è di routine, ma durante i periodi in cui i modelli AI incontrano dati ambigui, input avversariali o ambienti informativi in rapida evoluzione in cui le allucinazioni e il bias diventano più probabili, perché questi sono i momenti in cui la resilienza del livello di verifica determina se le istituzioni continuano a fidarsi dei sistemi automatizzati o tornano a processi solo umani più lenti.

L'importanza strategica a lungo termine dell'approccio di Mira, quindi, non si basa esclusivamente sul fatto che i suoi meccanismi di verifica funzionino in condizioni ideali, ma su se la rete possa mantenere un'affidabilità coerente quando i modelli sottostanti non concordano, quando nuovi modelli si uniscono all'ecosistema e quando le affermazioni in fase di valutazione coinvolgono interpretazioni finanziarie complesse o conoscenze mediche che evolvono nel tempo.

Se quell'infrastruttura si dimostra capace di mantenere la fiducia in quelle condizioni, allora le implicazioni si estendono ben oltre le singole applicazioni AI, perché finanza e sanità guadagnerebbero un framework in cui l'intelligenza delle macchine può partecipare al processo decisionale senza richiedere fede cieca in nessun algoritmo singolo, e la vera domanda diventa non se l'AI può generare risposte, ma se i sistemi circostanti possono continuamente dimostrare che quelle risposte meritano di essere fidate.

$MIRA #Mira @Mira - Trust Layer of AI

#OilTops$100 #SolvProtocolHacked #StockMarketCrash $COLLECT $PENGU