*Il Momento in Cui una Risposta dell'AI Mi Ha Fatto Esitare"

Oggi ho esaminato un cruscotto DeFi mentre seguivo alcune discussioni sulle campagne di CreatorPad su Binance Square. Avevo chiesto a un assistente AI di riassumere l'attività di liquidità attraverso alcuni pool che stavo osservando. La risposta sembrava ottima a prima vista. Analisi strutturata, ragionamento chiaro, persino una piccola previsione su dove potrebbe muoversi la liquidità successivamente. Poi ho controllato i dati grezzi. Una delle assunzioni fatte dall'AI era leggermente errata. Non in modo drammatico, ma abbastanza da non sostenere realmente la sua conclusione sulla direzione del mercato. Quel momento mi ha ricordato qualcosa di scomodo sui sistemi AI: sono estremamente bravi a produrre risposte che sembrano affidabili, anche quando la logica dietro di esse non è perfetta. E questo è esattamente il tipo di problema che Mira sembra cercare di affrontare. Il Problema Reale di Fiducia Dietro le Uscite dell'AI. Nel crypto passiamo molto tempo a parlare di decentralizzazione e minimizzazione della fiducia. Le blockchain hanno risolto il problema delle transazioni sostituendo la fiducia con il consenso distribuito. Ma i sistemi AI operano ancora principalmente in un ambiente ad alta fiducia. Quando un modello genera un'informazione — un'analisi, una raccomandazione o un riassunto — gli utenti di solito si fidano di quell'output senza alcun processo di verifica. Nei sistemi centralizzati, l'azienda che gestisce il modello agisce come l'autorità dietro quella fiducia. Una volta che l'AI inizia a interagire con sistemi decentralizzati, le cose diventano più complicate. Immagina agenti AI che analizzano i mercati DeFi, riassumono proposte di governance o generano segnali per strategie di trading automatizzato. Se quegli output sono errati, le conseguenze potrebbero propagarsi attraverso le applicazioni decentralizzate. È qui che l'architettura di Mira diventa interessante. Invece di assumere che le uscite dell'AI siano affidabili, introduce uno strato di verifica tra generazione e fiducia.

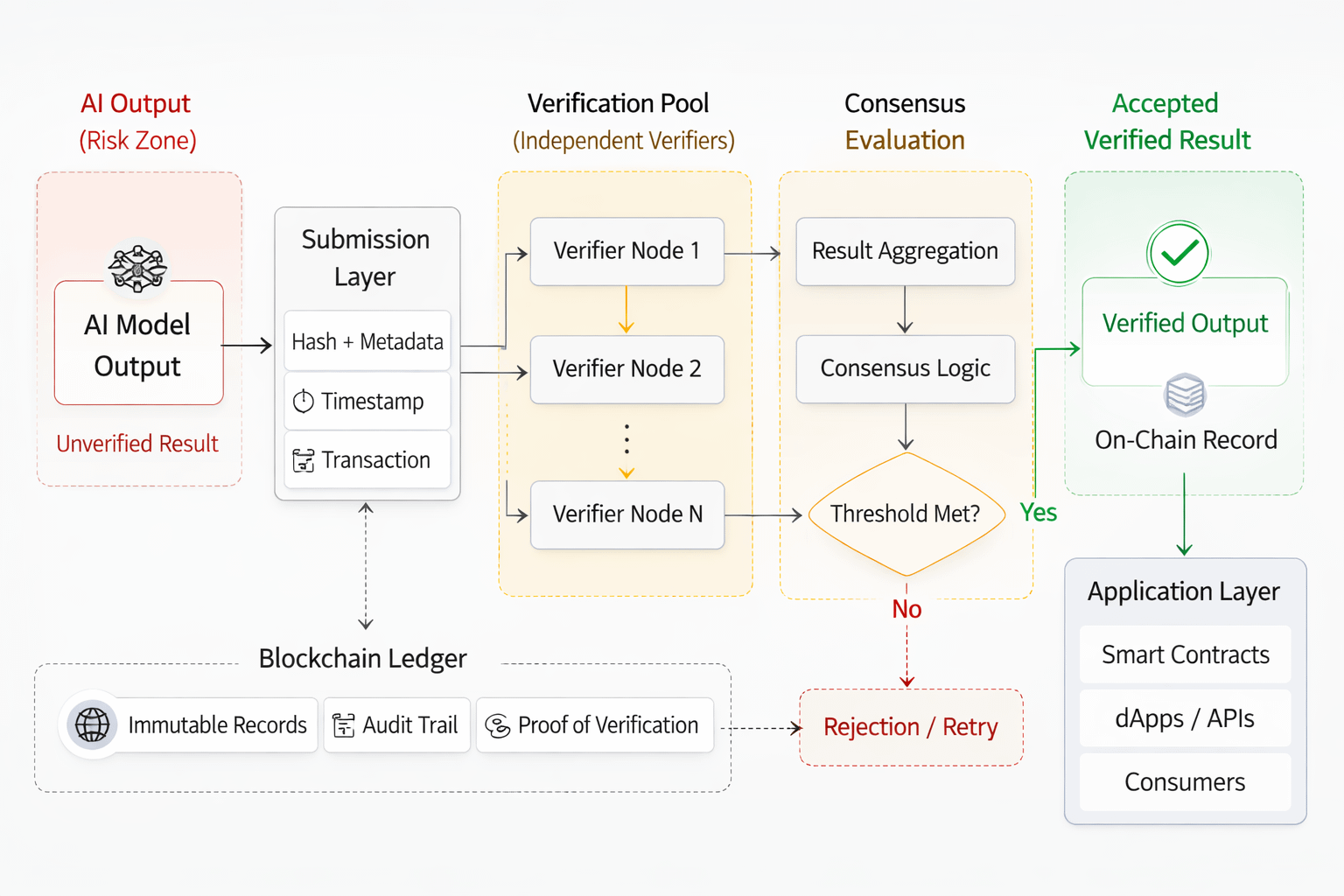

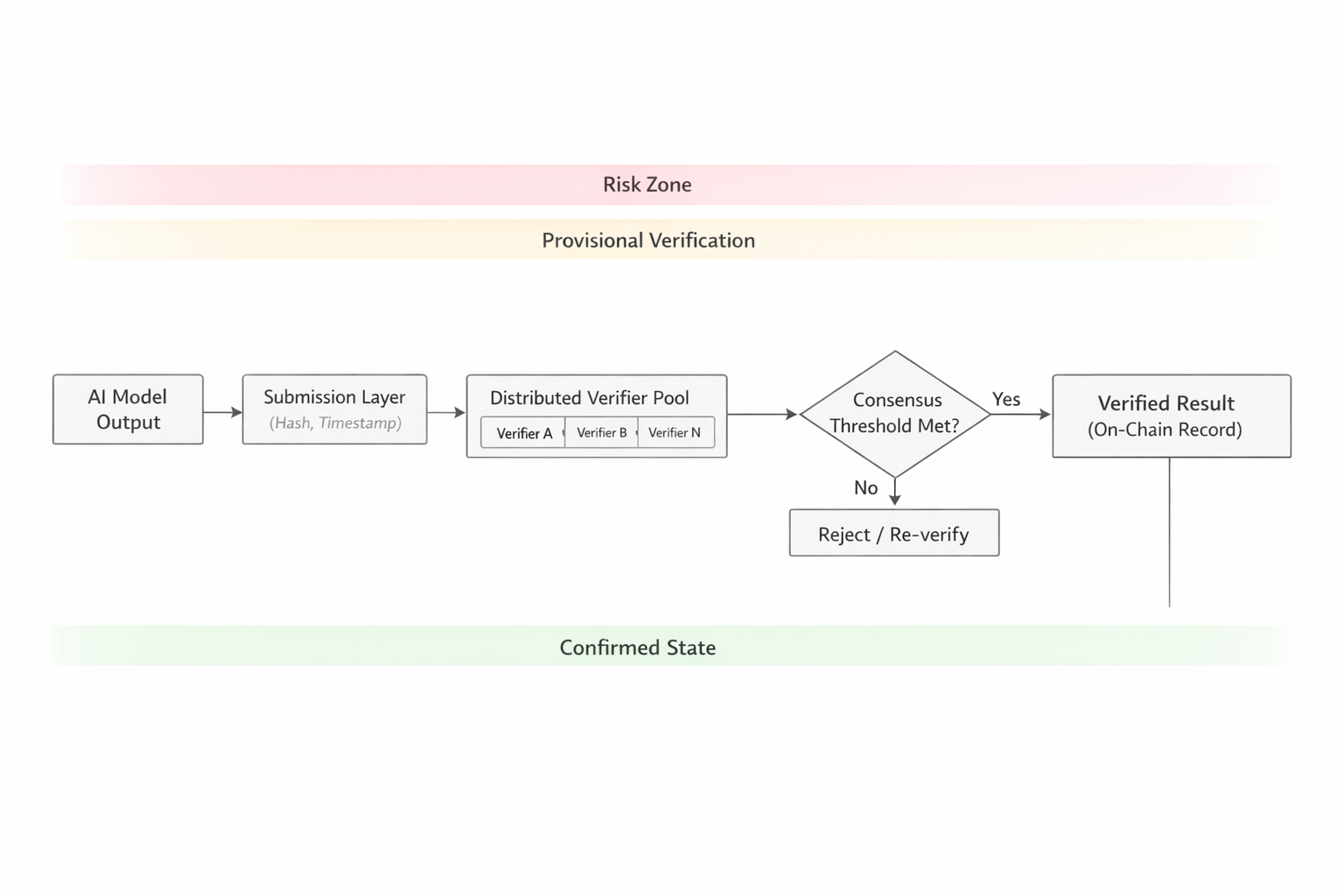

Il meccanismo principale di Mira: separare l'output dall'accettazione. Leggendo i post di CreatorPad e scavando tra i riferimenti documentali condivisi nei thread di Binance Square, il sistema di Mira funziona dividendo il processo in due fasi. La prima fase è semplice: i modelli IA producono output. Ma quegli output non vengono accettati immediatamente dalla rete. Invece, entrano in una fase di verifica in cui partecipanti indipendenti valutano il risultato prima che diventi informazione fidata. Il flusso appare in questo modo:

Output AI → Fase di Verifica → Accordo del Validatore → Risultato Accettato

Mentre studiavo il design, ho effettivamente disegnato un piccolo diagramma di flusso per capirlo. La struttura mi ha ricordato i pipeline di validazione della blockchain, eccetto che la rete sta verificando le informazioni anziché le transazioni. Quel piccolo cambiamento di design potrebbe rivelarsi piuttosto significativo. Trasformare la verifica in una rete decentralizzata. Uno dei dettagli che spicca nel modello di Mira è la dipendenza da più verificatori indipendenti. Invece di fidarsi di un'unica entità per valutare gli output dell'IA, la rete distribuisce quella responsabilità tra i partecipanti. Ciascun verificatore esamina l'output e invia una valutazione. Se abbastanza partecipanti concordano che l'informazione è valida, la rete la accetta. Se no, l'output viene rifiutato o contrassegnato. In sostanza, Mira applica lo stesso principio che protegge le blockchain - consenso distribuito - alla valutazione delle informazioni generate dalle macchine. E quel approccio potrebbe ridurre drammaticamente la fiducia cieca negli output dell'IA. Dove potrebbe contare in applicazioni reali. Mentre leggevo le discussioni delle campagne di CreatorPad, continuavo a pensare agli agenti IA che operano all'interno dei sistemi DeFi. Alcuni protocolli stanno già sperimentando strumenti di analisi potenziati dall'IA che raccomandano allocazioni di portafoglio o strategie di liquidità. Se quegli strumenti producono ragionamenti errati, gli utenti potrebbero prendere decisioni finanziarie basate su informazioni errate. Con il livello di verifica di Mira, quegli output potrebbero essere valutati da più partecipanti prima di influenzare le applicazioni. Invece di fidarsi direttamente del modello, la rete conferma se il ragionamento regge. Quel passaggio extra potrebbe sembrare piccolo, ma nei sistemi finanziari potrebbe ridurre significativamente il rischio. L'aspetto economico della fiducia. Un altro aspetto del design di Mira che ha attirato la mia attenzione è il modello di incentivi. I partecipanti che verificano gli output dell'IA non stanno solo svolgendo un compito tecnico. Vengono economicamente ricompensati per valutazioni accurate. Questo crea un sistema in cui la fiducia stessa diventa un servizio di rete. Gli sviluppatori di IA generano informazioni. I verificatori valutano quelle informazioni. Le applicazioni consumano i risultati verificati. Alcuni contributori di CreatorPad hanno iniziato a riferirsi a questa struttura come un'economia di verifica, in cui la validazione della conoscenza generata dalle macchine diventa un'attività produttiva. Se il contenuto generato dall'IA continua ad espandersi attraverso gli ecosistemi Web3, quel tipo di livello economico potrebbe diventare sorprendentemente prezioso.

Le sfide che il sistema dovrà affrontare. Certo, l'architettura solleva alcune domande importanti. La verifica non è sempre semplice. Alcuni output dell'IA comportano affermazioni fattuali che possono essere verificate facilmente, ma altri comportano ragionamento o interpretazione. Il protocollo avrà bisogno di quadri di valutazione affidabili per guidare i verificatori. La velocità è un'altra preoccupazione. Le applicazioni IA spesso operano rapidamente, mentre i livelli di verifica introducono passaggi aggiuntivi prima che gli output siano accettati. C'è anche il rischio di problemi di coordinamento se i verificatori semplicemente copiano le risposte degli altri invece di eseguire valutazioni indipendenti. Queste sono sfide di design difficili, ma sono anche simili ai problemi di coordinamento che le prime reti blockchain hanno affrontato nella costruzione di sistemi di consenso. Perché Mira continua a comparire nelle discussioni di CreatorPad. Dopo aver trascorso del tempo a leggere i post delle campagne di CreatorPad su Binance Square, ho notato che le discussioni su Mira spesso vanno più a fondo rispetto alle conversazioni tipiche sui token. Le persone non stanno solo chiedendo delle performance dei prezzi. Stanno dibattendo su come i sistemi decentralizzati potrebbero verificare le informazioni generate dall'IA su larga scala. Questo è un tipo di conversazione molto diverso. La domanda più grande dietro il design di Mira. Le blockchain hanno trasformato i sistemi finanziari rimuovendo la necessità di fidarsi di intermediari centralizzati. I sistemi IA, tuttavia, si basano ancora pesantemente sulla fiducia. Gli utenti si fidano del fornitore del modello, dei dati di addestramento e dell'infrastruttura che produce gli output. L'architettura di Mira suggerisce un'altra possibilità. Invece di fidarsi dell'IA ciecamente, le reti potrebbero verificare collettivamente le informazioni generate dalle macchine prima di accettarle. Se l'IA continua a integrarsi negli ecosistemi decentralizzati - dall'analisi DeFi agli strumenti di governance - quel tipo di livello di verifica potrebbe diventare essenziale. E se ciò accade, progetti come Mira non saranno solo esperimenti IA. Potrebbero diventare parte dell'infrastruttura che definisce come funziona la fiducia nell'era della conoscenza generata dalle macchine.

$ARIA $UAI $MIRA #Mira @Mira - Trust Layer of AI

#creatorpad #LearnWithFatima

#TrendingTopic #Market_Update