Le narrazioni DePIN (Reti di Infrastruttura Fisica Decentralizzata) e di infrastruttura AI stanno evolvendo rapidamente. Stiamo superando i primi giorni in cui si affittavano solo dischi rigidi di riserva e ci stiamo spostando verso uno stack sofisticato e verticalizzato.

Guardando ad Akash ( $AKT ), Aethir ($ATH ), Flux ($FLUX ), SKALE ($SKL) e Fluence ($FLT), emerge una chiara tendenza: La Separazione di Muscolo e Cervello.

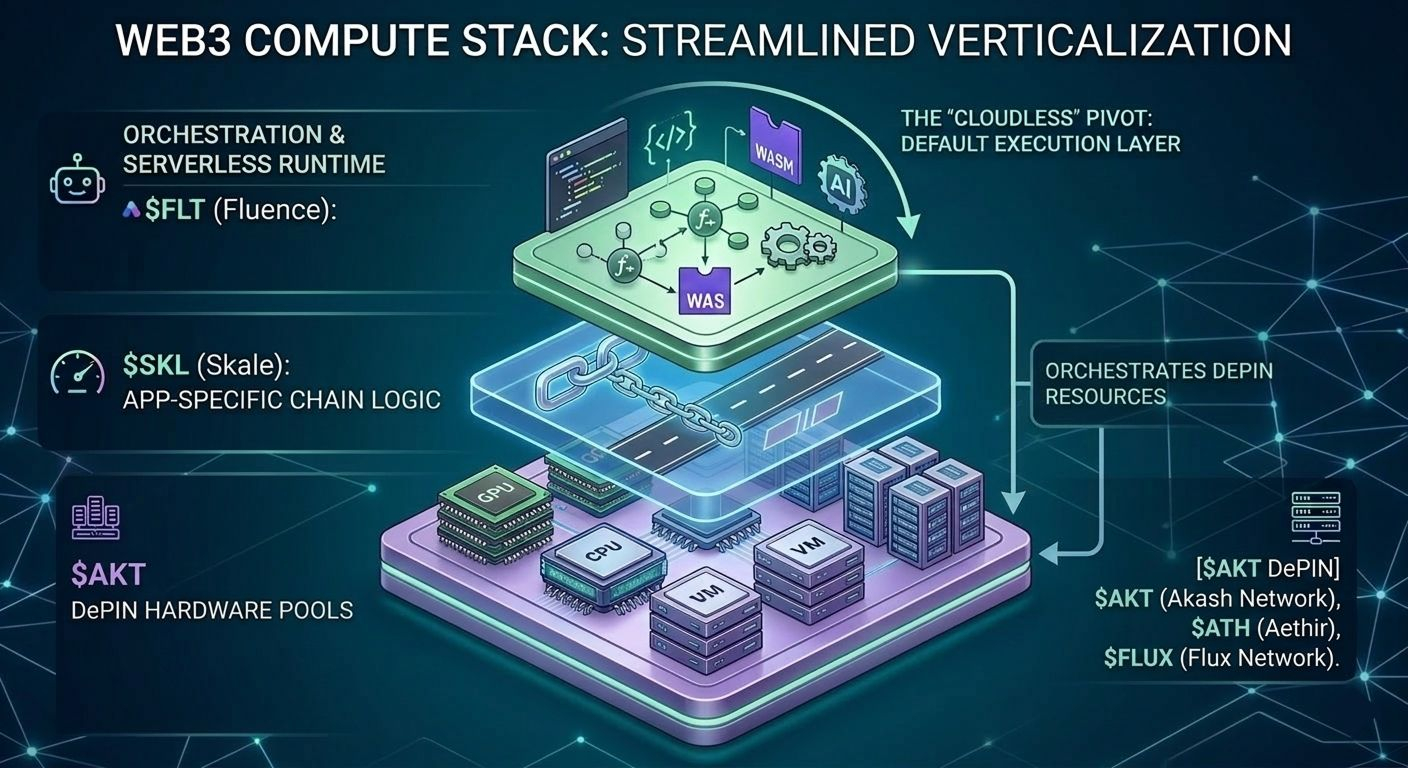

🏗️ Il Stack di Calcolo Decentralizzato

Per capire dove fluisce il valore, devi guardare ai livelli:

Il Muscolo (Livello Hardware): Akash, Flux e Aethir sono i grandi protagonisti. Monetizzano l'hardware direttamente. Se hai bisogno di un'istanza GPU grezza per l'addestramento AI o di una Macchina Virtuale (VM) per ospitare un nodo, questi sono i tuoi marketplace di riferimento. Aethir, in particolare, sta ritagliando una nicchia in GPU enterprise di alta gamma per AI e gaming.

La Fondazione (Livello Scalabilità): SKALE non è un marketplace di calcolo, ma fornisce un ambiente ad alta velocità e senza gas in cui la "logica" di queste applicazioni può vivere. È l'autostrada che collega le dApp al calcolo che consumano.

Il Cervello (Livello Orchestrazione): Qui Fluence si distingue. Si trova "sopra" l'hardware. Invece di affittarti semplicemente una macchina, Fluence fornisce un runtime serverless decentralizzato.

💡 Perché Fluence ($FLT) è la Colla

La missione di Fluence è costruire un internet senza cloud, backend senza permessi che non dipendono da un unico fornitore centralizzato come AWS. Ecco perché è un pezzo critico del quadro generale:

Orchestrazione, Non Solo Capacità: Mentre Aethir o Akash forniscono il metallo (GPU/CPU), Fluence fornisce il tessuto software che dice a quelle risorse cosa fare. Utilizza WebAssembly (WASM) per comporre e instradare compiti di calcolo tra diversi nodi senza soluzione di continuità.

La Colla della Pipeline AI: Le vere applicazioni AI non sono solo una semplice richiesta. Sono pipeline complesse: raccolta dati → pre-elaborazione → inferenza del modello → post-elaborazione. Fluence può trovarsi al centro di questo, coordinando una GPU da Aethir e dati da un'altra fonte per fornire un risultato finale.

Esperienza Sviluppatore: Per uno sviluppatore, affittare una VM (Akash/Flux) è il cloud "old school". Fluence offre un modello serverless. Non gestisci il server; semplicemente distribuisci la funzione. Questo è il futuro di come gli agenti AI decentralizzati e i microservizi saranno effettivamente costruiti.

📉 Il Riassunto: Dall'Hardware all'Esecuzione

Il mercato sta cambiando da "dove posso affittare una GPU?" a "come posso eseguire un agente AI complesso in modo autonomo?"

$AKT, $ATH e $FLUX sono scommesse sulla fornitura di hardware decentralizzato.

$SKL è una scommessa sulla coordinazione della logica on-chain.

$FLT è una scommessa sull'esecuzione e l'orchestrazione dell'intero cloud decentralizzato.

Fluence è essenzialmente il "Cervello" che rende il "Muscolo" del mondo DePIN utilizzabile per la prossima generazione di app AI. Man mano che lo spazio matura, la "Colla" che unisce queste risorse decentralizzate potrebbe diventare altrettanto preziosa quanto l'hardware stesso.