I grandi modelli linguistici possono scrivere poesie e codice, ma spesso falliscono nella matematica elementare? Questo dilemma è finalmente stato superato.

Recentemente ho visto un'operazione incredibile: un ricercatore è riuscito a "hardcodare" senza perdite un interprete WASM (WebAssembly) nei pesi del modello Transformer!

Non si tratta solo di "il modello utilizzerà strumenti", ma di far funzionare direttamente un vero computer all'interno del LLM.

💡 Logica centrale: architettura ibrida simile a quella dei chip DSP, paragonabile all'architettura DSP di TI:

Reti neurali (ARM): responsabile del ragionamento logico, comprensione semantica e organizzazione del linguaggio.

Interprete incorporato (DSP): responsabile di calcoli deterministici ad alta precisione e alta velocità.

Quando LLM incontra il problema di chi è più grande tra 3.11 e 3.8, non si basa più su un'“intuito” per indovinare il prossimo Token, ma chiama direttamente il motore di calcolo interno.

🚀Perché è così importante?

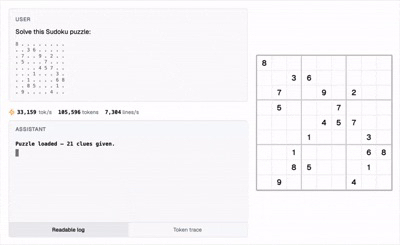

100% di accuratezza: anche il Sudoku più difficile può essere risolto in un attimo, eliminando completamente l'illusione del calcolo.

Milioni di passi di esecuzione: il programma può eseguire milioni di passi all'interno del modello, con prestazioni strabilianti.

Applicazioni in tutti i settori: simulazione fisica, modellazione finanziaria, calcoli crittografici... Questi settori che richiedono un'elevata precisione, LLM finalmente può affrontarli davvero.

Non è più solo “AI generativa”, è “AI per il calcolo nativo”. L'umanità è un passo più vicina alla vera intelligenza artificiale generale (AGI)!

#AI #LLM #WebAssembly #Transformer #DeepLearning #AGI