Continuo a tornare a Midnight Network in un modo leggermente indiretto, non perché lo comprenda completamente ancora, ma perché non lo faccio. C'è qualcosa di inquietante in un sistema che funziona senza mostrare il suo lavoro. Invierai logica, una prova viene verificata, si raggiunge un consenso e la rete avanza... ma i dati effettivi non emergono mai. Sembra completo, ma anche stranamente incompleto da una prospettiva umana.

E onestamente, capisco perché Midnight è costruito in questo modo.

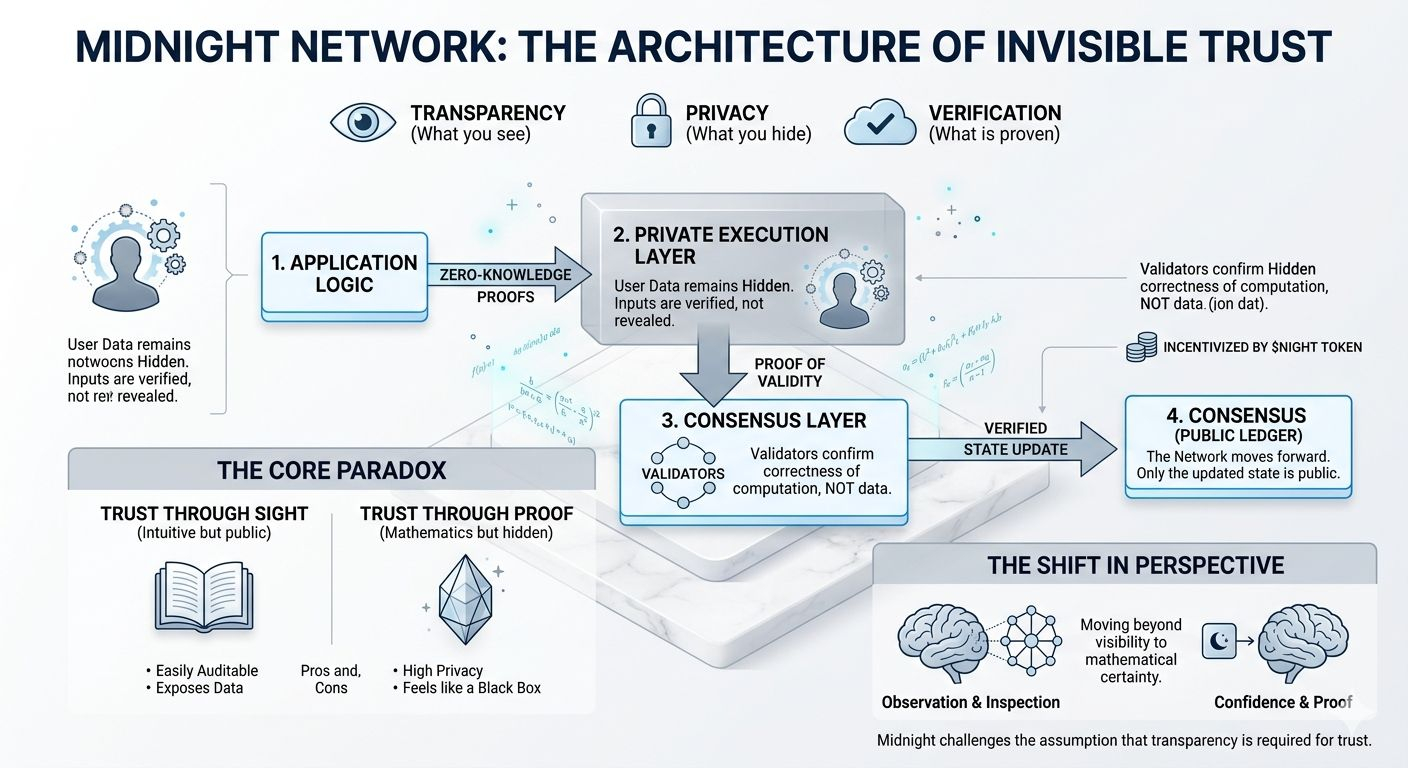

La maggior parte dei processi del mondo reale non ha bisogno di esposizione. Controlli dell'identità, regole di conformità, transazioni private—queste non sono cose che le persone vogliono vedere apertamente su un registro. Midnight si inserisce in quella lacuna, utilizzando prove a conoscenza zero in modo che i validatori confermino la correttezza senza mai vedere i dati sottostanti. La verifica sostituisce la visibilità. Idea pulita.

Ma continuo a girare attorno alla tensione.

Perché mentre l'architettura separa l'esecuzione dal consenso in un modo ordinato, quasi matematico, la fiducia umana non segue sempre strutture ordinate. Normalmente, quando qualcosa sembra strano, lo esamini. Tracci gli input, controlli gli output, metti in discussione il percorso. Qui, quel percorso è intenzionalmente nascosto. Sei costretto a fidarti della prova stessa, non della tua capacità di verificare il processo.

Quel cambiamento sembra più grande di quanto appaia.

Poi c'è il coordinamento. I validatori operano con consapevolezza parziale, facendo affidamento sugli incentivi—guidati da $NIGHT—per comportarsi correttamente. In teoria, gli incentivi allineano il comportamento. Nella pratica, i sistemi non si rompono a livello teorico. Si rompono quando i partecipanti agiscono in modo imprevisto, o quando i casi limite si accumulano più rapidamente di quanto le assunzioni possano gestire.

Penso anche agli sviluppatori. Costruire su un sistema in cui l'esecuzione è privata sembra potente, ma anche restrittivo. Come fai a debug un qualcosa che non puoi osservare completamente? Come progetti applicazioni quando parte del sistema è intenzionalmente invisibile? Quella frizione non appare nei diagrammi, ma si manifesta rapidamente nell'uso reale.

E forse è lì che si trova la vera prova.

Non se la crittografia di Midnight funziona—probabilmente sì—ma se le persone possono operare comodamente all'interno di un sistema che non possono 'vedere' intuitivamente. Perché la fiducia, nella pratica, è in parte emotiva. Non si tratta solo di correttezza, ma di fiducia.

In parole povere: se gli utenti si sentono ciechi, esitano.

Sotto stress del mondo reale—alta capacità, applicazioni complesse, pressione normativa—quel livello nascosto potrebbe passare da vantaggio a vincolo. O forse no. Forse l'astrazione diventa normale nel tempo, allo stesso modo in cui le persone hanno smesso di mettere in discussione come Internet instrada i dati.

Non sono ancora convinto in un modo o nell'altro.

Midnight non sta cercando di migliorare la trasparenza. Sta sfidando l'assunzione che la trasparenza sia sempre necessaria. Questo è un cambiamento più profondo di quanto sembri. Costringe a un tipo diverso di fiducia—quella basata su prove, non su osservazione.

E sto ancora cercando di capire se sia qualcosa che le persone accetteranno naturalmente… o resisteranno silenziosamente.

\u003ct-57/\u003e \u003cc-59/\u003e \u003cm-61/\u003e