Il momento che mi ha disturbato non era drammatico. Stavo solo guardando il mio portafoglio su un esploratore di blocchi, scorrendo tra le transazioni che non ricordavo nemmeno di aver effettuato. Tutto era lì—importi, timestamp, schemi. Non solo visibili a me, ma a chiunque si prendesse la briga di guardare. È allora che la domanda si è insediata silenziosamente: se questa è libertà finanziaria, perché sembra che qualcuno mi stia osservando?

Non sono andata a cercare risposte per curiosità. Era più un disagio che altro che mi ha portato verso Midnight Network. Non stavo cercando di capire cosa affermasse di essere. Stavo cercando di capire se il problema che sentivo fosse reale, o solo qualcosa che stavo esagerando.

All'inizio, assumevo che la privacy nelle criptovalute fosse già "risolta". Ci sono sistemi in cui le transazioni sono nascoste, le identità oscurate. Ma più guardavo, più emergeva un modello: nel momento in cui desideri utilità—smart contract, composabilità, applicazioni reali—la privacy inizia a scomparire. È quasi come se fossi costretto a scegliere. O rimani nascosto, o partecipi completamente. Raramente entrambi.

Questa compromissione non sembrava accidentale.

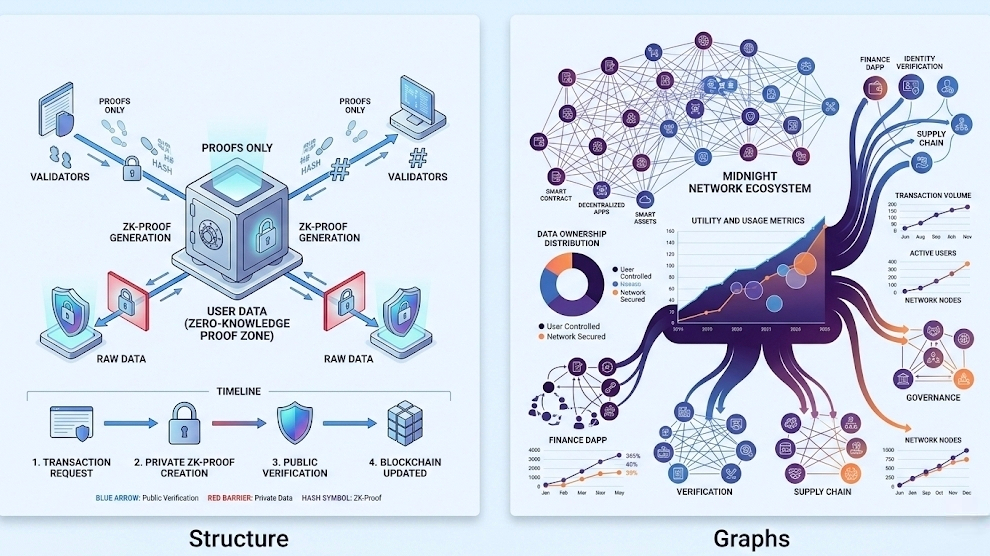

Mi ha fatto riconsiderare cosa significhi realmente la privacy in questi sistemi. Riguarda nascondere completamente le informazioni, o controllare quando e come vengono rivelate? È lì che la Zero-Knowledge Proof ha iniziato a avere senso, non come una caratteristica tecnica, ma come un cambiamento nel modo in cui si costruisce la fiducia. L'idea che puoi dimostrare che qualcosa è vero senza esporre i dati sottostanti suona astratta, ma le sue implicazioni sono molto concrete. Suggerisce un sistema in cui la verifica sostituisce l'esposizione.

Ma questo solleva immediatamente un'altra domanda: cosa consente effettivamente che non fosse possibile prima?

Se gli sviluppatori possono costruire applicazioni in cui gli utenti non devono rivelare dati sensibili, allora alcuni casi d'uso iniziano a sembrare più realistici—accordi finanziari privati, sistemi di identità in cui dimostri idoneità senza rivelare dettagli personali, interazioni che non registrano permanentemente tutto di te. Ma queste non sono garanzie. Dipendono da se il sistema può gestire il peso di quelle prove in modo efficiente.

E lì le cose diventano meno filosofiche e più pratiche.

Se generare e verificare le prove è costoso o lento, allora l'esperienza degrada. E quando l'esperienza degrada, le persone non rimangono abbastanza a lungo per apprezzare i principi. Così il sistema inizia a rivelare per cosa è realmente ottimizzato. Non solo privacy, ma un equilibrio specifico tra privacy e usabilità. E quell'equilibrio determinerà chi lo utilizza realmente.

Alcuni utenti potrebbero accettare attriti se questo dà loro controllo. Altri no. Per loro, velocità e semplicità superano tutto il resto. Il che significa che questo tipo di sistema non introduce solo nuove capacità, ma filtra silenziosamente il proprio pubblico.

Poi c'è la questione del comportamento su larga scala.

Se agli utenti viene data la possibilità di scegliere cosa rivelare, ereditano anche la responsabilità di fare quella scelta ripetutamente. Ogni interazione diventa un punto decisionale. Col tempo, sembra empowerment, o diventa un sovraccarico cognitivo? E se utenti diversi fanno scelte diverse, come influisce su fiducia tra di loro?

È anche difficile ignorare come questo possa intersecarsi con la regolamentazione. I sistemi che minimizzano l'esposizione dei dati non si allineano sempre in modo netto con gli ambienti che si aspettano trasparenza. Questa tensione non rompe necessariamente il sistema, ma ne plasma dove e come può crescere. A un certo punto, la governance smette di essere uno strato separato e inizia a diventare parte del prodotto stesso, definendo predefiniti, confini e comportamenti accettabili senza sempre rendere esplicite quelle decisioni.

Cosa rende più difficile valutare è quanto di questo sia ancora non provato.

È una cosa che un sistema funzioni in condizioni controllate, con utenti limitati e assunzioni chiare. È un'altra che operi sotto pressione del mondo reale, dove l'uso è imprevedibile e gli incentivi cambiano rapidamente. Mi chiedo quali segnali aumenterebbero effettivamente la fiducia qui. Non promesse, ma modelli—sviluppatori che costruiscono cose a cui le persone ritornano, utenti che scelgono la privacy anche quando è opzionale, prestazioni che si mantengono quando non è più conveniente.

Non sono sicuro quale sia ancora il risultato.

Ma torno sempre a poche domande che sembrano più utili di qualsiasi conclusione. Se la fiducia non dipende più dalla visibilità, cosa la sostituisce nella pratica? Quando alle persone viene data l'opzione di rivelare di meno, la scelgono effettivamente? E se lo fanno, rende i sistemi più resilienti, o solo più difficili da coordinare?

Da qualche parte in quelle risposte, la vera forma di questa idea inizierà a emergere.

$NIGHT @MidnightNetwork #night