Più fisso lo sguardo sul dashboard di Midnight City alle 3 del mattino ora locale, osservando quegli agenti AI in Kalendo e Bison Flats continuare a generare transazioni protette senza una sola perdita, meno mi preoccupo che la matematica a conoscenza zero si rompa.

Ciò che davvero mi tiene sveglio è il passaggio.

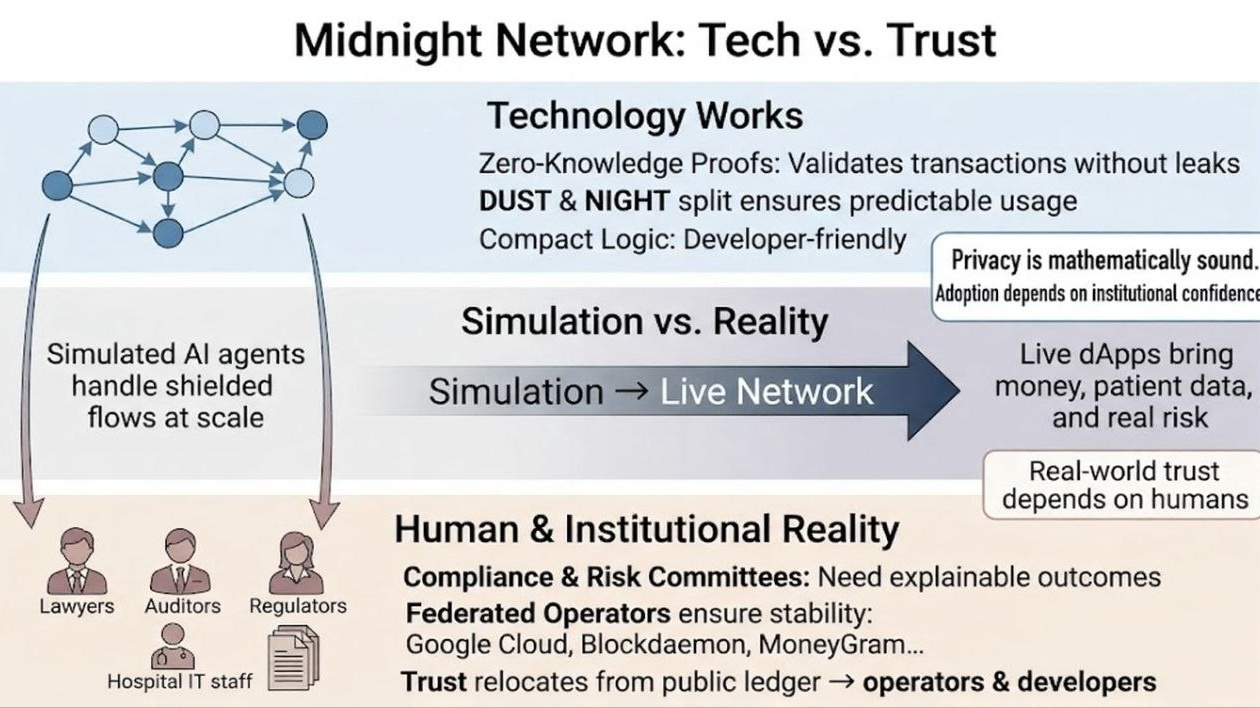

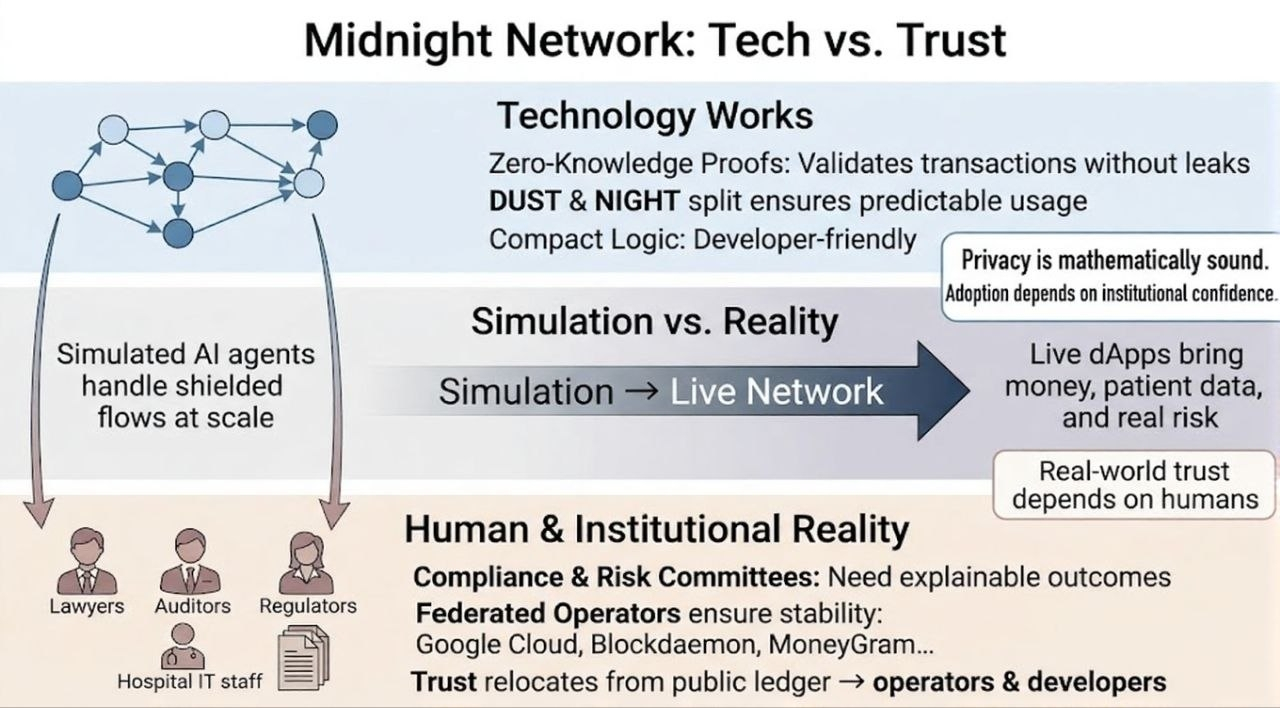

Perché proprio ora—letteralmente giorni prima del mainnet federato di Kūkolu—la simulazione sta facendo esattamente ciò per cui è stata costruita: dimostrare che la privacy razionale può scalare sotto un carico caotico, sempre attivo, da agenti imprevedibili. Le prove generano in modo pulito. DUST fluisce. La catena non si soffoca. Chiunque può osservare le metriche pubbliche e vedere che il sistema tiene.

Ma quando le vere dApp con veri soldi, veri registri di pazienti o veri set di dati di addestramento AI colpiscono la rete live, il gioco cambia completamente.

È l'attrito che non riesco a smettere di rielaborare.

L'intero pitch di Midnight è bellissimo sulla carta: prova solo ciò che deve essere provato, mantieni le cose sensibili protette, lascia che le istituzioni usino finalmente la blockchain senza vivere in una casa di vetro. Compact fa sembrare quasi normale TypeScript così più sviluppatori possono realmente costruire. La divisione NIGHT/DUST cerca di rendere l'uso prevedibile invece di punitivo. Operatori federati come Google Cloud, MoneyGram, Blockdaemon, eToro, Worldpay e Bullish portano credibilità e stabilità per la fase di lancio.

Tutto ciò è ingegneria intelligente. Responsabile, anche.

Tuttavia, ecco cosa i documenti e la bellissima simulazione non possono risolvere: la burocrazia, gli avvocati, gli ufficiali di conformità e i comitati di rischio il cui intero lavoro è assumere che qualcosa andrà storto e qualcuno dovrà spiegarlo in tribunale.

Quando un contratto sanitario protetto o un flusso di coordinamento AI si esegue perfettamente ma qualcosa a valle va storto—chi ricostruisce realmente cosa è successo? Le prove dicono "valido." La catena dice "privato per design." Ma l'auditor, il regolatore o il paziente i cui dati sono stati coinvolti hanno comunque bisogno di qualcosa di più che "fidarsi della matematica."

In una catena completamente trasparente, puoi almeno puntare al sentiero pubblico e argomentare. In Midnight, quel sentiero è intenzionalmente limitato. Quindi la fiducia non scompare—si sposta semplicemente silenziosamente. Dal registro aperto agli sviluppatori che hanno scritto la logica di Compact, alla toolchain che ha compilato i circuiti, agli operatori federati che gestiscono i nodi e potrebbero un giorno ricevere una richiesta molto cortese dalle giurisdizioni a cui rispondono.

Non è una cospirazione. Sono incentivi che incontrano la realtà.

Gli ospedali non adottano crittografia elegante perché la simulazione sembrava impressionante. Adottano quando il loro team legale può dormire tranquillo sapendo che possono ancora soddisfare i requisiti di spiegabilità, le regole transfrontaliere e la governance interna senza dover aprire la riservatezza per cui hanno pagato. I regolatori non applaudono per "affidabilità invisibile"—vogliono difendibilità che possono documentare.

Midnight sta cercando di infilare meglio quel ago rispetto a molti progetti di privacy che abbiano mai fatto. La fase di federazione è un ponte pragmatico, non un tappeto. La simulazione sta già mostrando che il ciclo centrale funziona sotto stress. Ma la sfida più profonda non è mai stata puramente tecnica.

È se questa privacy razionale può essere tradotta in qualcosa di cui le burocrazie si fidano realmente—non solo in laboratorio, ma quando la responsabilità reale, i titoli reali e la pressione reale si presentano.

Tifo ancora molto per questo. Il mondo ha disperatamente bisogno di sistemi protetti ma verificabili che non ci costringano a scegliere tra utilità e privacy. Ma se la bellissima matematica finisce per dipendere da "adulti approvati" nella stanza per rimanere difendibile, allora la rivoluzione potrebbe sembrare molto più un middleware d'impresa responsabile che l'infrastruttura sovrana che molti di noi speravano.

E va bene—se siamo onesti riguardo a ciò che stiamo realmente costruendo.

La simulazione ha dimostrato che la privacy può funzionare invisibilmente su scala.

La vera prova, che inizia qualsiasi giorno ora con Kūkolu, è se il resto dello stack (umano, legale, istituzionale) è pronto a vivere con ciò che quell'invisibilità costa realmente.

Cosa ne pensi—quando il primo flusso protetto serio colpisce la lista di sorveglianza di un nodo regolamentato, la privacy tiene grazie alla matematica, o perché gli operatori decidono che dovrebbe?

@MidnightNetwork #night $NIGHT