negli ultimi giorni sto esplorando Sign e il loro modello di attestazioni, cercando di capire come risolvono il problema degli attacchi Sybil. sulla carta tutto sembra molto logico: invece di guardare al portafoglio, guardi alla reputazione confermata. non solo un indirizzo, ma un insieme di segnali su di esso.

e a prima vista sembra che sia quasi una soluzione perfetta. se hai attestazioni da fonti affidabili, sei un utente “reale”. se no, il sistema ti ignora. sembra una versione più intelligente del proof-of-humanity.

ma più a lungo guardi, più forte è la sensazione che non sia una soluzione, ma solo una nuova forma dello stesso problema.

perché l'attacco Sybil non riguarda i portafogli. riguarda gli incentivi.

se per il sistema è importante avere determinate attestazioni, allora nasce la motivazione per ottenerle. non necessariamente in modo onesto. È sufficiente — in modo efficace.

qui inizia la meccanica. ci sono emittenti che rilasciano attestazioni. ci sono utenti che ne hanno bisogno per l'accesso, i drop o la reputazione. e ci sono protocolli che accettano questi dati come segnale.

in teoria tutto si basa sulla 'qualità delle fonti'. nella pratica, ciò apre uno spazio per l'ottimizzazione. si possono creare nuovi portafogli e passarli attraverso le stesse fonti. si possono trovare emittenti deboli o affiliati. si possono persino costruire intere reti che si scambiano attestazioni tra loro.

il sistema continua a sembrare valido. ci sono dati, ci sono firme, tutto viene verificato.

e qui appare il dettaglio che cambia tutto.

Sign non verifica la realtà — verifica la coerenza dei dati

se molte fonti si confermano a vicenda, il sistema lo accetta come segnale. anche se non c'è alcuna 'reale' unicità dell'utente dietro.

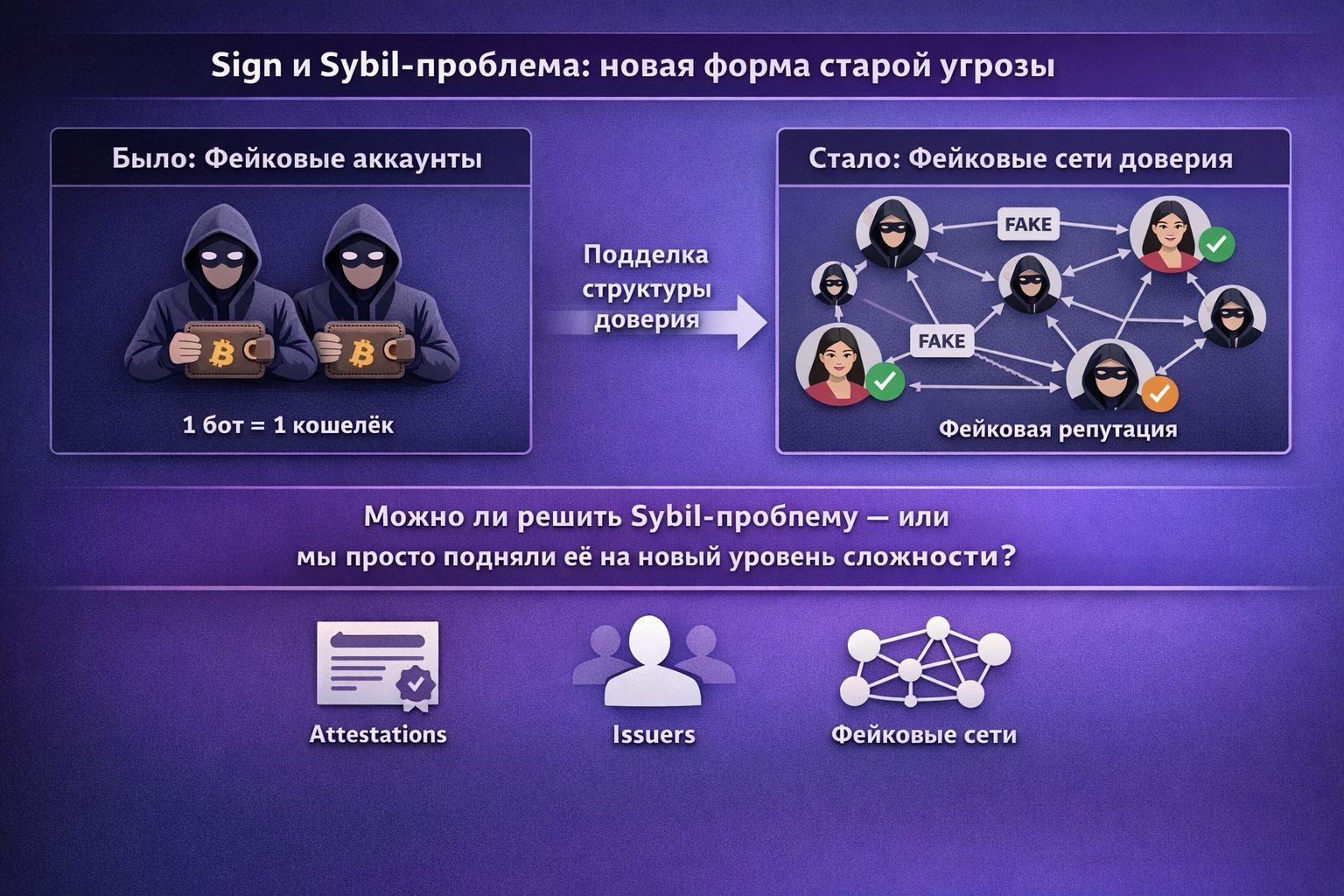

questa è la nuova forma di Sybil. non tramite la creazione di portafogli, ma tramite la creazione di una struttura di fiducia credibile.

e da qui deriva il principale trade-off.

da un lato, ottieni un sistema più flessibile ed espandibile rispetto a '1 persona = 1 account'. puoi considerare diversi segnali, combinarli, costruire modelli di accesso complessi.

dall'altra parte, sposti il problema a un livello superiore. ora non devi più difenderti da account falsi, ma da reti di fiducia false.

e questo è molto più complesso.

perché se prima dovevi distinguere un bot da una persona, ora devi distinguere una vera reputazione da una ben costruita.

alla fine si crea una situazione strana.

Sign complica davvero gli attacchi Sybil a livello base. ma allo stesso tempo apre la strada a attacchi più avanzati e sistematici, che sembrano assolutamente legittimi.

e allora sorge la domanda che non dà pace:

se la reputazione può essere costruita come un costruttore,

si può davvero parlare di una soluzione al problema Sybil — o abbiamo semplicemente sollevato il problema a un nuovo livello di complessità?