Non riuscivo a togliermi una semplice frustrazione: se tutto on-chain dovrebbe essere trasparente, perché sembra comunque così difficile dimostrare qualcosa di significativo?

Non stavo pensando alle transazioni. Quelle sono facili. Puoi tracciare un wallet, verificare un trasferimento, confermare i saldi. Ma nel momento in cui la domanda passa da cosa è successo a chi merita qualcosa, tutto diventa sfocato.

Quella tensione è ciò che mi ha fatto guardare più da vicino.

All'inizio, assumevo che il problema fosse l'identità. Forse la crittografia manca semplicemente di un adeguato strato di identità. Ma più guardavo, più mi rendevo conto che l'identità da sola non risolve molto. Anche se sai chi è qualcuno, come fai a verificare cosa ha fatto, per cosa è qualificato, o se dovrebbe ricevere una ricompensa?

Quindi la domanda è cambiata: il vero problema è l'identità… o è la prova?

È in quel momento che sono inciampato in SIGN, non come soluzione, ma come un sistema che sembrava essere costruito attorno a quella confusione esatta. Non ho iniziato cercando di capirlo. Ho iniziato testando se potesse rispondere al problema su cui ero bloccato.

La prima cosa che ho notato è che SIGN non cerca di definire la verità. Cerca di strutturare come la verità viene registrata e verificata. Quella distinzione sembrava piccola all'inizio, ma continuava a trascinarmi più a fondo.

Se lo riduco a comportamento, SIGN consente a qualcuno di fare un'affermazione — non solo "questo è accaduto", ma "questo è valido" — e poi attaccarlo a un sistema dove altri possono verificarlo indipendentemente. Sembra semplice, ma cambia il flusso di come vengono prese le decisioni.

Invece di piattaforme che decidono l'idoneità internamente, la verifica diventa esternalizzata.

Questo ha sollevato un'altra domanda per me: cosa rimuove effettivamente?

La risposta ovvia è la verifica manuale. Ma questo è superficiale. Il cambiamento più profondo è nella coordinazione. Se più sistemi possono fare affidamento sulle stesse affermazioni verificabili, allora le decisioni non devono essere ricostruite da zero ogni volta.

E da lì ho iniziato a notare l'architettura come prova, non come una caratteristica.

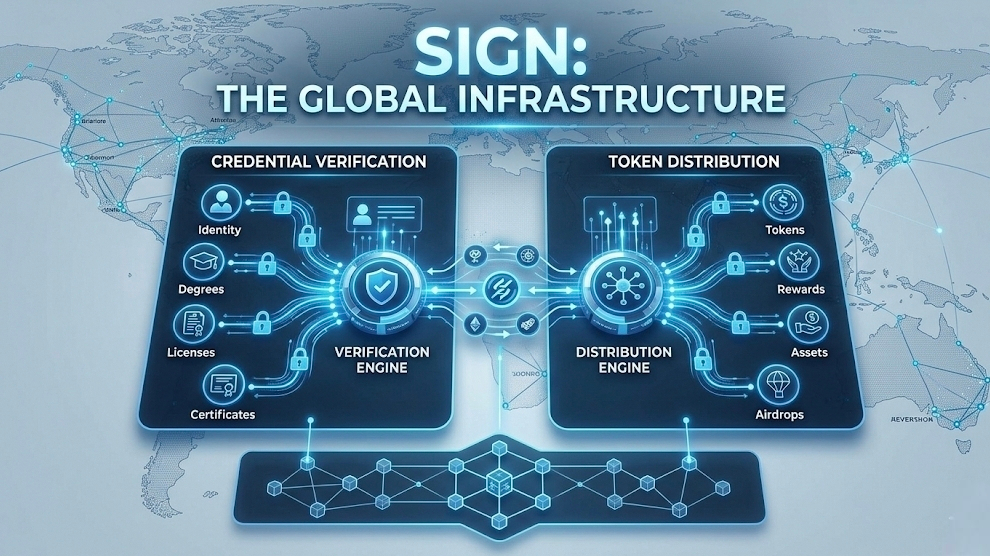

Il livello del protocollo di SIGN funge da registro di attestazioni — affermazioni strutturate che possono essere verificate in diversi ambienti. Non sta cercando di sostituire un blockchain. Si trova accanto a loro, concentrandosi specificamente sulla credibilità dei dati piuttosto che sul movimento di valore.

Poi c'è il lato della distribuzione dei token — strumenti che utilizzano quelle affermazioni verificate per decidere chi ottiene cosa. Airdrop, incentivi, allocazioni — ma legate a prove invece di congetture.

A questo punto, ho smesso di pensarci come infrastruttura e ho iniziato a pensarlo come un filtro.

Non un filtro per le transazioni, ma un filtro per la legittimità.

E questo ha portato a una domanda più scomoda: che tipo di comportamento incoraggia questo sistema?

Se le ricompense dipendono da azioni verificabili, gli utenti sono spinti a generare prove di partecipazione piuttosto che solo di presenza. Sembra efficiente, ma cambia anche il modo in cui le persone interagiscono con i sistemi. Invece di esplorare liberamente, potrebbero iniziare a ottimizzare per ciò che può essere provato.

Questo è un effetto di secondo ordine che non posso ignorare.

Suggerisce che nel tempo, sistemi come SIGN non solo verificano il comportamento — lo modellano.

Poi ho iniziato a pensare su scala. Cosa succede quando questo non viene utilizzato solo per incentivi crittografici, ma per sistemi più ampi — istruzione, governance, persino servizi pubblici?

Se le credenziali, l'idoneità e l'accesso dipendono tutti dalle attestazioni, allora chiunque definisca la struttura di quelle attestazioni detiene un'influenza silenziosa. Non controllo nel senso tradizionale, ma influenza su ciò che conta come prova valida.

È lì che la governance smette di essere una caratteristica e inizia a diventare parte del prodotto stesso.

E non penso che quella parte sia completamente risolta.

Perché mentre il sistema riduce l'attrito nella verifica, introduce una nuova dipendenza: fiducia nelle entità che emettono quelle attestazioni. Il sistema può dimostrare che un'affermazione esiste ed è valida secondo le sue regole, ma non prova intrinsecamente che l'affermazione dovrebbe esistere in primo luogo.

Quindi ora la domanda evolve di nuovo: chi ha il diritto di emettere prove e perché qualcuno dovrebbe fidarsi di loro?

Non ho ancora una risposta chiara a questo.

Quello che vedo è che SIGN sembra ottimizzato per ambienti in cui la verifica deve scalare tra i sistemi — dove più parti beneficiano di prove condivise e riutilizzabili. Deprioritizza l'anonimato nel senso più puro, non rimuovendolo, ma rendendo la reputazione e le credenziali più centrali per la partecipazione.

Questo lo rende confortevole per istituzioni, ecosistemi e comunità strutturate.

Meno per coloro che valutano interazioni senza attrito e leggere di identità.

E forse questo è intenzionale.

Più ci penso, più sembra che SIGN non stia cercando di sostituire i comportamenti crittografici esistenti. Sta cercando di formalizzare un livello che la crittografia ha evitato — il livello in cui le decisioni richiedono contesto, non solo dati.

Ma ciò significa anche che il suo successo dipende da qualcosa di più difficile da misurare.

L'adozione è una cosa. La dipendenza significativa è un'altra.

Mi chiedo quali segnali potrebbero effettivamente confermare che questo modello funziona.

Sarebbe airdrop su larga scala che non vengono più sfruttati?

Sarebbero istituzioni a emettere credenziali che vengono effettivamente utilizzate tra piattaforme?

O sarebbe qualcosa di più silenzioso — un cambiamento graduale in cui i sistemi smettono di chiedere agli utenti di provare se stessi manualmente perché la prova è già lì?

Allo stesso tempo, riesco a vedere dove le ipotesi potrebbero rompersi.

Se le attestazioni diventano troppo facili da emettere, perdono valore.

Se diventano troppo restrittive, limitano la partecipazione.

Se la governance diventa concentrata, il sistema rischia di ricreare gli stessi problemi di fiducia che mira a risolvere.

Quindi mi ritrovo con un diverso tipo di chiarezza.

Non riguarda cosa sia SIGN, ma come osservarlo.

Sto prestando attenzione a chi emette attestazioni, non solo a chi le utilizza.

Sto osservando se le prove vengono riutilizzate tra i sistemi o rimangono isolate.

Sto notando se gli incentivi spostano il comportamento in modi significativi o semplicemente creano nuove forme di ottimizzazione.

E sto aspettando di vedere se la verifica sostituisce effettivamente la fiducia… o semplicemente rimodella dove vive la fiducia.

Per ora, sto ancora osservando.

E penso che la vera domanda non sia se SIGN funzioni.

È se il mondo intorno a esso è pronto a dipendere dalla prova nel modo in cui assume.

\u003cc-140/\u003e \u003cm-142/\u003e\u003ct-143/\u003e