La prima volta che ho veramente capito quanto sia fragile la verità nei sistemi digitali, non è stato a causa di qualche grande hacking o scandalo in prima pagina. Era qualcosa di più piccolo. Un dataset che sembrava pulito, superava la validazione e portava comunque una distorsione silenziosa che nessuno notava fino a quando non era importante. Questa è la cosa sui sistemi moderni. Di solito non si rompono rumorosamente. Deviano. E gran parte di quella deviazione inizia con un semplice fatto: mentire è spesso economico.

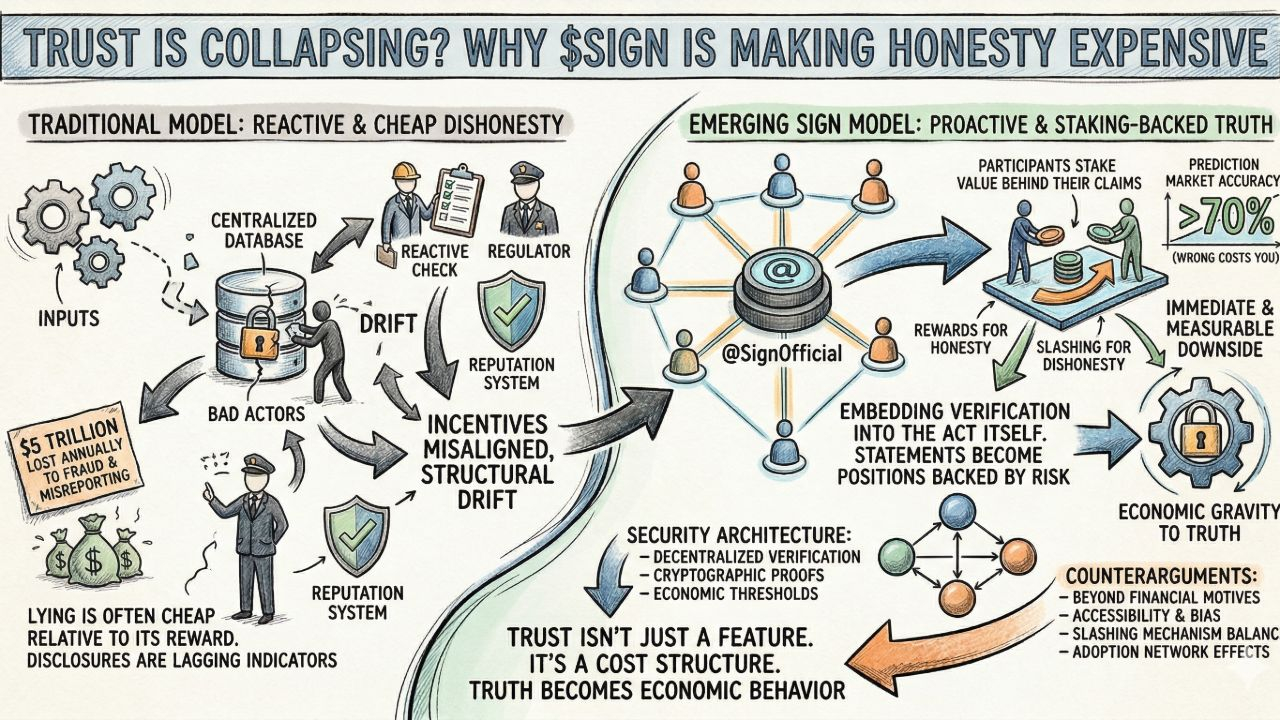

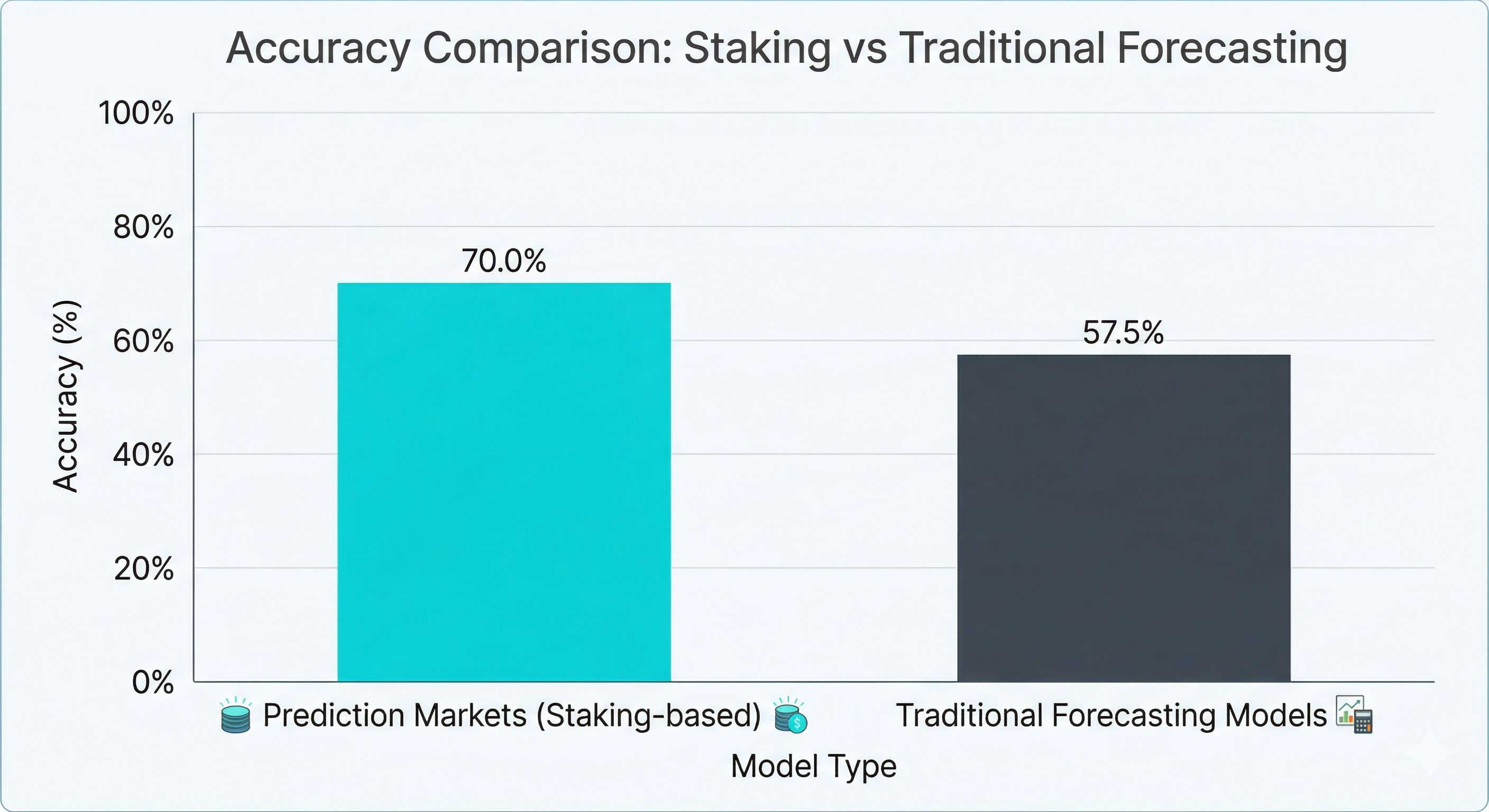

In questo momento, gli incentivi sono disallineati in modi che abbiamo per lo più imparato a tollerare. Nei sistemi finanziari, i 5 trilioni di dollari persi ogni anno a causa di frodi e falsificazioni sono una cifra sconcertante, ma cattura solo una dimensione del problema. Quello che quel numero espone realmente è quanto sia economica la disonestà rispetto al suo potenziale guadagno. Quando gli attori possono manipolare gli input o ritardare le divulgazioni con conseguenze minime, il sistema non fa solo che permettere il comportamento, ma lo invita strutturalmente a deviare. Non esplicitamente, ma strutturalmente.

Quando ho guardato per la prima volta @SignOfficial , ciò che mi ha colpito non erano le meccaniche. Era il quadro. Invece di cercare di rilevare le bugie dopo che si sono verificate, cerca di rimodellare il costo di dirle in primo luogo. È un cambiamento sottile, ma cambia tutto sottostante.

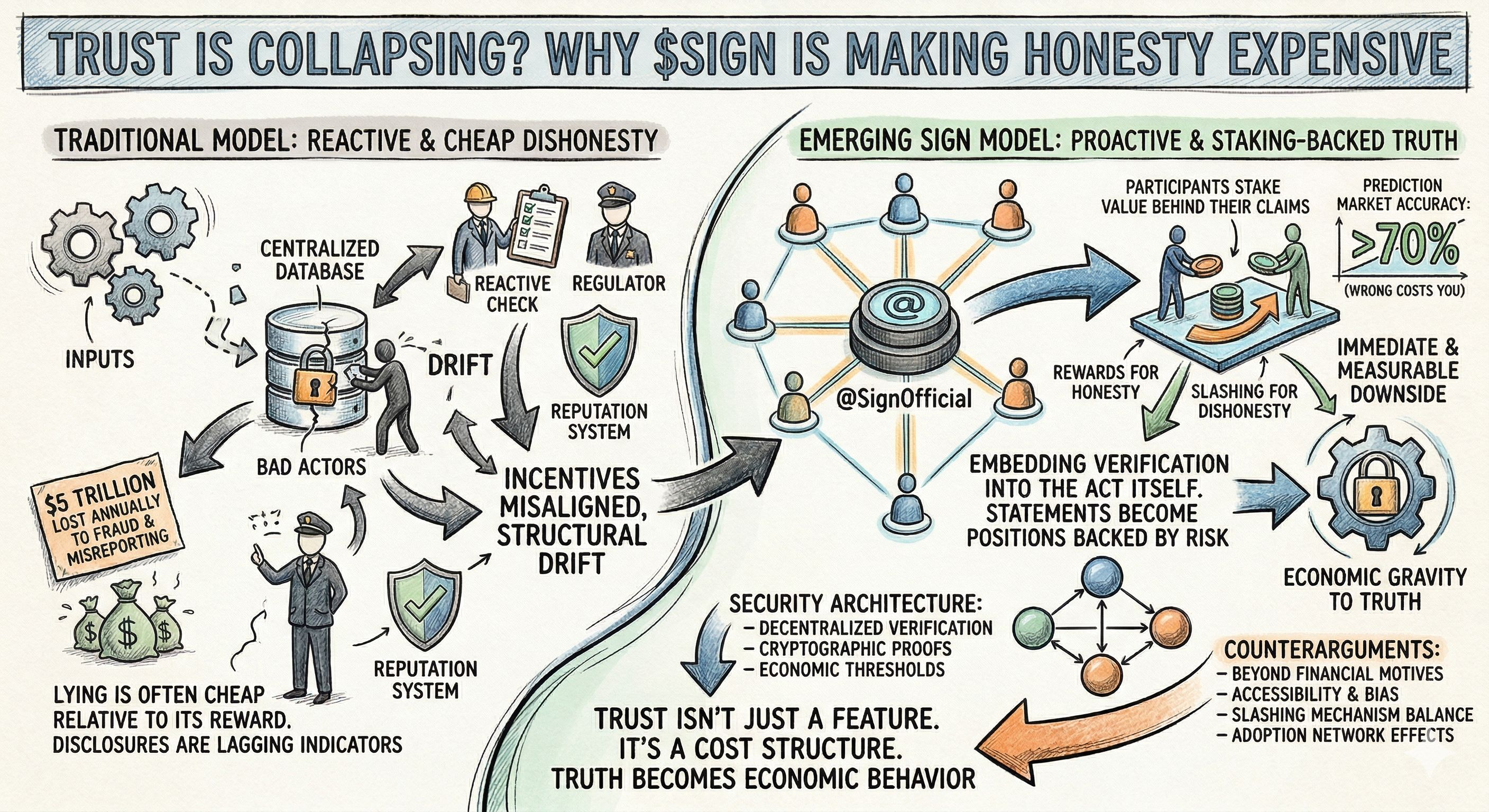

L'idea è semplice in superficie. I partecipanti mettono in gioco valore dietro le loro rivendicazioni. Se sono onesti, guadagnano ricompense. Se sono disonesti, perdono il loro capitale. Ma sotto quella semplicità c'è una rielaborazione più profonda degli incentivi. Introduce gravità economica alla verità. Le dichiarazioni non sono più solo informazioni. Sono posizioni sostenute da rischio.

Questo è importante perché la maggior parte dei sistemi oggi si basa su livelli di verifica che si trovano al di fuori dell'azione. Revisori, regolatori, sistemi di reputazione. Questi sono reattivi. Intervengono dopo che qualcosa va storto o dopo che appare il dubbio. Ciò che $SIGN sta facendo invece è incorporare la verifica nell'atto stesso. Non ti limiti a dire qualcosa. Ti impegni economicamente.

Una volta che introduci quell'attrito, il comportamento inizia a riallinearsi in modi sia evidenti che sottili. In superficie, il calcolo per gli attori disonesti cambia perché il lato negativo diventa immediato e misurabile. Ma il cambiamento più fondamentale avviene sotto. Gli attori onesti iniziano a distinguersi non per ciò che dicono, ma per il capitale che sono disposti a rischiare dietro di esso. Questo crea un tipo di segnale diverso—uno che è strutturalmente difficile da falsificare.

Se questo regge, potrebbe rimodellare il modo in cui la fiducia viene costruita in sistemi dove le scommesse sono elevate e l'asimmetria informativa è costante. Prendi la finanza. In questo momento, le dichiarazioni sono spesso indicatori tardivi. Entro il momento in cui i dati vengono pubblicati, gli incentivi a manipolarli si sono già manifestati. Con le rivendicazioni supportate da staking, la segnalazione diventa proattiva. Non ti limiti a inviare numeri. Ti assumi la responsabilità con capitale.

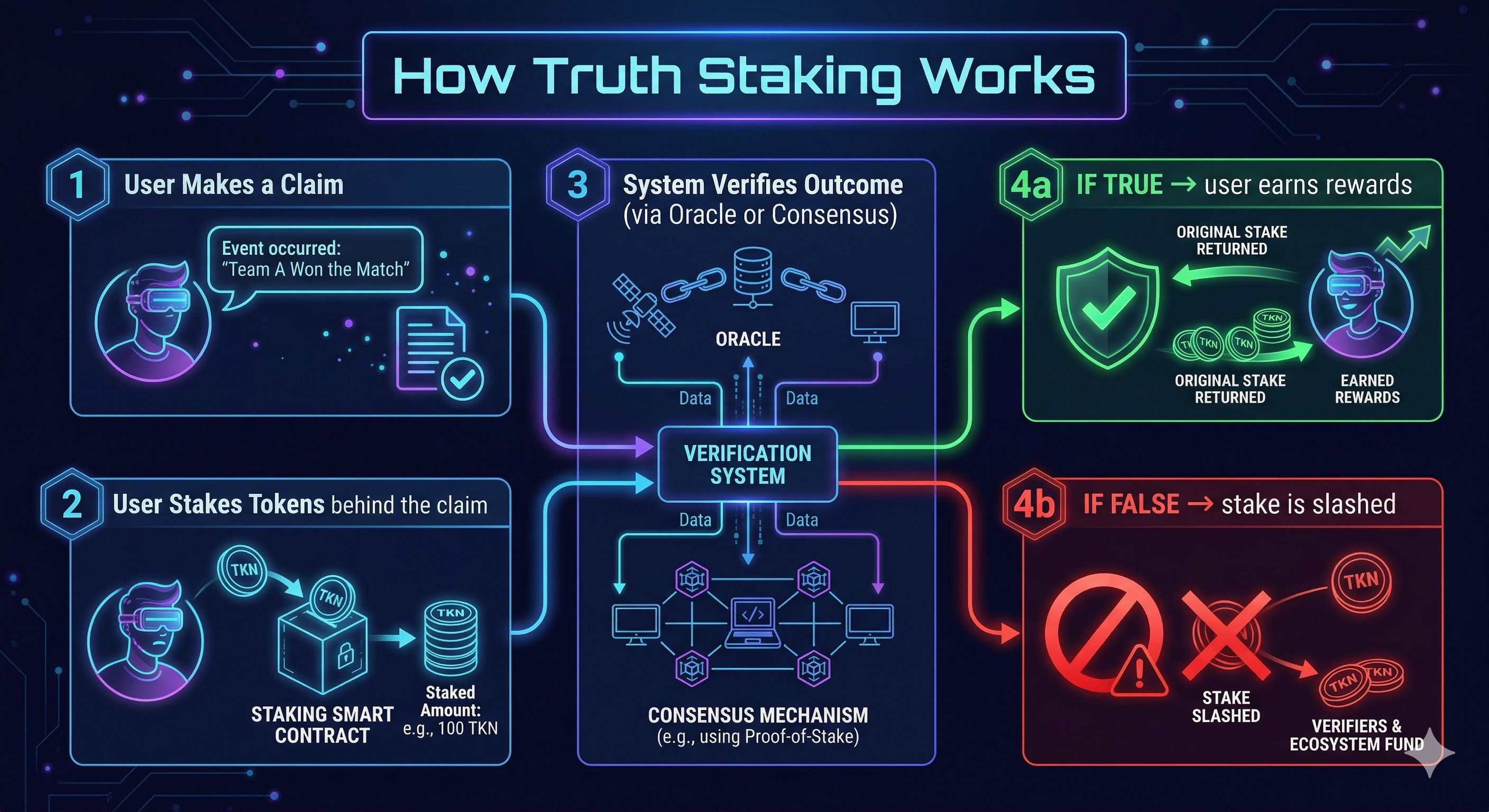

Le prime sperimentazioni in meccanismi simili hanno mostrato qualcosa di rivelatore. Nei mercati delle previsioni dove i partecipanti scommettono sui risultati, i tassi di accuratezza superano spesso il 70%, rispetto ai modelli di previsione tradizionali che si attestano più vicino al 55-60% in ambienti incerti. Quel divario non è solo rumore statistico. Riflette come gli incentivi plasmano il comportamento. Quando avere torto ti costa qualcosa di tangibile, il tuo processo cambia. Controlli più attentamente. Ti copri meno casualmente.

I sistemi di governance probabilmente subiranno un'evoluzione parallela. Nel settore pubblico, la segnalazione spesso inciampa su lacune di credibilità che sembrano endemiche, particolarmente dove l'applicazione istituzionale è disuguale. Quando immaginiamo un modello in cui i funzionari mettono in gioco capitale contro le proprie dichiarazioni, la risposta immediata è il dubbio: un riconoscimento che la collusione e il gioco sono rischi sempre presenti. Tuttavia, ciò che questa struttura fa realmente è introdurre un livello di responsabilità che è interno all'atto stesso. Non si tratta più di imposizione esterna; si tratta della meccanica della rivendicazione.

Questo è il motivo per cui l'architettura della sicurezza rimane fondamentale tanto quanto gli incentivi che è progettata per supportare. Affinché SIGN rimanga robusto, le pene devono essere inevitabili e la validazione deve essere immune alla cattura. Questo richiede di intrecciare una verifica decentralizzata, prove crittografiche e soglie economiche che garantiscano che gli attacchi coordinati rimangano antieconomici. Quando imbrogliare diventa più costoso che avere ragione, il comportamento si stabilizza. La verità diventa il percorso di minor resistenza.

Ma quell'equilibrio è fragile. Se le pene sono troppo severe, la partecipazione diminuisce. Se le ricompense sono troppo piccole, l'onestà non scala. I primi sistemi basati su token hanno avuto difficoltà con questo. Alcuni hanno sovra-incentivato lo staking, portando a una centralizzazione in cui solo i grandi possessori potevano partecipare in modo significativo. Altri lo hanno sotto-incentivato, risultando in segnali deboli che non avevano abbastanza peso per contare.

In questo momento, il mercato crypto più ampio offre un contesto a questo. Con la capitalizzazione di mercato totale delle criptovalute che oscilla attorno ai 2,5 trilioni di dollari e i volumi di scambio giornalieri che superano frequentemente i 100 miliardi di dollari, la scala del valore che si muove attraverso questi sistemi è massiccia. Anche un piccolo miglioramento nei meccanismi di fiducia potrebbe avere effetti sproporzionati. Se un sistema come $SIGN può ridurre la disinformazione o la frode anche solo dell'1% in ambienti di alto valore, si tratta di decine di miliardi di valore preservato.

Tuttavia, non è una storia pulita. Ci sono reali controargomentazioni. Una è che gli incentivi economici non catturano completamente il comportamento umano. Le persone mentono per motivi che non sono puramente finanziari. Ideologia, pressione, sopravvivenza a breve termine. I meccanismi di staking non eliminano quelle forze. Aggiungono solo attrito.

Un'altra preoccupazione è l'accessibilità. Se la verità richiede un sostegno di capitale, ciò esclude i partecipanti che hanno ragione ma sono poco finanziati? Questa è una tensione reale. Sistemi come questo rischiano di creare un pregiudizio verso coloro che possono permettersi di scommettere, non necessariamente verso coloro che hanno ragione. Alcuni design cercano di mitigare questo con delega o staking collettivo, ma quelli introducono le proprie complessità.

Poi c'è la questione dell'applicazione. I meccanismi di penalizzazione dipendono da un giudizio accurato. Se il sistema penalizza erroneamente attori onesti, la fiducia si erode rapidamente. Se non riesce a penalizzare quelli disonesti, l'intero modello si indebolisce. Trovare quel giusto equilibrio riguarda meno il codice e più la governance. E la governance, come abbiamo visto in più protocolli, è dove le cose spesso diventano complicate.

Nel frattempo, l'adozione rimane una questione aperta. I sistemi di incentivi funzionano solo se un numero sufficiente di partecipanti vi aderisce. Gli effetti di rete contano qui. Un sistema di staking della verità con bassa partecipazione non genera segnali significativi. Ma una volta che la partecipazione supera una certa soglia, i segnali diventano più difficili da ignorare. I primi segnali suggeriscono che gli utenti sono disposti a sperimentare con questi modelli, specialmente in ambienti in cui la fiducia è già fragile.

Ciò a cui questo punta è un modello più ampio. Stiamo passando da sistemi che assumono onestà e puniscono la disonestà dopo il fatto, a sistemi che prezzano l'onestà in anticipo. Quel cambiamento è silenzioso, ma cambia le fondamenta. Trasforma la verità da un'aspettativa morale a un comportamento economico.

E se ti allontani, questo non riguarda solo crypto o token. Riguarda come i sistemi digitali evolvono quando iniziano a interiorizzare la fiducia invece di esternalizzarla. La stessa logica potrebbe estendersi ai risultati dell'IA, ai dati della catena di fornitura, persino ai sistemi di identità. Ovunque le informazioni contano, seguono gli incentivi.

Resta da vedere quanto lontano questo modello possa scalare. Ci sono ancora domande aperte attorno a equità, applicazione e conseguenze indesiderate. Ma la direzione sembra solida. I sistemi stanno iniziando a riconoscere che la fiducia non è solo una caratteristica. È una struttura di costo.

Quello che mi rimane è questo. Per la maggior parte dell'informatica moderna, abbiamo trattato la verità come qualcosa da verificare. Ciò che SIGN suggerisce è più silenzioso ma più fondamentale. La verità potrebbe essere qualcosa che devi guadagnare essendo disposto a perdere.