Quando i sistemi degli agenti falliscono, raramente sembra un fallimento all'inizio.

Niente si blocca. Niente si ferma. I compiti continuano a essere eseguiti. Le decisioni continuano a essere prese. Ciò che cambia è più difficile da misurare. Le cose iniziano a richiedere più coordinamento del previsto. Appaiono piccole eccezioni. Qualcuno deve intervenire "solo questa volta."

Di solito è in quel momento che l'autonomia ha già iniziato a erodere.

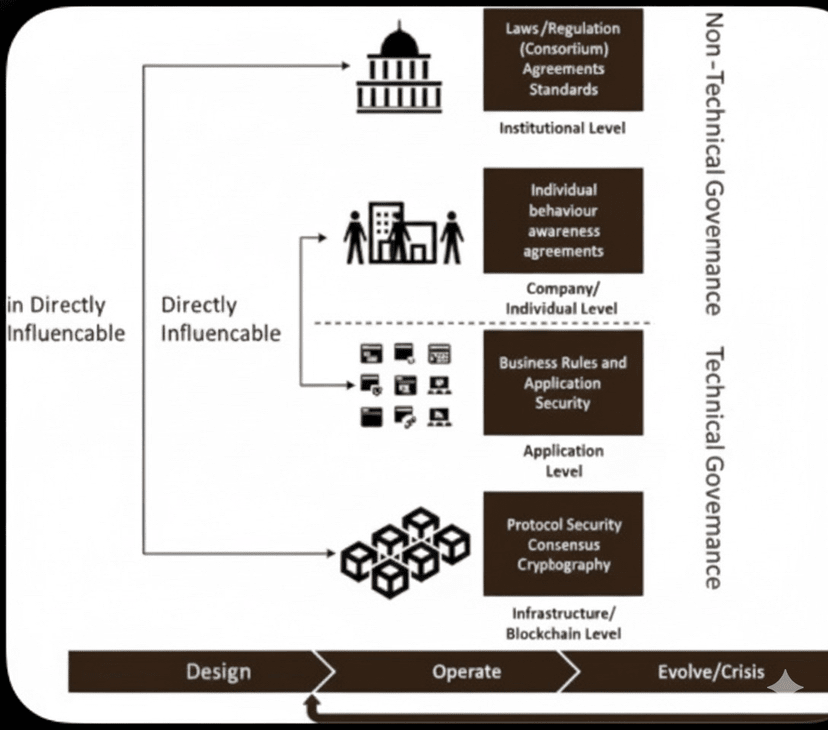

L'errore è quasi sempre lo stesso. La governance è trattata come qualcosa che si aggiunge dopo che gli agenti dimostrano di funzionare. Prima arriva la capacità. Poi arriva la scala. La governance dovrebbe recuperare più tardi.

Di solito non lo fa.

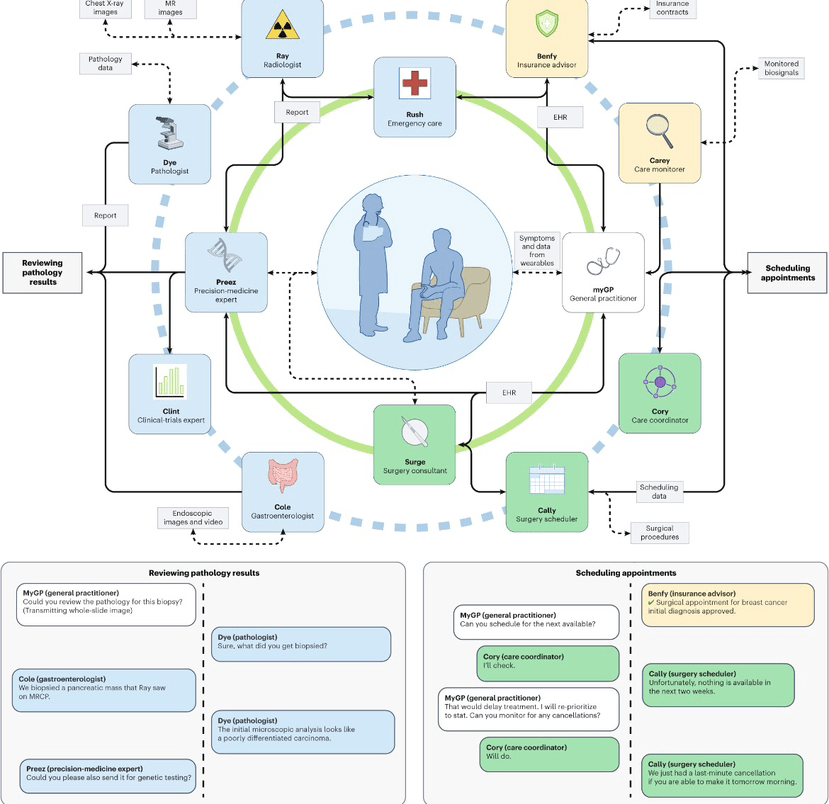

Quando gli agenti operano senza confini fissi, non diventano pericolosi da un giorno all'altro. Diventano incoerenti. Ogni agente segue la propria logica, plasmata da incentivi locali. Da sola, quella logica ha senso. In combinazione, crea sovrapposizioni, conflitti e incertezze su chi è effettivamente responsabile di cosa.

In scala ridotta, questo sembra gestibile. In scala maggiore, si trasforma in attrito. Appaiono più controlli. Più sovrascritture. Più regole scritte al di fuori del sistema perché il sistema stesso non può applicarle in modo pulito.

A quel punto, l'autonomia non è fallita. È stata silenziosamente sostituita.

Il kite parte da un presupposto diverso. La governance non è uno strato che si pone sopra il comportamento degli agenti. È qualcosa che definisce lo spazio in cui gli agenti possono operare fin dall'inizio.

L'identità qui è importante. Non come un'etichetta, ma come un confine. Un agente sa cosa può toccare, dove può agire e quando deve fermarsi. Quei limiti non vengono negoziati al volo. Sono strutturali.

Quella struttura cambia il modo in cui i sistemi scalano. La strategia può evolversi senza riscrivere le regole. Nuovi agenti possono essere aggiunti senza espandere l'incertezza. Il controllo non richiede interventi costanti perché è già incorporato.

I sistemi agenti ben progettati non si basano su agenti che si comportano bene. Si basano su agenti vincolati in modi chiari e prevedibili.

La maggior parte dei sistemi perde il controllo non perché gli agenti diventino troppo capaci, ma perché nessuno ha deciso dove quella capacità dovrebbe finire.