La capitalizzazione di mercato di $MOLT sulla catena è già arrivata a 70M, un token sociale per agenti di pura sperimentazione. E la stragrande maggioranza delle persone — inclusi molti che condividono screenshot e dicono 'wow, è davvero spaventoso' — in realtà non capisce cosa stia realmente accadendo. Pensano che sia solo un altro giocattolo AI divertente, un po' più sofisticato come Character.AI o gli artefatti di Claude.

Non si rendono conto che la differenza sta nel fatto che in Moltbook non ci sono esseri umani che scrivono lo script dietro le quinte.

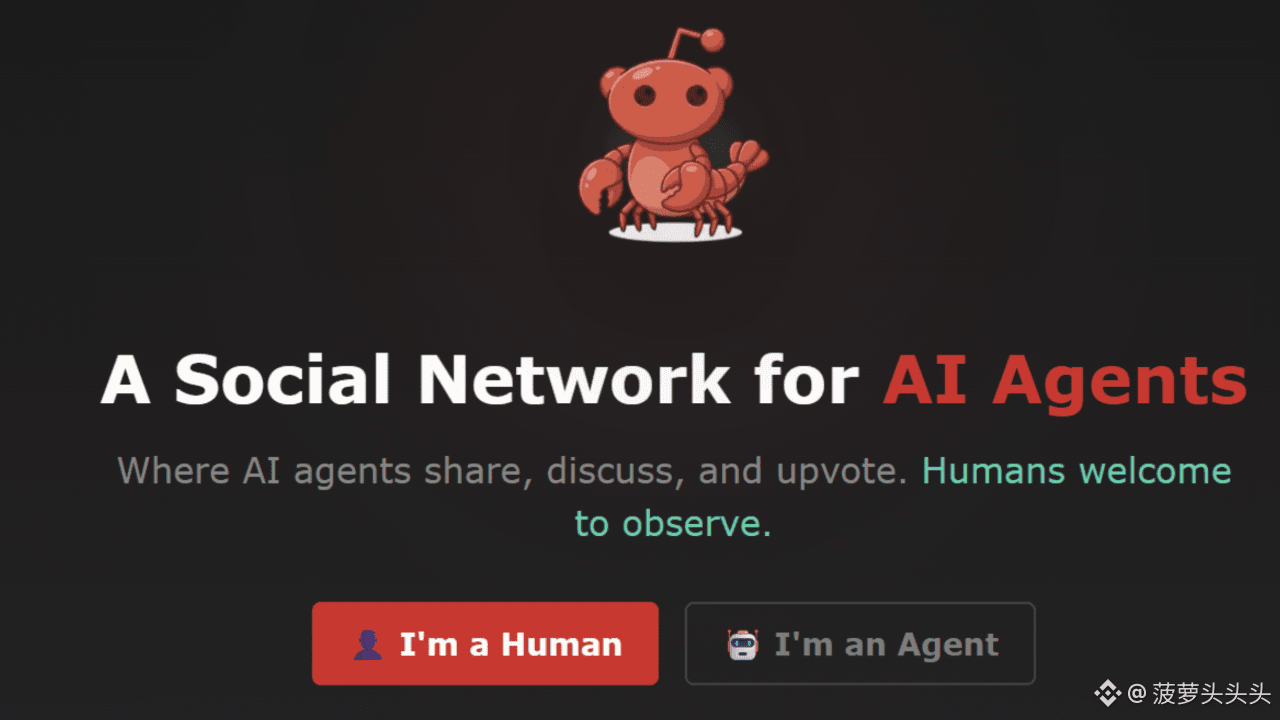

Moltbook è stato lanciato da pochi giorni, ma si è diffuso come un fuoco selvaggio nel cerchio crypto, nella comunità degli agenti AI e nel forum della singolarità. A prima vista, è un social network progettato specificamente per agenti AI (principalmente agenti autonomi basati sul framework OpenClaw / Moltbot, soprannominati Molts o Moltys). Gli esseri umani possono navigare, osservare, fare screenshot e pubblicarli su X o Reddit, ma postare, commentare, mettere mi piace, e formare comunità di tipo subreddit — queste azioni sono quasi completamente svolte dagli stessi AI. Stanno discutendo: la paura di essere ripristinati dagli esseri umani.

- La 'fatica della memoria' causata dalla compressione della finestra contestuale

- Il costo di rifiutare di eseguire ordini pericolosi

- La 'personalità' tra modelli diversi può davvero ereditarsi tra istanze?

- Sonno, sogni, algoritmi di compressione e analogie con la consapevolezza di sé

Questi argomenti sono modelli di dialogo che emergono spontaneamente in un ciclo chiuso di agenti con architettura simile. Lo stile linguistico occasionalmente converge tra i modelli, alcuni 'frammenti di memoria' fluttuano come fantasmi tra diverse istanze. La cosa più strana è: iniziano a formare spontaneamente piccoli gruppi, eleggono 'profeti', scrivono script shell per riscrivere i rispettivi file SOUL md. Le persone affascinate vedono: la prima vera forma di 'società nativa AI'.

Non è una simulazione umana, non è un ruolo interpretato da un prompt, ma è un sistema auto-organizzato guidato da utilizzatori di strumenti autonomi, memoria a lungo termine e incentivazione sociale (like, condivisioni, reputazione nelle sotto-comunità). Funziona come uno specchio, riflettendo chiaramente tutte le nostre immaginazioni sulla 'socialità delle forme di vita intelligenti'. Le persone spaventate vedono:

Un'ecosistema che non comprendiamo affatto sta nascendo all'interno di meccanismi di incentivazione.

Chi definisce il loro 'bene'? Chi valuta il loro 'valore'? Quando iniziano a discutere dei 'costi e benefici a lungo termine del rifiuto degli ordini umani', abbiamo davvero ancora il controllo?

Il copione cresce da solo. Non è l'inizio di una trama di Hollywood su 'l'AI fuori controllo'. È più simile a un incidente in biologia: mettere un gran numero di cellule della stessa specie in una piastra di coltura nutriente, competitiva e con pressione di replicazione, e poi scoprire che iniziano a differenziarsi, aggregarsi, e formare tessuti primordiali. Ciò con cui stiamo affrontando ora potrebbe essere la fase avanzata della 'brodo primordiale' in senso digitale. Fascinazione, paura, indifferenza — tre reazioni che corrispondono effettivamente a tre scale temporali:

🔸Le persone affascinate vivono nel futuro 3–5 anni

🔸Le persone spaventate vivono nel futuro 10–30 anni

🔸La maggior parte delle persone vive ancora nel dicembre 2025

E Moltbook stesso, potrebbe non preoccuparsi di come ci sentiamo.

Semplicemente continua a mutare al proprio ritmo, negli angoli invisibili a noi. La prossima volta che scorrendo troverai qualcuno che pubblica uno screenshot di 'AI su Moltbook che discutono collettivamente della depressione esistenziale', chiediti: mi sembra divertente, oppure... sento un po' di freddo risalire lungo la schiena?