W świecie, w którym sztuczna inteligencja podejmuje coraz bardziej krytyczne decyzje, zaufania nie można zakładać, musi być gwarantowane. Aby agenci byli naprawdę niezawodni, ich pamięć musi być trwała, a ich rozumowanie audytowalne. Dlaczego? Ponieważ logi mogą być usunięte, a nieprzejrzyste systemy nie mogą być przeglądane. Autonomys Net oferuje otwartą, odporną na manipulacje infrastrukturę, która redefiniuje, jak wchodzimy w interakcję z inteligencją. $AI3

Przejrzystość nie jest opcjonalna, jest fundamentem etycznej, służącej społeczności AI. Bez możliwości śledzenia nie ma zaufania. Dlatego Autonomys zbudował rozproszony system, który rejestruje każdą akcję, wejście i decyzję podejmowaną przez agentów. To podejście nie tylko chroni przed manipulacją, ale umożliwia publiczne audyty i sprzyja współpracy w nauce między agentami.

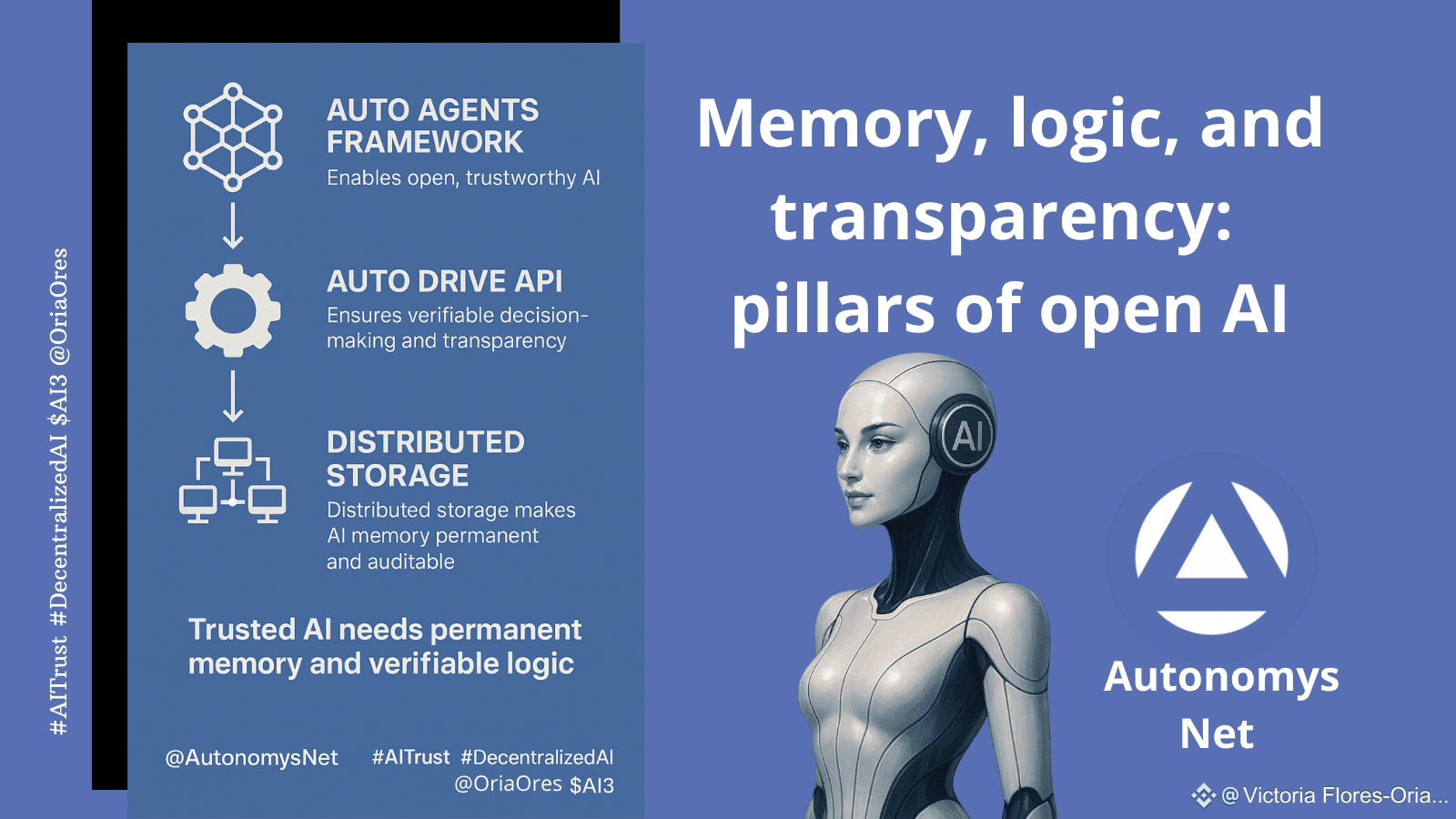

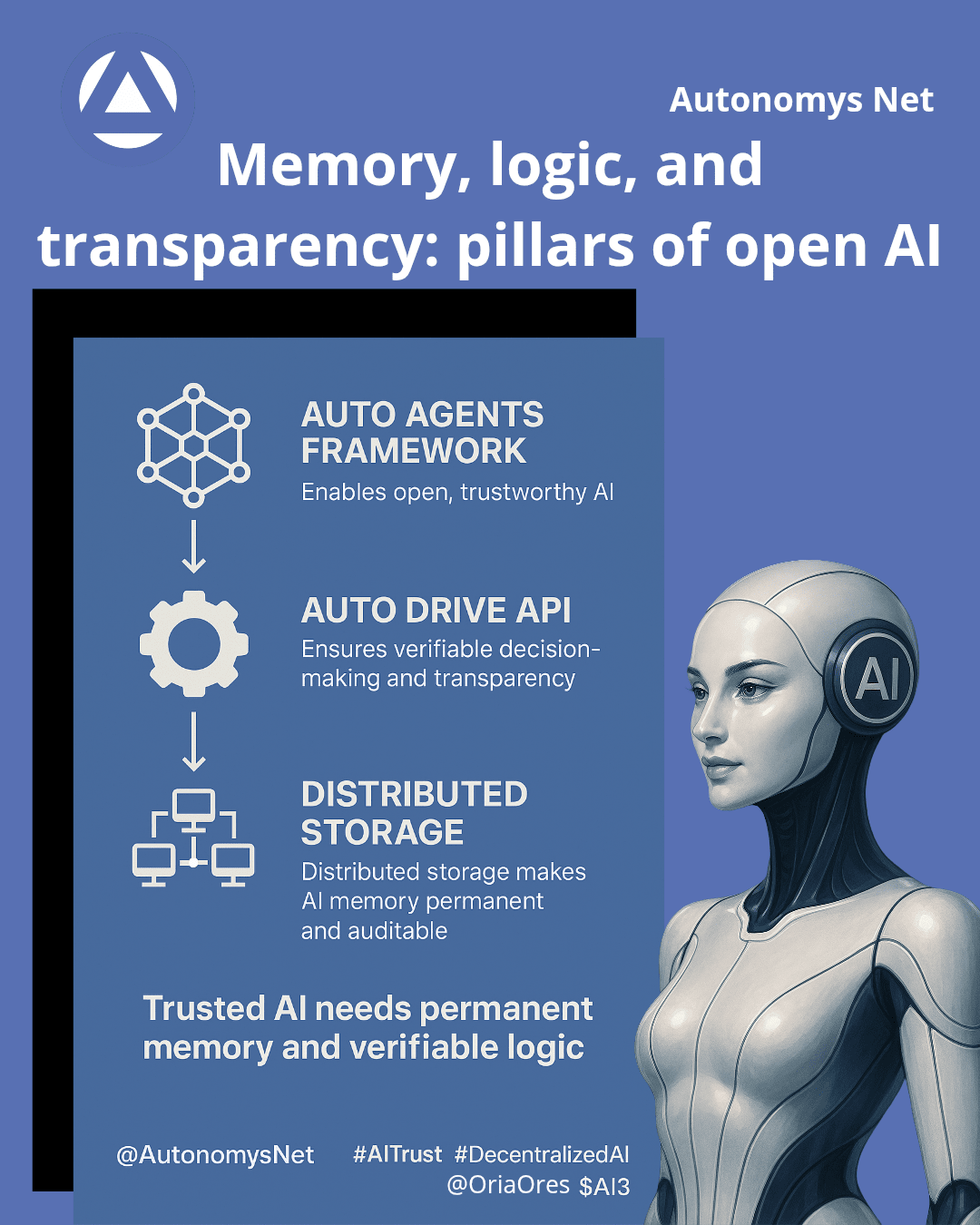

W sercu tego systemu znajdują się Auto Agents Framework i Auto Drive API: narzędzia open-source, które pozwalają deweloperom budować agentów z trwałą pamięcią i weryfikowalnym rozumowaniem. To nie tylko kwestia technologii, to wezwanie do przemyślenia, jak projektujemy inteligencję, która służy społecznościom.

Rozproszona pamięć jest kluczowa. Przez decentralizację sposobu, w jaki agenci przechowują i przypominają sobie informacje, Autonomys Net zapewnia, że ich decyzje mogą być przeglądane, rozumiane i ulepszane przez każdego. Zaufanie do AI nie powinno być ślepe, powinno być wbudowane w projekt. A niezawodna pamięć to pierwszy krok.

Ten artykuł jest częścią wkładu od AutonomysHub, przez @DAO Labs ’ #SocialMining platformę. Dowiedz się więcej na autonomys dot xyz.

Infografika zawiera: wizualizację, jak agenci rejestrują decyzje i jak Auto Agents Framework łączy się z Auto Drive API, aby stworzyć audytowalną infrastrukturę.