Napisane przez Zespół Qubic Scientific

Mózg jest dynamiczny i niebinarowy

Biologiczne sieci neuronowe nie działają jako przełącznik decyzyjny między aktywacją a odpoczynkiem. W systemach żywych bezczynność sama w sobie implikuje dynamizm. Absolutny „odpoczynek” byłby niezgodny z życiem. Jak widzieliśmy w pierwszym rozdziale, życie rozwija się w czasie.

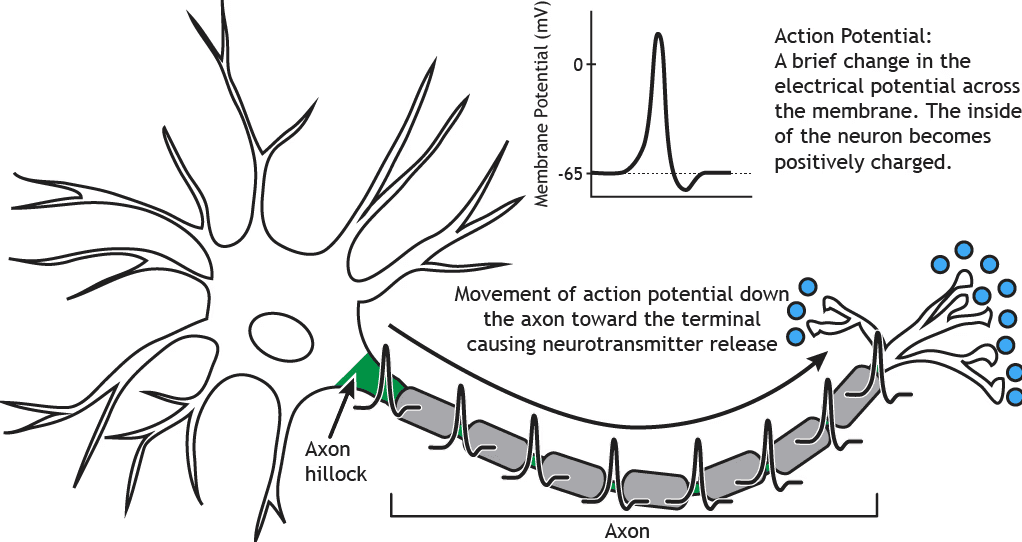

Pojedynczy neuron może wydawać się zdarzeniem wszystko albo nic, przesyłając prąd elektryczny do innego neuronu w celu jego zahamowania lub pobudzenia. Jednak przed tą transmisją, potencjał czynnościowy, neuron nieustannie odbiera pozytywne i negatywne sygnały w obszarze zwanym dendrytami. Jeśli globalna suma tych sygnałów przekracza określony próg, zachodzi fizyczna zmiana konformacyjna, a prąd elektryczny propaguje się wzdłuż aksonu w kierunku następnego neuronu. Przez większość czasu przetwarzanie neuronalne odbywa się poniżej progu działania, gdzie prądy pobudzające i hamujące są nieustannie integrowane.

W neuronauce obliczeniowej jest dobrze ustalone, że mózg jest ciągłym dynamicznym systemem, którego stany ewoluują nawet w przypadku braku bodźców zewnętrznych (Deco et al., 2009; Northoff, 2018).

Nie ma dyskretnych zdarzeń ani resetów w mózgu. Każdy bodziec zewnętrzny działa na żywy system, który już ma wcześniejszą konfigurację. Bodziec może wpływać na stan pobudzający lub hamujący, ale nigdy statyczny. To jak piłka na boisku piłkarskim: ta sama trajektoria wyzwala różne wyniki w zależności od dynamicznych pozycji graczy. Przy identycznej ścieżce gra może się nie udać lub stać się decydującym asystą.

Mechanizmy, które utrzymują neurony aktywne niezależnie od natychmiastowych bodźców, są dobrze znane.

Jednym z nich są wejścia podprogowe, które zmieniają potencjał błony bez generowania potencjału czynnościowego.

Inne obejmują ciche synapsy i spine dendrytyczne, które zachowują latentne połączenia między neuronami lub promują lokalną aktywację.

Najważniejszym mechanizmem są receptory metabotropowe powiązane z neuroprzekaźnikami, które organizują kontekst. Nie określają one bezpośrednio, czy potencjał czynnościowy jest wyzwalany. Zamiast tego definiują, co jest istotne, co przewiduje nagrodę, jaki poziom czujności lub niebezpieczeństwa jest obecny, ile nowości istnieje w systemie, jaki stopień utrzymywanej uwagi jest wymagany, jaka równowaga między eksploracją a eksploatacją jest odpowiednia, co powinno być kodowane, a co zapomniane, jak regulowany jest stan wewnętrzny, i kiedy kontrola impulsów lub stabilność czasowa jest korzystna.

Innymi słowy, receptory metabotropowe wdrażają formę mądrego metakontroli. Nie są danymi, ale parametrami! Funkcjonują jako dynamiczne zmienne, które dostosowują zachowanie systemu. Pozwalają systemowi stać się wrażliwym na funkcjonalne znaczenie sytuacji (nowość, istotność, nagroda lub zagrożenie) bez wymagania natychmiastowych reakcji.

Wracając do metafory piłkarskiej, receptory metabotropowe odpowiadają taktykom drużyny: decydowanie, kiedy atakować lub bronić, to znaczy decydowanie, jak gra jest prowadzona.

Z perspektywy obliczeniowej te mechanizmy działają poprzez stany pośrednie. Nie są one binarne (aktywne/nieaktywne). System działa w trzech trybach: pobudzającym, hamującym i stanie pośrednim, który nie produkuje natychmiastowego wyniku, ale moduluje przyszłą dynamikę.

Kiedy mówimy o ternarnym w biologicznych sieciach mózgowych, nie odnosimy się do matematycznej abstrakcji ani rachunku, ale do dosłownego opisu funkcjonalnego, jak mózg utrzymuje równowagę w czasie.

Z tego powodu neuronauka obliczeniowa nie bada przede wszystkim map wejścia-wyjścia, ale raczej jak stany reorganizują się w sposób ciągły. Te stany mają zasadniczo charakter predyktywny (Friston, 2010; Deco et al., 2009).

LLM-y są obliczeniami binarnymi.

W dużych modelach językowych koncepcja ternarności nie ma sensu. Uczenie się zasadniczo opiera się na propagacji błędów wstecz. To znaczy, że gdy tylko znana jest wielkość błędu w stosunku do oczekiwanych danych, algorytm optymalizacji dostosowuje parametry za pomocą sygnału zewnętrznego.

Jak to działa? Model produkuje wynik, na przykład prognozę najbardziej prawdopodobnego następnego słowa: „Paryż jest stolicą ...”. Jeśli odpowiedzią jest Finlandia, to jest ona porównywana z poprawnym słowem z zestawu treningowego (Francja). Z tej porównania obliczany jest błąd liczbowy. Ten błąd określa, jak daleko prognoza odbiega od wartości oczekiwanej. Następnie błąd jest przekształcany w gradient, a mianowicie sygnał matematyczny, który wskazuje, w jakim kierunku i o ile parametry modelu powinny być dostosowane, aby zredukować błąd. Wagi są aktualizowane wstecznie tylko po tym, jak wynik został wyprodukowany i oceniony.

Błąd jest obliczany a posteriori, wagi są dostosowywane tak, aby poprawna odpowiedź stała się Francją, a system wznawia działanie, jakby nic się nie stało.

W dużych modelach językowych separacja między dynamiką a uczeniem jest szczególnie wyraźna. Podczas wnioskowania parametry pozostają stałe; nie ma plastyczności online, habituacji, zmęczenia ani adaptacji czasowej. System nie zmienia się, będąc aktywnym.

W metaforze piłkarskiej LLM-y przypominają trenera, który przegląda błędy po meczu i dostosowuje taktykę na następny. Ale podczas samego meczu drużyna gra pełne dziewięćdziesiąt minut bez żadnej możliwości technicznej lub taktycznej modyfikacji!

Jest strategia przedmeczowa i korekta po meczu, ale nie ma dynamiki podczas gry!

LLM-y nie są zatem ternarne w sensie funkcjonalnym. Są to macierze „uwagi” (transformery) trenowane offline (Vaswani et al., 2017). To nie jest ograniczenie ilościowe, ale ontologiczna różnica.

Dynamika ternarna Neuraxon i Aigarth

Neuraxon wprowadza zasadniczo inny framework. Jego podstawową jednostką nie jest funkcja wejścia-wyjścia, jak w LLM-ach, ale wewnętrzny ciągły stan, który ewoluuje w czasie. W Neuraxon pobudzenie reprezentowane jest jako +1, hamowanie jako −1, a pomiędzy tymi dwoma stanami istnieje neutralny zakres reprezentowany przez 0.

W każdej chwili system integruje wpływ bieżących wejść, niedawnej historii i wewnętrznych mechanizmów, aby wygenerować dyskretny wynik trynarny (pobudzenie, hamowanie lub neutralność).

Relacja między czasem a ternarnym jest centralna. Stan neutralny nie oznacza braku obliczeń ani bezczynności, ale fazę podprogowa, w której system gromadzi wpływ bez generowania natychmiastowego wyniku. Jest to porównywalne do dynamicznego przesunięcia taktycznego w drużynie piłkarskiej, niezależnie od tego, czy prowadzi to do gola, czy przeciwko.

Aigarth wyraża tę samą logikę na poziomie strukturalnym. Nie tylko same jednostki są ternarne, ale sieć może rosnąć, reorganizować się lub załamywać w zależności od swojej użyteczności, wprowadzając wymiar ewolucyjny, który wzmacnia ciągłą adaptację. Kombinacja Neuraxon–Aigarth (mikro-makro) daje początek tkankom obliczeniowym zdolnym do pozostawania aktywnymi (jednostki tkankowe inteligencji), co jest niemożliwe w architekturach opartych wyłącznie na propagacji wstecznej.

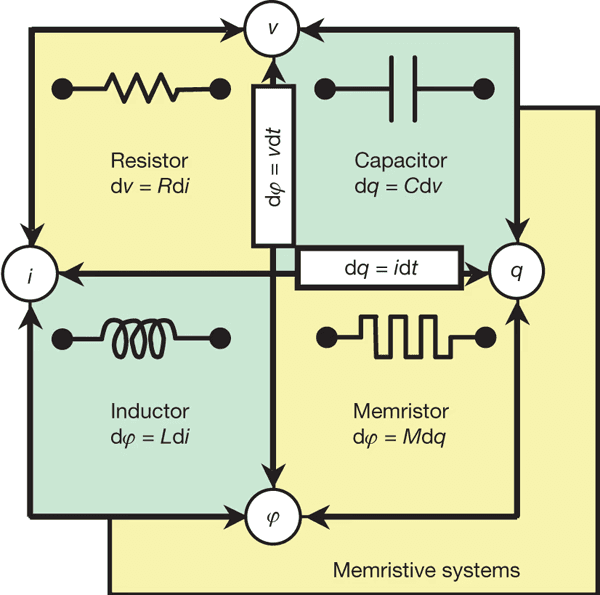

Pytanie o sprzęt nie może być ignorowane. Obecnie nie ma uniwersalnego sprzętu ternarnego, ale istnieją aktywne linie badawcze w logice ternarnej, w tym memristory wielowartościowe i obliczenia neuromorficzne oparte na urządzeniach rezystancyjnych lub spintronikach (Yang et al., 2013; Indiveri & Liu, 2015). Te podejścia mają na celu redukcję zużycia energii i, co ważniejsze, osiągnięcie obliczeń ternarnych zgodnych z fizycznymi, żywymi i ciągłymi dynamikami.

Czy architektura ternarna ma sens nawet bez dedykowanego sprzętu ternarnego? Mimo tego ograniczenia, ma, ponieważ architektura poprzedza fizyczny substrat. Projektując systemy ternarne, ujawniamy niezdolność logiki binarnej do odzwierciedlenia dynamicznego świata. Jednocześnie architektury ternarne, takie jak Neuraxon–Aigarth, mogą już przynosić poprawę na istniejącym sprzęcie binarnym, redukując niepotrzebną aktywność.

Bibliografia

Deco, G., Jirsa, V. K., Robinson, P. A., Breakspear, M., & Friston, K. J. (2009). Dynamiczny mózg: Od neuronów wyładowujących do mas neuronowych i pól kortykalnych. PLoS Computational Biology, 5(8), e1000092.

Friston, K. (2010). Zasada wolnej energii: zjednoczona teoria mózgu? Nature Reviews Neuroscience, 11(2), 127–138.

Indiveri, G., & Liu, S.-C. (2015). Pamięć i przetwarzanie informacji w systemach neuromorficznych. Proceedings of the IEEE, 103(8), 1379–1397.

Northoff, G. (2018). Spontaniczny mózg: Od problemu umysł-ciało do neurofenomenologii. MIT Press.

Vaswani, A., Shazeer, N., Parmar, N., et al. (2017). Uwaga to wszystko, czego potrzebujesz. Advances in Neural Information Processing Systems, 30.

Yang, J. J., Strukov, D. B., & Stewart, D. R. (2013). Urządzenia memristywne do obliczeń. Nature Nanotechnology, 8(1), 13–24.