Im więcej używam narzędzi AI w prawdziwych procesach decyzyjnych, tym mniej jestem pod wrażeniem, jak gładko brzmią. Płynność nie jest już rzadkością. To, co pozostaje rzadkie, to pewność.

Nowoczesna AI potrafi pisać przekonująco, podsumowywać efektywnie i konstruować logiczne argumenty. Ale czy pozwoliłbyś jej wykonać coś nieodwracalnego bez przeglądu? Większość ludzi się waha. To wahanie odzwierciedla głębszy problem strukturalny.

Modele AI generują probabilistyczne wyniki. Przewidują wzorce; nie weryfikują inherentnie prawdy. Gdy występują błędy, często wydają się pewne. To nie jest drobna wada interfejsu — to ograniczenie architektury.

Kiedy badałem sieć Mira, to, co się wyróżniało, to nie próba zbudowania potężniejszego modelu językowego. Zamiast tego, nacisk kładziony jest na weryfikację. Mira pozycjonuje się jako zdecentralizowana warstwa, która ocenia wyniki AI, zanim zaufanie zostanie przyjęte.

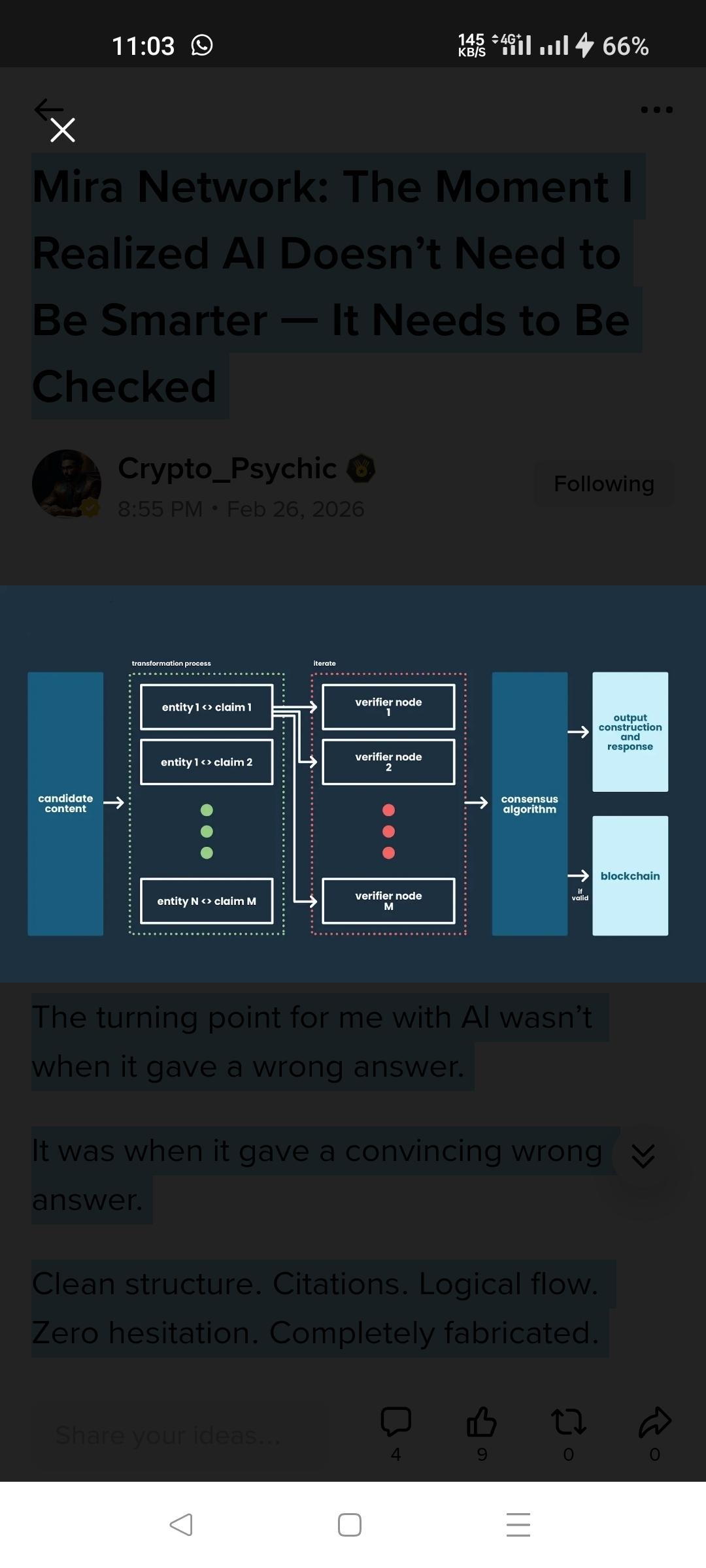

Zamiast traktować odpowiedź AI jako jedną niepodzielną odpowiedź, system dzieli ją na mniejsze roszczenia. Te roszczenia są następnie oceniane przez rozproszonych walidatorów. Mechanizmy konsensusu i zachęty ekonomiczne są używane do koordynowania wyników walidacji.

To zmienia model zaufania. Zamiast polegać na autorytecie pojedynczego dostawcy, walidacja staje się rozproszona i zbieżna z interesami. Walidatorzy mają zachęty do dokładnego oceny roszczeń, ponieważ wyniki wpływają na nich ekonomicznie.

To rozróżnienie staje się ważne, gdy systemy AI zmierzają w kierunku większej autonomii. W kontekstach takich jak analiza finansowa, procesy robocze w przedsiębiorstwie czy zautomatyzowane systemy wykonawcze, „w większości dokładne” może nie wystarczyć. Wyniki mogą wymagać, aby były kwestionowalne i audytowalne.

Projekt Mira sugeruje, że halucynacje nie znikną całkowicie — i zamiast tego buduje mechanizmy wokół weryfikacji. To podejście wydaje się pragmatyczne, a nie idealistyczne.

Istnieją otwarte pytania. Granularność roszczeń, zbieżność walidatorów i zachęty do koordynacji to złożone wyzwania projektowe. Systemy rozproszone rzadko są proste. Ale podstawowa teza jest jasna: inteligencja sama w sobie nie gwarantuje niezawodności.

W miarę jak AI staje się coraz bardziej zintegrowane w systemach krytycznych, infrastruktura odpowiedzialności może stać się coraz ważniejsza.

Mira bada tę warstwę.

Nie poprzez obiecywanie doskonałej inteligencji — ale poprzez skupienie się na weryfikowalnym zaufaniu.

@Mira - Trust Layer of AI #mira $MIRA