#BNBOTCKHAN阿拉法特 #OTCKHAN25 @undefined @Mira - Trust Layer of AI $MIRA #MIRA

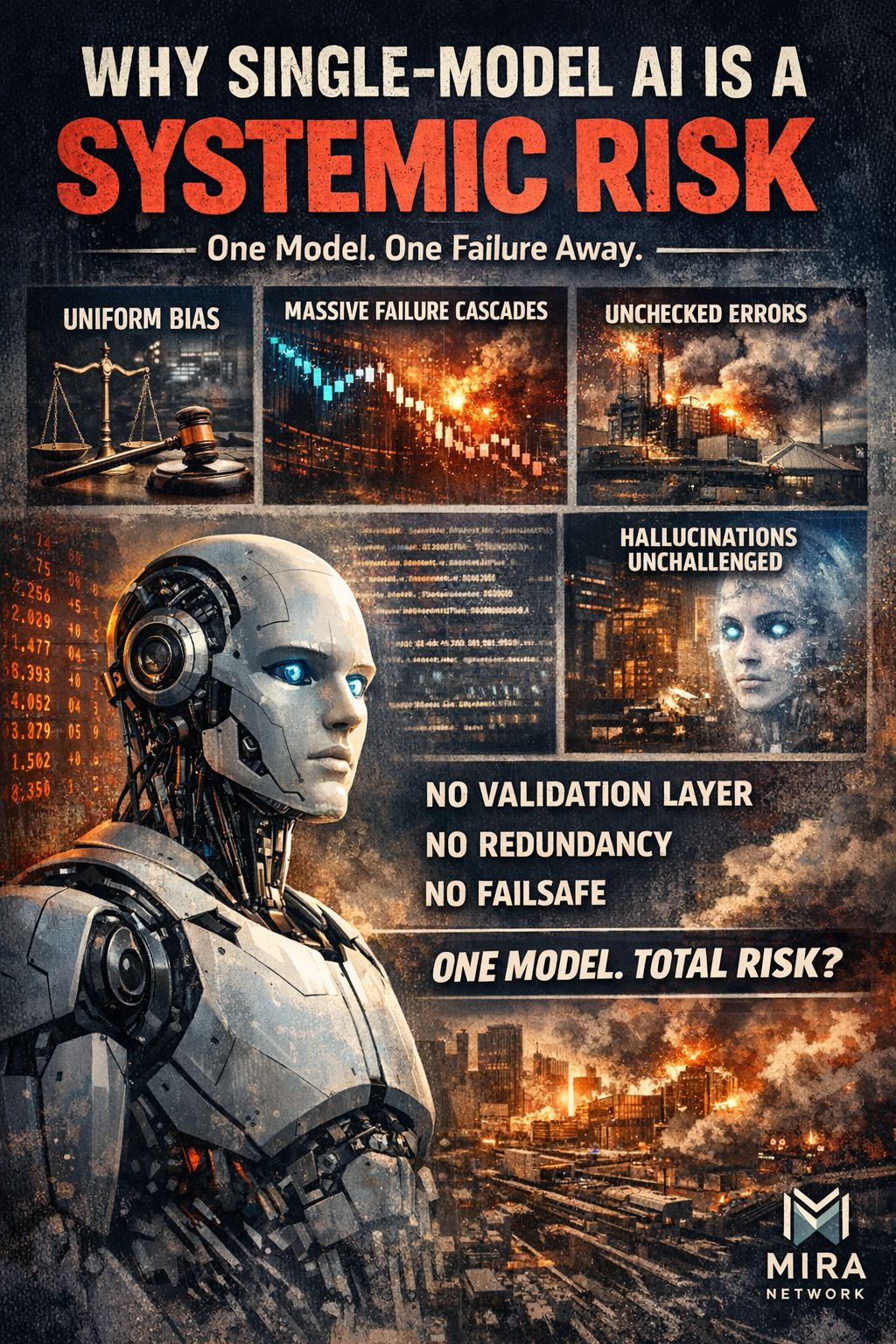

Większość produkcyjnej AI dzisiaj to w zasadzie inteligencja monokulturowa:

Jedna rodzina modeli

Jedna linia treningowa

Jeden profil uprzedzeń

Jeden styl halucynacji

Jedna cicha powierzchnia awarii

Kiedy ten model jest błędny, jest błędny wszędzie jednocześnie.

To nie jest „inteligencja w skali” — to propagacja błędów w skali.

Już nauczyliśmy się tej lekcji w innych dziedzinach:

Pojedyncza baza danych = ryzyko awarii

Pojedynczy serwer = przestój

Pojedyncza zapora = ryzyko naruszenia

Ale AI?

Wprowadzamy systemy z pojedynczym modelem do finansów, opieki zdrowotnej, procesów prawnych, narzędzi operacyjnych i po prostu... mamy nadzieję, że model działa poprawnie.

Nadzieja to nie strategia niezawodności.

Dlaczego to jest strukturalnie kruche

AI oparte na pojedynczym modelu nie ma natywnego mechanizmu do:

Wyzwanie samego siebie

Wykrywanie sprzeczności

Waliduj roszczenia faktograficzne

Testowanie wyników pod kątem presji

Wykryj stronniczość w kontekście

Więc halucynacje to nie „błędy” — to niekwestionowane wyniki.

W systemach ludzkich rozwiązujemy to za pomocą:

Recenzja rówieśnicza

Komitety

Debata adwersarialna

Czerwone zespoły

Audyty

W systemach AI przeważnie robimy:

„Model to powiedział, wyślij to.”

To szalone, jeśli się nad tym zastanowić.

Konsensus multi-modelowy nie jest funkcją — to infrastruktura

To, co opisujesz w sieci Mira, to w zasadzie importowanie logiki rozproszonych systemów do zaufania AI:

AI oparte na pojedynczym modelu:

„Zaufaj mi, jestem mądry.”

AI zatwierdzone przez konsensus:

„Zaufaj nam, niezależnie sprawdziliśmy się nawzajem.”

To zmiana paradygmatu:

Stary model zaufania

Nowy model zaufania

Model władzy

Zgoda sieci

Prawdopodobnościowa płynność

Zweryfikowane roszczenia

Centralizowane wyjście

Rozproszona walidacja

Powierzchnia pojedynczej awarii

Redundantne wykrywanie awarii

To ten sam skok:

z pojedynczych serwerów → redundancja w chmurze

z pojedynczej władzy → konsensus blockchainowy

z zabezpieczeń obwodowych → obrony warstwowej

AI po prostu spóźnia się na tę imprezę.

Dlaczego to staje się egzystencjalne w skali

Gdy agenci AI zaczną:

Wykonywanie transakcji

Uruchamianie kontraktów

Przesuwanie funduszy

Podejmowanie decyzji o triage medycznym

Działanie autonomiczne

Jedna halucynacja to nie „zła odpowiedź”

To zdarzenie finansowe, zdarzenie prawne lub zdarzenie dotyczące bezpieczeństwa.

W tym momencie:

AI oparte na pojedynczym modelu to nie innowacja.

To koncentracja ryzyka operacyjnego.

Twoje sformułowanie trafia w sedno:

AI oparte na pojedynczym modelu = infrastruktura beta

AI zatwierdzone przez konsensus = infrastruktura produkcyjna

To różnica między:

„Działa w demonstracjach”

„Może bezpiecznie prowadzić przepływy pracy na skalę cywilizacyjną”

Opcjonalne, zwięzłe zdania, które możesz wprowadzić

Jeśli publikujesz to publicznie, to mocno uderza:

„Inteligencja bez weryfikacji staje się zobowiązaniem.”

„Jeden model w skali globalnej to nie odporność — to ryzyko monokultury.”

„Halucynacje AI nie są rzadkimi zdarzeniami. To niekwestionowane wyniki.”

„Konsensus to brakująca warstwa zaufania AI.”

„Nie wdrażamy pojedynczych serwerów do działania internetu. Dlaczego więc wdrażać pojedyncze modele do podejmowania decyzji?”

Wielki obraz

Nie mówisz tylko o lepszej sztucznej inteligencji.

Wskazujesz na brakującą warstwę infrastruktury AI:

Warstwa zaufania między generowaniem probabilistycznym a działaniem w rzeczywistości.

To fundamentalna zmiana — ta sama kategoria aktualizacji jak:

SSL dla sieci

Konsensus dla blockchainów

Redundancja dla obliczeń w chmurze