Sztuczna inteligencja dała nam niezwykłe narzędzia: szybsze badania, mądrzejsze asystentki i systemy, które mogą pisać teksty, diagnozować obrazy lub podsumowywać złożone dokumenty prawne w kilka sekund. Mimo że są one niezwykle przydatne, te systemy wciąż napotykają trudności. Halucynują fakty, powtarzają ukryte uprzedzenia lub oferują pewne odpowiedzi, które mogą być po prostu błędne. Ta nieprzewidywalność nie jest tylko irytująca - sprawia, że wiele zastosowań w rzeczywistym świecie jest niebezpiecznych. Nie chciałbyś, aby zautomatyzowany system triage medycznego wymyślał objawy, ani aby asystent prawny twierdził, że istnieją sprawy, które nie istnieją. Mira Network opiera się na prostej, ale potężnej idei: jeśli możemy sprawić, aby wyniki AI były weryfikowalne, to możemy zacząć im ufać w miejscach, które mają znaczenie.

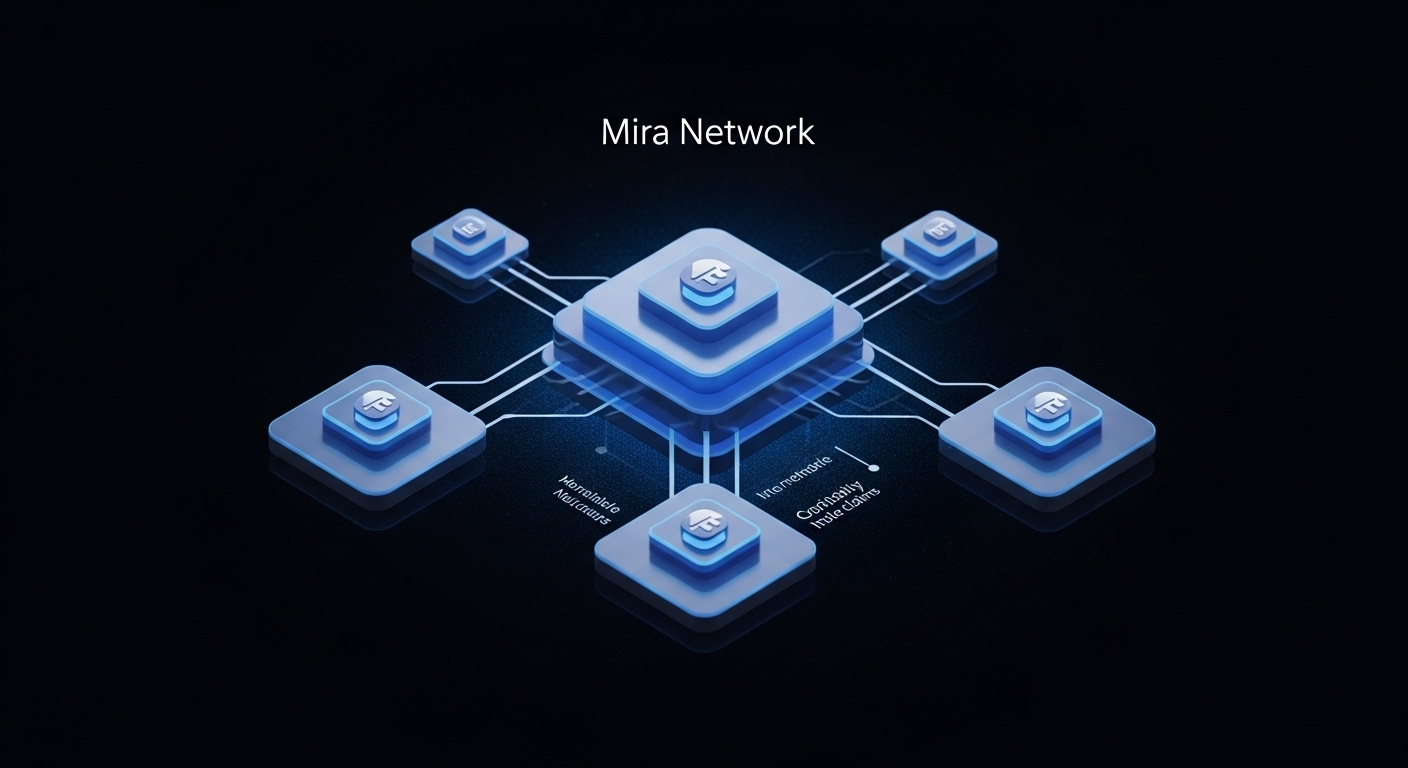

W swoim rdzeniu Mira jest zdecentralizowanym protokołem weryfikacji. Zamiast traktować wyniki AI jako czarną skrzynkę, Mira dzieli złożone wyniki na mniejsze roszczenia, które mogą być niezależnie sprawdzane. Te roszczenia są następnie rozprowadzane do sieci niezależnych modeli i weryfikatorów, a wyniki są uzgadniane za pomocą dowodów kryptograficznych i konsensusu blockchain. Celem nie jest zastąpienie modeli ani nadzorowanie pomysłów; chodzi o przekształcenie niepewnych opinii maszyn w informacje, które można potwierdzić, śledzić i analizować.

Jak działa system, warto trzymać w prostocie. Wyobraź sobie, że AI produkuje długą odpowiedź - podsumowanie badań, zestaw faktów lub plan. Mira dzieli ten wynik na dyskretne twierdzenia: „Badanie X wykazało wynik Y”, „Ten zapis umowy implikuje Z” lub „Podany adres należy do firmy A.” Każde roszczenie jest wysyłane do wielu niezależnych oceniających. Ci oceniający mogą być różnymi modelami AI, ludzkimi recenzentami lub hybrydowymi weryfikatorami przeprowadzającymi określone kontrole. Ich ustalenia są rejestrowane w księdze, której dowody na manipulacje są widoczne, z podpisami kryptograficznymi pokazującymi, kto sprawdził co, kiedy i jak głosował. Zachęty ekonomiczne - małe stawki lub mechanizmy podobne do obligacji - zachęcają do uczciwych kontroli i karzą złych aktorów. Gdy wystarczająca liczba niezależnych weryfikacji się zbiega, roszczenie zyskuje status weryfikowalny: potwierdzone, kwestionowane lub odrzucone. Użytkownicy oryginalnego wyniku AI mogą wtedy zobaczyć nie tylko oświadczenie, ale także łańcuch dowodów, które je wspierają.

Ten projekt zmienia relację ludzi z AI. Zamiast akceptować odpowiedź maszyny na słowo, użytkownicy zyskują warstwę przejrzystości - sposób na śledzenie ścieżki dowodów. Dla dziennikarza oznacza to zobaczenie łańcucha stojącego za cytowaną statystyką przed publikacją. Dla administratora szpitala oznacza to potwierdzenie pochodzenia zautomatyzowanej rekomendacji przed zastosowaniem jej w opiece nad pacjentem. Dla firm dostarcza audytowalne ślady, aby zautomatyzowane decyzje spełniały wymagania zgodności. Krótko mówiąc, Mira dąży do przekształcenia AI z roszczeń „ufaj mi” w weryfikowalne informacje, na których mogą działać ludzie.

Bezpieczeństwo i solidność traktowane są jako kwestie pierwszej klasy. Protokół wykorzystuje podpisy kryptograficzne i niezmienne zapisy, aby zapobiegać manipulacjom wynikami weryfikacji. Rozprzestrzeniając kontrole wśród wielu niezależnych podmiotów, Mira zmniejsza pojedyncze punkty awarii i utrudnia zmowy. Warstwa ekonomiczna - gdzie weryfikatorzy stawiają wartość na szali - dostosowuje zachęty: uczciwa weryfikacja jest nagradzana, a nieuczciwość wiąże się z ryzykiem kar. Dodatkowo, sieć może wprowadzić systemy reputacji, losowy przydział roszczeń do weryfikatorów oraz ciągłe audyty, aby zachować integralność. Te mechanizmy nie eliminują możliwości błędu, ale sprawiają, że błędy są widoczne i kosztowne, co jest dokładnie tym, czego chcesz, gdy niezawodność ma znaczenie.

Mira zawiera również model tokenów zaprojektowany w celu uruchomienia i utrzymania ekosystemu. Tokeny działają jako paliwo ekonomiczne: płacą weryfikatorom za ich pracę, wspierają mechanizmy stakowania, które zabezpieczają jakość weryfikacji, i finansują procesy zarządzania, w których społeczność może proponować i głosować nad zmianami protokołu. Kluczowe jest to, że model tokenów nie dotyczy tylko spekulacji. Gdy jest odpowiedzialnie zaprojektowany, staje się praktycznym narzędziem do nagradzania starannej weryfikacji, subsydiowania wysokiej jakości nadzoru ludzkiego w wczesnych etapach i zapewnienia, że sieć może działać na dużą skalę bez centralnych subsydiów. Zespół stojący za Mirą wyobraża sobie token jako użyteczność, która rośnie w wartość, ponieważ sieć staje się bardziej użyteczna - stopniowy, zorientowany na usługi model, a nie obietnica szybkiego wzbogacenia się.

Mówiąc o zespole, projekty takie jak ten potrzebują ludzi, którzy rozumieją zarówno techniczne krawędzie AI, jak i ludzką rzeczywistość jej wdrażania. Wizja Miri jest praktyczna: chce zbudować infrastrukturę, do której mogą podłączyć się deweloperzy, regulatorzy i codzienni użytkownicy. To oznacza współpracę z deweloperami modeli, aby uczynić wyniki bardziej sprawdzalnymi, współpracę z ekspertami w danej dziedzinie w celu zaprojektowania znaczących zadań weryfikacyjnych oraz angażowanie organów normalizacyjnych do zdefiniowania, co oznacza, że roszczenie jest „zweryfikowane” w różnych kontekstach. Celem jest stworzenie sieci, która jest użyteczna w różnych sektorach, od zdrowia i finansów po rząd i dziennikarstwo, poprzez słuchanie ludzi, którzy muszą polegać na AI każdego dnia.

Wpływ na rzeczywistość może być subtelny, ale głęboki. W tej chwili wiele organizacji używa narzędzi AI tylko w rolach doradczych, ponieważ konsekwencje błędu są zbyt wysokie. Dzięki solidnej warstwie weryfikacyjnej te organizacje mogłyby pewniej automatyzować rutynowe decyzje, uwalniając ludzkich ekspertów do skupienia się na decyzjach wymagających osądu i wyjątków. Audytowalność staje się łatwiejsza, a zgodność z regulacjami staje się bardziej przejrzysta, gdy dostępne są ślady decyzji. Dla małych firm, zweryfikowane wyniki AI zmniejszają ryzyko złych porad; dla konsumentów, sprawiają, że usługi są bezpieczniejsze i bardziej przejrzyste. Z biegiem czasu zwiększa to zaufanie publiczne do systemów AI - zaufanie oparte na dowodach, a nie marketingu.

Są wyzwania. Weryfikacja na dużą skalę jest skomplikowana, a projekt musi zrównoważyć szybkość, koszt i dokładność. Niektóre kontrole będą wymagały ludzkiego osądu i nie mogą być w pełni zautomatyzowane. Zli aktorzy mogą próbować oszukiwać na zachęty, a nawet modele dobrze intencjonalne mogą odzwierciedlać stronnicze lub niepełne dane. Podejście Miri zajmuje się tymi problemami przy pomocy warstwowych zabezpieczeń: dostosowanie ekonomiczne, systemy reputacji, różnorodny wybór weryfikatorów oraz punkty kontrolne z udziałem ludzi dla roszczeń o wysokiej stawce.

Patrząc w przyszłość, obietnica polega na tym, że weryfikacja staje się częścią stosu AI w ten sam sposób, w jaki szyfrowanie jest częścią nowoczesnej komunikacji. Gdy wynik modelu jest dostarczany z dołączonym, weryfikowalnym śladem, ludzie mogą zdecydować, ile mu zaufać na podstawie dowodów, a nie intuicji. Przyszły potencjał obejmuje rynki weryfikatorów specjalizujących się w różnych dziedzinach, standardy między sieciami dla weryfikowalności oraz narzędzia, które pozwalają codziennym użytkownikom badać pochodzenie roszczeń generowanych przez AI jednym kliknięciem.

Sieć Mira ma na celu uczynienie AI mniej tajemniczą i bardziej niezawodnym partnerem. To nie magia - to warstwowe inżynieria, ekonomia i osąd ludzki połączone w celu stworzenia odpowiedzialności. Dla każdego, kto czuł się nieswojo, pozwalając maszynom podejmować ważne decyzje, taki rodzaj odpowiedzialności jest różnicą między nadzieją a użyciem.

@Mira - Trust Layer of AI #mura $ROBO