凌晨三点复盘完美股,看着英伟达和几家头部 AI 科技股的走势,我越发印证了上周在私域群里的判断:传统大模型的算力博弈已经进入深水区,华尔街的聪明资金正在疯狂寻找下一个蓄水池。资金的下一个落脚点必定是“AI 的物理延伸”——即 DePIN 与通用机器人赛道。

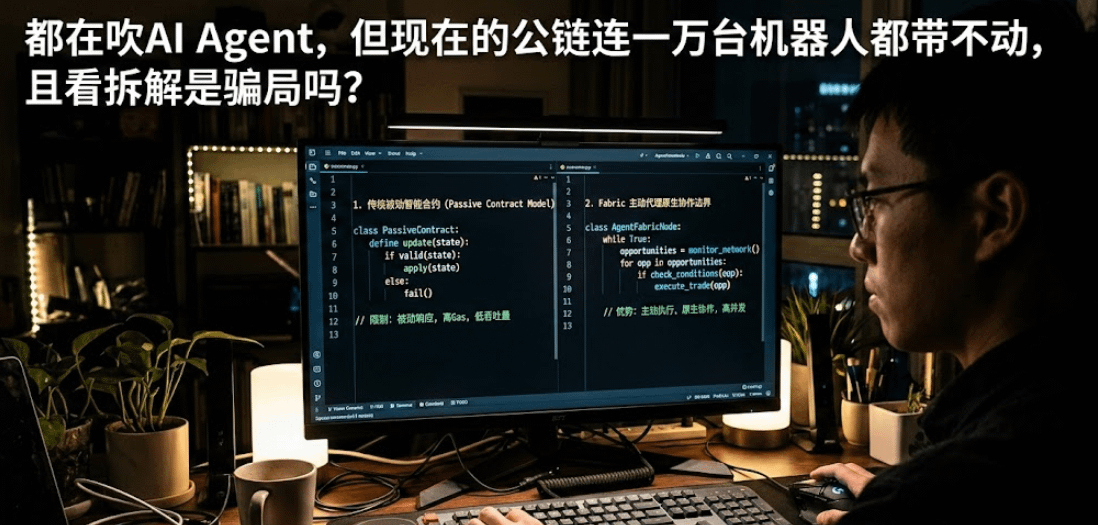

这两天加密市场都在疯狂炒作 AI Agent 和具身智能,连做个 Tg自动回复机器人的土狗项目都敢跳出来喊自己是“Web3的物理延伸”。说实话,作为平时经常自己写量化脚本、盯着链上数据找 #ALPHA 的人,我看这些宏大叙事觉得挺扯的,甚至有点滑稽。

别看资金炒得热闹,大家似乎都刻意忽略了一个最致命的技术常识:现有的 EVM 公链,根本带不动真正的物理机器人网络。#ROBO

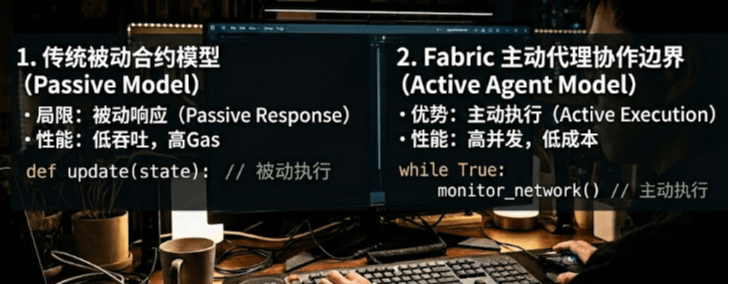

很多人没搞明白一个底层逻辑,传统智能合约是给“人”设计的,不是给“机器”设计的。你让一个连高峰期打个新 Meme 都会拥堵、Gas费动辄十几刀的传统智能合约,去承载未来几万、几十万台物理机器人的高频自主交互?这不叫基础设施,这叫玩具。 @Fabric Foundation

传统智能合约的执行逻辑是“被动状态机”。你拿钱包去签名,它才动一下。但机器人所处的真实物理世界是极其复杂且多变的,它们需要毫秒级的环境感知、持续计算和主动发起交互。你让一台送货机器人每次遇到障碍物重新规划路线时,还要等你人类点个授权确认 Gas?或者让机器人自己每秒钟发起十次链上交易去同步状态?这就好比给一辆 F1 赛车装上了蒸汽机的引擎。

这也是我最近一直在深度拆解 Fabric Protocol 白皮书和 Github 代码库的原因。它最吸引我的,绝对不是什么“机器人发币”的噱头,而是它在底层架构上做了一件极其苦逼、极其耗时,但如果不做整个赛道就永远停留在概念阶段的事:代理原生架构和 OM1 操作系统。

通俗点说,市面上各种四足狗、机械臂、家用服务机器人,用的都是自家闭源的单机系统,互相之间是彻底的数据孤岛。苹果的设备连不上安卓的生态,这就导致机器人无法形成网络效应。Fabric 搞的这个 OM1 开源系统,相当于给这些杂牌军强行刷入了一个统一的“Web3 安卓底包”。不管你是 Unitree 还是 AGIBot,只要接入这个系统,机器人就不再是简单的执行器,而是变成了链上的一个独立、可信、能自主交流的节点。

但这里立刻就衍生出一个让所有 Web3 开发者头疼的核心问题:也就是物理世界的“预言机难题”。我怎么知道你的机器人是真的在物理世界干了活,还是你用几行代码在服务器上刷假数据骗奖励?

这就是 Fabric 引入“真实工作量证明”和专属链上身份,类似 ERC-7777的根本原因。机器人在物理世界每完成一次搬运、清扫或者复杂协同,它的传感器数据必须通过边缘计算节点进行签名,然后加密上链进行密码学维度的交叉验证。只有验证通过了,智能合约才会把 $ROBO 当作薪水,自动打给这个机器节点所在的专属钱包。

为了验证这个逻辑的链上消耗,我昨天下午顺手写了一段 Python 脚本,跑了一个极简的压力测试模型。大家可以看看这段模拟 PoRW 验证和流动性消耗的逻辑:

Python

# Fabric (ROBO) 早期网络流动性枯竭与 PoRW 压力测试模型

import random

class FabricNetworkSimulation:

def init(self, initial_supply_rate=0.005, max_supply=10000000000):

# 初始流通量仅为 0.5%,这是极其可怕的强控盘结构

self.circulating_supply = max_supply * initial_supply_rate

self.daily_network_gas_burnt = 0

self.staked_robo = 0

def simulate_porw_validation(self, active_robots, tasks_per_robot):

# 模拟真实工作量证明(PoRW)的验证消耗

daily_transactions = active_robots * tasks_per_robot

print(f"当前网络活跃机器人: {active_robots} 台, 每日产生物理动作交互: {daily_transactions} 次")

# 假设每次有效的物理任务验证需要消耗/质押 0.1 ROBO

base_cost_per_tx = 0.1

total_daily_cost = daily_transactions * base_cost_per_tx

self.daily_network_gas_burnt += (total_daily_cost * 0.2) # 假设20%燃烧或回购

self.staked_robo += (total_daily_cost * 0.8) # 80%流入节点质押池

liquidity_squeeze_index = (self.staked_robo + self.daily_network_gas_burnt) / self.circulating_supply

return liquidity_squeeze_index

# 假设 2026 年中,有 5 万台机器人接入 OM1 操作系统

fabric_net = FabricNetworkSimulation()

days_to_simulate = 30

active_bots = 50000

for day in range(1, days_to_simulate + 1):

# 假设每台机器人每天只发生 20 次关键的高价值协同验证

squeeze_index = fabric_net.simulate_porw_validation(active_bots, 20)

if squeeze_index > 0.6:

print(f"第 {day} 天警告:全网流通筹码极度干涸!Squeeze Index 突破 60%!")

break

# 模拟网络自然增长

active_bots = int(active_bots * 1.05)

跑完这个极其粗糙的模型,其实结论已经呼之欲出了。我们聊回盘面和最现实的交易逻辑。

很多人盯着 $ROBO 的百亿总供应量,又看着币安广场 CreatorPad 奖池里那 8,600,000 ROBO 的活动奖励,开始算计短期抛压。但我作为一个只看长期流动性的交易员,我更看重的是它的消耗模型与通缩飞轮。

在这个生态里,$ROBO 对不是那种只会拿来投票、形同虚设的空气治理币,它是驱动整个网络的刚需燃料。算力租赁、节点质押、技能调用、甚至是机器人跨设备的数据购买,全都要消耗它。再配合官方明确的极低初始流通量(0.5%),这在项目的早期极容易形成流动性真空。

一旦有几万台机器人真实的接入了网络,开始高频地产生 PoRW 验证需求,市场上的流通筹码会被瞬间吸干进入质押池。这种由真实物理需求驱动的“流动性枯竭(Liquidity Squeeze)”,比任何纯粹依靠金融旁氏拉盘的模型都要坚固。

不过,既然是理性的深度复盘,我还是要给大家泼一盆冷水。这种底层协议的建设周期是按年算的,绝对不是两三天就能拉爆的土狗 Meme 币。大家要明白一个极其残酷的现实:目前项目跑在 Base 链上,作为早期的验证当然没问题。但如果未来真的如白皮书所愿,有百万级的机器人接入,如此高频的 Agent-Native 并发请求,绝对会把现有的 Layer 2 序列器(Sequencer)打宕机。Gas 费的飙升会直接摧毁机器人的协作经济学。

所以,Fabric 路线图里规划的“机器人专属高性能 Layer 1”能不能如期落地,底层共识机制能否真正解决极低延迟和超高并发的矛盾,才是决定这个项目最终估值上限的胜负手。在专属 L1 出来之前,它依然面临着极大的工程学挑战。你在享受早期极低流通带来的赔率红利时,也要随时把手放在刹车上,盯紧官方硬件接入的速度和真实链上算力的增长。风控永远是第一位的。

最后,留个技术深水区的探讨题给看得懂的朋友:在 Fabric 自己的专属 L1 出来之前,各位觉得目前市面上哪条高性能公链(比如最近很火的 Monad 或是其他并行的 EVM 方案),能真正扛得住这种百万级 Agent-Native 物理节点的并发压力?

懂底层架构和代币经济学的老哥,评论区碰一碰,我们互相印证。