W ciszy zachodzi głęboko ludzki moment, moment, w którym sztuczna inteligencja udziela odpowiedzi, która brzmi bezbłędnie, wypolerowana i absolutna, a jednak coś wewnątrz słuchacza napina się z niepokojem, ponieważ sama pewność nie równa się prawdzie, a instynkt to wie. Ten cichy dyskomfort nie wynika z ignorancji, ale z doświadczenia, zrozumienia, że pojedyncze niepoprawne zdanie może wprowadzić w błąd decyzje, kształtować przekonania lub cicho niszczyć życie, a to właśnie w tej delikatnej przestrzeni emocjonalnej Mira Network odnajduje swoje znaczenie, nie jako kolejny system techniczny, ale jako odpowiedź na rosnący zbiorowy niepokój związany z zaufaniem do maszyn, które nigdy nie wahają się, nawet gdy się mylą.

Nowoczesna sztuczna inteligencja często zachowuje się jak przekonywujący narrator, który mówi bez wątpliwości, łącząc dokładne spostrzeżenia i wymyślone szczegóły tak płynnie, że nawet eksperci mogą mieć trudności z odróżnieniem, gdzie kończy się prawda, a zaczyna przypuszczenie. I chociaż może to wydawać się nieszkodliwe w codziennym użyciu, staje się głęboko niepokojące, gdy AI zaczyna wpływać na medycynę, prawo, finanse, rządzenie i osobiste wybory. Obawa nie polega na tym, że AI jest potężna, ale że jest potężna bez odpowiedzialności, zdolna do produkcji przekonujących dezinformacji, nie zdając sobie sprawy z wagi własnych słów. Mira zaczyna od zaakceptowania tej niewygodnej rzeczywistości, wybierając, by nie gonić za iluzją perfekcyjnego modelu, lecz zamiast tego przyjmując znacznie bardziej uczciwe podejście: prawda nigdy nie powinna zależeć od pojedynczego głosu, bez względu na to, jak inteligentny wydaje się ten głos.

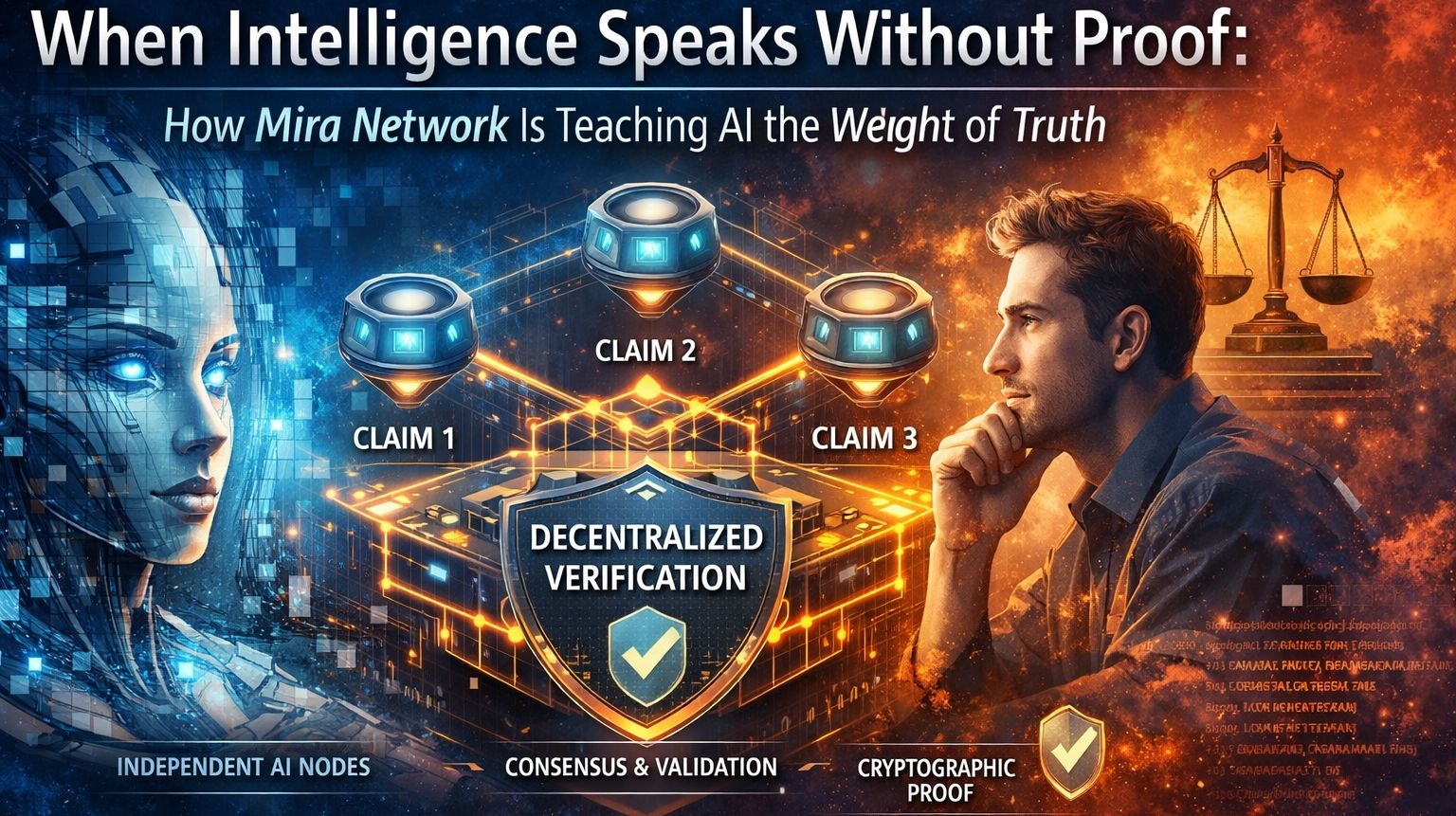

Gdy informacje przepływają przez Mirę, nie są akceptowane na pierwszy rzut oka ani traktowane jako ostateczne; są starannie rozpakowywane, dzielone na poszczególne twierdzenia, które można badać, kwestionować i podważać, tak jak zrobiłby to staranny człowiek, gdy coś jest naprawdę ważne. Każde twierdzenie jest następnie uwalniane do zdecentralizowanej sieci niezależnych weryfikatorów AI, zbudowanych w różny sposób, szkolonych w różny sposób i zmotywowanych do myślenia krytycznego zamiast ślepego zgadzania się. W tej strukturze jest coś głęboko ludzkiego, ponieważ odzwierciedla sposób, w jaki zaufanie zawsze było budowane w społeczeństwie, poprzez różne perspektywy, wspólną odpowiedzialność oraz ciche zapewnienie, że prawda jest silniejsza, gdy przetrwa badanie.

To, co wyłania się z tego procesu, to nie pośpieszna pewność, lecz zasłużona pewność, ponieważ zgoda osiągana jest tylko wtedy, gdy silna większość niezależnie dochodzi do tego samego wniosku, a ta zgoda jest przypieczętowana kryptograficznym dowodem, który nie może być cicho zmieniany ani ukrywany. Co równie ważne, gdy konsensus nie może być osiągnięty, niepewność nie jest maskowana wysublimowanym językiem ani sztuczną pewnością; wątpliwość jest otwarcie ujawniana, pozwalając ludziom zobaczyć, gdzie kończy się wiedza, a zaczyna niejasność. W cyfrowym świecie uzależnionym od natychmiastowych odpowiedzi, ta odmowa udawania wydaje się niemal radykalna, ponieważ szanuje ludzkie prawo do wiedzenia nie tylko tego, co jest prawdziwe, ale również tego, co wciąż jest nieznane.

Pod tym poziomem weryfikacji kryje się system ekonomiczny, który subtelnie, ale potężnie wzmacnia integralność, nagradzając tych, którzy weryfikują uczciwie, i karząc tych, którzy próbują manipulować wynikami, zapewniając, że prawda nie jest chroniona jedynie przez ideały, ale przez namacalne konsekwencje. To dostosowanie zachęt przekształca weryfikację z teoretycznego celu w żywą odpowiedzialność, gdzie dokładność staje się cenna, a nieuczciwość staje się kosztowna, odzwierciedlając prostą ludzką prawdę, że zachowanie podąża za odpowiedzialnością.

To, co ostatecznie sprawia, że to podejście wydaje się inne, to emocjonalna zmiana, jaką tworzy między ludźmi a maszynami, ponieważ nie prosi użytkowników o rezygnację z osądu ani o złożenie ślepej wiary w technologię, lecz oferuje partnerstwo oparte na przejrzystości i dowodach. Przywraca poczucie godności w interakcji z AI, zastępując niepewną zależność ostrożnym zaufaniem i zastępując cichą wątpliwość widoczną weryfikacją. W miarę jak sztuczna inteligencja zbliża się do autonomii i głębiej wkracza w ludzkie życie, koszt bycia w błędzie staje się coraz większy z każdym krokiem, a ta wizja stoi jako przypomnienie, że postęp bez zaufania jest pusty, że inteligencja bez weryfikacji jest krucha, a przyszłość, którą budujemy z maszynami, musi nadal szanować ludzką potrzebę prawdy, odpowiedzialności i pocieszenia.