Nie zacząłem oglądać Miry, ponieważ świat potrzebował kolejnego protokołu AI.

Zacząłem oglądać, ponieważ coś wydawało się dziwne.

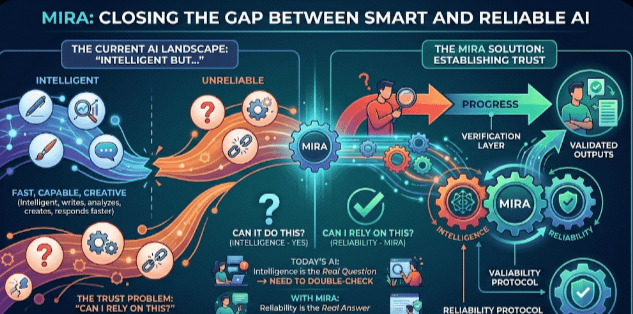

AI już wydaje się inteligentne. Potrafi pisać, analizować, tworzyć i odpowiadać szybciej niż kiedykolwiek. Ale inteligencja nie jest już prawdziwym problemem.

Zaufanie to.

Dziś, gdy AI daje odpowiedź, prawdziwe pytanie brzmi, czy może to zrobić?

Prawdziwe pytanie brzmi, czy mogę polegać na tym bez samodzielnego sprawdzania?

I szczerze mówiąc, większość czasu — nie mogę.

Dokładnie w tym miejscu wkracza Mira Network.

Mira nie stara się zbudować lepszego modelu. Nie konkuruje z LLM. Zamiast tego koncentruje się na czymś głębszym — przestrzeni między wynikami AI a zaufaniem.

Zamiast traktować odpowiedzi AI jako jedną ostateczną prawdę, Mira dzieli je na mniejsze twierdzenia. Te twierdzenia są następnie oceniane w rozproszonym sieci niezależnych weryfikatorów. Każdy weryfikator przegląda twierdzenie osobno, a konsensus osiągany jest poprzez koordynację blockchain i mechanizmy motywacyjne.

To zmienia wszystko.

Zaufanie nie zależy już od pewności jednego modelu.

Pochodzi to z rozproszonej zgody wspieranej przez odpowiedzialność ekonomiczną.

Każda weryfikacja jest rejestrowana w łańcuchu.

Dokładność jest nagradzana.

Bezczynność jest karana.

Prawda przestaje być zakładana — i zaczyna być egzekwowana.

To staje się krytyczne, gdy AI ewoluuje.

Już widzimy, jak agenci AI zarządzają aktywami, wchodzą w interakcje z systemami finansowymi, automatyzują przepływy pracy i generują badania. Gdy AI przechodzi od sugerowania do działania, „prawdopodobnie poprawne” nie jest już akceptowalne.

Mira nie udaje, że halucynacje znikną. Akceptuje niepewność jako część nowoczesnej AI — i buduje wokół niej warstwę niezawodności.

To podejście wydaje się ugruntowane.

Oczywiście, to nie jest proste. Rozbicie rozumowania na weryfikowalne twierdzenia wymaga wysiłku. Weryfikacja wprowadza opóźnienie. Różnorodność weryfikatorów musi być zachowana. Ryzyko zmowy musi być zarządzane.

Ale zasadnicza idea jest potężna:

Inteligencja bez weryfikacji nie może się bezpiecznie skalować.

Jeśli AI stanie się infrastrukturą, sama reputacja nas nie ochroni. Centralna moderacja nie wystarczy.

Mira pozycjonuje się jako warstwa zaufania — przekształcając probabilistyczne wyniki AI w informacje poparte konsensusem.

To nie jest głośne.

To nie goni za modą.

Rozwiązuje jeden z największych strukturalnych słabości AI.

A jeśli AI będzie dążyć do autonomii, systemy takie jak Mira nie będą już tylko użyteczne.

Będą niezbędne.