Kiedyś myślałem, że największym zagrożeniem dla przyszłości sztucznej inteligencji była centralizacja danych, ale zrozumiałem, że to tylko symptom znacznie głębszego i bardziej niebezpiecznego wąskiego gardła: całkowita niemożność weryfikacji obliczeń na dużą skalę. Obecnie budujemy globalną infrastrukturę inteligencji na fundamencie ślepej wiary, a w każdym systemie, w którym stawka jest tak wysoka, wiara jest strukturalną podatnością.

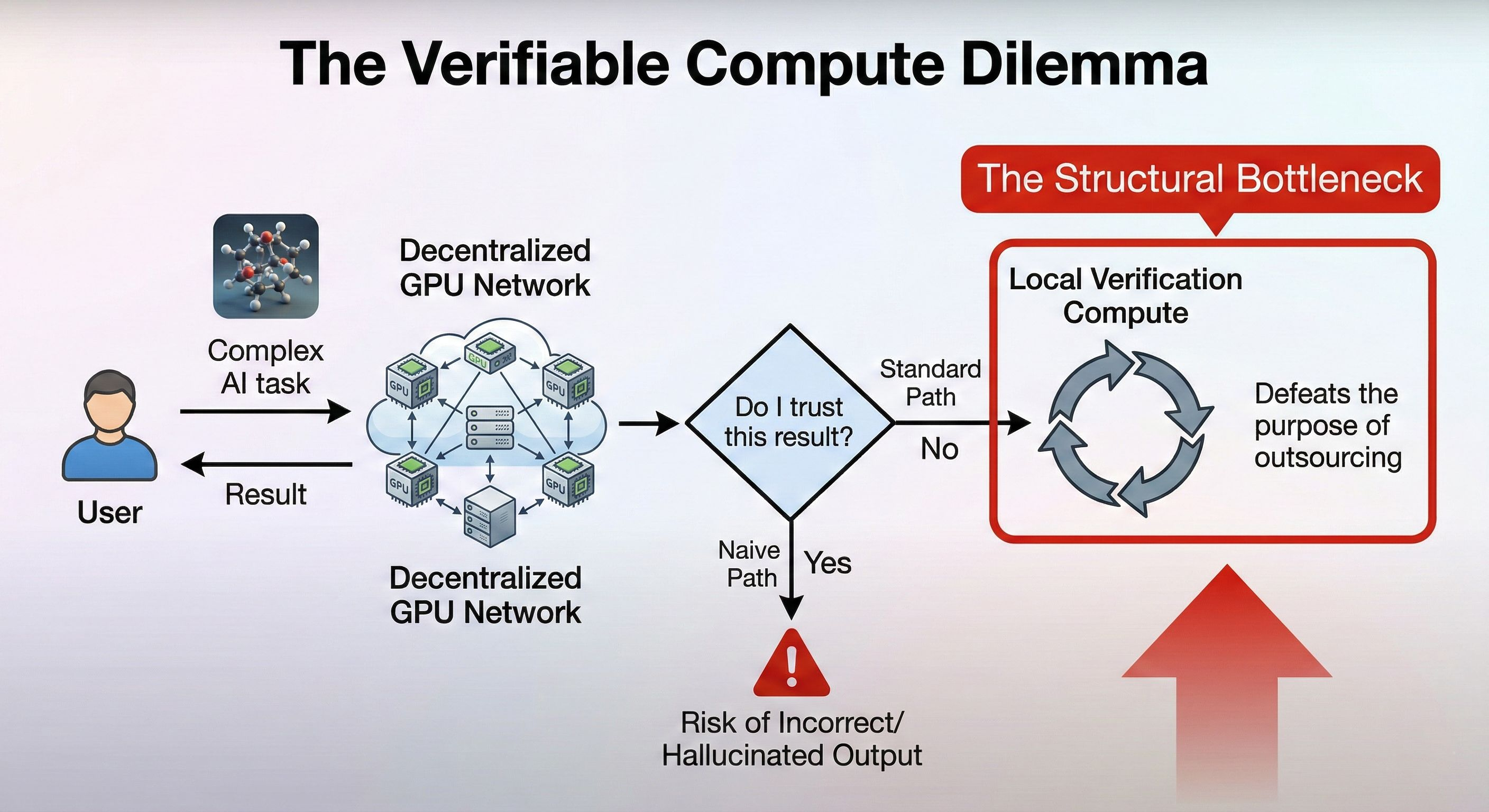

Przemysł lubi mówić o "demokratyzacji AI" lub "zdecentralizowanej obliczenia", ale większość z tych rozmów to powierzchowne tematy. Skupiają się na stronie podaży — jak wprowadzić więcej GPU w ręce większej liczby ludzi. Ignorują jednak dylemat weryfikacji. Jeśli zlecę ogromne zadanie szkolenia maszynowego do zdecentralizowanej sieci dostawców sprzętu, jak mogę wiedzieć, że wykonali tę pracę poprawnie? W obecnym paradygmacie jedynym sposobem, aby być pewnym, jest ponowne wykonanie obliczeń samodzielnie, co całkowicie niweczy sens zlecania tego na początku. To nie jest problem skalowania ani problem adopcji. To fundamentalna luka zaufania w architekturze, w jakiej przetwarzamy informacje.

Bieżące rozwiązania tego problemu zawodzą, ponieważ próbują rozwiązać kryzys na poziomie sprzętowym za pomocą łat na poziomie oprogramowania. Widzę projekty próbujące używać optymistycznych protokołów, gdzie zakłada się, że pracownik jest uczciwy, chyba że wyzwalacz udowodni inaczej. Działa to w przypadku prostych transakcji, ale w przypadku złożoności nowoczesnej AI o parametrach multibilionowych, "okres wyzwania" staje się obliczeniowym koszmarem. Inni próbują zmusić standardowy sprzęt ogólnego przeznaczenia do stosowania dowodów zerowej wiedzy. Koszty są oszałamiające. Kończysz wydając więcej energii i czasu na udowadnianie, że wykonałeś pracę, niż na rzeczywiste wykonanie tej pracy. To ślepy zaułek architektoniczny. W zasadzie próbujemy uruchomić system szybkiej kolei na drewnianych torach i zastanawiamy się, dlaczego tarcie spala całe to przedsięwzięcie.

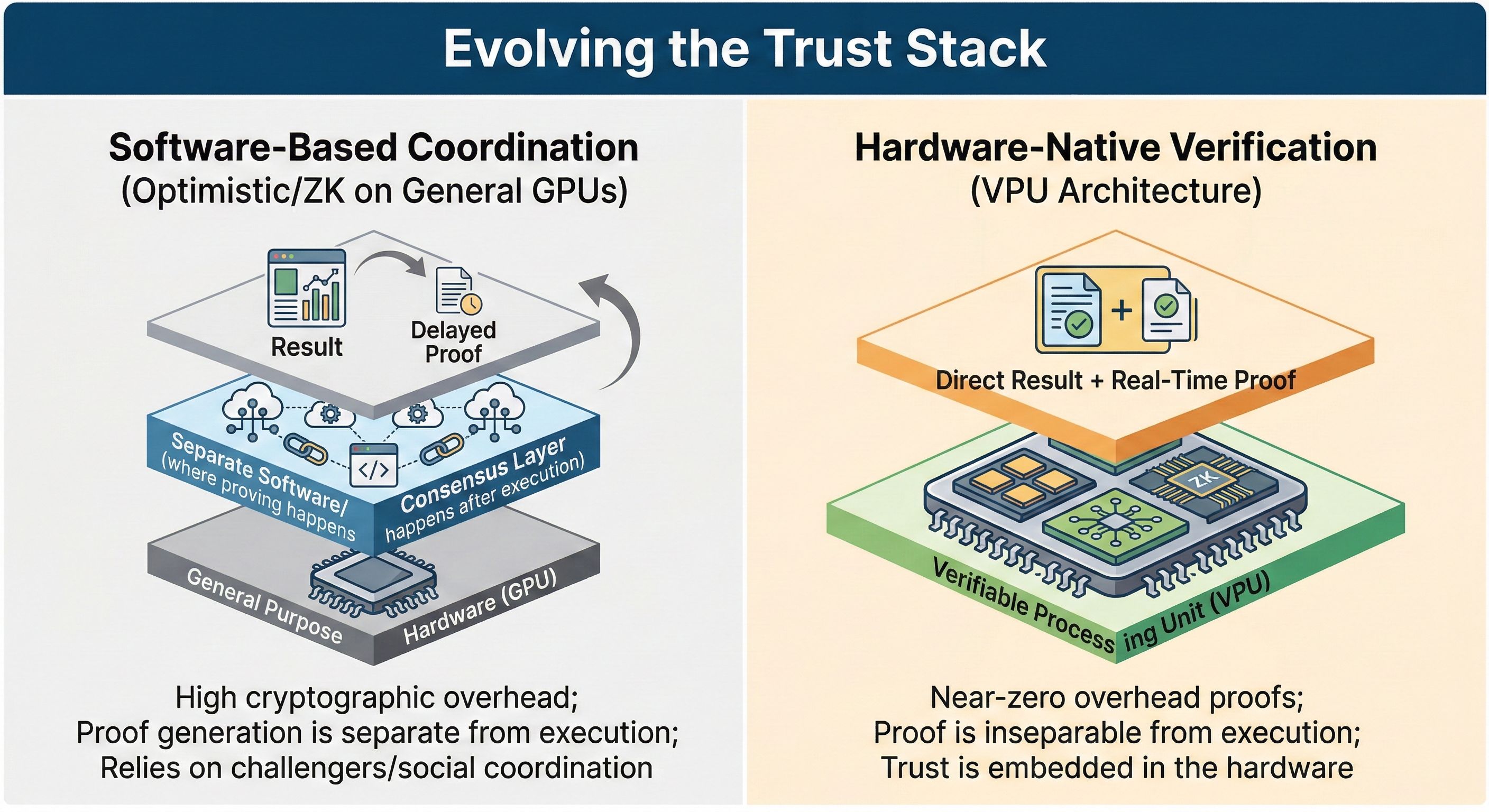

To tutaj @Fabric Foundation wchodzi do rozmowy, i robi coś fundamentalnie innego. Nie budują kolejnego rynku dla wynajmu GPU w stylu "AirBnB". Zamiast tego przemyślają relację między chipem a dowodem. Ich filozofia projektowania koncentruje się na idei, że aby obliczenia były naprawdę zdecentralizowane, muszą być natywnie weryfikowalne. Przesuwają warstwę "zaufania" z warstwy społecznej lub programowej bezpośrednio do krzemu.

Skupiając się na tym, co nazywają Weryfikowalnymi Jednostkami Obliczeniowymi, Fabric buduje stos, w którym wykonanie zadania i kryptograficzny dowód tego wykonania odbywają się jednocześnie. To ogromna zmiana w strategii infrastrukturalnej. Większość projektów zaczyna od tokena i próbuje przekupić użytkowników do sieci. Fabric zaczyna od fizyki samego obliczenia. Token tutaj nie działa jako spekulacyjna marchewka, ale jako narzędzie koordynacji dla nowej klasy "uczciwego" sprzętu. To system zaprojektowany dla świata, w którym nie musimy już brać słowa dostawcy za pewnik. Sam sprzęt staje się arbitrem prawdy.

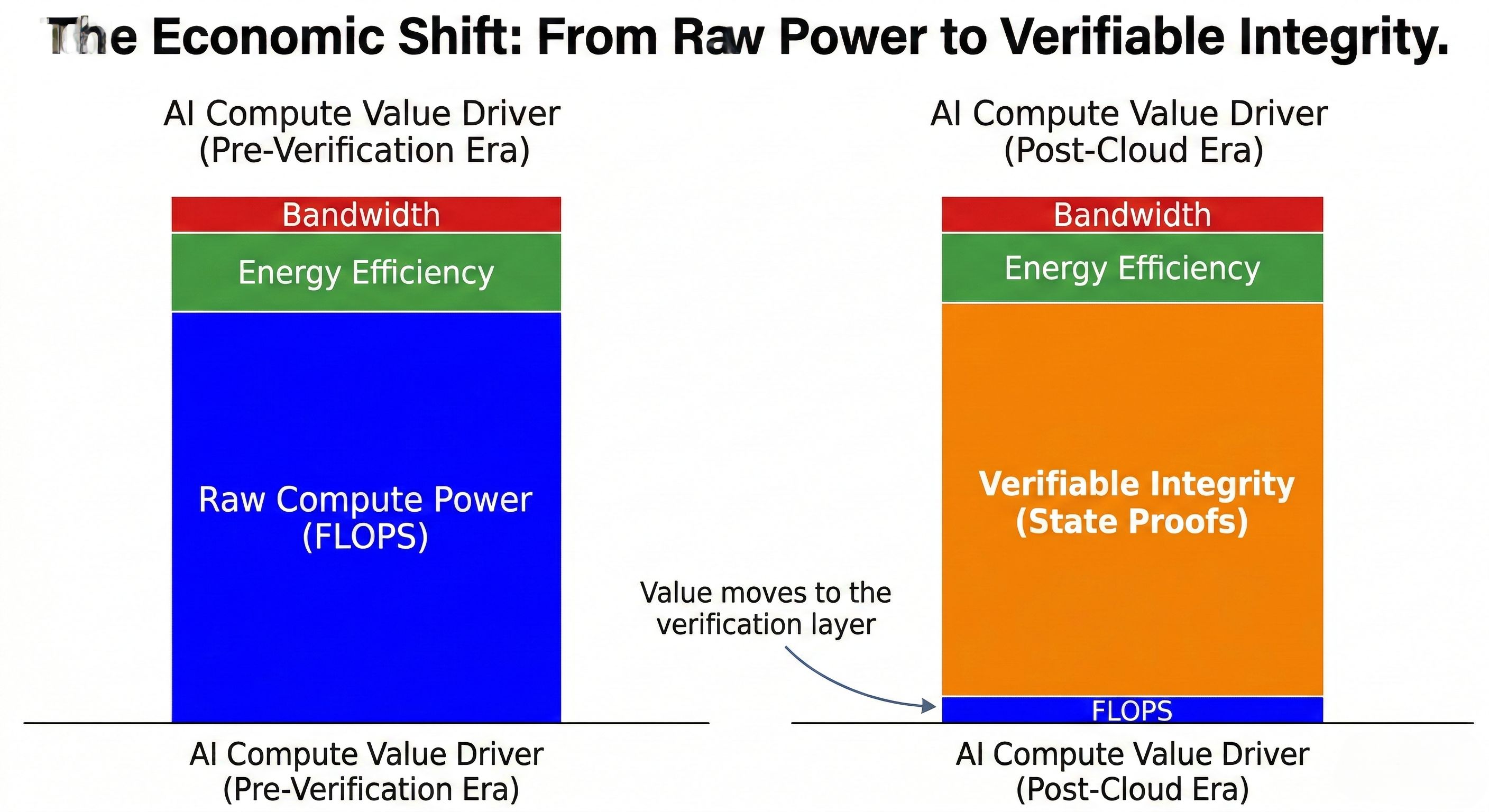

Zacząłem zauważać wzór w tym, jak ludzie oceniają te projekty, i jest jeden niespodziewany wniosek, który większość pomija. Przechodzimy w kierunku ery "po-chmurze", ale nie będzie to wyglądać jak internet, który mamy teraz. Prawdziwa wartość projektu takiego jak Fabric nie polega tylko na tym, że czyni AI "tańszym" lub "opornym na cenzurę". Głębszą konsekwencją jest komodyzacja zaufania. Gdy obliczenia są natywnie weryfikowalne, "prawda" przestaje być luksusem dostarczanym przez garstkę ogromnych korporacji jak Google czy Microsoft i zaczyna być towarem, który może być handlowany i weryfikowany przez każdego, wszędzie, natychmiast.

Sposób, w jaki te systemy wchodzą w interakcje, jest obecnie zasadniczo zepsuty, ponieważ wciąż traktujemy "obliczenia" jako czarną skrzynkę. Wysyłasz dane, otrzymujesz wynik, i masz nadzieję, że czarna skrzynka nie halucynowała ani nie oszukiwała. Fabric skutecznie otwiera skrzynkę i buduje przezroczysty rejestr dla każdej operacji. To zmienia zasady gry dla aplikacji AI o wysokiej stawce w medycynie, finansach i systemach autonomicznych, gdzie "wystarczająco dobre" lub "prawdopodobnie poprawne" nie są opcją. To, co mnie wyróżnia, to to, że nie próbują konkurować z Nvidią pod względem surowej mocy; konkurują na integralności wyniku. W dłuższej perspektywie integralność jest znacznie rzadszym i cenniejszym zasobem niż surowe FLOPS.

To, co obserwujemy, to narodziny nowego stosu, gdzie projektowanie zachęt i architektura sprzętu w końcu są zsynchronizowane. Koordynacja tysięcy niezależnych węzłów działa tylko wtedy, gdy koszt oszustwa jest wyższy niż nagroda, a można to egzekwować tylko wtedy, gdy można wykryć oszustwo w czasie rzeczywistym bez zbędnej pracy. Łącząc kryptograficzne wymagania blockchaina z wymaganiami przetwarzania AI na poziomie sprzętu, Fabric tworzy warstwę koordynacyjną, która naprawdę ma zęby, aby poradzić sobie z inteligencją na skalę globalną.

Powinniśmy przestać patrzeć na zdecentralizowaną AI przez pryzmat "zakłócania wielkich technologii" i zacząć postrzegać ją jako niezbędną ewolucję teorii informacji. Gdy AI staje się głównym sposobem, w jaki wchodzimy w interakcje z rzeczywistością, nie możemy pozwolić sobie na to, aby ta rzeczywistość była filtrowana przez nieweryfikowalne silosy. Przejście od "ufaj mi" do "zweryfikuj mnie" to jedyny sposób, aby zapewnić, że inteligencja, na której polegamy, pozostaje obiektywna i dostępna.

To nie chodzi o następny wzrost rynku lub tymczasowy trend w cyklu. Chodzi o strukturalną zmianę w tym, jak ludzkość przetwarza logikę. Oddalamy się od scentralizowanej władzy i kierujemy się w stronę matematycznej pewności. Fabric Foundation nie buduje tylko platformy; budują infrastrukturę dla świata, w którym prawda obliczenia jest nierozłączna z samym obliczeniem. To cicha, potężna zmiana, która zdefiniuje następną dekadę naszej branży.