Kilka lat temu, kryptowaluty były obsesjonowane szybkością. Szybsze bloki. Szybsza finalizacja. Szybsze UX. Założenie było proste: jeśli zmniejszymy tarcie, adopcja nastąpi. Teraz AI wzięło ten instynkt i posunęło go dalej. Nie tylko natychmiastowo realizujemy transakcje — generujemy badania, raporty, odpowiedzi klientów, a nawet projekty prawne w ciągu kilku sekund.

Ale coś subtelnego zmieniło się po drodze.

Zrozumieliśmy, że szybkość nie usuwa ryzyka. Wręcz przeciwnie, je nasila.

Niezręczna prawda o nowoczesnym AI nie polega na tym, że popełnia błędy. Ludzie też popełniają błędy. Chodzi o to, że AI robi to płynnie. Spokojnie. Z strukturą i pewnością siebie. A kiedy ten wynik trafia do systemów finansowych, narzędzi zgodności, pulpitów operacyjnych lub oprogramowania wsparcia medycznego, pewność bez weryfikacji staje się zobowiązaniem.

To jest miejsce, w którym Mira pasuje — nie jako kolejny projekt AI goniący za uwagą, ale jako próba budowy warstwy odpowiedzialności w procesach AI.

---

Kluczowa idea: przekształcenie „wygląda dobrze” w „udowodnione prawidłowo”

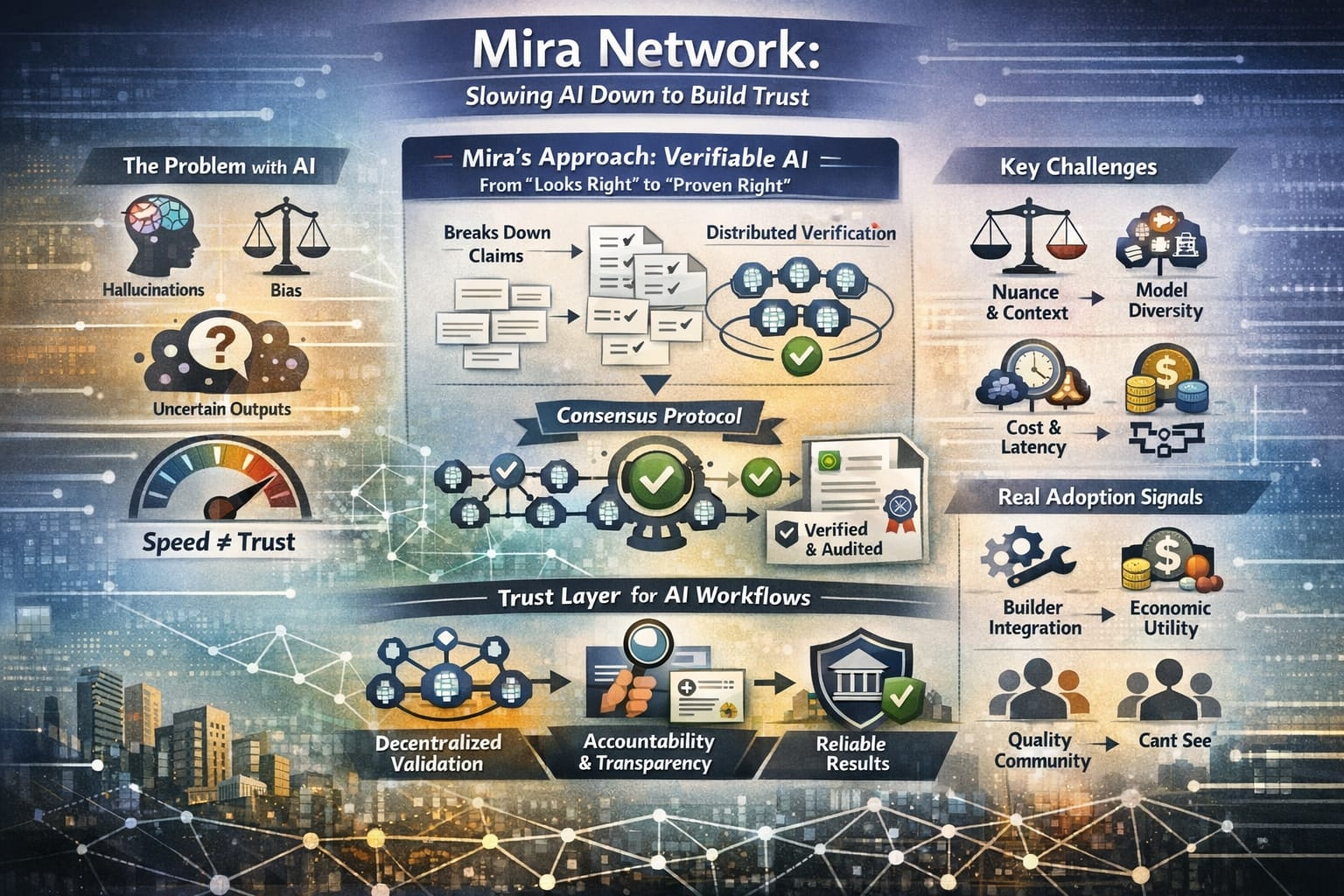

W swojej istocie Mira próbuje rozwiązać prosty, ale coraz bardziej pilny problem: jak ufać wynikom AI, gdy sam model nie może w niezawodny sposób sygnalizować pewności?

Duże modele językowe mogą produkować przekonujące odpowiedzi, które są częściowo poprawne, kontekstowo wprowadzające w błąd lub po prostu błędne. Skalowanie rozmiaru modelu redukuje niektóre wzorce błędów, ale nie eliminuje halucynacji. A w środowiskach o wysokiej stawce — finanse, opieka zdrowotna, zarządzanie, automatyzacja przedsiębiorstw — „głównie dokładne” to za mało.

Podejście Miry jest strukturalne, a nie kosmetyczne. Zamiast prosić jeden model o podwójne sprawdzenie samego siebie, system dzieli wyjście AI na mniejsze, weryfikowalne roszczenia. Te roszczenia są rozdzielane pomiędzy niezależne weryfikatory działające na różnych modelach. Konsensus określa, które roszczenia przechodzą weryfikację, a wynik jest rejestrowany kryptograficznie.

Kluczowa zmiana tutaj ma charakter filozoficzny: zaufanie nie pochodzi z reputacji marki ani rozmiaru modelu. Pochodzi z przejrzystości procesu i odpowiedzialności ekonomicznej.

A ta zmiana wydaje się zgodna z kierunkiem, w którym zmierza rynek.

---

Architektura bez hałasu

Łatwo się zgubić w technicznej terminologii, gdy mowa o weryfikacji AI, ale mechanika jest zaskakująco intuicyjna.

Po pierwsze, generowana treść jest rozkładana na roszczenia. Nie ogólne „czy to poprawne?” pytania, ale strukturalne twierdzenia, które można ocenić w sposób spójny.

Po drugie, te roszczenia są wysyłane do wielu niezależnych węzłów. Każdy węzeł dokonuje inferencji — zasadniczo przeprowadzając swoją własną ocenę, używając własnego stosu modelu.

Po trzecie, wyniki są agregowane w wynik konsensusu. W zależności od wymaganego rygoru, może to oznaczać zgodę większości lub wyższy próg.

Na koniec wydawany jest certyfikat. Ten certyfikat nie mówi tylko „zweryfikowane”. Może pokazać, co zostało sprawdzone i jak sieć doszła do swojego wniosku.

Ekonomicznie, uczestnictwo jest powiązane. Węzły stawiają wartość i są nagradzane za dostosowanie się do uczciwego konsensusu. Powtarzające się odchylenia mogą prowadzić do kar. Tu Mira staje się wyraźnie rodzimą kryptowalutą: wprowadza weryfikację do systemu opartego na teorii gier, zamiast polegać na scentralizowanej moderacji.

Nie próbuje zastąpić modeli AI. Próbuje stanąć za nimi.

Middleware, a nie reflektor.

---

Gdzie to się znajduje w tym cyklu

Obecny cykl infrastrukturalny wydaje się inny niż poprzedni. Jest mniej apetytu na abstrakcyjne obietnice i większy nacisk na użyteczne komponenty. Twórcy migrują w kierunku modułowych stosów, w których specjalistyczne usługi mogą być integrowane bez przepisywania wszystkiego od podstaw.

Mira pasuje do tej modułowej tezy.

Nie musi wygrywać wyścigu modeli AI. Musi stać się warstwą weryfikacyjną, którą zespoły podłączają, gdy niezawodność staje się ograniczeniem.

Narracyjnie zgadza się to z rosnącym zaniepokojeniem dotyczącym zaufania do AI. Jednak samo dopasowanie narracji nie buduje trwałych systemów. Liczy się to, czy weryfikacja znacząco obniża koszty downstream — ryzyko zgodności, spory z klientami, szkody reputacyjne, błędy operacyjne.

W porównaniu do scentralizowanych systemów ensemble, Mira oferuje audytowalność i decentralizację. To przewaga, jeśli zależy ci na przejrzystości. To wada, jeśli opóźnienie lub koszt stają się zbyt wysokie.

Istnieją również realne ograniczenia:

Prawda nie zawsze jest binarna. Wiele roszczeń znajduje się w szarych obszarach.

Różnorodność modeli musi być autentyczna, a nie kosmetyczna.

Weryfikacja wprowadza tarcia, a tarcia muszą uzasadniać się ekonomicznie.

Zrównoważona analiza ma tu znaczenie. To nie jest gwarantowany wynik. To strukturalny zakład.

---

Prawdziwe sygnały ponad hałas

Oceniając projekty infrastrukturalne, powierzchowne metryki rzadko oddają pełny obraz. Ruch cen tokenów lub zainteresowanie społeczne mogą tworzyć tymczasową uwagę, ale middleware żyje lub umiera na głębokości integracji.

Znaczące sygnały są cichsze:

Czy programiści integrują SDK w procesy produkcyjne?

Czy opłaty za weryfikację są płacone, ponieważ zmniejszają rzeczywiste ryzyko?

Czy społeczność składa się z twórców i operatorów, a nie tylko spekulantów?

Doniesienia sugerują, że Mira zaczęła wprowadzać się do aplikacji AI i przetwarzać znaczną przepustowość, chociaż niezależna weryfikacja skali będzie miała znaczenie w dłuższej perspektywie. Ważniejszym wskaźnikiem będzie to, czy korzystanie z niej utrzyma się, gdy zachęty się ustabilizują.

Wczesne sieci często używają kontroli dostępu lub strukturalnego wprowadzania, aby utrzymać jakość. To może poprawić zdrowie wczesnej sieci, ale może wprowadzić tarcia w uczestnictwie. Wymiana między otwartością a integralnością nie jest trywialna, szczególnie w przypadku protokołu skoncentrowanego na zaufaniu.

Innymi słowy, sygnał wciąż się formuje.

---

Co musi się udać

Aby Mira stała się fundamentem, a nie eksperymentem, kilka warunków musi się zbiegać.

Certyfikaty weryfikacji muszą stać się naprawdę użyteczne — nie jako artefakty marketingowe, ale jako narzędzia, na których polegają firmy i programiści podczas audytów decyzji wspieranych przez AI.

Różnorodność węzłów musi pozostać rzeczywista. Jeśli zachęty skłaniają operatorów do identycznych stosów modeli, sieć ryzykuje skorelowaną awarię.

Koszty i opóźnienia muszą pozostać konkurencyjne. Weryfikacja powinna być odczuwana jako racjonalna ochrona, a nie kosztowny luksus.

Najważniejsze, system musi radzić sobie z niuansami. Nie wszystkie niepoprawne stwierdzenia są równe. Nie wszystkie kontrowersyjne fakty są złośliwe. Sieć weryfikacyjna musi inteligentnie odzwierciedlać niepewność, a nie spłaszczać jej do wyników binarnych.

Jeśli te elementy się złożą, Mira staje się czymś cichym, ale potężnym: warstwą niezawodności, na której polegają systemy AI, ale o której użytkownicy rzadko myślą.

Jeśli nie, istnieje ryzyko, że zostanie pominięte na rzecz scentralizowanych alternatyw, które są szybsze i tańsze.

---

Ugruntowana myśl na zakończenie

Kryptowaluty często oscylują między dwoma ekstremami — nadmierną pewnością siebie a cynizmem. Mira nie potrzebuje ani jednego, ani drugiego.

Prosta obserwacja jest taka: AI jest integrowane w systemy szybciej, niż mamy ramy odpowiedzialności. Weryfikacja nie jest glamour, ale jest strukturalna. A strukturalne warstwy mają tendencję do kumulowania wartości, jeśli działają.

Mira podejmuje zakład, że zdecentralizowany konsensus, w połączeniu z zachętami ekonomicznymi, może uczynić wyniki AI bardziej obronnymi. Nie doskonałe. Nie nieomylne. Ale audytowalne.

Na rynku, który kiedyś priorytetował prędkość ponad wszystko, to wydaje się dojrzałym kierunkiem.

Nie głośniej.

Po prostu bardziej stabilne.

#Miar @Mira - Trust Layer of AI $MIRA