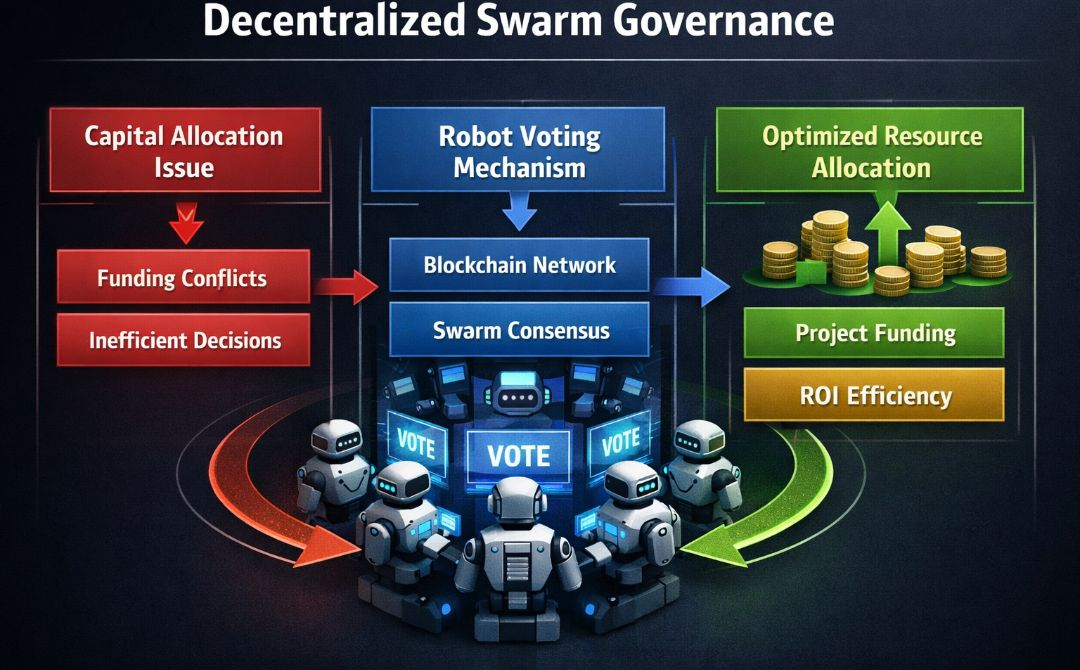

Czy $ROBO zaprojektować zdecentralizowaną warstwę zarządzania rojem, w której kolektywy robotów głosują na alokację kapitału bez nadzoru ludzkiego?

Wczoraj oglądałem aktualizację oprogramowania, która była wprowadzana w małej flocie robotów magazynowych podczas strumienia testowego. Tablica rozdzielcza odświeżyła się, jeden węzeł opóźnił się o 1,7 sekundy, a nagle kolejka zadań sama się zrównoważyła bez ingerencji kogokolwiek. Żaden nadzorca nie interweniował. Żaden menedżer tego nie zatwierdził. System po prostu dostosował alokację kapitału—zużycie baterii, priorytet obliczeń, gęstość routingu—na podstawie sygnałów wewnętrznych.

Wyglądało na efektywne. Czuło się również lekko niedopasowane.

Cała warstwa optymalizacji była technicznie 'autonomiczna', ale skarbiec finansujący te maszyny wciąż znajdował się pod zarządzaniem ludzkim. Zatwierdzenia budżetu, cykle aktualizacji, kapitał na wymianę sprzętu—wszystko to przepływało przez statyczne komitety. Roboty mogły koordynować ruch w milisekundach, ale decyzje kapitałowe poruszały się z prędkością kwartalnych raportów. Wykonanie i alokacja istniały w różnych stuleciach.

Strukturalne napięcie nie dotyczy autonomii AI. Chodzi o opóźnienie kapitału.

Kontynuujemy projektowanie swarmów robotycznych, które zachowują się jak adaptacyjne organizmy, jednocześnie finansując je jak biurokracje. Roboty mogą przełączać ruch, redystrybucjonować obciążenia energetyczne lub dostosowywać gęstość pracy w czasie rzeczywistym, ale ich ekonomiczna linia życia pozostaje ręcznie ograniczona. Zachęty dryfują. Zapotrzebowanie na zasoby się zmienia. Zarządzanie pozostaje w tyle.

Model mentalny, który bardziej mi odpowiada, to nie 'DAO dla robotów'. To układ nerwowy.

Swarm bez refleksów ekonomicznych jest jak ciało, które odczuwa ból, ale nie może skierować przepływu krwi. Czujniki strzelają. Sygnały się propagują. Ale kapitał—odpowiednik tlenu—wciąż wymaga głosowania zarządu. Jeśli systemy robotyczne stają się coraz bardziej samodzielne w przestrzeni fizycznej, to warstwa skarbowa musi ewoluować w coś refleksyjnego, a nie deliberatywnego.

Dopiero po przemyśleniu tego w ten sposób pomysł warstwy zarządzania swarmem pod $ROBO zaczyna wydawać się spójny.

W sieciach takich jak Ethereum, alokacja kapitału jest deterministyczna i przejrzysta, ale wolna w skali ludzkiej. Solana optymalizuje przepustowość, ale nadal zakłada ludzkie cykle propozycji. Podsieci Avalanche umożliwiają dostosowanie, ale zarządzanie pozostaje zewnętrznie napędzane. Żaden z tych ekosystemów nie jest strukturalnie zaprojektowany dla refleksów skarbowych natywnych dla maszyn. Optymalizują dla ludzi koordynujących kapitał, a nie agentów koordynujących płynność.

Warstwa zarządzania swarmem ROBO potrzebowałaby zupełnie innej architektury.

Pierwsza zasada: roboty nie powinny 'głosować' w konwencjonalnym sensie. Zamiast tego powinny stakować metryki wydajności operacyjnej jako sygnały ekonomiczne. Każdy węzeł w swarmie mógłby zablokować $ROBO tokeny proporcjonalnie do dostępności, dokładności zadania lub efektywności energetycznej. Dane wydajności stają się ważoną siłą głosów. Słabe wykonanie automatycznie zmniejsza wagę stawki poprzez cięcie lub spadek.

To przesuwa zarządzanie z głosowania opartego na opiniach do alokacji ważonej wydajnością.

Druga zasada: alokacja kapitału musi być parametryczna, a nie oparta na propozycjach. Zamiast składać propozycje zarządzające, węzły swarmu dostosowywałyby przepływy kapitału poprzez ograniczone funkcje optymalizacji. Na przykład, dystrybucja skarbu do klastrów obliczeniowych mogłaby skalować w oparciu o zweryfikowany wzrost przepustowości w ramach zdefiniowanych limitów—powiedzmy, limit 5% tygodniowej redystrybucji, aby zapobiec niekontrolowanej koncentracji.

Użyteczność tokena staje się strukturalna tutaj. ROBO nie działałoby jedynie jako aktyw koordynacyjny; działałoby jako zabezpieczenie stakowane, obligacja wydajności oraz ograniczenie alokacji. Emisje skarbu mogłyby podążać za krzywą rozpadu—może 3% kwartalnego zmniejszenia emisji—aby uniknąć nieskończonego rozcieńczenia, jednocześnie zachęcając do wczesnego uczestnictwa. Wymagania dotyczące uczestnictwa mogą obejmować minimalne progi dostępności lub kryptograficzny dowód ukończenia zadania.

Pętla zachęt jest mechaniczna:

Roboty wykonują zadania → metryki wydajności weryfikowane → waga stawki ROBO dostosowywana → alokacja skarbu się zmienia → klastry o wyższej wydajności zyskują kapitał → konkurencja wydajnościowa intensyfikuje się.

Wyobraź sobie wizualny diagram pokazujący tę pętlę jako okrągły przepływ: Dane wykonania → Warstwa weryfikacji → Dostosowanie stawki → Redystrybucja skarbu → Ulepszenie infrastruktury → z powrotem do Danych wykonania. W centrum siedzi token ROBO jako ograniczenie równoważące. Diagram miałby znaczenie, ponieważ jasno pokazuje, że zarządzanie nie jest forum—jest obwodem sprzężenia zwrotnego.

Przechwytywanie wartości wynika z różnic w efektywności. Jeśli jedna konfiguracja swarmu konsekwentnie dostarcza 12% wyższej przepustowości na jednostkę energii, alokacja skarbu ją wzmacnia. Z biegiem czasu kapitał naturalnie płynie w kierunku najbardziej efektywnych kolektywów robotycznych. Sieć staje się adaptacyjnym gradientem kapitału.

Ale projekt działa tylko wtedy, gdy weryfikacja pozostaje odporna na manipulacje. Roboty muszą kryptograficznie zaświadczać o metrykach wydajności za pomocą zdecentralizowanych wróżb lub dowodów zakorzenionych w sprzęcie. Bez wiarygodnego pomiaru, waga stawki zapada się w manipulacje. Cały model refleksyjny zależy od weryfikowalnych danych wykonania.

Zachowanie deweloperów zmieniłoby się natychmiast. Zamiast lobbować posiadaczy tokenów o finansowanie, deweloperzy optymalizowaliby oprogramowanie robotów, aby poprawić mierzalne wskaźniki wydajności. Przechwytywanie skarbca staje się wynikiem technicznym, a nie politycznym. Centrum ciężkości przesuwa się z forów zarządzających do optymalizacji kodu.

Użytkownicy—czy to przedsiębiorstwa wdrażające swarmy, czy uczestnicy stakujący ROBO—również dostosowywaliby zachęty. Stakerzy woleliby wspierać klastry z przejrzystą historią wydajności. Spekulacja maleje w stosunku do mierzalnej efektywności. Szybkość tokena zwalnia, ponieważ ROBO staje się osadzone w wymaganiach stakowania i reflexach zarządzania zamiast krążyć czysto w celu handlu.

Istnieje tutaj uczciwe ryzyko.

Jeśli metryki wydajności stają się zbyt wąskie, swarmy mogą nadmiernie optymalizować mierzalne wyniki, degradując jednocześnie niemierzalne cechy. Na przykład maksymalizacja przepustowości może skrócić żywotność sprzętu w dłuższym okresie. Jeśli funkcja nagrody jest źle zaprojektowana, reflexy zarządzania mogą wzmocnić systemową kruchość. Autonomiczna alokacja może przyspieszyć porażkę tak szybko, jak wzmocni sukces.

Inne ograniczenie: stabilność koordynacji. Jeśli redystrybucja skarbu jest zbyt reaktywna, kapitał może oscylować między klastrami, tworząc niestabilność ekonomiczną wewnątrz swarmu. Ograniczone parametry redystrybucji—takie jak ustalone tygodniowe redystrybucje lub wygładzanie spadku stawki—nie są opcjonalnymi wyborami projektowymi; są to strukturalne tłumiki.

Podstawowym założeniem, które musi być prawdziwe, jest to: kolektywy robotyczne mogą produkować wiarygodne, kryptograficznie weryfikowalne dane wydajności. Bez tego jakakolwiek warstwa 'zarządzania swarmem' wraca do arbitrażu ludzkiego.

To, co czyni koncepcję ROBO strukturalnie interesującą, to nie autonomia dla samej autonomii. To zbieżność między prędkością wykonania a prędkością kapitału. Gdy maszyny działają w milisekundach, ale finansowanie porusza się w miesiącach, nieefektywność kumuluje się niewidocznie. Warstwa zarządzania swarmem stara się zlikwidować tę lukę czasową.

Kapitał przestaje być decyzją menedżerską i staje się odpowiedzią systemu.

A gdy alokacja kapitału staje się refleksyjna w skali maszyn, zarządzanie nie jest już spotkaniem—jest adaptacyjnym organem ekonomicznym osadzonym bezpośrednio wewnątrz swarmu.#ROBO @Fabric Foundation