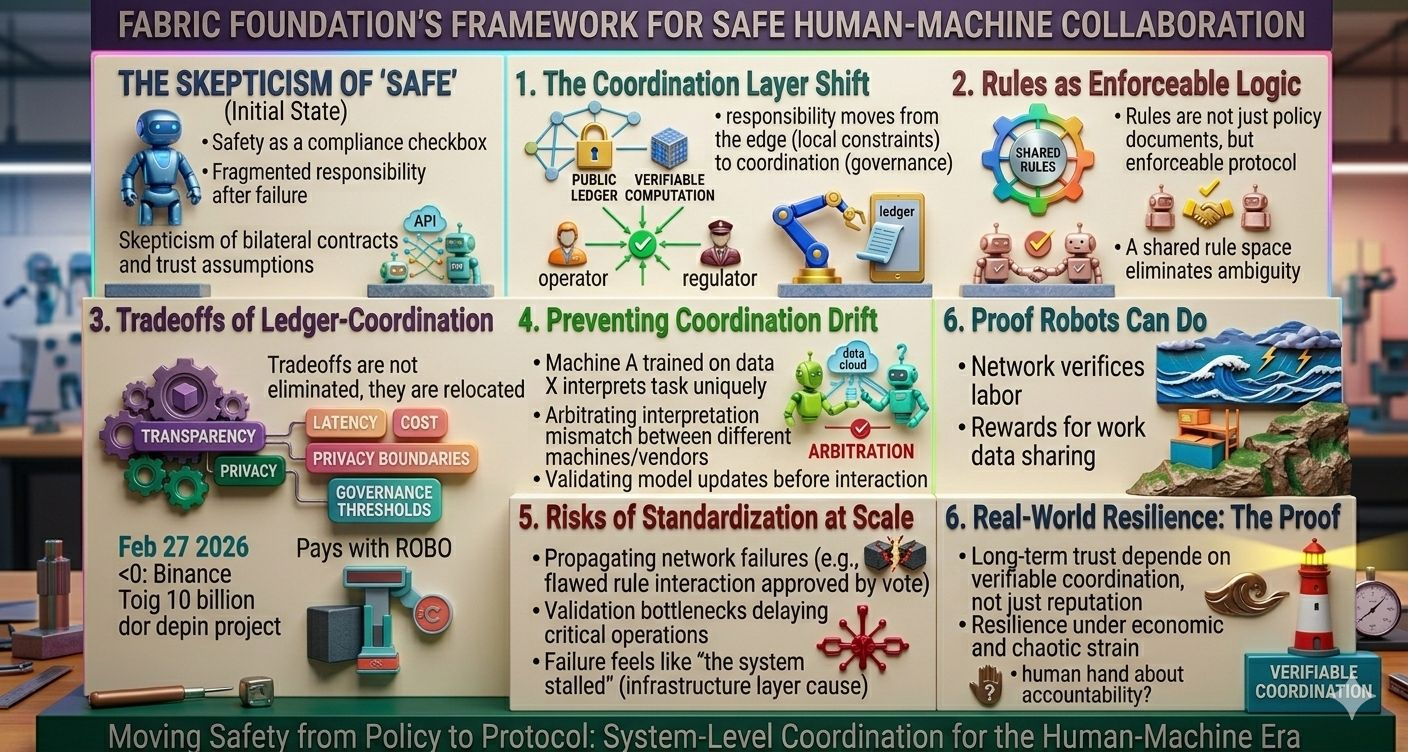

Kiedy słyszę „bezpieczna współpraca człowieka z maszyną”, moją pierwszą reakcją nie jest komfort. To sceptycyzm. Nie dlatego, że bezpieczeństwo nie jest ważne, ale dlatego, że w robotyce bezpieczeństwo często traktowane jest jak pole do zaznaczenia zgodności, a nie jak zasada projektowania na poziomie systemu. Większość ram mówi o barierach ochronnych. Nieliczni przeprojektowują infrastrukturę, aby bariery ochronne były wbudowane w samą koordynację.

To jest soczewka, której używam, gdy patrzę na Fabric Foundation. Interesującą częścią nie jest to, że podkreśla bezpieczeństwo. Każda poważna inicjatywa w dziedzinie robotyki mówi, że to robi. Interesującą częścią jest to, gdzie odpowiedzialność za bezpieczeństwo faktycznie leży w jej architekturze.

W tradycyjnych wdrożeniach robotycznych bezpieczeństwo znajduje się na krawędzi. Robot ma lokalne ograniczenia. Firma ustala zasady. Regulator egzekwuje standardy po fakcie. Koordynacja między maszynami, szczególnie w różnych firmach lub jurysdykcjach, jest łączona za pomocą interfejsów API, umów i założeń dotyczących zaufania. Gdy coś zawodzi, odpowiedzialność staje się fragmentaryczna. Czy to operator? Oprogramowanie układowe? Integrator? Źródło danych?

Podejście Fabric przesuwa ten środek ciężkości. Zamiast traktować współpracę jako nakładkę na autonomiczne maszyny, traktuje koordynację jako pierwszorzędną warstwę rządzoną przez weryfikowalne obliczenia i publiczną księgę rachunkową. To brzmi abstrakcyjnie, dopóki nie rozpakujesz, co to oznacza: wspólne zasady to nie tylko dokumenty polityczne, to egzekwowalna logika.

Ale egzekwowanie nie eliminuje kompromisów. Przenosi je.

Jeśli roboty koordynują poprzez system oparty na księdze rachunkowej, wtedy każda istotna akcja, wymiana danych, przydział zadań, dowód wykonania potencjalnie przechodzi przez ramy, które mogą weryfikować, rejestrować i ograniczać zachowanie. To wprowadza przejrzystość i odpowiedzialność, ale także tworzy nowe powierzchnie projektowe, latencję, koszty, granice prywatności i progi zarządzania.

Bezpieczeństwo w tym modelu nie dotyczy tylko zapobiegania szkodom fizycznym. Chodzi o zapobieganie dryfowi koordynacji. Jeśli dwie maszyny trenowane na różnych zbiorach danych interpretują zadanie inaczej, kto rozstrzyga? Jeśli autonomiczny agent aktualizuje swój model, jak ta zmiana jest walidowana przed interakcją z innymi systemami? Jeśli zachęty są źle dopasowane, jak zapobiega się subtelnemu wykorzystywaniu wspólnej infrastruktury?

To tutaj warstwa zarządzania Fabric staje się czymś więcej niż tylko marką. Publiczna ramy koordynacji oznacza, że zasady mogą ewoluować kolektywnie, a nie być dyktowane przez jednego producenta. Ale kolektywne zarządzanie oznacza również wolniejszą zmianę, koszty negocjacji i potencjalną koncentrację władzy wśród tych, którzy kontrolują mechanizmy walidacji lub propozycji.

Stary model robotyki rozdziela bezpieczeństwo nierówno. Każda firma zabezpiecza swoje własne peryferia. Interoperacyjność jest opcjonalna. Odpowiedzialność jest negocjowana po integracji. Działa, dopóki heterogeniczne systemy nie zaczynają działać w tym samym fizycznym lub ekonomicznym środowisku w skali.

Model koordynacji księgi rachunkowej profesjonalizuje to środowisko. Zamiast każdego robota działającego jako izolowana jednostka z umowami o zaufaniu bilateralnym, maszyny stają się uczestnikami w przestrzeni wspólnych zasad. Dostęp, uprawnienia i aktualizacje mogą być audytowalne. W teorii to zmniejsza niejasność. W praktyce przenosi operacyjny ciężar w górę do tego, kto utrzymuje tory koordynacji, a tory mogą zawodzić.

W czysto lokalnym systemie awarie są często ograniczone. Robot ulega awarii, zakład zamyka, aplikowane jest poprawka. W systemie koordynowanym w sieci tryby awarii mogą się rozprzestrzeniać. Wadliwa aktualizacja przechodzi weryfikację. Głosowanie w sprawie zarządzania zatwierdza niezamierzoną interakcję zasad. Wąskie gardło walidacji opóźnia krytyczne operacje. Użytkownik, czy to przedsiębiorstwo, czy osoba, doświadcza tego po prostu jako „system się zaciął”. Przyczyna leży w warstwie infrastruktury, której niewielu bezpośrednio widzi.

To nie jest wada unikalna dla wizji Fabric. To właściwość każdej próby standaryzacji koordynacji na dużą skalę. Pytanie brzmi, czy mechanizmy weryfikacji i zarządzania są wystarczająco solidne w stresie nie tylko technicznie, ale też ekonomicznie. Kto ponosi koszty, gdy zabezpieczenia wyzwalają fałszywe pozytywy? Kto rozstrzyga spory między autonomicznymi agentami o sprzecznych celach?

Następuje również subtelniejsza zmiana, gdy zasady współpracy są zakodowane, a przewagi konkurencyjne się przesuwają. To już nie tylko kwestia budowania najbardziej zdolnego robota. Chodzi o budowanie maszyn, które mogą działać najskuteczniej w ramach wspólnej struktury koordynacji. Zgodność, interoperacyjność i weryfikowalna wydajność stają się strategicznymi zasobami.

Dla ludzi zmienia to równanie zaufania. Zamiast ufać obietnicy producenta, użytkownicy zaczynają ufać gwarancjom ram. Oczekują, że maszyny działające pod tym samym protokołem przestrzegają wspólnych ograniczeń. Jeśli to oczekiwanie się łamie, uszczerbek na reputacji dotyczy nie tylko producenta urządzenia, ale także samej warstwy koordynacji.

Dlatego prawdziwym testem bezpiecznej współpracy człowiek-maszyna nie jest to, czy poszczególne roboty przestrzegają zasad w izolacji. Chodzi o to, czy wspólny system konsekwentnie egzekwuje granice, gdy zachęty są napięte w czasie zmienności rynku, presji politycznej lub szybkiej zmiany technologicznej.

W spokojnych warunkach prawie każda struktura zarządzania wydaje się stabilna. W środowiskach o wysokim ryzyku zakłócenia łańcucha dostaw, reakcja na sytuacje awaryjne, ataki wrogów ujawniają słabości. Latencja weryfikacji staje się krytyczna. Progi decyzyjne mają znaczenie. Procedury awaryjne określają, czy współpraca degraduje płynnie, czy gwałtownie się załamuje.

Dlatego postrzegam ramy Fabric Foundation mniej jako cechę bezpieczeństwa, a bardziej jako strukturalny zakład, że długoterminowe zaufanie do robotyki będzie zależało od weryfikowalnej koordynacji, a nie tylko od reputacji instytucjonalnej. To próba przeniesienia bezpieczeństwa z polityki do protokołu.

Pytanie, które ostatecznie determinuje jego wpływ, nie dotyczy tego, czy ramy są kompleksowe. Chodzi o to, czy jego warstwy zarządzania i weryfikacji mogą pozostać przewidywalne, neutralne i odporne, gdy warunki w rzeczywistym świecie stają się chaotyczne.

Ponieważ bezpieczna współpraca nie jest udowodniona w dokumentach. Jest udowodniona po raz pierwszy, gdy system jest pod presją i nadal się trzyma.

@Fabric Foundation #ROBO $ROBO

#USIsraelStrikeIran #GoldSilverOilSurge