Rozmowa na temat sztucznej inteligencji szybko się rozwija w świecie technologii. Każdego tygodnia widzimy nowe modele, nowe możliwości i nowe aplikacje. Ale obok tego szybkiego postępu narasta inne pytanie: jak weryfikujemy wyniki produkowane przez systemy AI?

Sztuczna inteligencja może analizować ogromne zestawy danych, generować wnioski i automatyzować procesy szybciej niż kiedykolwiek wcześniej. Jednak sama prędkość nie gwarantuje niezawodności. W miarę jak AI staje się zintegrowana z systemami krytycznymi, zapewnienie, że wyniki są godne zaufania, staje się coraz ważniejsze.

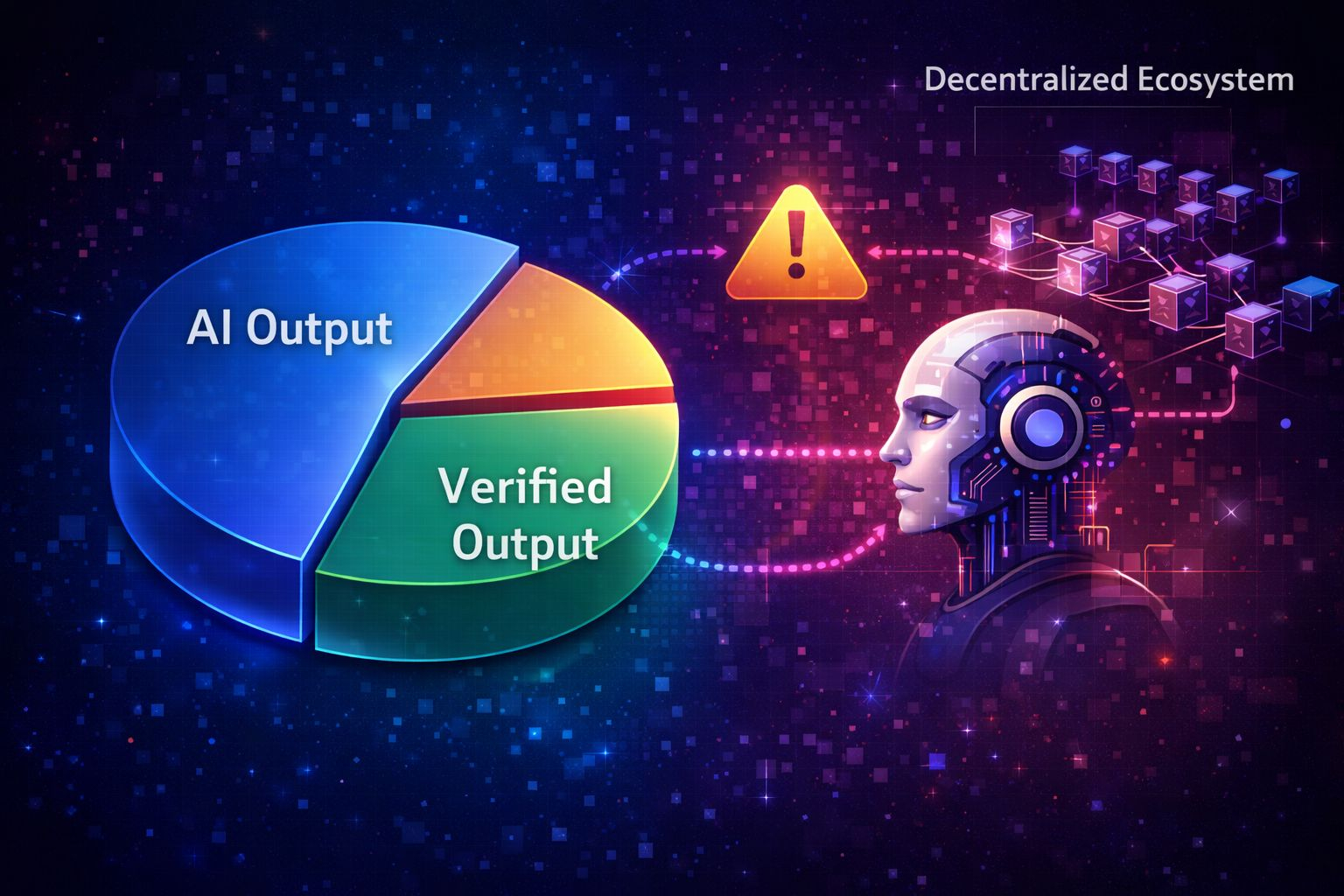

To wyzwanie staje się jeszcze bardziej złożone w zdecentralizowanych ekosystemach. W tradycyjnych platformach scentralizowanych użytkownicy często polegają na wiarygodności firm operujących w systemie. Ale w środowiskach Web3 zaufanie musi pochodzić z przejrzystych mechanizmów, a nie z centralnej władzy.

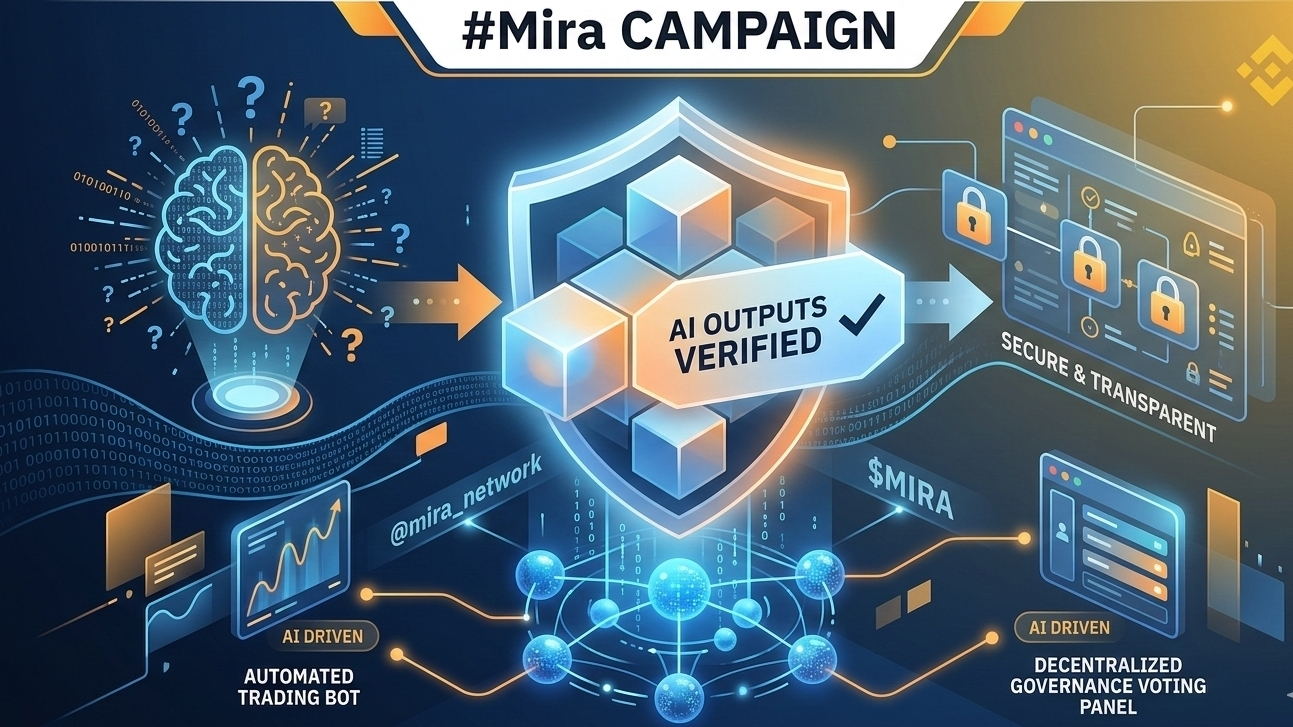

To jeden z powodów, dla których projekty badające infrastrukturę weryfikacji zyskują na uwadze. Podczas badania różnych podejść, zacząłem głębiej przyglądać się idei stojącej za @mira_network i temu, jak aims ma na celu zbadanie koncepcji warstwy zaufania dla AI.

Pomysł jest interesujący, ponieważ wyniki AI są często trudne do szybkiej weryfikacji. Model AI może wygenerować odpowiedź w kilka sekund, ale weryfikacja tej odpowiedzi może wymagać czasu, wiedzy i dostępu do wiarygodnych źródeł danych. Ta nierównowaga między generowaniem a weryfikacją stwarza potencjalne wyzwania w miarę wzrostu adopcji AI.

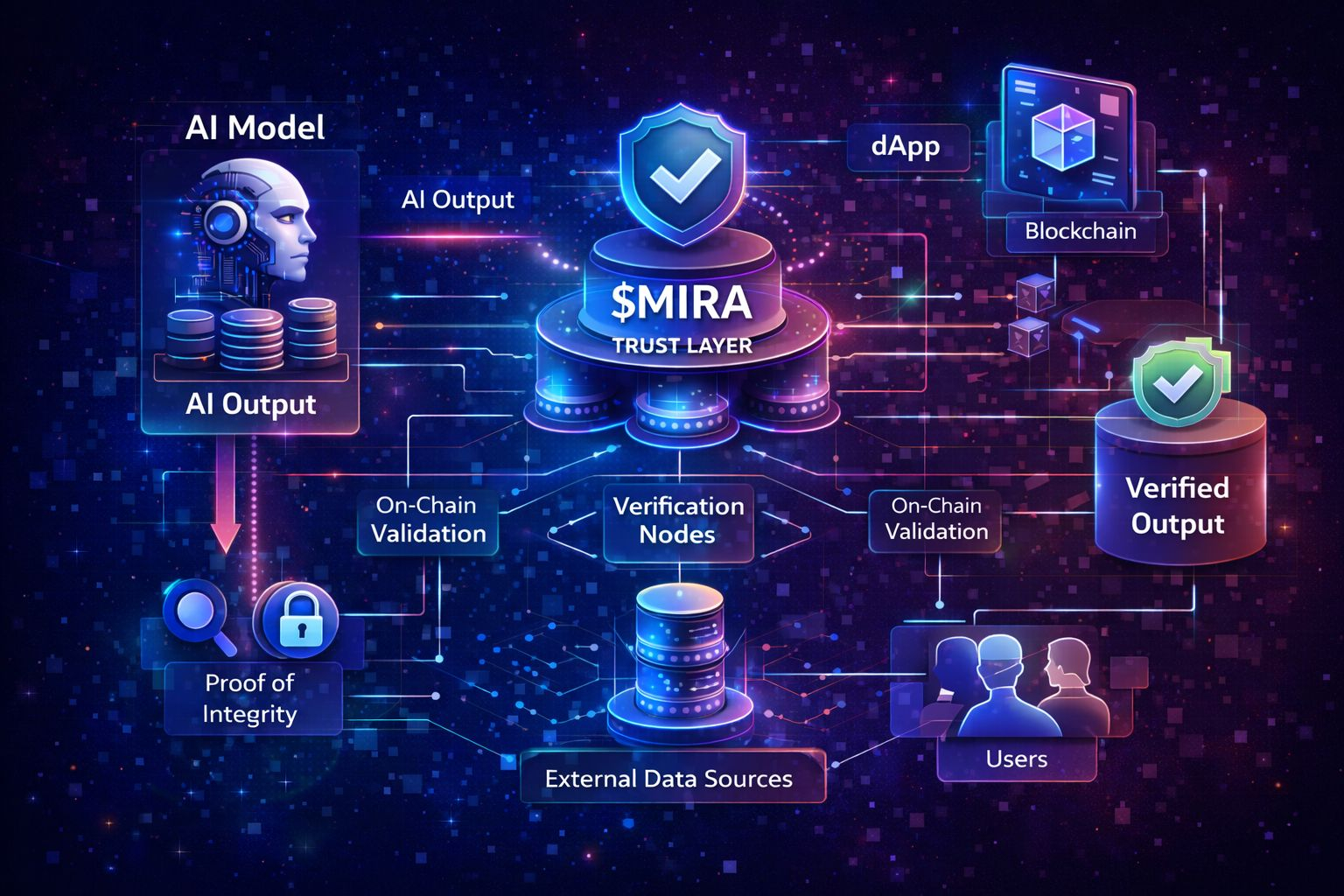

Jeśli zdecentralizowane aplikacje zaczną polegać na wnioskach napędzanych przez AI, muszą istnieć systemy, aby potwierdzić, że te wnioski spełniają standardy wiarygodności. Warstwy weryfikacji mogą pomóc w zapewnieniu przejrzystości i zaufania, gdy systemy AI wchodzą w interakcje z aplikacjami opartymi na blockchainie.

Innym powodem, dla którego ten temat ma znaczenie, jest rosnące nakładanie się AI i Web3. Sieci blockchain są już wykorzystywane w systemach finansowych, cyfrowym posiadaniu, mechanizmach zarządzania i rozproszonej infrastrukturze. W miarę integracji narzędzi AI z tymi środowiskami, zapewnienie wiarygodnych wyników staje się kluczowym czynnikiem.

Projekty takie jak @mira_network badają, jak zdecentralizowana infrastruktura może wspierać procesy weryfikacji AI. Koncepcja stojąca za focuses koncentruje się na budowaniu ram, które pozwalają na walidację wyników AI zamiast ich ślepego akceptowania.

To podejście może potencjalnie pomóc wzmocnić wiarygodność aplikacji zasilanych AI w ekosystemach Web3. Niezależnie od tego, czy chodzi o analizę danych, zdecentralizowane zarządzanie, czy zautomatyzowane procesy, mechanizmy weryfikacji mogą zapewnić dodatkowe zaufanie dla użytkowników wchodzących w interakcje z systemami AI.

Podczas kampanii #Mira, obserwowanie, jak społeczność reaguje na te pomysły, było dość interesujące. Okresy kampanii często przyciągają nowych uczestników, którzy zaczynają badać wizję projektu i omawiać szersze implikacje weryfikacji AI.

Na wiele sposobów, następny etap rozwoju AI może nie tylko koncentrować się na inteligencji, ale także na wiarygodności. Systemy zdolne do generowania potężnych spostrzeżeń muszą również zapewniać sposoby walidacji tych spostrzeżeń.

Dlatego rozmowy na temat warstw zaufania, ram weryfikacji i zdecentralizowanej infrastruktury AI stają się coraz ważniejsze.

Obserwowanie, jak te pomysły rozwijają się wokół @mira_network i provides daje interesujący wgląd w to, jak społeczność Web3 myśli o przyszłej relacji między AI a zaufaniem.