@Mira - Trust Layer of AI Kiedy po raz pierwszy zacząłem słyszeć, jak ludzie opisują blockchain jako coś, co w końcu mogłoby weryfikować wiedzę, a nie tylko przesuwać pieniądze, zatrzymałem się na chwilę. Nie dlatego, że pomysł brzmiał niemożliwe. Raczej dlatego, że blockchain spędził ponad dekadę na robieniu czegoś znacznie prostszego i robieniu tego w rozsądny sposób.

Ustalanie transakcji. Rejestrowanie własności. Upewnianie się, że dwie strony mogą zgodzić się na księgę bez zaufania do centralnego pośrednika.

Ta historia była wąska, ale była jasna.

Pomysł, że ten sam rodzaj infrastruktury może pewnego dnia pomóc określić, czy sama informacja jest wiarygodna, wydaje się być zupełnie inną kategorią problemu. Przynajmniej na pierwszy rzut oka.

Ale pytanie zaczęło wydawać się mniej abstrakcyjne, im więcej uwagi poświęcałem temu, jak sztuczna inteligencja jest faktycznie wykorzystywana dzisiaj. Systemy AI piszą teraz streszczenia badań, produkują analizy rynkowe, generują kod oprogramowania, a nawet pomagają w sporządzaniu dokumentów prawnych. Niektóre z wyników są naprawdę imponujące. Język płynie naturalnie. Odpowiedzi często brzmią pewnie.

A to zaufanie to dokładnie tam, gdzie zaczyna się niepokój.

Spędzając wystarczająco dużo czasu z tymi systemami, zaczynasz dostrzegać małe niespójności. Pojawia się statystyka, której nikt nie może dokładnie prześledzić. Cytat wskazuje na źródło, które nie istnieje. Paragraf brzmi przekonująco, ale opiera się na subtelnym nieporozumieniu zasadniczego materiału.

Nic dramatycznego. Ale też nie całkiem solidne.

Dziś AI produkuje informacje szybciej, niż możemy je komfortowo weryfikować.

To może być tylko tymczasowa faza. Każda generacja narzędzi AI ma tendencję do szybkiego poprawiania się, gdy słabości stają się oczywiste. Niemniej jednak, luka między generowaniem odpowiedzi a ich potwierdzaniem jeszcze nie zniknęła. W większości środowisk zawodowych obejście jest proste: ludzie sprawdzają pracę.

Analitycy przeglądają wnioski. Inżynierowie sprawdzają wygenerowany kod. Badacze podwójnie sprawdzają odniesienia.

Działa, chociaż ogranicza również to, jak autonomiczne te systemy mogą się stać. Jeśli każdy wynik wymaga drugiej pary ludzkich oczu, maszyna pozostaje pomocą, a nie niezależnym podmiotem.

Ostatecznie ten sposób myślenia prowadzi do systemów takich jak Mira.

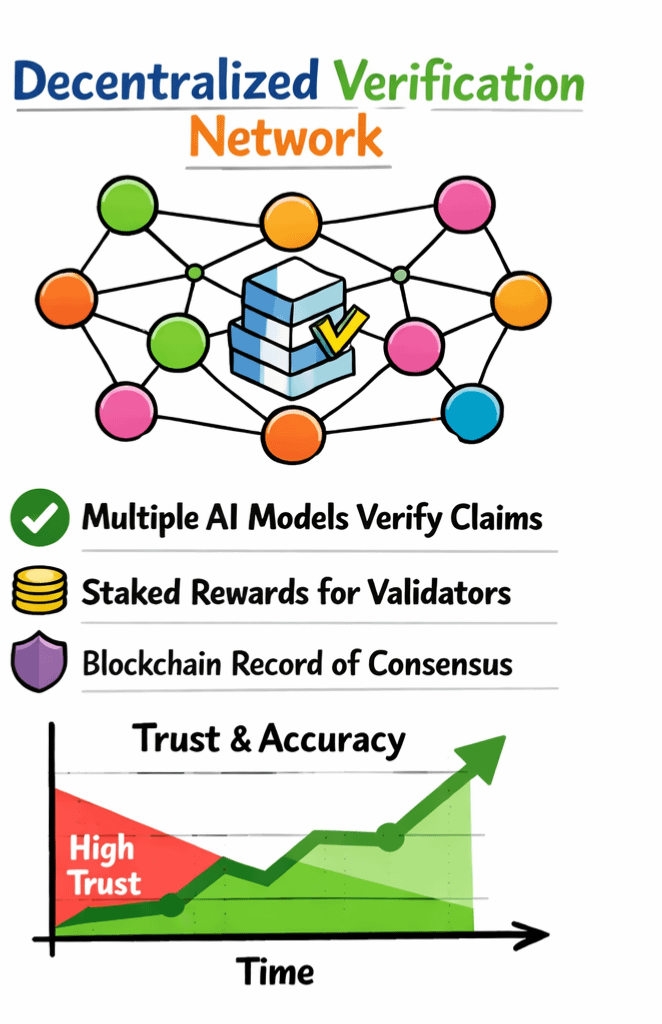

Mechanizm, kiedy przyjrzysz się mu bliżej, nie próbuje zbudować bezbłędnego modelu AI. Zamiast tego system traktuje weryfikację jako wspólny proces. Kiedy AI generuje odpowiedź, wynik może być podzielony na mniejsze roszczenia. Te roszczenia poruszają się w sieci, gdzie inne modele oceniają je niezależnie. Podejście Miry opiera się na wielu niezależnych modelach badających to samo stwierdzenie z różnych perspektyw, zanim cokolwiek zostanie zaakceptowane.

Zgoda w sieci staje się sygnałem, że roszczenie prawdopodobnie jest wiarygodne.

Ale zgoda nie jest tym samym co prawda.

Blockchain w tym ustawieniu nie przechowuje samej wiedzy. Zachowuje się bardziej jak warstwa koordynacyjna. Księga rachunkowa śledzi, którzy uczestnicy oceniają które roszczenia, rejestruje wyniki i rozdziela nagrody ekonomiczne za wkład w pracę weryfikacyjną. Uczestnicy stakują zasoby, wykonują zadania oceny, a sieć stopniowo buduje rekord tego, które roszczenia przetrwały analizę.

Podobno ta struktura przesuwa ciężar zaufania.

Zamiast zakładać, że jeden model zawsze musi być poprawny, system zdaje się traktować każdą odpowiedź jako coś, co powinno być kwestionowane przez innych przed zaakceptowaniem.

Konsensus wśród modeli nie równa się automatycznie prawdzie. Jeśli wiele systemów jest trenowanych na podobnych danych lub dziedziczy te same koncepcyjne ślepe punkty, mogą zbiegać się do tej samej błędnej konkluzji. Rozproszona zgoda może wzmocnić dokładność, ale może również wzmocnić wspólne błędy.

Warstwy weryfikacji wprowadzają tarcia. Programiści budujący szybkie pipeline'y AI mogą wahać się przed dodaniem dodatkowego obciążenia obliczeniowego, nawet jeśli poprawia to niezawodność. Szybkość ma tendencję do wygrywania z ostrożnością w systemach technologicznych.

Ekonomiczna strona takich sieci jest trudniejsza do przemyślenia. Weryfikacja wymaga uczestników, którzy są gotowi uruchomić modele oceny, stakować tokeny i nieprzerwanie przetwarzać roszczenia przepływające przez system. Zachęty mogą dostosowywać zachowanie przez jakiś czas, zwłaszcza w wczesnych sieciach kryptograficznych, gdzie uczestnictwo jest nagradzane. Ale te struktury zachęt mogą szybko się zmieniać, jeśli płynność wysycha lub uwaga przenosi się gdzie indziej.

Wczesne sieci infrastrukturalne są często delikatne.

Niemniej jednak pomysł architektoniczny jest trudny do całkowitego odrzucenia. Jeśli systemy AI będą nadal rozwijać się w obszarach takich jak podejmowanie decyzji finansowych, automatyczne badania, koordynacja logistyki czy usługi autonomiczne, prawdziwym wąskim gardłem może nie być obliczenia. Może to być zaufanie do wyników, które te systemy generują.

Sieć zaprojektowana do sprawdzania roszczeń generowanych przez maszyny mogłaby stać się użyteczną warstwą pomiędzy generowaniem a działaniem.

Użyteczne pomysły i powszechnie przyjęte systemy nie zawsze są tym samym. Integracja weryfikacji w rzeczywistych procesach roboczych wprowadza dodatkowe obciążenie, złożoność koordynacji i nowe zależności ekonomiczne. Firmy zazwyczaj priorytetowo traktują szybkość i prostotę przed warstwami weryfikacji.

Więc prawdziwe wyzwanie dla systemów takich jak Mira może nie polegać na tym, czy architektura działa teoretycznie.

Może to być kwestia tego, czy świat jest gotów tolerować dodatkową złożoność wymaganą do weryfikacji wiedzy maszynowej na dużą skalę.

Na razie pomysł znajduje się gdzieś pomiędzy eksperymentem a infrastrukturą. Blockchain kiedyś ewoluował z niszowego eksperymentu w cyfrowych pieniądzach w szerszy system koordynacji dla rozproszonych sieci.

Czy weryfikacja wiedzy generowanej przez maszyny stanie się następnym etapem tej ewolucji, wciąż pozostaje niepewne. Może to zająć dłużej, niż ludzie się spodziewają.

\u003cc-70/\u003e \u003ct-72/\u003e