W ciągu ostatniego roku rozmowa o AI w kryptowalutach głównie podążała przewidywalnym wzorcem. Pojawiają się nowe modele, nowe tokeny są uruchamiane, a każdy projekt twierdzi, że buduje nową generację inteligentnych systemów na łańcuchu. Ale pod całym tym podekscytowaniem pozostaje nierozwiązany znacznie głębszy problem.

Jak możesz ufać wynikom AI w zdecentralizowanym systemie?

Modele AI są potężne, ale są również nieprzejrzyste. Produkują odpowiedzi, prognozy i decyzje, nie ujawniając wewnętrznego rozumowania, które doprowadziło do tych wyników. W tradycyjnych środowiskach nie zawsze stanowi to problem, ponieważ scentralizowane instytucje działają jako ostateczna władza weryfikująca wyniki.

Web3 nie działa w ten sposób.

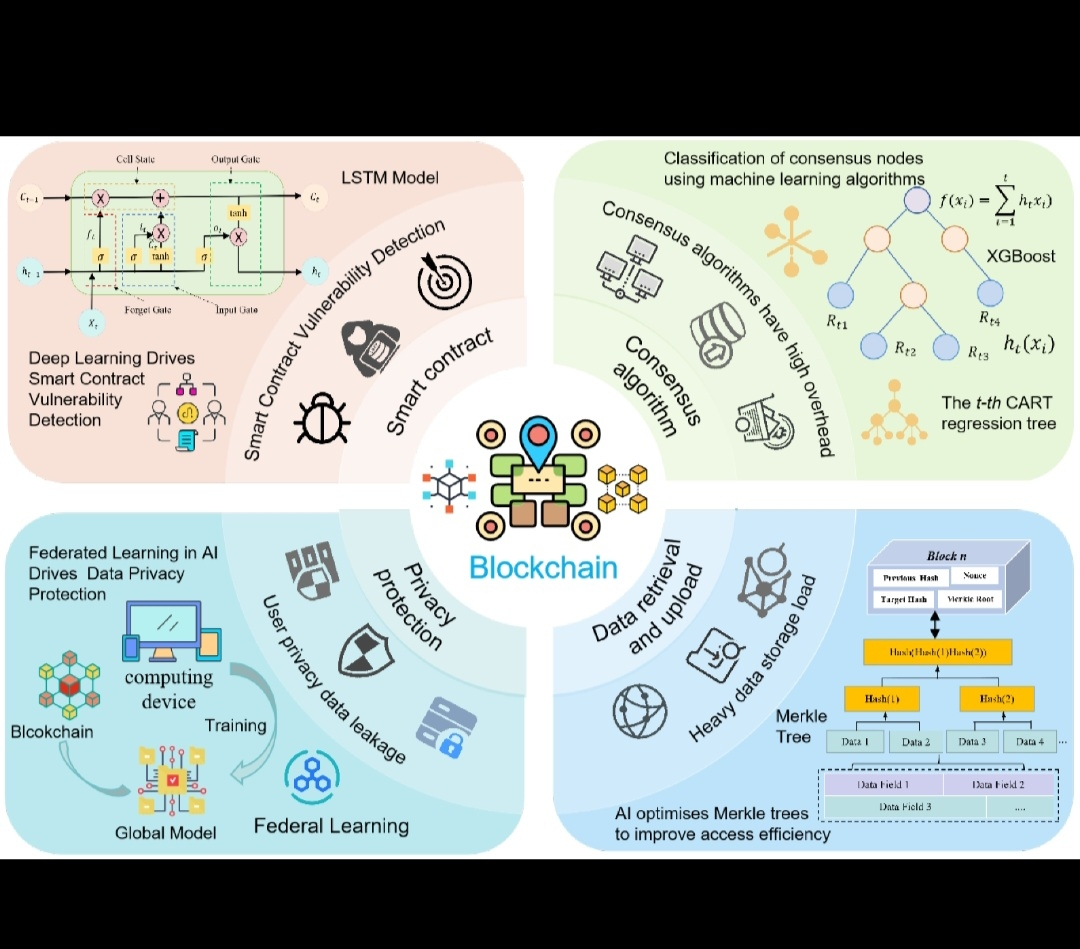

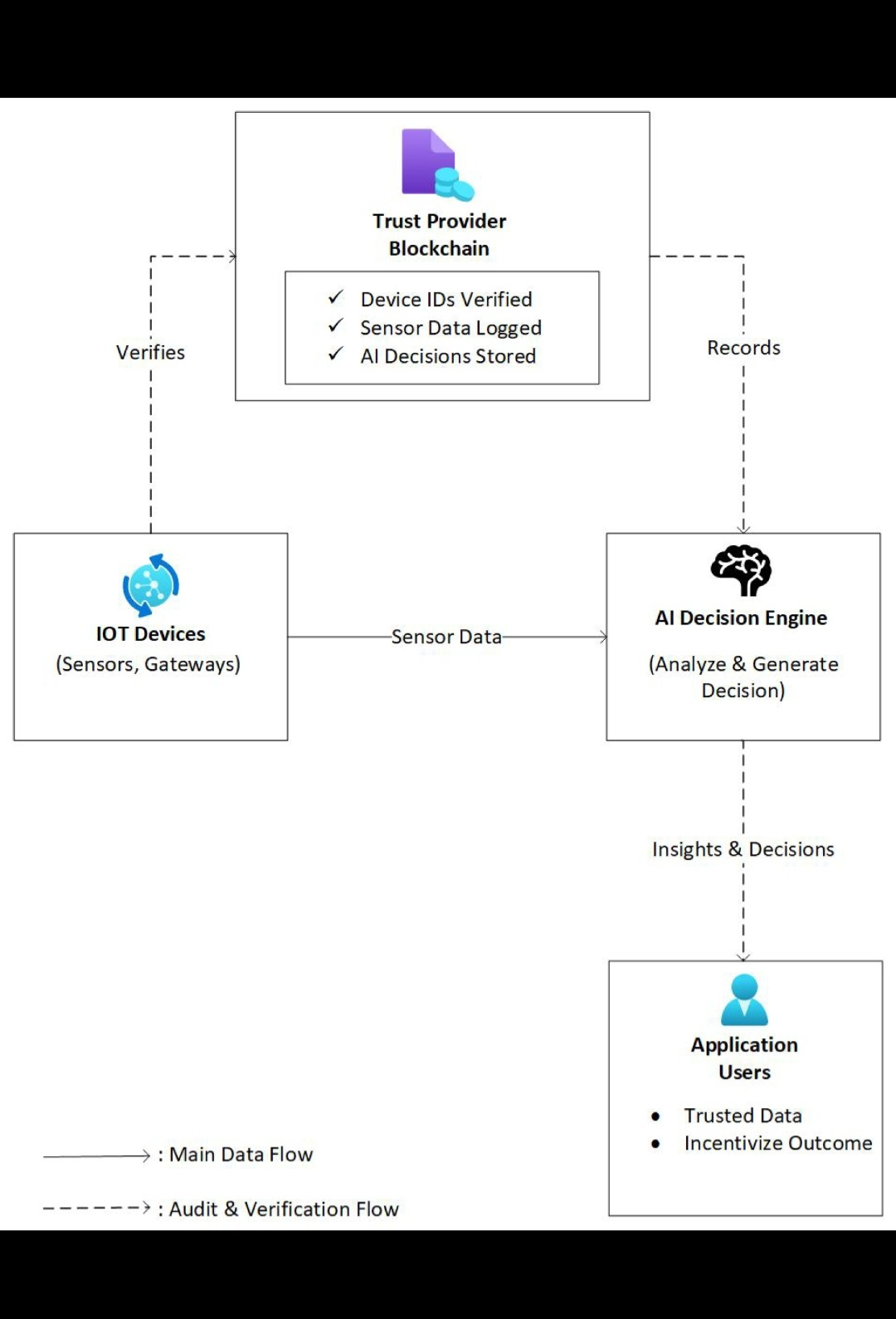

W zdecentralizowanych systemach zaufanie musi pochodzić z weryfikowalnych procesów, a nie z centralnej akceptacji. Smart kontrakty wykonują deterministyczną logikę. Blockchainy weryfikują każdą transakcję. Warstwy dostępności danych gwarantują, że informacje mogą być niezależnie weryfikowane.

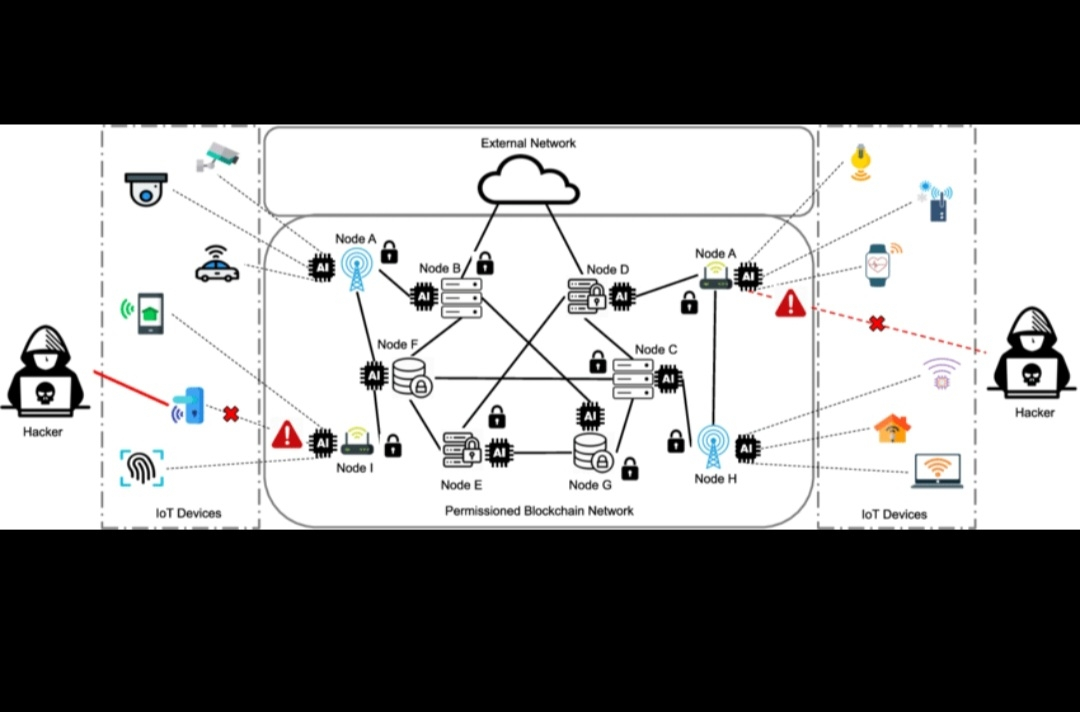

Ale kiedy AI wchodzi do tego ekosystemu, pojawia się nowe wyzwanie: wyniki AI są probabilistyczne, a nie deterministyczne.

To tworzy fundamentalną sprzeczność.

Blockchainy są zaprojektowane do weryfikowalnych obliczeń, podczas gdy systemy AI generują wyniki, które nie mogą być łatwo udowodnione jako poprawne. A jeśli wyniki AI nie mogą być zweryfikowane, stają się niezwykle trudne do zintegrowania z zdecentralizowanymi systemami finansowymi, mechanizmami rządowymi czy zautomatyzowaną infrastrukturą.

To dokładnie tutaj $MIRA zaczyna wyróżniać się.

Zamiast koncentrować się na budowaniu kolejnego modelu AI lub rywalizować w zatłoczonej dziedzinie inteligencji generatywnej, Mira podchodzi do problemu z zupełnie innej perspektywy. Jej celem nie jest sama inteligencja, ale warstwa zaufania ją otaczająca.

Mówiąc prosto, Mira pracuje nad tym, aby wyniki AI były weryfikowalne, audytowalne i niezawodne w zdecentralizowanych systemach.

To może brzmieć jak wąski problem techniczny, ale implikacje są znacznie większe, niż się wydaje.

Wyobraź sobie przyszłość, w której agenci AI zarządzają strategiami płynności, oceniają parametry ryzyka w protokołach pożyczkowych lub generują sygnały dla zautomatyzowanych systemów handlowych. Te systemy mogłyby działać ciągle w zdecentralizowanych sieciach, analizując ogromne zbiory danych i reagując na warunki rynkowe znacznie szybciej niż ludzie.

Ale nic z tego nie może działać, jeśli wyniki tych systemów AI nie mogą być ufne.

Bez weryfikacji decyzje napędzane przez AI stają się potencjalnymi punktami awarii.

Błędna prognoza modelu może wywołać nieprawidłowe likwidacje. Manipulowany zestaw danych może wpływać na decyzje rządowe. Złośliwi aktorzy mogą wdrażać systemy AI, które generują mylące wyniki zaprojektowane w celu wykorzystania zautomatyzowanych protokołów.

Innymi słowy, AI bez weryfikacji staje się ryzykiem systemowym dla zdecentralizowanych systemów.

Architektura Miri radzi sobie z tym wyzwaniem, wprowadzając mechanizmy, które pozwalają na walidację wyników AI poprzez zdecentralizowane procesy weryfikacji. Zamiast ślepo akceptować wyniki jednego modelu, wyniki mogą być sprawdzane, potwierdzane i weryfikowane krzyżowo przed ich integracją w podejmowaniu decyzji na łańcuchu.

Ten koncept skutecznie przekształca AI z czarnej skrzynki w coś bliższego udowodnionej usłudze obliczeniowej.

Znaczenie tej zmiany nie może być przeceniane.

Jeśli wyniki AI mogą być weryfikowane w zdecentralizowanym środowisku, mogą być bezpiecznie integrowane w szerokim zakresie aplikacji Web3. Autonomiczne agenty handlowe mogłyby wdrażać strategie oparte na zweryfikowanych sygnałach. Zdecentralizowane sieci danych mogłyby polegać na modelach klasyfikacji AI, nie wprowadzając założeń zaufania. Systemy rządowe mogłyby włączać analizy AI, zachowując jednocześnie przejrzystość.

W każdym z tych przypadków weryfikacja staje się brakującym mostem między sztuczną inteligencją a zdecentralizowaną infrastrukturą.

A ten most to dokładnie przestrzeń, którą Mira próbuje zbudować.

Co czyni to szczególnie interesującym, to fakt, że szerszy rynek kryptowalut nie w pełni pochłonął jeszcze znaczenie tej warstwy. Większość dyskusji nadal krąży wokół tokenów AI związanych z rozwojem modeli, rynkami danych lub sieciami obliczeniowymi.

Ale te systemy rozwiązują tylko część równania.

Nawet najnowocześniejszy model jest bezużyteczny w zdecentralizowanych systemach, jeśli jego wyniki nie mogą być ufne.

W wielu aspektach Mira zajmuje się tą samą kategorią problemu, którą orakle rozwiązały dla zewnętrznych danych. Zanim istniały zdecentralizowane orakle, smart kontrakty nie mogły niezawodnie uzyskiwać informacji ze świata rzeczywistego. Ceny, dane o pogodzie czy metryki off-chain wymagały zaufanych pośredników.

Sieci Oracle zmieniły tę dynamikę, tworząc systemy, w których dane mogły być weryfikowane poprzez zdecentralizowany konsensus.

Mira wydaje się badać podobny koncept, ale dla informacji generowanych przez AI zamiast surowych danych.

Jeśli ten model zadziała, może wprowadzić zupełnie nową warstwę infrastruktury w ramach Web3.

Modele AI generują spostrzeżenia. Sieci weryfikacyjne je walidują. Smart kontrakty następnie wykorzystują te wyniki do podejmowania decyzji.

Razem te komponenty tworzą możliwość zaufanych autonomicznych systemów działających w zdecentralizowanych sieciach.

A ta wizja zbliża kryptowaluty znacznie bliżej do czegoś, o czym przemysł mówił od lat, ale rzadko osiągał w praktyce: naprawdę autonomicznych cyfrowych gospodarek.

Oczywiście, budowanie infrastruktury zaufania rzadko jest efektowne. Sieci Oracle zajęły lata, zanim rynek w pełni zrozumiał ich znaczenie. Warstwy dostępności danych były ignorowane, aż problemy ze skalowaniem zmusiły deweloperów do uznania ich wartości.

Warstwy weryfikacji dla AI mogą podążać podobną trajektorią.

Są to technologie podstawowe — takie, które stają się kluczowe długo przed tym, jak staną się popularne.

Z tej perspektywy pozycjonowanie Miri staje się szczególnie przekonujące.

Zamiast rywalizować w hałaśliwym wyścigu o zbudowanie najinteligentniejszego modelu AI, próbuje rozwiązać głębszy problem strukturalny, który zdeterminuje, czy AI może rzeczywiście funkcjonować w zdecentralizowanych systemach na dużą skalę.

A jeśli Web3 nadal będzie się przesuwać w kierunku zautomatyzowanych rynków, infrastruktury napędzanej AI i autonomicznych agentów finansowych, potrzeba weryfikowalnej inteligencji tylko się wzmocni.

Ponieważ w zdecentralizowanych systemach sama inteligencja nigdy nie wystarcza.

Musisz mu ufać.