@Fabric Foundation $ROBO #ROBO

周六的早晨,阳光刚好越过阳台的百叶窗,在地板上切出一道道慵懒的金光。难得的周末,没有夺命连环的会议邀请,也没有永远清不空的未读邮件。

厨房里,我正在观察角落里那台处于测试阶段的辅助机械臂——我习惯叫它“小 R”。作为一套生活辅助系统的端侧设备,它正准备执行一个看似再简单不过的指令:为我倒一杯热咖啡。

小 R 的摄像头精准地锁定了咖啡壶的把手,机械爪以预设的角度张开、闭合,平稳地举起咖啡壶。它的动作流畅得如同流水线上的工业老手。接着,它将壶嘴对准了桌面上的马克杯,倾斜,褐色的液体带着香气倾泻而下。

一切都很完美,直到最后半秒钟。

今天,我临时换了一个新买的骨瓷杯。它的表面釉质极度光滑,而且杯底有一点点昨晚洗过未干的水渍。当咖啡注入,杯身重心发生微妙偏移,加上杯底与大理石台面摩擦力陡降,杯子毫无预兆地向左滑动了两厘米。

小 R 的视觉传感器捕捉到了杯子的位移,但它的控制算法还在执行“倾倒液体”的后半段程序。它的大脑在这一瞬间卡壳了:是该立刻停止倾倒?还是去追逐移动的杯子?

零点几秒的延迟后,咖啡无情地浇在了台面上,顺着边缘滴答滴答地落在地板上。

我拿过抹布一边清理,一边却忍不住笑了。这滩溢出的咖啡不仅没有搞砸我的早晨,反而让我极其直观地看到了一个困扰科技界多年的终极难题,也正是 Robo 项目(具身智能与通用机器人平台) 试图跨越的那道天堑——莫拉维克悖论(Moravec's paradox)。

在数字世界里,AI 可以秒解极其复杂的微积分,能写出辞藻华丽的诗歌,甚至能战胜人类最顶尖的围棋大师;但在真实的物理世界里,让一个机器人感知到杯子的滑动并瞬间做出“像人一样”的肌肉微调,却难如登天。

这滩咖啡,正是 Robo 项目从“概念”走向“伟大”的破局点。今天,我们就从这件生活小事切入,深度拆解 Robo 项目背后的技术逻辑、架构重构以及它所描绘的未来图景。

一、 破局:从“代码逻辑”到“物理直觉”

传统机器人(比如工厂里的机械臂)是典型的“死记硬背”型选手。它们依赖极其精确的坐标系和预先写好的脚本。在无干扰的环境下,它们是神;但一旦放入充满变量的人类生活场景——哪怕只是一个底座打滑的杯子——它们就会瞬间变成智障。

Robo 项目的核心愿景,就是赋予机器“物理直觉”。

它不再试图穷举所有可能发生的意外(因为现实世界的变量是无穷的),而是通过一套全新的具身智能(Embodied AI)架构,让机器学会在动态环境中实时感知、判断和反应。它要实现的是从“执行既定程序”向“理解物理常识”的跨越。

为了做到这一点,Robo 项目在底层架构上进行了大刀阔斧的重构。

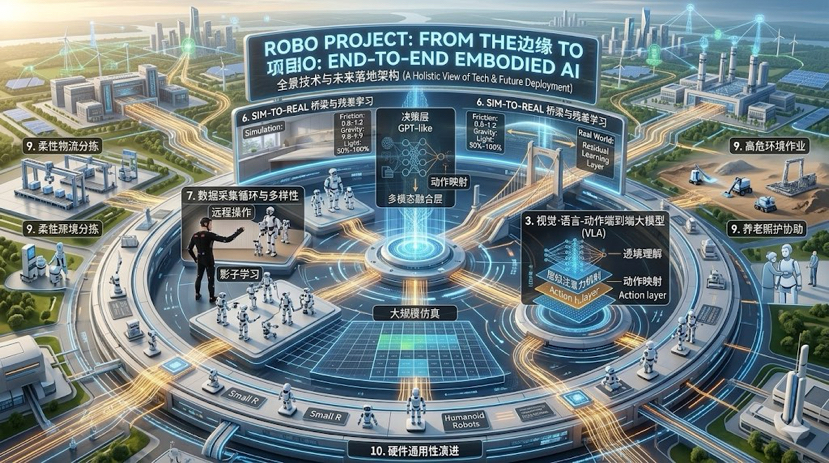

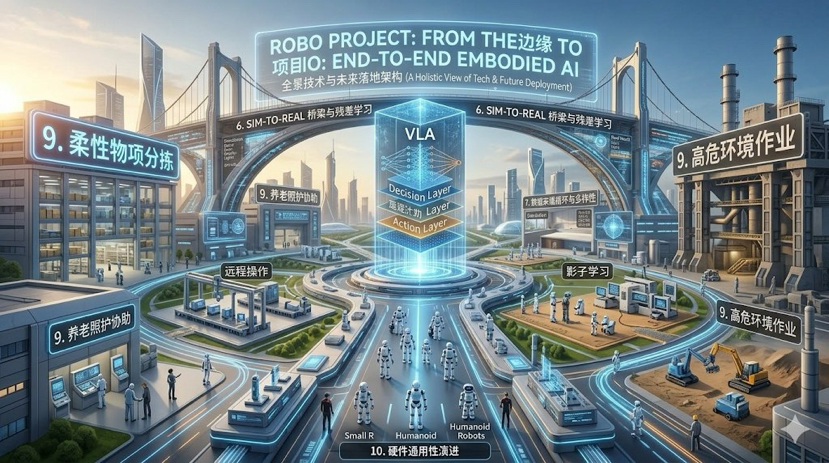

二、 核心重构:Robo 项目的“三位一体”架构

要让机器人接住那杯快要洒掉的咖啡,Robo 项目在技术栈上搭建了三个至关重要的模块:感知层、决策层与执行层。这并非传统意义上的分层,而是高度耦合的“三位一体”。

1. 多模态视触觉感知网络 (VTPN - Visual-Tactile Perception Network)

小 R 失败的原因之一,是它只“看”到了杯子,却没有“感觉”到它。Robo 项目彻底抛弃了单一的视觉依赖。

• 高频视觉流:不再是每秒处理几张静态图片,而是引入事件相机(Event Camera)级别的动态捕捉,专注于捕捉视野内的“变化”而非“全局背景”,极大地降低了算力开销。

• 高分辨率触觉反馈:在机械执行末端(比如夹爪)集成高密度柔性传感器。当夹爪接触杯子时,它不仅能感知到“抓住了”,还能感知到“摩擦力系数”、“温度”甚至“材质的微小形变”。

• 空间声学感知:液体倾倒的声音变化、物体滑动的细微摩擦声,都被纳入感知大模型中,作为视觉盲区的重要补充。

2. 视觉-语言-动作端到端大模型 (VLA - Vision-Language-Action Model)

这是 Robo 项目的“大脑”,也是最具革命性的一环。传统机器人是将视觉信息转化为代码逻辑,再通过代码控制电机。这个过程漫长且容易信息丢失。

Robo 项目采用了端到端(End-to-End)的架构。你可以把它理解为一个被装进钢铁躯壳里的 ChatGPT,但它输出的不再是文字,而是动作(Actions)。

• 语境理解:当用户说“给我倒杯咖啡,别洒了”,大脑会将其转化为连续的物理预期。

• 直接映射:模型直接接收摄像头像素和触觉信号输入,经过神经网络的“黑盒”计算,直接输出各个关节的扭矩和速度指令。这省去了复杂的逆运动学方程求解过程,大大缩短了延迟(Latency)。

3. 柔性与阻抗控制执行器 (Compliant Actuation)

有了聪明的脑子,还需要敏捷的四肢。当杯子滑动的瞬间,机械臂不应该继续死板地停在半空中,而是应该像人类手臂一样,具有“柔顺性”。

• 动态阻抗控制:Robo 项目的硬件驱动不再追求绝对的位置刚性,而是允许机器人在遇到意外阻力(或失去阻力)时,顺势而为。

• 高频微调:以 500Hz 甚至更高的频率进行控制环路刷新。在杯子滑动的 0.1 秒内,执行器已经收到了大脑几十次的修正指令,手腕会本能地跟随杯子移动,或者迅速回抽切断水流。

三、 跨越鸿沟:数据飞轮与 Sim-to-Real 挑战

架构再好,没有数据也是空壳。大语言模型可以吃互联网上的文本长大,但 Robo 项目需要的“物理交互数据”在互联网上是根本不存在的。你无法通过让机器人看一万小时的李子柒做饭视频,就指望它学会切土豆。

Robo 项目的壁垒,就建立在它极其庞大且高效的数据获取与迁移闭环上。

1. 遥操作(Teleoperation)与影子学习

在项目初期,核心数据来源于人类的“言传身教”。操作员穿戴带有触觉反馈的动捕设备,像玩 VR 游戏一样远程控制机器人去倒咖啡、折衣服、拧螺丝。

机器人在这个过程中,记录下人类在面对“打滑”、“掉落”、“尺寸不合”时的每一次微小修正。这些高质量的“专家轨迹数据(Expert Trajectories)”是 Robo 大模型的启蒙教材。

2. 仿真训练(Simulation)中的上帝视角

物理世界收集数据太慢了。Robo 项目构建了极度逼真的物理引擎仿真环境(Sim)。在赛博空间里,一万台虚拟的小 R 正在同时倒咖啡。

• 域随机化(Domain Randomization):系统会疯狂改变虚拟环境中的变量——杯子变成玻璃的、桌子变成倾斜的、重力稍微改变、光线变暗。机器人在经历了千万次的失败后,利用强化学习(Reinforcement Learning)总结出一套最具鲁棒性的动作策略。

3. Sim-to-Real 的惊险一跃

将虚拟世界练就的绝世武功带入现实,是 Robo 项目最惊艳的一笔。由于现实世界的物理法则(空气阻力、电机磨损、未知的微小震动)永远无法被 100% 模拟,系统采用了“残差学习(Residual Learning)”。大模型给出基础动作框架,而边缘侧的小模型根据现实反馈进行实时的差值修正。

四、 Robo 项目的商业化图景:不止于厨房

虽然一杯咖啡引发了这场思考,但 Robo 项目的野心绝不仅仅局限于做一个高级的家庭保姆。当“通用物理交互能力”被解锁,一个万亿级别的市场将被重构。

• 柔性制造与智能物流:面对形状不一、大小随机的包裹和零件,传统机械臂需要昂贵的定制夹具。Robo 驱动的机器人只需“看一眼”,就能自主规划抓取策略,彻底解放非标产品的分拣瓶颈。

• 高危环境作业:在核辐射区域清理、深海勘探或灾后废墟救援中,面对极其复杂和未知的物理环境,具备动态适应能力的 Robo 机器人将成为人类双手的延伸。

• 康复与养老照护:这可能是最有温度的落地场景。面对脆弱的人体,机器必须具备极致的“柔性”和“同理心算法”。搀扶老人、协助翻身,这些容错率为零的动作,正是 Robo 多模态感知和柔顺控制的终极考场。

五、 写在最后:当魔法变成日常

收拾完地上的咖啡,我重新洗了那个骨瓷杯,擦干杯底,换了一个表面粗糙的马克杯。这一次,小 R 顺利地完成了任务。热气腾腾的咖啡香再次弥漫在周六的早晨。

技术的进步,往往不是以一种惊天动地的方式降临,而是悄无声息地融入生活。当我们不再惊讶于手机能听懂我们说话,不再惊讶于汽车能在高速上自己居中行驶时,这就是科技胜利的标志。

对于 Robo 项目而言,它真正成功的验收标准,不是在发布会上演示后空翻,也不是在实验室里完成多么复杂的精密组装。而是某一个平凡的早晨,当桌上的咖啡杯再次意外滑动时,厨房里的机械臂能像一个老朋友一样,极其自然地伸手扶住它,然后稳稳地倒满一杯醇香的咖啡。

整个过程波澜不惊,理所当然。