Oglądałem wiele projektów, które mówią o zachowaniu prywatności naszych informacji. Często twierdzą, że mogą pomóc w wielu sprawach, ale gdy prosisz o konkretny przykład, nie mogą go podać. Midnight jest inny, ponieważ stara się rozwiązać problemy, z którymi ludzie zmagają się w tej chwili—jak pomoc w sztucznej inteligencji, dzielenie się informacjami zdrowotnymi i zapewnienie, że banki przestrzegają zasad. To nie są tylko pomysły; to problemy, na które organizacje wydają znaczące pieniądze, aby je naprawić.

To, co mnie interesuje w Midnight, to fakt, że stara się rozwiązać te problemy w praktyczny sposób.

Część dotycząca sztucznej inteligencji to temat, o którym chciałbym porozmawiać, ponieważ jest to najciekawszy przykład i jednocześnie ten, który podkreśla największe wyzwanie w planie Midnight.

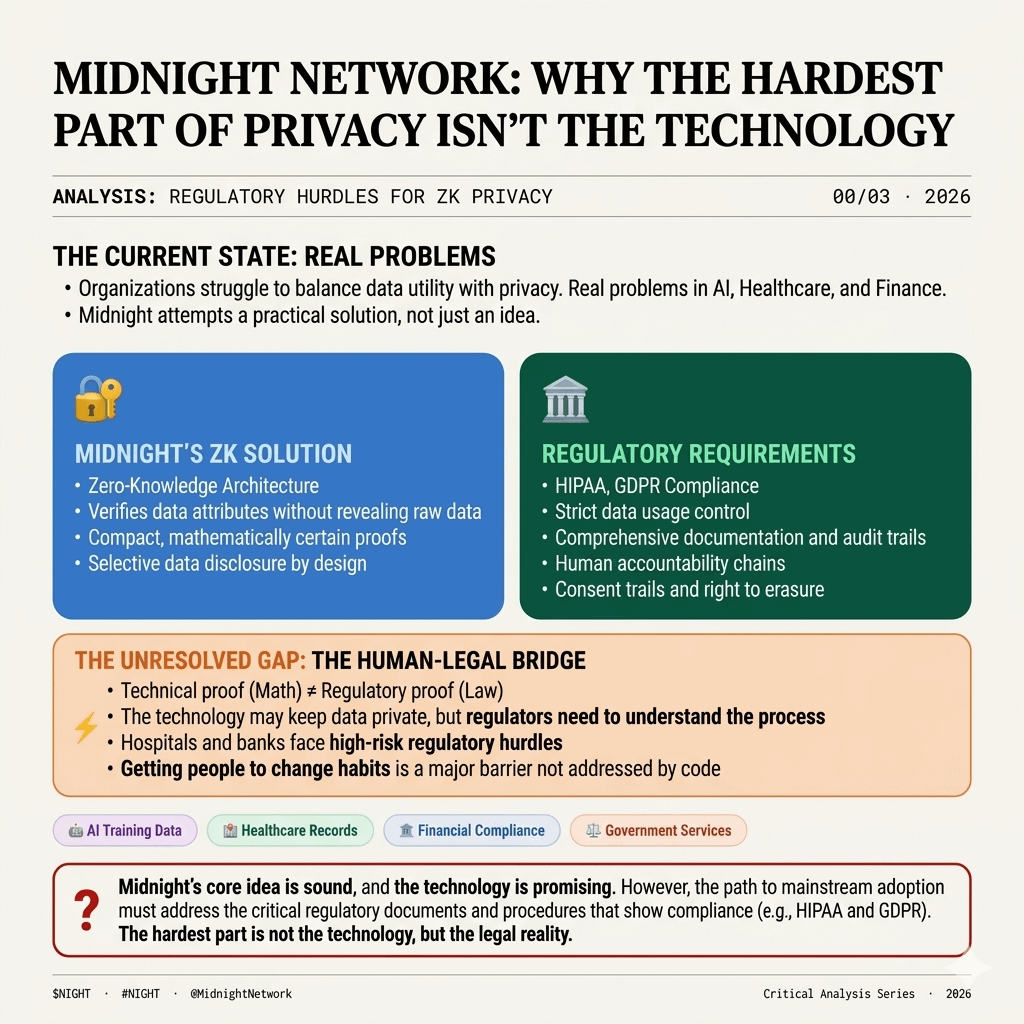

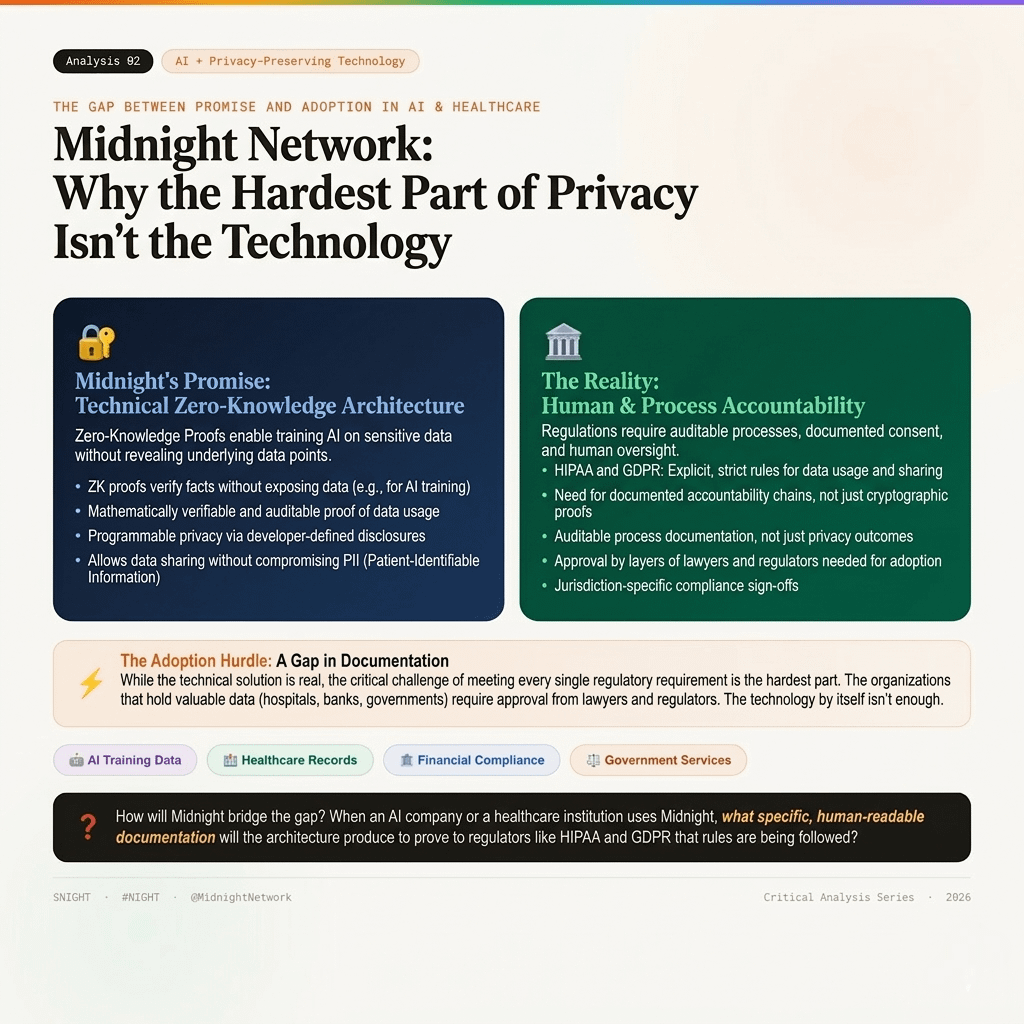

Midnight sugeruje, że sztuczna inteligencja jest powstrzymywana, ponieważ ludzie nie ufają jej swoimi informacjami. Aby trenować AI, potrzebujesz ogromnej ilości danych, ale ludzie i organizacje są zrozumiale ostrożni w kwestii tego, jak ich informacje są wykorzystywane. Rozwiązaniem Midnight jest użycie czegoś, co nazywa się "prywatnością", aby zapewnić odpowiedzialne zarządzanie danymi. Technologia, którą stosują — zwana architekturą zero-knowledge — pozwala AI na uczenie się na danych bez tego, aby osoba prowadząca AI kiedykolwiek zobaczyła rzeczywiste wrażliwe informacje. To brzmi, jakby mogło naprawdę rozwiązać problem zaufania.

Jednak to tutaj sprawy się komplikują. Organizacje, które posiadają najcenniejsze dane do trenowania AI, to duże podmioty, takie jak szpitale, banki i rządy. Aby skłonić te organizacje do zmiany sposobu zarządzania danymi, Midnight musi przejść przez długą serię kroków, takich jak uzyskanie zgody od prawników i zapewnienie, że każdy przepis jest spełniony. Chociaż techniczna strona rozwiązania Midnight jest realna, skłonienie ludzi do rzeczywistego przyjęcia i używania go jest znacznie trudniejszym problemem, którego Midnight nie naprawdę porusza.

Kiedy patrzysz na opiekę zdrowotną, ten problem staje się jeszcze bardziej oczywisty. Midnight twierdzi, że może pomóc w dzieleniu się informacjami zdrowotnymi między osobami a organizacjami bez narażania prywatnych danych. To jest prawdziwy problem; gdy pacjenci odwiedzają różnych lekarzy, dzielenie się historią medyczną pozostaje trudne. Ale informacje zdrowotne nie są tylko prywatne; są ściśle regulowane przez przepisy takie jak HIPAA w Stanach Zjednoczonych i GDPR w Europie. Te przepisy określają dokładnie, jak dane pacjentów mogą być używane i udostępniane. Nawet jeśli technologia Midnight może udowodnić, że informacje pacjenta pozostają prywatne, nie jest jeszcze jasne, czy to będzie wystarczające, aby zadowolić regulatorów.

Dokumenty Midnight stwierdzają, że "programowalna prywatność" może rozwiązać problem braku dzielenia się informacjami zdrowotnymi. Chciałbym w to wierzyć. Problem polega na tym, że posiadanie dobrej technologii po prostu nie wystarczy. Większość projektów próbujących rozwiązać to utknęła, ponieważ nie mogą spełnić każdego pojedynczego wymagania regulacyjnego.

Ten sam problem istnieje w przypadku AI. Nawet jeśli technologia Midnight udowodni, że dane są przechowywane prywatnie, firma korzystająca z AI nadal musi wyjaśnić regulatorom i prawnikom, w jaki sposób te dane są przetwarzane. Midnight jeszcze nie wyjaśniło, jak połączy swoje techniczne rozwiązanie z tymi ciężkimi wymaganiami regulacyjnymi.

Pomysł stojący za Midnight jest silny, a technologia zmierza w dobrym kierunku. Opieka zdrowotna i AI są dokładnie tam, gdzie ta innowacja jest potrzebna. Prawdziwe pytanie brzmi: Jak Midnight zapewni, że jego technologia spełnia różnorodne wymagania regulacyjne różnych krajów i regionów?

Kiedy instytucja opieki zdrowotnej lub firma AI korzysta z technologii Midnight, jaką dokumentację wyprodukuje, aby pokazać, że przestrzega zasad, takich jak HIPAA i GDPR?#nighat #NIGHT $NIGHT @MidnightNetwork