Spędzam większość swojego czasu, patrząc na protokoły nie jako narracje, ale jako systemy, które ostatecznie stają w obliczu presji. Rynki stosują tę presję w subtelny sposób: poprzez zachęty dla użytkowników, ograniczenia infrastrukturalne, zachowania władzy oraz cichą akumulację złożoności operacyjnej. Kiedy patrzę na protokół Fabric przez ten pryzmat, to co wyróżnia się, to nie ambicja budowania sieci dla robotów. Ambicja jest tania w kryptowalutach. To, co ma znaczenie, to struktura, która próbuje koordynować maszyny, dane i podejmowanie decyzji poprzez weryfikowalną obliczeniową.

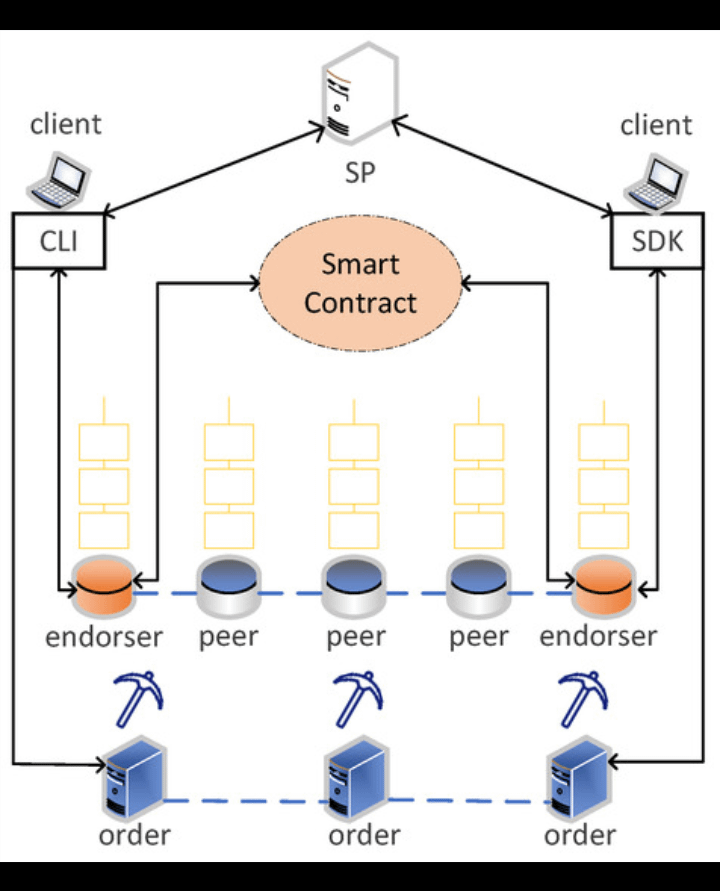

Pierwszą rzeczą, na której zazwyczaj się koncentruję w takim projekcie, jest to, jak rzeczywistość wkracza do systemu. Każdy protokół, który twierdzi, że koordynuje agentów fizycznych – roboty w tym przypadku – natychmiast dziedziczy chaotyczny interfejs ze światem fizycznym. Czujniki zawodzą, środowiska się zmieniają, sprzęt traci kalibrację, a operatorzy zachowują się nieprzewidywalnie. Fabric wydaje się to uznawać, koncentrując swoją architekturę wokół weryfikowalnych obliczeń i infrastruktury natywnej dla agentów, zamiast zakładać zaufanie do samych maszyn. W praktyce, to przesuwa ciężar z wiary w robota na weryfikację obliczeń, które robot twierdzi, że wykonał.

Z perspektywy projektowania protokołów, ta subtelna zmiana ma znaczenie. Zamiast próbować egzekwować poprawność na poziomie sprzętowym, Fabric koncentruje się na udowodnieniu, że decyzje lub wyniki agentów podążają za weryfikowalnymi procesami. Jeśli ta struktura utrzyma się podczas rzeczywistego użytkowania, tworzy dziwną, ale użyteczną dynamikę ekonomiczną. Roboty stają się uczestnikami sieci, w której ich działania są odpowiedzialne poprzez dowody, a nie reputację. To inny model niż w przypadku większości infrastruktury automatyzacji, która zazwyczaj polega na centralnym nadzorze lub zamkniętych ekosystemach dostawców.

To, co mnie interesuje, to jak to zmienia zachęty operatorów prowadzących te maszyny. Jeśli zachowanie robota można weryfikować kryptograficznie, operatorzy mają mniej sposobów na ukrycie nieefektywności lub manipulacji. Teoretycznie powinno to skompresować marże dla nieuczciwych zachowań, jednocześnie nagradzając niezawodność operacyjną. Ale w praktyce zachęty rzadko zachowują się tak czysto. Operatorzy będą szukać najtańszego sposobu na spełnienie jakiegokolwiek standardu weryfikacji, który protokół narzuca. To oznacza, że dokładny projekt wymagań dotyczących dowodów staje się ważniejszy niż narracja wokół decentralizacji.

Kolejną warstwą, która zasługuje na uwagę, jest rola publicznego rejestru w koordynowaniu danych i obliczeń. Większość dyskusji przedstawia to jako przejrzystość, ale w systemach operacyjnych przejrzystość często jest drugorzędna. To, co się liczy, to synchronizacja. Księga staje się powierzchnią koordynacyjną, gdzie agenci, regulatorzy i dostawcy infrastruktury obserwują tę samą sekwencję zdarzeń. Ta wspólna linia czasowa ma większe znaczenie niż same dane. Gdy działania są rejestrowane w spójnym porządku, spory stają się łatwiejsze do rozwiązania, a procesy zautomatyzowane mogą zakończyć się bez ciągłych negocjacji.

W kontekście robotyki, ta funkcja porządkowania cicho kształtuje zachowanie. Jeśli robot wykonuje zadania, które uruchamiają płatności, prawa dostępu lub kontrole regulacyjne, latencja i niezawodność rozliczenia stają się praktycznymi ograniczeniami. Wolna lub zatłoczona warstwa rozliczeniowa nie tylko denerwuje użytkowników – zmienia, jak maszyny planują pracę. Roboty mogą grupować zadania w inny sposób, opóźniać raportowanie lub przesuwać obciążenia robocze, aby zminimalizować koszty transakcji. Z biegiem czasu te operacyjne dostosowania stają się widoczne w wzorcach na łańcuchu: wybuchy aktywności, skumulowane zgłoszenia lub okresowa weryfikacja dowodów zamiast ciągłych aktualizacji.

Te wzorce byłyby jednymi z pierwszych rzeczy, które obserwowałbym w danych sieciowych na żywo. Metryki użycia rzadko kłamią na temat tego, jak protokół rzeczywiście działa. Jeśli Fabric osiągnie rzeczywiste wdrożenie, oczekiwałbym zobaczyć wyraźne sygnatury w przepływie transakcji związane z robotycznymi obciążeniami – okresowe składanie dowodów, uwierzytelnienia tożsamości sprzętu lub cykle weryfikacji obliczeń. To nie są typowe wzorce transakcji konsumenckich. Zwykle są napędzane przez maszyny, powtarzalne i wrażliwe na czas.

Strona przechowywania protokołu również niesie ciekawe implikacje. Roboty generują duże ilości danych z czujników, ale przechowywanie ich bezpośrednio w księdze nie jest ani praktyczne, ani konieczne. To, co zwykle pojawia się w tych systemach, to podejście warstwowe, w którym surowe dane znajdują się poza łańcuchem, podczas gdy weryfikowalne zobowiązania zakotwiczają integralność tych danych w łańcuchu. Wydajność tego mostu decyduje o tym, czy protokół wydaje się użyteczny, czy uciążliwy. Jeśli generowanie weryfikowalnych zobowiązań staje się zbyt kosztowne obliczeniowo, operatorzy naturalnie zminimalizują to, co zgłaszają.

Ta napięcie wprowadza niewygodną prawdę, którą wiele projektów infrastrukturalnych cicho ignoruje. Systemy weryfikacji działają tylko wtedy, gdy koszt udowodnienia czegoś pozostaje niższy niż ekonomiczna wartość oszustwa. Jeśli generowanie dowodów staje się drogie w porównaniu do wartości zadań robotycznych, system zaprasza do skrótów. Operatorzy mogą przeprowadzać minimalną weryfikację, opóźniać dowody lub konsolidować operacje w sposób, który technicznie przestrzega zasad, ale zmniejsza przejrzystość. Architektura protokołu decyduje o tym, czy te zachowania pozostają przypadkami marginalnymi, czy stają się dominującą strategią.

Zachowanie walidatorów to kolejny element, który często jest pomijany podczas omawiania sieci robotycznych. Walidatorzy w każdym protokole odpowiadają przede wszystkim na zachęty, a nie ideologię. Jeśli weryfikacja obliczeń robotów staje się zasobożerna, walidatorzy muszą być odpowiednio wynagradzani, w przeciwnym razie sieć przesuwa się w kierunku centralizacji wśród nielicznych aktorów gotowych ponieść koszty. Obserwowanie wskaźników uczestnictwa walidatorów, wymagań sprzętowych i wzorców propagacji bloków szybko ujawni, czy system jest ekonomicznie zrównoważony.

Szybkość rozliczeń ma również większe znaczenie, niż większość ludzi się spodziewa. Gdy fizyczne maszyny wchodzą w interakcje z cyfrowymi warstwami rozliczeniowymi, opóźnienia tworzą tarcia operacyjne. Wyobraź sobie roboty wykonujące zadania, ale czekające na potwierdzenie w księdze, zanim odblokują następne instrukcje lub uwolnią płatność. Nawet małe opóźnienia mogą prowadzić do nieefektywności w flotach maszyn. Operatorzy albo tolerują te tarcia, przekształcają przepływy pracy wokół nich, albo próbują obejść protokół w pewnych skrajnych przypadkach. Obserwowanie, jak często koordynacja poza łańcuchem pojawia się wokół rozliczeń w łańcuchu, ujawni, gdzie leżą te punkty nacisku.

Dynamika tokenów, jeśli występuje, nieuchronnie odzwierciedli te operacyjne realia. Tokeny w protokołach infrastrukturalnych często zachowują się mniej jak spekulacyjne aktywa, a bardziej jak wewnętrzne paliwo, które ułatwia koordynację. Popyt zazwyczaj śledzi cykle użycia, a nie narracje. Jeśli obciążenia robotyczne skalują się stopniowo, prędkość tokenów może pozostawać wysoka, podczas gdy ruch cenowy pozostaje stłumiony. Traderzy często źle odczytują tę dynamikę, oczekując spekulacyjnego wzrostu, gdy token w głównej mierze pełni rolę mechanizmu koordynacji w opartej na maszynach gospodarce.

Inny subtelny efekt pojawia się wokół zarządzania. Gdy protokoły wchodzą w interakcje z systemami fizycznymi, decyzje zarządzające niosą ze sobą konsekwencje operacyjne, które wykraczają poza aktualizacje oprogramowania. Dostosowanie wymagań dotyczących dowodów lub standardów obliczeniowych może wpływać na konfiguracje sprzętowe, które muszą prowadzić operatorzy. Zmiany, które wydają się drobne na poziomie protokołu, mogą wymusić kosztowne aktualizacje w całych flotach robotów. Ta rzeczywistość zwykle spowalnia zarządzanie, nie dlatego, że uczestnicy są konserwatywni, ale dlatego, że każda zmiana parametru ma rzeczywiste koszty.

To, co cenię w ramach Fabric, to fakt, że nie próbuje ukrywać tej złożoności. Koordynowanie robotów poprzez weryfikowalną infrastrukturę jest z natury chaotyczne. Maszyny istnieją w środowiskach, które opierają się schludnym abstrakcjom. Pogoda, zużycie, przerwy w łączności – żadne z tych rzeczy nie dbają o elegancję protokołu. Wyzwanie polega na budowie systemu, w którym te niedoskonałości mogą być obserwowane, mierzone i rozwiązywane bez burzenia zaufania w sieć.

Jeśli Fabric odniesie jakikolwiek znaczący sukces, prawdopodobnie będzie to dlatego, że jego architektura cicho absorbuje te niedoskonałości, zamiast udawać, że ich nie ma. Większość projektów infrastrukturalnych nie udaje się nie dlatego, że pomysł jest zły, ale dlatego, że tarcia w rzeczywistości gromadzą się szybciej, niż system może się dostosować. Obserwowanie, jak protokół radzi sobie z niedoskonałymi danymi, opóźnionymi dowodami, stresem walidatorów i zachętami dla operatorów, powie znacznie więcej niż jakikolwiek dokument techniczny kiedykolwiek mógłby.

Z mojego punktu widzenia, studiując rynki i mechanikę protokołów każdego dnia, interesującą częścią jest nie to, czy roboty ostatecznie wezmą udział w zdecentralizowanej infrastrukturze. Interesującą częścią jest to, czy projekt ekonomiczny systemu takiego jak ten może przetrwać nudny, powtarzalny stres rzeczywistego użytkowania. Systemy rzadko łamią się w dramatyczny sposób. Dryfują powoli, kształtowane przez zachęty i operacyjne skróty, aż architektura ujawnia, co naprawdę optymalizuje.

I to zwykle jest moment, w którym struktura protokołu staje się jaśniejsza niż jego narracja kiedykolwiek była.