Specyficzne obwody ZK: Precyzja, Wydajność i Paradoks Skalowania

Przez ostatnie kilka dni byłem zanurzony w wzorcach architektonicznych stojących za systemami takimi jak RIVER, PIPPIN i sekcja Kachina — im głębiej patrzę, tym wyraźniejsza staje się filozofia projektowania. To, co początkowo wydawało się niszową optymalizacją, teraz wydaje się świadomym, niemal filozoficznym odchyleniem od głównego kierunku systemów z zerową wiedzą (ZK).

Większość nowoczesnych systemów dowodów ZK jest budowana do ogólnego użytku. Mają na celu wsparcie szerokiego zakresu aplikacji w ramach jednego systemu, priorytetując elastyczność i kompozycyjność. Takie podejście ma oczywiste zalety: deweloperzy mogą budować raz i wdrażać w wielu kontekstach, korzystając ze wspólnych narzędzi, infrastruktury i standardów.

Kachina jednak podąża zasadniczo inną ścieżką.

Zamiast optymalizować pod kątem uniwersalności, skłania się ku specyfice. Każda aplikacja jest połączona ze swoim własnym dostosowanym obwodem — stworzonym na miarę, aby odzwierciedlić jej dokładną logikę obliczeniową. Zamiast zmuszać różnorodne aplikacje do uogólnionego systemu dowodzenia, Kachina przekształca system dowodzenia wokół samej aplikacji.

Ta różnica nie jest tylko architektoniczna — ma głębokie konsekwencje.

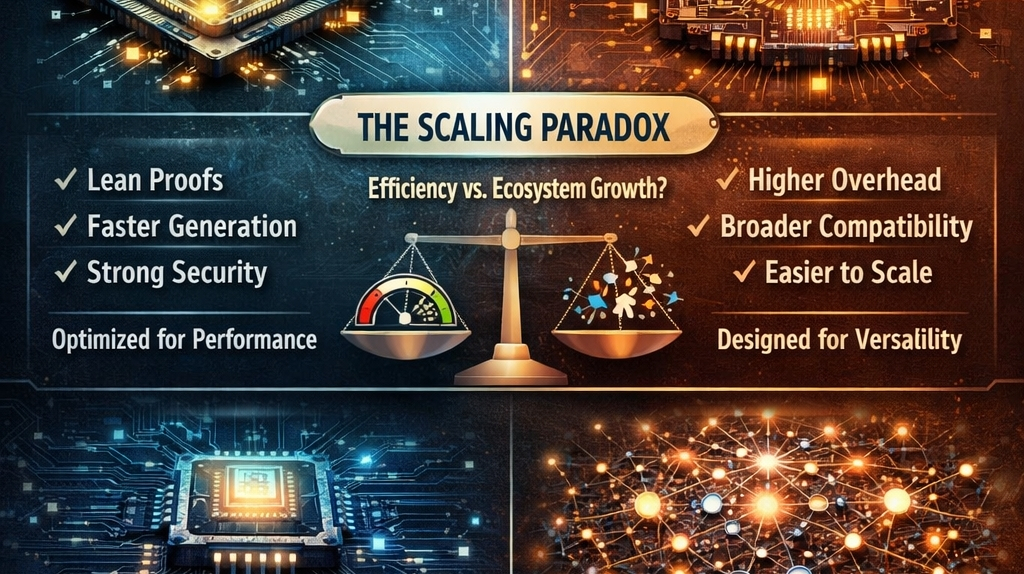

Systemy ogólnego przeznaczenia z natury noszą koszty dodatkowe. Muszą pomieścić pełne spektrum możliwych obliczeń, nawet jeśli dana aplikacja korzysta tylko z małej części tej zdolności. Prowadzi to do nieefektywności w generowaniu dowodów, czasie weryfikacji, a czasami nawet w założeniach bezpieczeństwa.

Obwody specyficzne dla aplikacji, w przeciwieństwie do tego, eliminują te nadmiary. Działają w węższym zakresie, umożliwiając:

Skrócone dowody: Mniejsze, bardziej wydajne reprezentacje

Szybsza generacja: Zredukowana złożoność obliczeniowa

Silniejsze gwarancje: Mniej miejsca na niezamierzone użycie lub błędną konfigurację

W istocie, wymieniają elastyczność na precyzję — i w ten sposób odblokowują poziom wydajności, z którym ogólne systemy mają trudności.

Ale ten wybór projektowy wprowadza nowe napięcie: skalowalność na poziomie ekosystemu.

Chociaż stosunkowo prosto jest zbudować kilka wysoko zoptymalizowanych obwodów, wyzwanie narasta w miarę wzrostu liczby aplikacji. Każdy nowy przypadek użycia wymaga własnego projektu obwodu, procesu audytowego i cyklu życia konserwacji. To, co zaczyna się jako przewaga wydajności, może ewoluować w kierunku obciążenia operacyjnego.

To stawia krytyczne pytanie:

Czy obwody specyficzne dla aplikacji są fundamentem przyszłości o wysokiej wydajności — czy może wąskim gardłem czekającym na pojawienie się?

Z jednej strony, dostosowane obwody umożliwiają każdej aplikacji działanie z maksymalną wydajnością, wzmacniając system jako całość poprzez specjalizację. Z drugiej strony, skumulowany koszt projektowania i zarządzania tymi obwodami może utrudnić skalowalność, spowolnić innowacje i fragmentować ekosystem.

Odpowiedź prawdopodobnie nie leży w wyborze jednej skrajności, ale w znalezieniu równowagi.

Modele hybrydowe mogą się pojawić — gdzie rdzenne prymitywy pozostają uniwersalne, podczas gdy komponenty krytyczne dla wydajności wykorzystują optymalizacje specyficzne dla aplikacji. Narzędzia i automatyzacja mogą również odgrywać decydującą rolę, redukując tarcia związane z tworzeniem obwodów i umożliwiając programistom skalowanie bez poświęcania precyzji.

Podejście Kachiny to odważne stwierdzenie: że wydajność, poprawność i zamierzony projekt są warte dodatkowej złożoności. Czy ten model będzie się pięknie skalował, czy też będzie obciążony własnym ciężarem, będzie zależeć od tego, jak ewoluuje otaczający ekosystem.

Na razie pozostaje to przekonywującym kontrargumentem dla filozofii „jeden rozmiar pasuje do wszystkich” — przypomnieniem, że czasami najostrzejsze projekty pochodzą z zawężania zakresu, a nie jego rozszerzania.

A ta napięcie? To właśnie tam innowacje mają tendencję do rozkwitu.#night @MidnightNetwork $NIGHT