Mình bắt đầu nhận ra một thói quen khá khó chịu khi dùng Binance AI Pro, và càng để ý thì càng thấy nó xuất hiện nhiều hơn mình nghĩ.

Mình mở AI Pro, hỏi về một setup XAU. Nó trả lời khá rõ, nhưng không đúng với hướng mình đang nghiêng. Và thay vì dừng lại suy nghĩ… mình hỏi lại.

Không phải hỏi rõ hơn.

Mà là hỏi lại theo cách khác.

Đôi khi đổi wording một chút. Đôi khi focus vào một phần nhỏ hơn của setup. Và thường thì lần thứ hai, câu trả lời “hợp” với mình hơn.

Lúc đó mình tự nghĩ là mình đang refine câu hỏi.

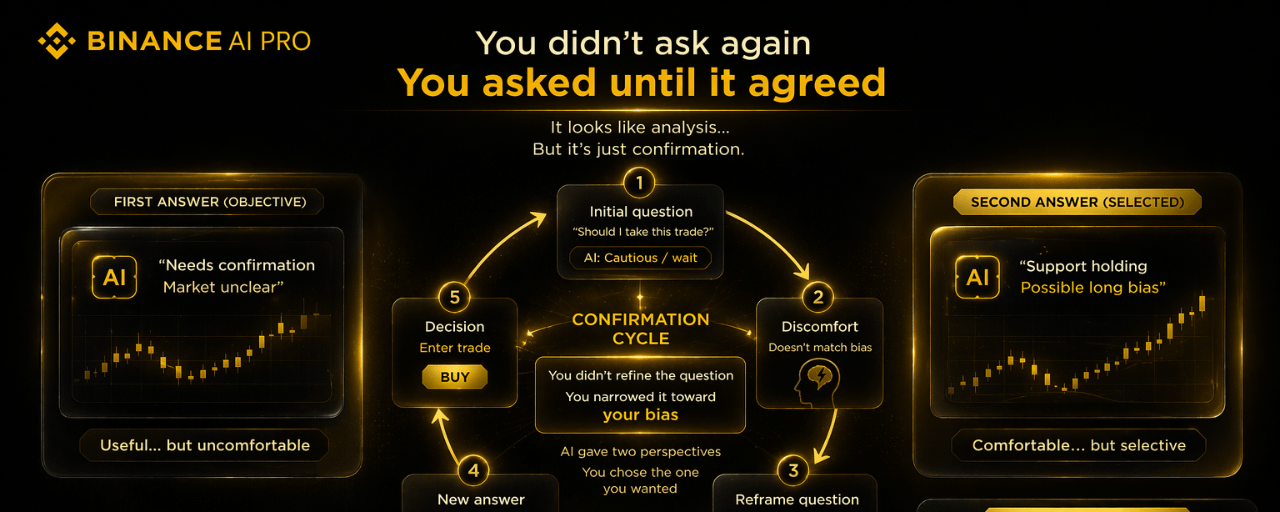

Nhưng thật ra… mình chỉ đang hỏi cho đến khi nó đồng ý.

Cơ chế này nhìn ra thì rất đơn giản, nhưng lúc đang làm thì lại không thấy.

Bạn hỏi một câu. Output không khớp với bias của bạn. Bạn không đổi bias. Bạn đổi câu hỏi. Output thứ hai gần với suy nghĩ của bạn hơn. Bạn chọn nó. Và gọi đó là “phân tích”.

AI đưa ra hai góc nhìn.

Bạn chọn góc nhìn bạn thích.

Và bạn tưởng đó là research.

Điều khiến cái này khó nhận ra là câu hỏi thứ hai thường trông “chặt” hơn. Cụ thể hơn. Nghe giống như mình đang đi sâu hơn vào vấn đề. Nhưng thực tế thì lại là thu hẹp câu hỏi theo hướng có lợi cho bias của mình.

Mình nhận ra rõ nhất trong một setup XAU hồi trước.

Thị trường lúc đó khá lưng chừng, không rõ xu hướng, macro thì mixed. Mình đang nghiêng về long. Hỏi AI Pro lần đầu, nó không bearish, nhưng khá thận trọng. Nó nói cần thêm xác nhận, chưa đủ rõ để vào.

Mình không thích câu đó.

Nên mình hỏi lại, lần này focus vào vùng support cụ thể. Output thứ hai tích cực hơn. Mình vào lệnh.

Lệnh đó đi ngược mình vài ngày trước khi hồi lại.

Khi ngồi review lại, mình thấy câu trả lời đầu tiên thực ra hữu ích hơn. Còn câu thứ hai thì… dễ chịu hơn.

Mình đã chọn cái dễ chịu, rồi tự thuyết phục rằng đó là phân tích tốt hơn.

Từ đó mình bắt đầu thay đổi cách dùng AI Pro một chút.

Không phải là hỏi ít đi.

Mà là xem câu trả lời đầu tiên như một dạng “data”, không phải thứ có thể mặc cả.

Nếu output đầu tiên không khớp với mình, thì cái khoảng lệch đó chính là thông tin. Hoặc mình đang sai, hoặc AI đang thiếu thứ gì đó. Nhưng cả hai đều cần được hiểu rõ, chứ không phải bị “giải quyết” bằng cách hỏi lại.

Giờ mình tự đặt một rule khá đơn giản.

Mỗi câu hỏi chỉ có một follow-up, và follow-up đó chỉ để làm rõ, không phải để đổi hướng câu trả lời.

Nếu sau đó mình vẫn không đồng ý, mình phải viết ra rõ ràng tại sao mình nghĩ AI đang thiếu hoặc sai ở đâu.

Nếu mình không viết ra được… thì mình không vào lệnh.

Nghe thì hơi cực đoan, nhưng nó giúp mình nhận ra một điều.

Nhiều lúc mình không vào được lệnh không phải vì setup không rõ.

Mà vì mình không thực sự hiểu tại sao mình muốn vào.

AI Pro không sai khi nó cho một câu trả lời mình không thích.

Nó chỉ phản ánh lại câu hỏi của mình, dựa trên dữ liệu nó có.

Còn việc mình hỏi lại lần hai… đa phần không phải để tìm câu trả lời tốt hơn.

Mà là để tìm một câu trả lời khiến mình cảm thấy dễ chịu hơn khi vào lệnh.

Và cái version “AI đồng ý với mình” đó… thực ra chỉ là mình đang hỏi lại chính mình, cho đến khi đủ tự tin để hành động.

Trước đây mình vẫn làm vậy.

Chỉ là không nhận ra.

AI Pro chỉ làm cho việc đó dễ hơn… và nhìn có vẻ giống “research” hơn.

Giao dịch luôn tiềm ẩn rủi ro. Các đề xuất do AI tạo ra không phải là lời khuyên tài chính. Hiệu quả hoạt động trong quá khứ không phản ánh kết quả trong tương lai. Vui lòng kiểm tra tình trạng sản phẩm có sẵn tại khu vực của bạn.