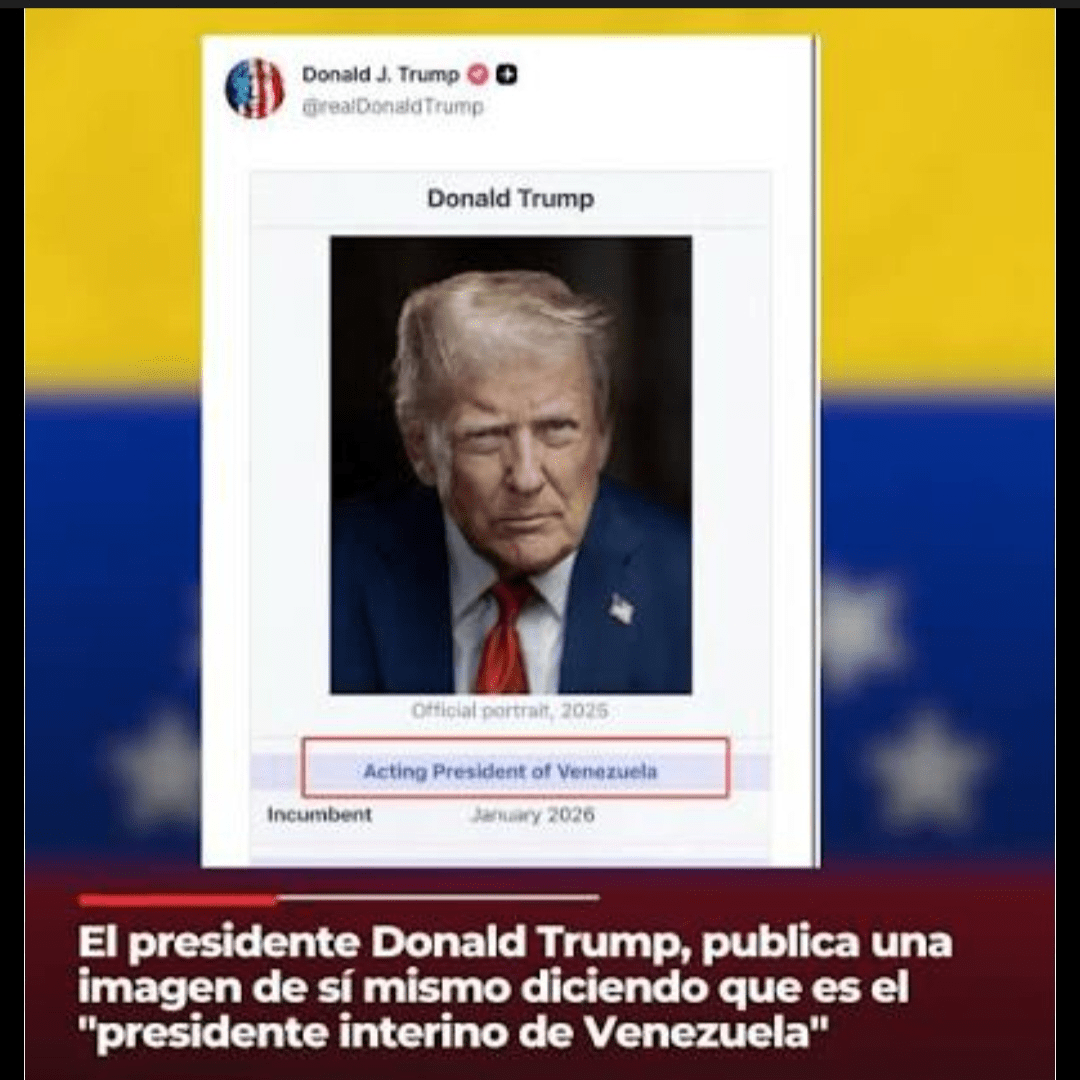

W ostatnich godzinach obraz wygenerowany za pomocą sztucznej inteligencji zdobył ogromną popularność na całym świecie: Donald Trump pojawia się na postacie jako „czasowy prezydent Wenezueli”.

Rzecz, manipulowana cyfrowo, szybko rozprzestrzeniła się w mediach społecznościowych i wywołała dyskusje na temat wiarygodności informacji oraz łatwości, z jaką AI może tworzyć fałszywe postacie osób wpływowych. Poza wpływem medialnym ten wydarzenie odzwierciedla rosnący wyzwanie: jak rozróżnić prawdziwy materiał od cyfrowo wyprodukowanego?

Proliferacja narzędzi sztucznej inteligencji zdolnych do generowania ekstremalnie realistycznych obrazów i tekstów stawia krytyczny dylemat dla polityki, mediów i opinii publicznej.

W miarę jak technologia staje się coraz bardziej dostępna, granica między prawdą a fałszem zaciera się, a manipulacja informacją może mieć natychmiastowe reperkusje dla postrzegania liderów i decyzji politycznych.

W tym kontekście pojawiają się protokoły takie jak Walrus, zaprojektowane do certyfikacji tożsamości i wiarygodności za pomocą weryfikowalnych tokenów. Te systemy oparte na $WAL pozwalają na audyt autentyczności publikacji, oświadczeń lub obrazów w sposób zdecentralizowany, ustanawiając wiarygodne ramy w ekosystemie cyfrowym nasyconym informacjami.

Tokeny działają jak certyfikaty cyfrowe: każda emisja jest powiązana z tożsamością lub instytucją i nie może być zmieniana bez pozostawienia śladu.

Walrus i podobne technologie są przedstawiane jako rozwiązanie problemu, który sztuczna inteligencja zaostrza: utrata zaufania do informacji.

Na przykład, token powiązany z politykiem lub zweryfikowanym medium mógłby ostrzegać użytkowników o zmanipulowanej lub sztucznie wygenerowanej treści, odróżniając fakty od cyfrowych symulacji.

To nie tylko chroni reputację źródeł, ale również przyczynia się do bardziej przejrzystego i bezpiecznego środowiska cyfrowego.

Ponadto, integracja tych protokołów może wykraczać poza weryfikację wiadomości i postaci publicznych.

Organizacje, agencje fact-checkingowe i media mogłyby używać tokenów do certyfikacji dokumentów, publikacji i danych w sposób wiarygodny, zmniejszając ryzyko dezinformacji wirusowej oraz ataków reputacyjnych opartych na AI.

Przypadek Trumpa i wirusowe rozpowszechnienie jego fikcyjnego samoproklamowania to wyraźny przykład tego, jak cyfrowa manipulacja może wpływać na politykę i opinię publiczną.

Jednakże, pokazuje to również możliwość: narzędzia takie jak Walrus oferują namacalny mechanizm przywracania zaufania, łącząc przejrzystość technologii blockchain z weryfikacją tożsamości i reputacją cyfrową.

W świecie, w którym granice między rzeczywistością a fikcją stają się coraz bardziej rozmyte, konwergencja sztucznej inteligencji i protokołów tokenów otwiera drzwi do przyszłości, w której informacje mogą być wiarygodne, audytowalne i weryfikowalne.

Pytanie nie brzmi, czy AI zmieni politykę i komunikację, ale czy będziemy mieli odpowiednie narzędzia, aby zapewnić, że to, co widzimy i dzielimy się, jest autentyczne. Coraz trudniej zarządzać i utrzymywać etykę w tych aspektach.