A Mira Network faz mais sentido quando vista não como uma tentativa de criar uma inteligência artificial mais inteligente, mas como um esforço para tornar as saídas da IA suficientemente confiáveis para serem tratadas como entradas verificadas. O verdadeiro objetivo parece ser menos sobre melhorar como os modelos soam e mais sobre transformar suas respostas em resultados que carregam responsabilidade, semelhante a números financeiros auditados ou transações confirmadas. Quando examinei o conceito pela primeira vez, ficou claro que a ambição é a confiabilidade em vez da inteligência apenas.

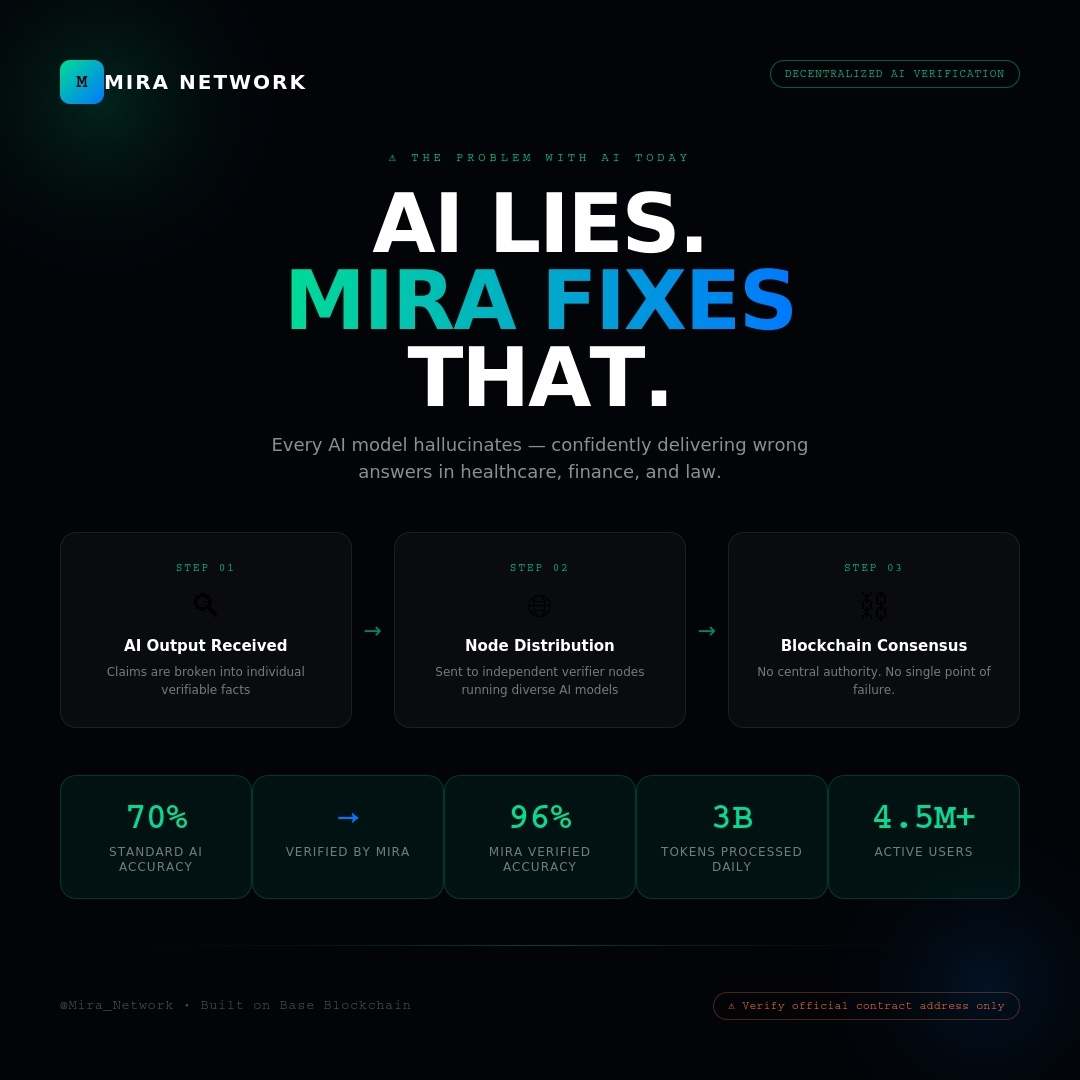

O projeto começa com uma observação simples. Um único modelo de IA pode gerar respostas confiantes e polidas, enquanto ainda está incorreto. Para uso casual, como elaborar ideias ou fazer brainstorm, esse erro pode causar apenas inconvenientes. Mas quando os sistemas de IA começam a acionar ações automatizadas envolvendo pagamentos, permissões, verificações de conformidade ou decisões de segurança, até mesmo erros raros se tornam críticos. A Mira parece construída em torno da aceitação dessa verdade desconfortável em vez de ignorá-la.

Dividindo a Saída da IA em Unidades Verificáveis

Em vez de confiar na conclusão de um modelo, a Mira introduz um processo que separa uma resposta de IA em componentes menores conhecidos como reivindicações. Essas reivindicações representam declarações específicas que a rede pode avaliar de forma independente. Notei que essa etapa muda tudo porque, uma vez que a linguagem se torna reivindicações estruturadas, o sistema pode roteá-las para verificação, desafiá-las, comparar resultados e, eventualmente, chegar a um resultado verificado.

Esta fase de decomposição tem mais importância do que pode parecer à primeira vista. A forma como as reivindicações são formadas determina o que pode realmente ser verificado e quão custoso o processo se torna. Se as reivindicações forem muito amplas, a verificação se transforma em debates vagos sobre respostas inteiras. Se forem muito estreitas, a verificação se torna cara e ineficiente. A eficácia da Mira depende amplamente de encontrar um equilíbrio onde as reivindicações permaneçam significativas, enquanto ainda são práticas para verificar.

Verificação Impulsionada por Incentivos em vez de Opiniões

Depois que as reivindicações são criadas, a Mira muda para um sistema de verificação construído em torno de consequências em vez de simples concordância. A verificação não é tratada como um voto casual, mas como um processo estruturado economicamente. Os participantes responsáveis pela verificação devem assumir riscos, as recompensas estão ligadas a julgamentos precisos, e existem penalidades para comportamentos incorretos ou suspeitos. Do meu ponto de vista, isso faz com que o sistema se assemelhe a um mecanismo de liquidação em vez de uma discussão comunitária.

O raciocínio é simples. Se os participantes pudessem ganhar recompensas sem precisão, o sistema rapidamente se encheria com contribuições de baixo esforço. Ao anexar consequências financeiras, a rede tenta desestimular adivinhações e encorajar uma avaliação cuidadosa. Em vez de depender da boa vontade, incentivos orientam o comportamento em direção a resultados confiáveis.

Múltiplos Modelos Independentes para Reduzir o Viés

A Mira também distribui a verificação entre múltiplos modelos independentes. A ideia aqui é evitar depender de um único sistema que possa ter fraquezas ocultas. Em ambientes do mundo real, erros frequentemente aparecem em padrões. Quando muitos sistemas dependem de dados de treinamento ou design de modelo semelhantes, tendem a cometer erros semelhantes. Ao introduzir avaliadores independentes, a Mira tenta evitar que pontos cegos compartilhados se tornem falhas sistêmicas.

Vejo essa abordagem como semelhante a ter múltiplos examinadores revisando o mesmo trabalho em vez de permitir que um sistema se avalie. Perspectivas independentes criam fricção, e essa fricção pode ajudar a expor erros antes que se tornem resultados aceitos.

Construindo um Registro Crescente de Informações Verificadas

Um dos aspectos mais interessantes aparece depois que a verificação é concluída. Com o tempo, as reivindicações verificadas podem se acumular em uma coleção crescente de resultados verificados. Em vez de reiniciar a verificação do zero a cada vez, sistemas futuros poderiam referenciar reivindicações previamente resolvidas. Isso cria uma camada de confiabilidade baseada não na verdade filosófica, mas na história de verificação documentada.

Essa acumulação importa porque a confiabilidade começa a se acumular. Cada resultado verificado contribui para uma base reutilizável que reduz o trabalho repetido e fortalece a confiança nos processos futuros. Na minha visão, isso transforma a verificação de uma ação temporária em uma infraestrutura duradoura.

Riscos Ocultos Dentro do Processo de Verificação

Apesar dos fortes objetivos de design, vários riscos específicos do projeto permanecem. Uma preocupação importante envolve a própria formação das reivindicações. A entidade ou mecanismo responsável por transformar saídas em reivindicações efetivamente decide quais perguntas a rede avalia. Mesmo com verificação descentralizada, o controle sobre a estrutura das reivindicações pode influenciar silenciosamente os resultados. Reivindicações mal formuladas podem levar o sistema a conclusões confiantes, mas incorretas.

Outro risco envolve a possibilidade de produzir certificados de verificação que parecem confiáveis sem realmente reduzir falhas raras, mas sérias. Sistemas otimizados para velocidade e concordância podem ignorar casos extremos difíceis. Uma rede de verificação saudável deve ocasionalmente mostrar desacordo e escalonamento, especialmente em domínios complexos onde a certeza requer esforço adicional. Se tudo se torna verificado muito rapidamente, isso pode indicar simplificação excessiva em vez de força.

Equilíbrio de Privacidade e Roteamento de Informações

O design de privacidade também desempenha um papel importante na arquitetura da Mira. A rede descreve a divisão de informações para que os verificadores individuais vejam apenas entradas parciais, com detalhes adicionais revelados apenas quando necessário. Esta abordagem tenta proteger dados sensíveis enquanto ainda permite uma avaliação significativa. No entanto, equilibrar privacidade e precisão é delicado. Muito pouco contexto pode levar a erros de julgamento, enquanto muita exposição arrisca vazar informações privadas.

A forma como a informação flui pelo sistema, portanto, afeta tanto a segurança quanto a qualidade da verificação. Não é apenas um recurso de privacidade, mas um componente estrutural que influencia a resistência da rede à manipulação.

Um Sistema Que Recompensa a Precisão

Se eu tivesse que resumir o projeto de forma simples, descreveria a Rede Mira como uma tentativa de construir um sistema econômico em torno de ser correto. A precisão é medida reivindicação por reivindicação, a confiabilidade é adquirida por aqueles que precisam de resultados confiáveis, e penalidades desestimulam a participação descuidada. O foco não está em prometer uma verdade perfeita, mas em criar um processo onde a verificação se comporta como uma infraestrutura responsável.

Essa direção é o que torna o projeto genuinamente atraente para mim. Em vez de confiar na suposição de que a IA geralmente se sai bem o suficiente, a Mira tenta transformar a verificação em algo mensurável, auditável e com base econômica. Ao tratar a correção como um recurso que pode ser avaliado e recompensado, o projeto aproxima as saídas da IA de algo em que as organizações possam realmente confiar em ambientes operacionais reais.

@Mira - Trust Layer of AI $MIRA #Mira