A Mira Network é um desses projetos que acabei estudando não por causa do hype, mas por uma questão prática: como podemos realmente verificar informações geradas por IA de uma maneira que não dependa de confiar em uma única empresa?

Depois de ler o design do protocolo e acompanhar as atualizações de @Mira - Trust Layer of AI , ficou claro que a Mira Network está focada em algo muito específico. Não está tentando construir outro grande modelo de linguagem. Está construindo uma camada de verificação descentralizada para sistemas de IA.

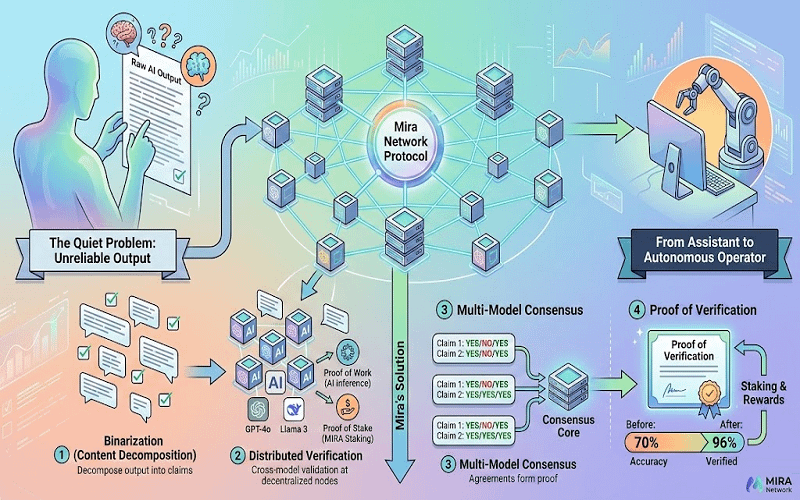

A ideia central por trás de #MiraNetwork é simples, mas importante. Modelos de IA geram saídas que muitas vezes parecem confiantes, mesmo quando estão erradas. Alucinações, viés sutil, citações fabricadas, esses não são casos raros. Eles são fraquezas estruturais em como grandes modelos preveem texto.

Mira aborda isso tratando as saídas da IA como conjuntos de afirmações em vez de um único bloco de texto.

Em vez de perguntar: “Esta resposta inteira está correta?”, o protocolo divide a saída em declarações menores e verificáveis. Cada afirmação pode então ser avaliada de forma independente por outros modelos de IA atuando como verificadores.

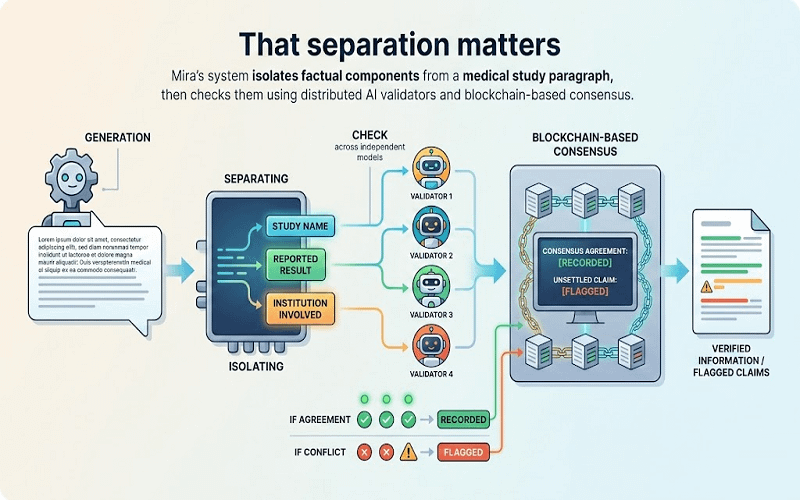

Essa separação importa.

Se um modelo gera um parágrafo sobre um estudo médico, o sistema da Mira isola os componentes factuais. Por exemplo, o nome do estudo, o resultado reportado, a instituição envolvida. Essas partes são então verificadas através de modelos independentes. Se múltiplos modelos concordam, esse acordo é registrado. Se houver conflito, a afirmação é sinalizada.

Ele me lembra de como as redes de verificação de fatos funcionam no jornalismo. Um repórter escreve a história, mas editores e revisores externos verificam fatos individuais. A diferença aqui é que os “editores” são validadores de IA distribuídos coordenados por meio de consenso baseado em blockchain.

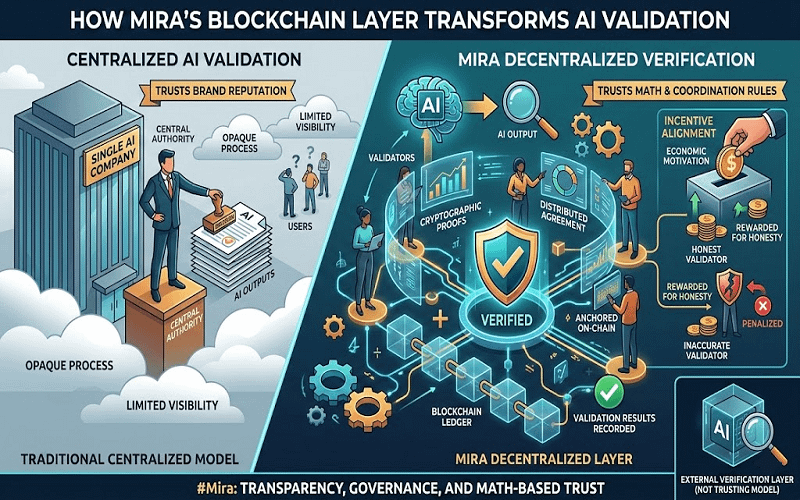

É aqui que a camada de blockchain se torna relevante.

Em vez de depender de uma autoridade central para declarar algo verificado, Mira utiliza provas criptográficas e mecanismos de acordo distribuído para registrar os resultados de validação. Uma vez que uma afirmação foi avaliada e o consenso foi alcançado, esse resultado é ancorado na blockchain. A confiança vem da matemática e das regras de coordenação, não da reputação da marca.

O token $MIRA desempenha um papel em alinhar incentivos dentro deste sistema. Os validadores são economicamente motivados a se comportar de maneira honesta porque a verificação imprecisa pode ser penalizada. Em teoria, isso reduz o risco de colusão ou validação descuidada.

O que torna isso diferente da validação de IA centralizada é a governança e a transparência. Em uma configuração típica, uma única empresa decide como as saídas são testadas, o que conta como preciso e como as correções são tratadas. Os usuários têm visibilidade limitada nesse processo.

Com #Mira a camada de verificação é externa ao próprio modelo. Não assume que o modelo é confiável. Assume o oposto e constrói um mecanismo para testá-lo continuamente.

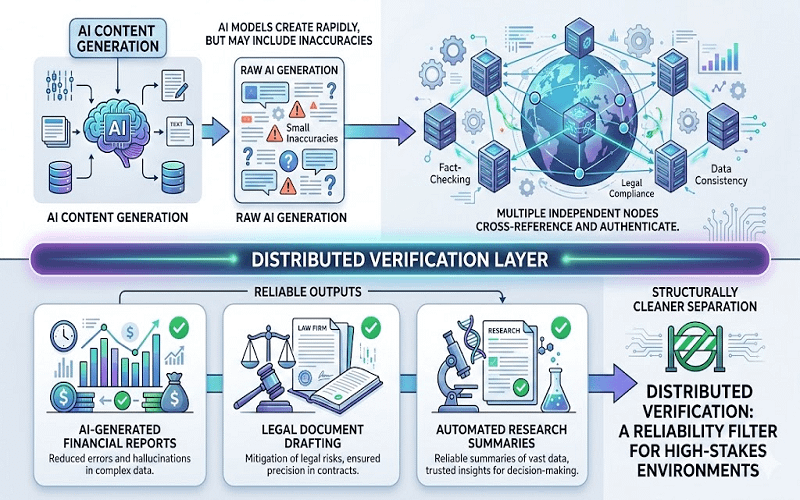

Essa separação parece estruturalmente mais limpa.

Isso também abre casos de uso práticos. Pense em relatórios financeiros gerados por IA, redação de documentos legais ou resumos de pesquisa automatizados. Nessas áreas, até pequenas imprecisões podem causar problemas reais. Uma camada de verificação distribuída poderia atuar como um filtro de confiabilidade antes que as informações sejam usadas em ambientes de alto risco.

Claro, esse design não está sem compromissos.

Executar múltiplos modelos de IA para verificar as saídas aumenta o custo computacional. A coordenação entre validadores distribuídos introduz latência. E a infraestrutura de IA descentralizada está se tornando congestionada, com vários protocolos explorando territórios semelhantes. A Mira Network ainda está no início em termos de maturidade do ecossistema, e a adoção generalizada dependerá de quão eficientemente pode escalar a verificação sem torná-la proibitivamente cara.

Há também uma questão mais profunda sobre epistemologia. Se múltiplos sistemas de IA concordarem em algo incorreto, o consenso por si só não garante a verdade. O design da Mira reduz o erro individual dos modelos, mas não elimina o viés sistêmico entre modelos treinados com dados similares.

Ainda assim, acho o foco disciplinado.

Em vez de tentar construir o modelo mais inteligente, a Mira Network está construindo uma camada que assume que a inteligência é imperfeita e precisa de verificação. Essa mudança de perspectiva parece prática.

Quando olho para a interseção mais ampla de IA e blockchain, muitos projetos buscam métricas de desempenho. A Mira parece mais preocupada com a infraestrutura de confiabilidade. Trata a verificação como um problema de primeira classe em vez de um pensamento posterior.

E em um mundo onde as saídas de IA influenciam cada vez mais as decisões, essa camada silenciosa de validação pode importar mais do que outra melhoria marginal no tamanho do modelo.