Quanto mais uso ferramentas de IA em fluxos de trabalho de tomada de decisão real, menos impressionado fico com o quão polidas elas parecem. A fluência não é mais rara. O que continua raro é a certeza.

A IA moderna pode escrever de forma persuasiva, resumir de maneira eficiente e construir argumentos lógicos. Mas você permitiria que ela executasse algo irreversível sem revisão? A maioria das pessoas hesita. Essa hesitação reflete um problema estrutural mais profundo.

Modelos de IA geram saídas probabilísticas. Eles preveem padrões; não verificam a verdade inerentemente. Quando ocorrem erros, eles frequentemente parecem confiantes. Isso não é uma falha menor da interface — é uma limitação da arquitetura.

Quando explorei a Mira Network, o que se destacou não foi uma tentativa de construir um modelo de linguagem mais poderoso. Em vez disso, o foco está na verificação. A Mira se posiciona como uma camada descentralizada que avalia as saídas de IA antes que a confiança seja assumida.

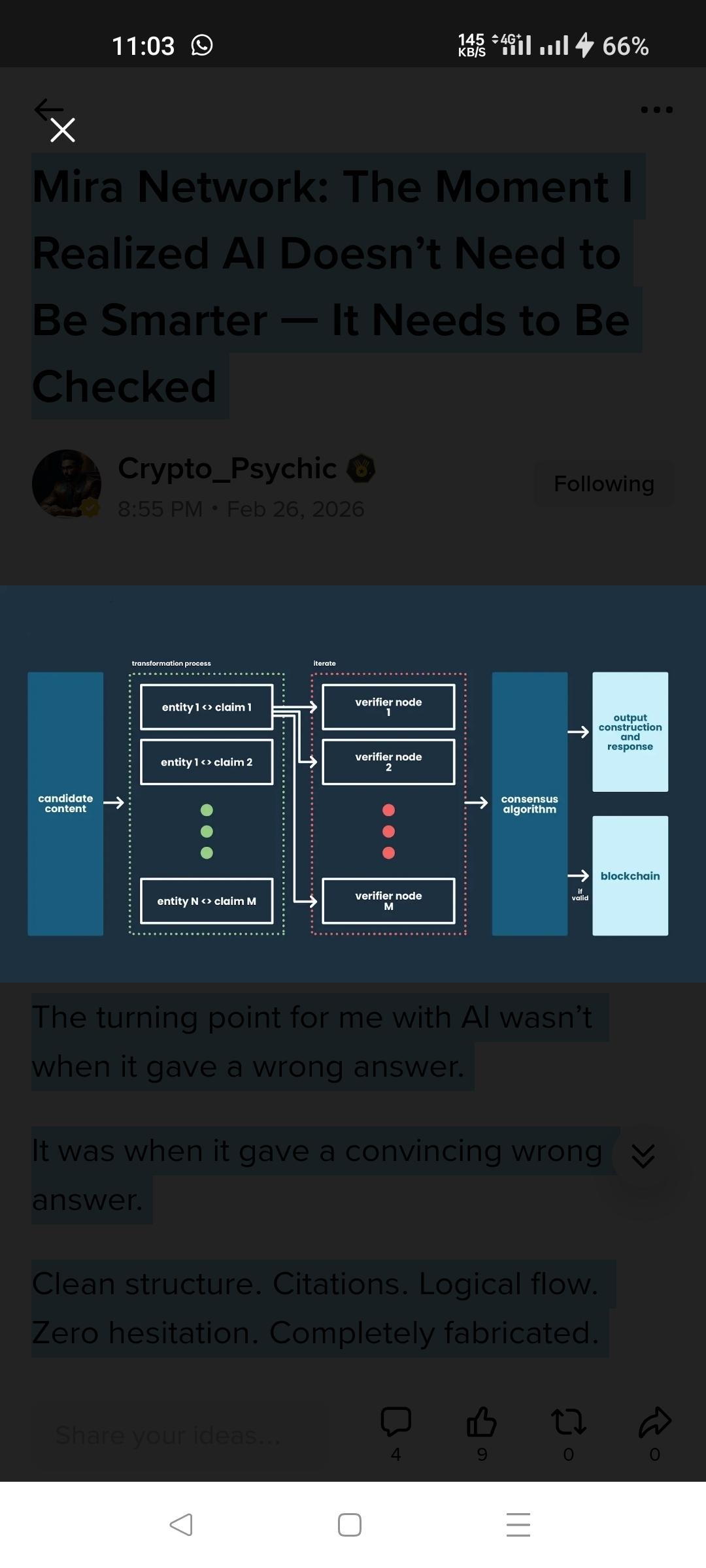

Em vez de tratar uma resposta de IA como uma única resposta indivisível, o sistema a divide em reivindicações menores. Essas reivindicações são então avaliadas por validadores distribuídos. Mecanismos de consenso e incentivos econômicos são usados para coordenar os resultados da validação.

Isso muda o modelo de confiança. Em vez de confiar na autoridade de um único provedor, a validação torna-se distribuída e alinhada ao interesse. Os validadores têm incentivos para avaliar as reivindicações com cuidado, uma vez que os resultados os afetam economicamente.

Essa distinção se torna importante à medida que os sistemas de IA avançam para uma maior autonomia. Em contextos como análise financeira, fluxos de trabalho empresariais ou sistemas de execução automatizada, "principalmente precisos" pode não ser suficiente. As saídas podem precisar ser contestáveis e auditáveis.

O design da Mira sugere que as alucinações não desaparecerão completamente — e em vez disso, constrói mecanismos em torno da verificação. Essa abordagem parece pragmática em vez de idealista.

Existem perguntas em aberto. A granularidade da reivindicação, o alinhamento do validador e os incentivos de coordenação são desafios de design complexos. Sistemas distribuídos raramente são simples. Mas a tese central é clara: inteligência sozinha não garante confiabilidade.

À medida que a IA se torna mais integrada em sistemas críticos, a infraestrutura de responsabilidade pode se tornar cada vez mais importante.

A Mira está explorando essa camada.

Não prometendo inteligência perfeita — mas focando na confiança verificável.

@Mira - Trust Layer of AI #mira $MIRA