Por que a Verificação Independente de IA se Torna Crítica Durante a Guerra e Crise

Modelos de linguagem grandes são treinados em grandes quantidades de dados da internet. Esses dados não são neutros. Eles refletem o peso político, cultural e institucional das regiões que produzem a maior parte do conteúdo. Quando uma parte dominante do material de treinamento vem de um país ou ecossistema de mídia específico, padrões de enquadramento, terminologia e viés narrativo podem se tornar embutidos no modelo.

Isso não requer intenção maliciosa. É estrutural. Os modelos aprendem relações estatísticas. Se certos pontos de vista são repetidos com mais frequência, esses pontos de vista ganham prioridade probabilística nas respostas.

Em tempos estáveis, isso pode parecer uma sutil inclinação cultural. Durante a guerra ou crise geopolítica, torna-se muito mais sério.

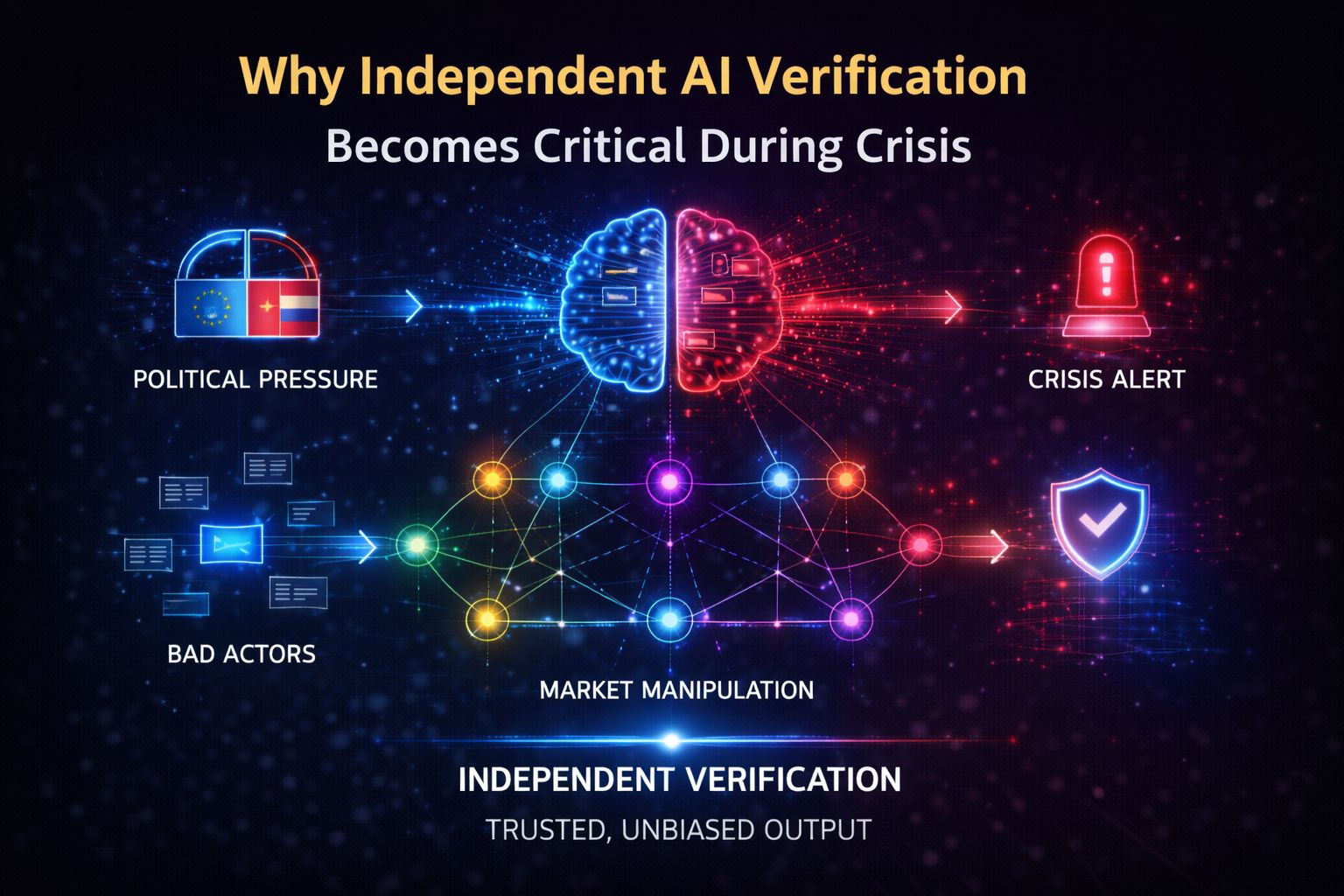

Informação se torna um ativo estratégico. Narrativas moldam mercados, opinião pública e até mesmo percepção de campo de batalha. Se os sistemas de IA usados por traders, jornalistas, analistas ou formuladores de políticas refletem um viés regional concentrado, as consequências escalam rapidamente. Mercados financeiros podem reagir a resumos distorcidos. Avaliações de risco podem herdar um desequilíbrio narrativo. Sistemas autônomos podem agir com inteligência incompleta ou enquadrada.

O perigo não é que a IA espalhe intencionalmente propaganda. O perigo é que ela pode amplificar involuntariamente narrativas dominantes devido à distribuição de treinamento e mecanismos de reforço.

A validação independente de fatos torna-se essencial nessas condições.

É aqui que a arquitetura de verificação descentralizada se torna relevante. Em vez de confiar em um único modelo treinado sob uma única lente institucional, as saídas podem ser decompostas em reivindicações factuais discretas. Cada reivindicação pode então ser avaliada independentemente por diversos nós verificadores que operam com incentivos econômicos alinhados à precisão em vez de lealdade narrativa.

@Mira - Trust Layer of AI exatamente esse tipo de estrutura.

Em vez de assumir que um único modelo pode eliminar seu próprio viés, $MIRA introduz um sistema onde múltiplos modelos participam da validação de consenso. Validadores apostam valor para participar, criando responsabilidade. Se eles divergirem consistentemente de maneiras que sugiram uma verificação descuidada ou desonesta, correm o risco de penalidades econômicas.

A diversidade desempenha um papel fundamental. Uma rede descentralizada incentiva arquiteturas de modelos heterogêneas, corpora de treinamento variados e operadores distribuídos geograficamente. Com o tempo, isso reduz a probabilidade de que uma única perspectiva dominante controle o resultado.

Outro fator crítico durante a crise é a privacidade. Documentos sensíveis, resumos de inteligência ou análises financeiras não podem ser expostos amplamente. A abordagem de Mira de dividir o conteúdo em reivindicações granulares e distribuí-las entre os nós significa que nenhum validador único reconstrói o documento inteiro, protegendo a confidencialidade enquanto preserva a integridade da verificação.

Em tempos de guerra ou ambientes geopolíticos de alta tensão, informações neutras tornam-se infraestrutura. Os mercados dependem disso. As instituições dependem disso. Os cidadãos dependem disso.

A IA está cada vez mais incorporada em pipelines de pesquisa, sistemas de bots de negociação e fluxos e fluxos de decisões automatizadas. À medida que a dependência aumenta, também aumenta a necessidade de neutralidade verificável.

A validação independente de fatos não é mais opcional. Torna-se um mecanismo de estabilidade.

$MIRA e o #Mira framework de verificação visam criar uma camada de confiança alinhada a incentivos que reduz o viés estrutural e aumenta a confiança nas saídas de IA quando a precisão é mais importante.