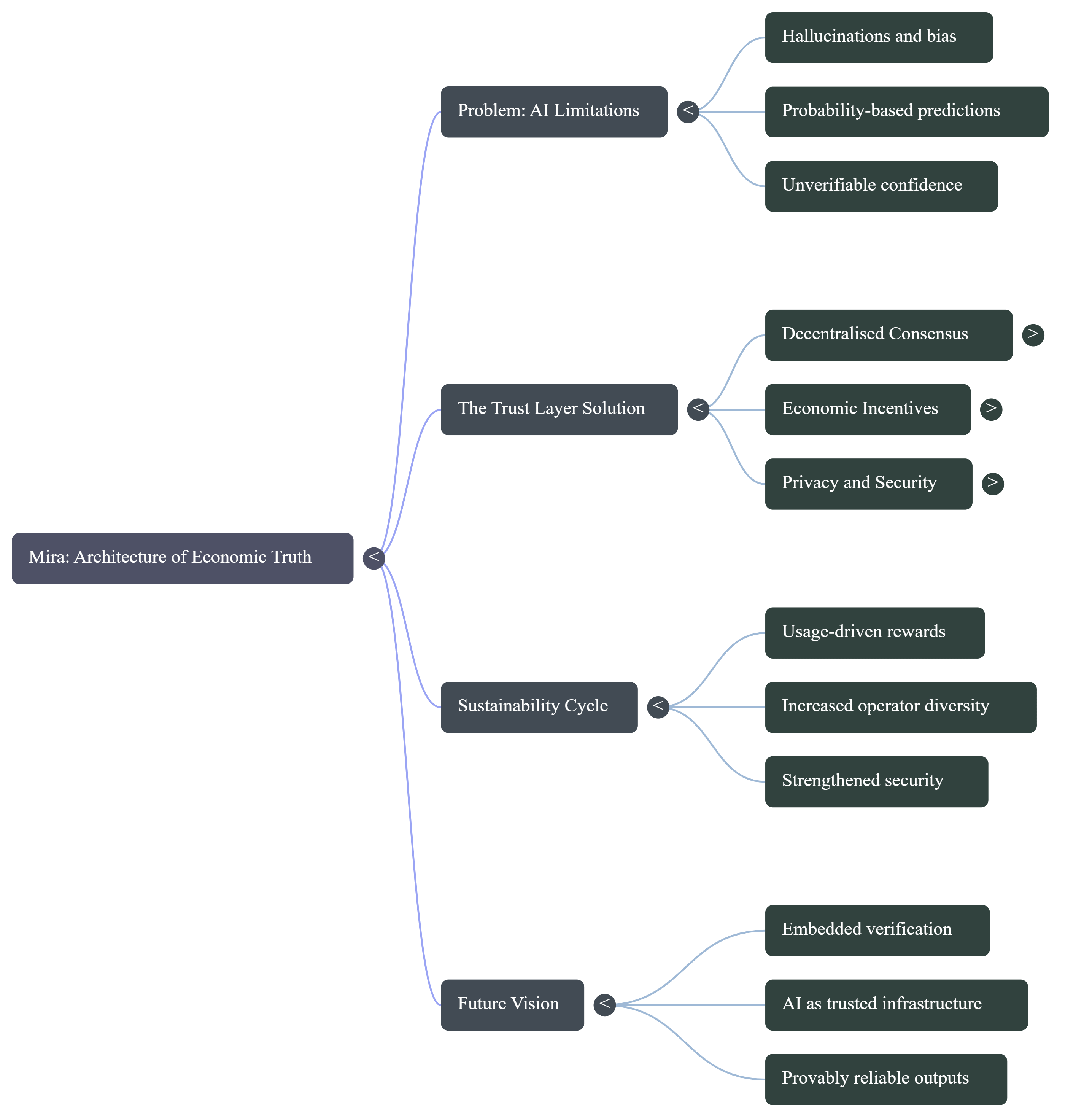

A maioria dos sistemas de IA hoje tem uma grande fraqueza.

Eles geram respostas que soam confiantes, mas não podem garantir que estão corretas. Alucinações e viés não são falhas raras. Elas vêm de como grandes modelos são construídos. Esses sistemas preveem probabilidades, não verdades verificadas. Mesmo quando ajustados, parece haver uma taxa mínima de erro que um único modelo não pode eliminar completamente.

Mira começa com uma crença diferente.

Em vez de tentar construir um modelo perfeito, ela constrói um sistema onde múltiplos modelos se verificam mutuamente.

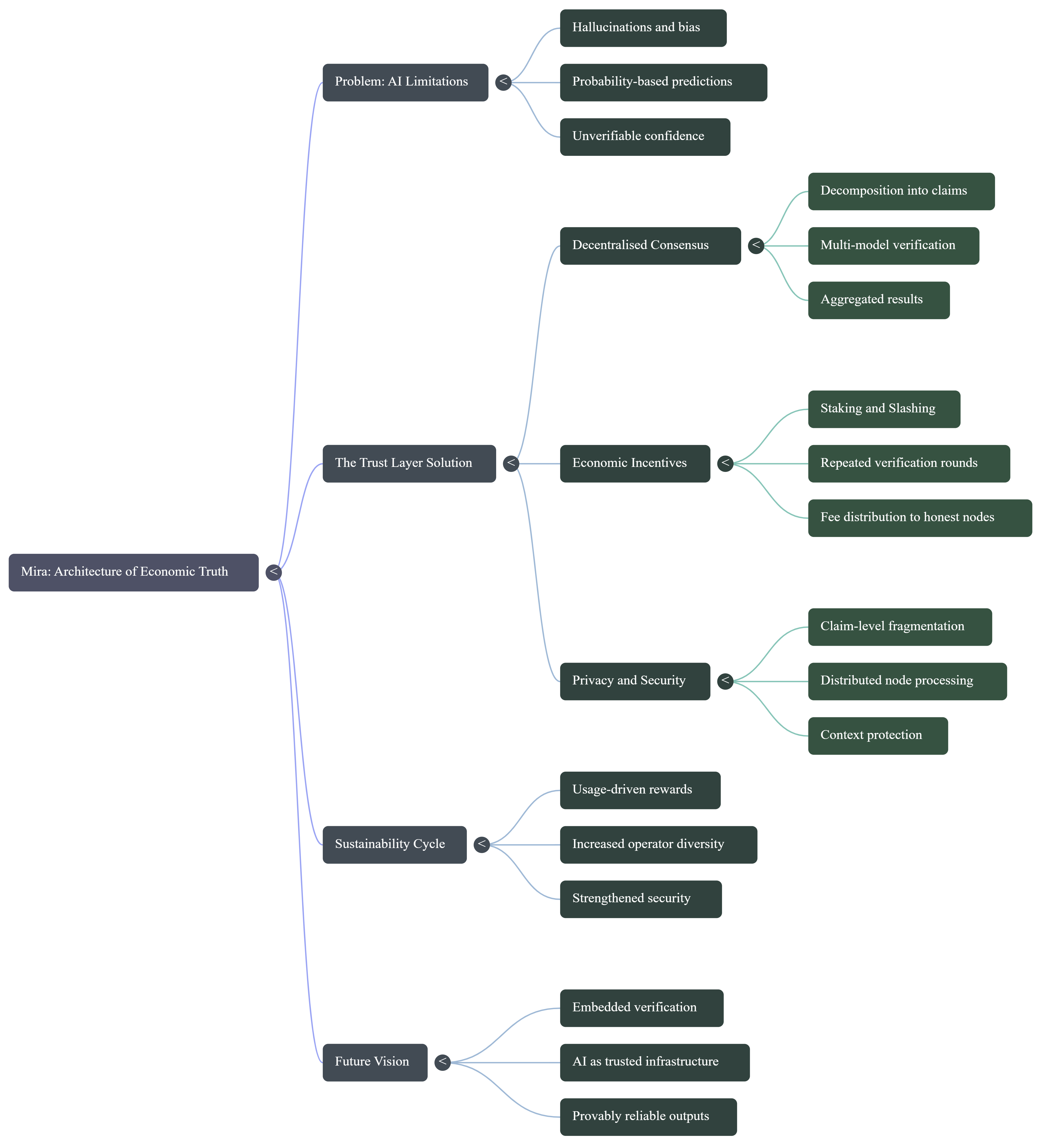

De acordo com o @Mira - Trust Layer of AI whitepaper, $MIRA transforma a saída da IA em reivindicações menores e independentes. Por exemplo, um longo parágrafo é dividido em declarações factuais claras. Cada declaração é então enviada a diferentes nós verificadores. Esses nós executam sua própria inferência e enviam um julgamento. A rede agrega as respostas e produz um resultado de consenso.

Esse processo reduz tanto a alucinação quanto o viés porque nenhum modelo único controla o resultado.

Mas a verificação sozinha não é suficiente. Os incentivos importam.

$MIRA combina trabalho de inferência com staking. Validadores devem bloquear valor para participar da rede. Se tentarem manipular o sistema adivinhando respostas ou enviando respostas descuidadas, correm o risco de perder sua participação através de slashing.

O whitepaper até explica por que isso é necessário. Porque perguntas de verificação podem às vezes parecer tarefas de múltipla escolha, a adivinhação aleatória pode parecer atraente. Mira aborda isso exigindo rodadas de verificação repetidas e penalidades econômicas. A probabilidade de adivinhar corretamente de forma consistente cai drasticamente após múltiplas verificações, tornando o comportamento desonesto estatisticamente e economicamente irracional.

É assim que a sustentabilidade é construída.

Os usuários pagam taxas por saídas verificadas. Essas taxas são distribuídas para operadores de nós honestos que realizam trabalho de inferência real. À medida que o uso cresce, as recompensas crescem. À medida que as recompensas crescem, mais operadores se juntam. À medida que a diversidade de operadores aumenta, o viés diminui e a segurança se fortalece. Isso se torna um ciclo de reforço.

Outra camada importante é a privacidade. Em vez de enviar documentos completos a um único validador, o conteúdo é dividido em fragmentos de nível de reivindicação e distribuído entre nós. Nenhum participante único vê todo o contexto. Isso protege informações sensíveis enquanto ainda permite a verificação.

A visão de longo prazo vai mais longe. Mira pretende passar de verificar saídas após a geração para incorporar a verificação diretamente no processo de geração. Isso significa construir sistemas de IA onde a validação faz parte de como a resposta é criada, e não uma reflexão tardia.

Em termos simples, Mira trata a verdade como algo que deve ser economicamente garantido.

Não assumido.

Não centralizado.

Mas verificado através de consenso descentralizado e incentivos alinhados.

À medida que a IA se torna infraestrutura para finanças, saúde, direito e automação, a confiança não pode depender apenas da confiança. Deve depender de sistemas que recompensam a honestidade e penalizam a manipulação.

Essa é a base que a Mira está tentando construir.

Sistemas como $MIRA visam construir a camada de confiança que torna as saídas da IA não apenas persuasivas, mas comprovadamente confiáveis.

#Mira #MİRA #AIToken #cforcrypto