As trilhas de auditoria da Mira podem ser a resposta. Em um mundo onde a transparência e a responsabilidade em IA são inegociáveis, a Mira capacita organizações a rastrear cada decisão, ação e resultado—tornando possível verificar e confiar em seus sistemas de IA como nunca antes. Imagine um futuro onde cada escolha algorítmica está aberta para revisão e melhoria! Pronto para construir sua IA sobre uma fundação na qual você pode confiar? Descubra por que as trilhas de auditoria da Mira podem ser a espinha dorsal da IA verificável. Quais perguntas você tem sobre trazer verdadeira transparência para a inteligência artificial?

Enquanto a promessa da IA verificável continua a dominar o discurso da indústria, poucas soluções oferecem uma abordagem prática e transparente - é aqui que a Mira Audit afirma se destacar. No entanto, à medida que as organizações correm para abraçar processos impulsionados por IA, a necessidade de trilhas de auditoria robustas nunca foi tão urgente. As Trilhas de Auditoria da Mira se posicionam como potenciais agentes de mudança, mas sua adoção levanta questões críticas.

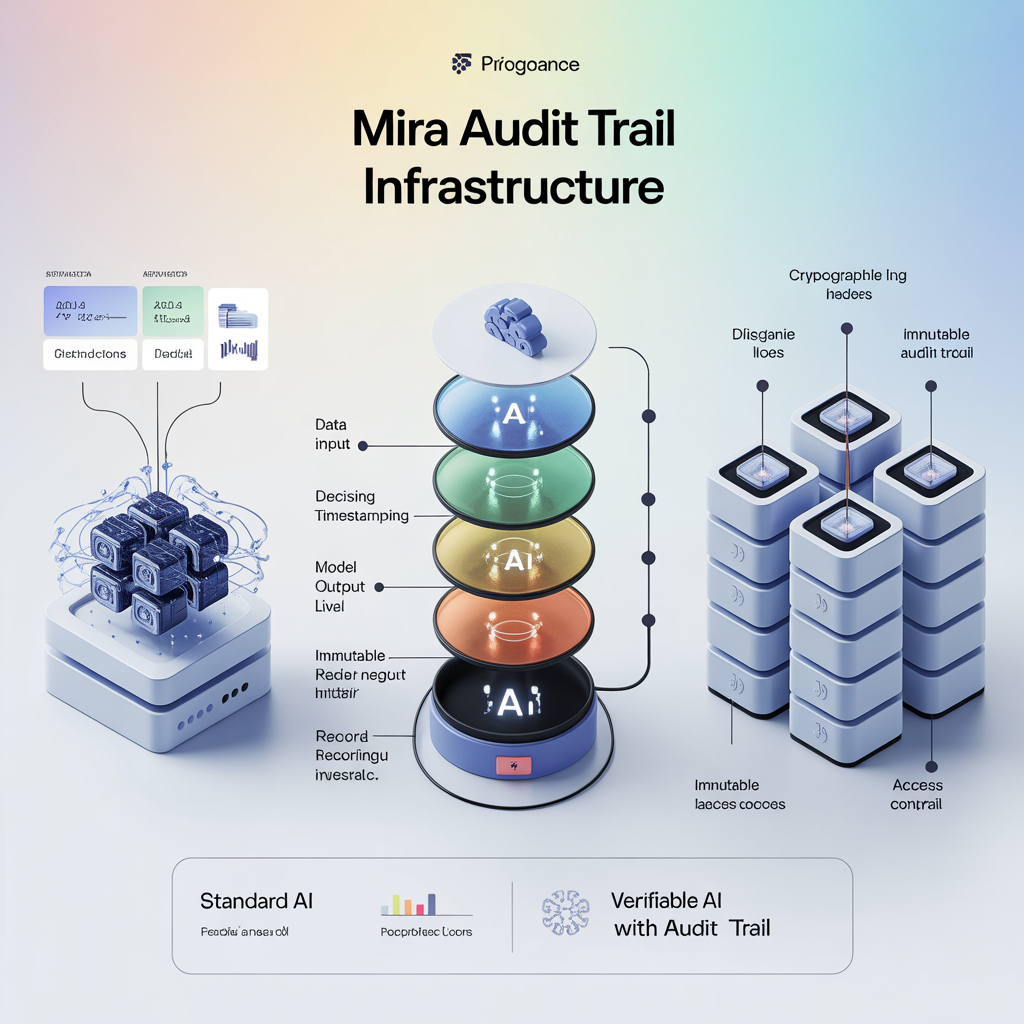

A força central da Mira Audit reside em seu registro detalhado e imutável: cada decisão tomada por um sistema de IA é registrada, datada e vinculada a entradas de dados relevantes. Em teoria, essa transparência poderia construir confiança e permitir uma revisão independente. No entanto, críticos argumentam que simplesmente ter uma trilha de auditoria não garante automaticamente responsabilidade ou interpretabilidade. Órgãos de supervisão e partes interessadas ainda devem navegar pela complexa documentação técnica - um fardo que pode deslocar a responsabilidade em vez de realmente democratizar o acesso.

Além disso, enquanto a Mira Audit exalta a rastreabilidade de ponta a ponta como a espinha dorsal dos sistemas de IA verificáveis, há pouca fiscalização pública sobre como esses registros de auditoria são gerenciados ou quem controla o acesso a registros sensíveis. Existe o risco de que o controle centralizado possa minar a objetividade e levantar novas preocupações de privacidade.

Em última análise, se a IA verificável depende de mecanismos de auditoria confiáveis, como os oferecidos pela Mira Audit Trails, a indústria deve interrogar rigorosamente não apenas o que está sendo registrado - mas como a transparência se traduz em responsabilização significativa para todas as partes envolvidas.

#Mira @Mira - Trust Layer of AI $MIRA #MarketSentimentToday #MarketUpdate #UsaAttack #IranIsraelConflict