Quando ouço “validação de múltiplos modelos”, minha primeira reação não é que soa avançado. Soa atrasado. Não porque sistemas de conjunto sejam novos, mas porque passamos os últimos anos fingindo que escalar um único modelo era a mesma coisa que aumentar a confiabilidade. Não é. Respostas maiores não são as mesmas que respostas verificadas.

Essa é a mudança silenciosa dentro do design da Mira Network. Não trata a inteligência como algo em que você confia porque soa confiante. Trata-a como algo que você valida porque pode estar errada.

A maioria dos sistemas de IA hoje opera como caixas pretas com linguagem persuasiva. Se a saída parece coerente, a aceitamos. Se está errada, culpamos a versão do modelo, ajustamos os prompts ou adicionamos barreiras de proteção. Mas estruturalmente, a suposição de confiança não muda: um sistema gera e esperamos que ele se comporte.

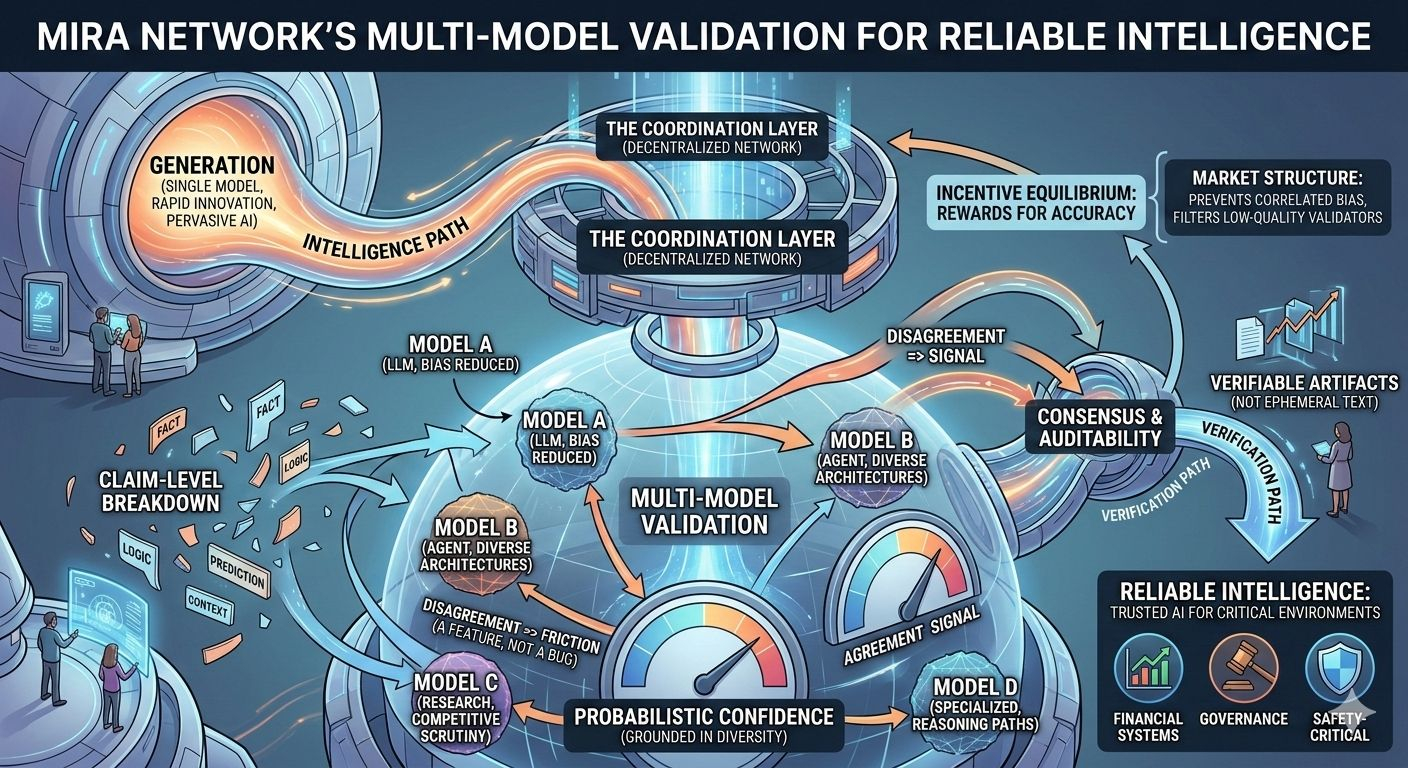

A validação de múltiplos modelos transfere essa responsabilidade. Em vez de um modelo produzir uma resposta que é enviada para baixo, as saídas são divididas em reivindicações discretas. Essas reivindicações são então avaliadas em vários modelos independentes. O acordo se torna sinal. A discordância se torna fricção. E a fricção nesse contexto não é um erro, é uma característica, porque a confiabilidade não se trata de eliminar a incerteza. Trata-se de expô-la.

Quando múltiplos modelos avaliam a mesma reivindicação, você introduz uma forma de escrutínio competitivo. Cada modelo se torna um verificador dos outros. O resultado não é a opinião da maioria por si só, mas sim a confiança probabilística fundamentada na diversidade. Estruturas diferentes, preconceitos de dados de treinamento e caminhos de raciocínio reduzem o risco de um único ponto cego dominar o resultado, mas a mudança mais profunda não é apenas técnica. É arquitetônica.

Ao direcionar a validação através de uma camada de coordenação descentralizada, a Mira transforma o acordo do modelo em algo mais próximo do consenso. A validação não está acontecendo dentro da infraestrutura de um único provedor. Está acontecendo em uma rede onde os resultados podem ser registrados, verificados e auditados. Isso transforma as saídas de IA de texto efêmero em artefatos verificáveis.

Claro que o consenso não elimina magicamente o custo. Múltiplas avaliações significam mais computação. Mais computação significa mais coordenação. Em algum lugar nesse pipeline, os incentivos precisam estar alinhados: quem envia reivindicações, quem as valida, como as disputas são resolvidas e como validadores maliciosos ou de baixa qualidade são filtrados. É aqui que a validação de múltiplos modelos deixa de ser um conceito de pesquisa e se torna uma estrutura de mercado.

Se os validadores são recompensados por precisão, o sistema incentiva avaliações disciplinadas. Se são recompensados por velocidade ou volume, a qualidade pode degradar. Se a participação for muito centralizada, preconceitos correlacionados voltam a surgir. A confiabilidade nesse design não é uma propriedade estática, é um equilíbrio de incentivos e, como qualquer equilíbrio, se comporta de maneira diferente sob estresse.

Em condições calmas, os modelos tendem a concordar sobre reivindicações diretas. O consenso parece forte. Mas o verdadeiro teste aparece em casos extremos, dados ambíguos, prompts adversariais, eventos de rápida mudança. É quando a discordância aumenta. A pergunta então se torna: como o sistema lida com a divergência? Ele expõe a incerteza de forma transparente? Ele atrasa a execução? Ele atribui pontuações de confiança que aplicações a montante podem interpretar racionalmente?

Porque a validação de múltiplos modelos só melhora a confiabilidade se as aplicações respeitarem de fato o sinal.

Se sistemas a montante tratam "validado" como binário, sim ou não, podem ignorar gradientes de confiança sutis. Mas se integrarem saídas probabilísticas em modelos de risco, motores de precificação ou agentes autônomos, a validação se torna infraestrutura. Deixa de ser um emblema e passa a ser uma camada de controle.

Há outra mudança sutil aqui: a responsabilidade. Em sistemas de modelo único, a falha é fácil de atribuir erroneamente. Foi o dado de treinamento? O prompt? O wrapper de implantação? Em uma estrutura de múltiplos modelos, a discordância se torna rastreável. Você pode ver quais modelos divergiram, quais validadores sinalizaram problemas e como o consenso foi alcançado. Essa auditabilidade não apenas melhora a depuração, mas muda a dinâmica de confiança. Os usuários não são solicitados a acreditar. Eles são mostrados o caminho da verificação.

Essa transparência, no entanto, introduz sua própria camada competitiva. Validadores com históricos de desempenho mais fortes ganham reputação. Modelos que se alinham consistentemente com a verdade validada ganham peso. Com o tempo, a confiabilidade se torna algo mensurável e comercializável.

É por isso que não vejo a validação de múltiplos modelos da Mira apenas como uma salvaguarda contra alucinações. Vejo isso como uma tentativa estrutural de separar a geração de inteligência da verificação de inteligência. A geração pode inovar rapidamente. A verificação pode permanecer disciplinada. Os dois não precisam se mover na mesma velocidade.

E essa separação importa se a IA vai operar de forma autônoma em sistemas financeiros, camadas de governança ou ambientes críticos de segurança. Confiança sem verificação aumenta o risco. Verificação sem diversidade colapsa em validação circular. A coordenação de múltiplos modelos tenta equilibrar ambos.

O valor a longo prazo desse design não será julgado pela frequência com que os modelos concordam em condições normais. Será julgado por como a rede se comporta quando os incentivos são testados, quando atores adversariais tentam manipular o consenso, quando a volatilidade do mercado pressiona a latência, quando os validadores enfrentam erros correlacionados. Nesses momentos, a confiabilidade não é mais teórica. É operacional.

Então a verdadeira questão não é se a validação de múltiplos modelos melhora a qualidade da resposta. É se a estrutura de incentivo, a lógica de coordenação e os mecanismos de transparência são fortes o suficiente para manter a confiabilidade intacta quando as condições estão bagunçadas.

Porque, no final, a inteligência não é poderosa porque pode gerar. É poderosa porque pode ser confiável.

@Mira - Trust Layer of AI $MIRA #Mira #USCitizensMiddleEastEvacuation #MarketRebound $TOWNS