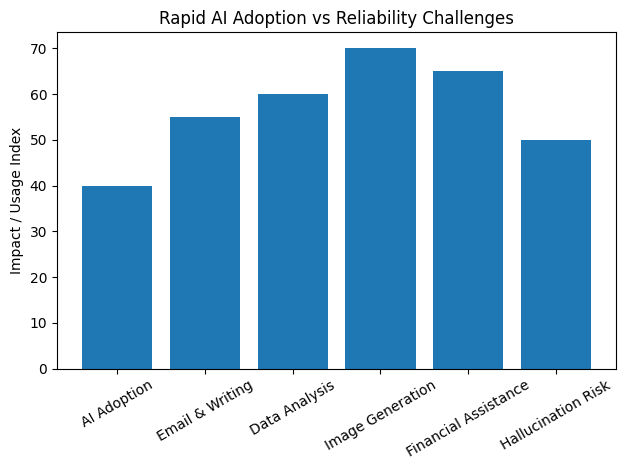

Tenho pensado muito sobre quão rapidamente a inteligência artificial está se tornando parte da vida cotidiana. Apenas alguns anos atrás, a IA era usada principalmente em laboratórios de pesquisa ou empresas especializadas. Hoje, ela escreve e-mails, analisa dados, cria imagens e até ajuda as pessoas a tomar decisões financeiras. A velocidade dessa transformação é incrível. Mas quanto mais poderosos esses sistemas se tornam, mais uma pergunta começa a importar: podemos realmente confiar no que a IA produz?

A maioria dos modelos de IA hoje opera usando probabilidade. Eles analisam quantidades massivas de dados e preveem a resposta mais provável a uma pergunta. Muitas vezes, os resultados são impressionantes e precisos. Mas, às vezes, esses sistemas produzem informações que simplesmente não estão corretas. Eles podem inventar fatos, interpretar mal fontes ou criar declarações que parecem convincentes, mas não têm evidências reais por trás delas. Esse fenômeno é frequentemente chamado de alucinação e é uma das maiores limitações da IA moderna.

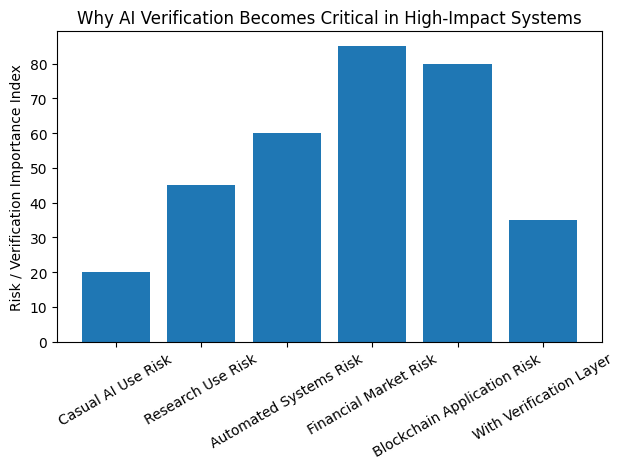

Para conversas casuais ou tarefas simples, esses erros podem não causar problemas sérios. Mas quando a IA começa a ser usada em mercados financeiros, sistemas automatizados, ambientes de pesquisa ou aplicações de blockchain, a precisão se torna extremamente importante. Uma peça de informação incorreta pode levar a decisões ruins, perdas financeiras ou confiança danificada. É por isso que a verificação está se tornando um dos tópicos mais importantes no futuro da inteligência artificial.

A Mira Network aborda esse desafio de uma perspectiva muito interessante. Em vez de tentar competir na corrida para construir modelos de IA maiores ou mais rápidos, o projeto se concentra em tornar as saídas de IA confiáveis e verificáveis. O objetivo não é apenas gerar informações, mas confirmar se essas informações são realmente corretas.

A ideia central por trás da Mira Network é transformar saídas complexas de IA em reivindicações menores e verificáveis. Quando um sistema de IA gera uma resposta, a Mira não aceita simplesmente a saída como um único bloco de informação. Em vez disso, o sistema separa essa resposta em várias declarações individuais. Cada declaração pode então ser examinada e validada independentemente.

Essas reivindicações são distribuídas por uma rede de validadores independentes de IA. Cada validador revisa as reivindicações e verifica sua precisão. Como o processo de validação é descentralizado, o sistema não depende de um único modelo, uma única empresa ou uma única autoridade. Em vez disso, múltiplos participantes contribuem para o processo de verificação, criando um consenso sobre o que é verdadeiro e o que não é.

Essa estrutura descentralizada cria uma forma mais forte de confiança. Em vez de confiar em uma única fonte, a rede constrói confiança por meio de um acordo distribuído. A tecnologia blockchain ajuda a coordenar esse processo, garantindo que os resultados da verificação sejam transparentes e auditáveis.

Outra parte importante do sistema é a estrutura de incentivos. Participantes que fornecem verificações precisas são recompensados, enquanto comportamentos desonestos ou descuidados podem ser penalizados. Esses incentivos econômicos ajudam a manter a integridade da rede. Eles incentivam os participantes a contribuir com análises honestas e desencorajam a manipulação ou validação falsa.

O que eu acho particularmente empolgante é como esse modelo poderia apoiar o futuro dos sistemas autônomos. Nos próximos anos, agentes de IA podem operar diretamente em finanças descentralizadas, mercados de dados e infraestrutura digital. Esses agentes poderiam analisar mercados, executar estratégias e interagir com contratos inteligentes sem intervenção humana. Em um ambiente assim, informações confiáveis se tornam essenciais.

Uma camada de verificação como a Mira Network pode atuar como uma salvaguarda para esses sistemas. Ao confirmar a precisão das saídas de IA antes que sejam usadas em processos críticos, a rede pode reduzir riscos e melhorar a confiabilidade. Em vez de confiar cegamente em modelos de IA, desenvolvedores e usuários têm acesso a inteligência verificada.

À medida que a inteligência artificial continua a se expandir em novas áreas da tecnologia, a confiança se tornará um dos recursos mais valiosos. Modelos poderosos sozinhos não são suficientes. Os sistemas também devem provar que suas saídas são corretas e confiáveis. A Mira Network representa uma tentativa de construir essa camada de confiança para o mundo impulsionado pela IA.

O futuro da IA provavelmente será moldado não apenas pela inovação no design de modelos, mas também por sistemas que garantem transparência e responsabilidade. Projetos que combinam inteligência artificial com verificação descentralizada podem desempenhar um papel importante nessa transformação.

Para mim, a Mira Network representa um passo inicial em direção a um futuro onde a inteligência não é apenas poderosa, mas também comprovável.